Author: Денисенко А.Н.

Tags: электротехника общая радиотехника радиотехника

ISBN: 5-93517-214-3

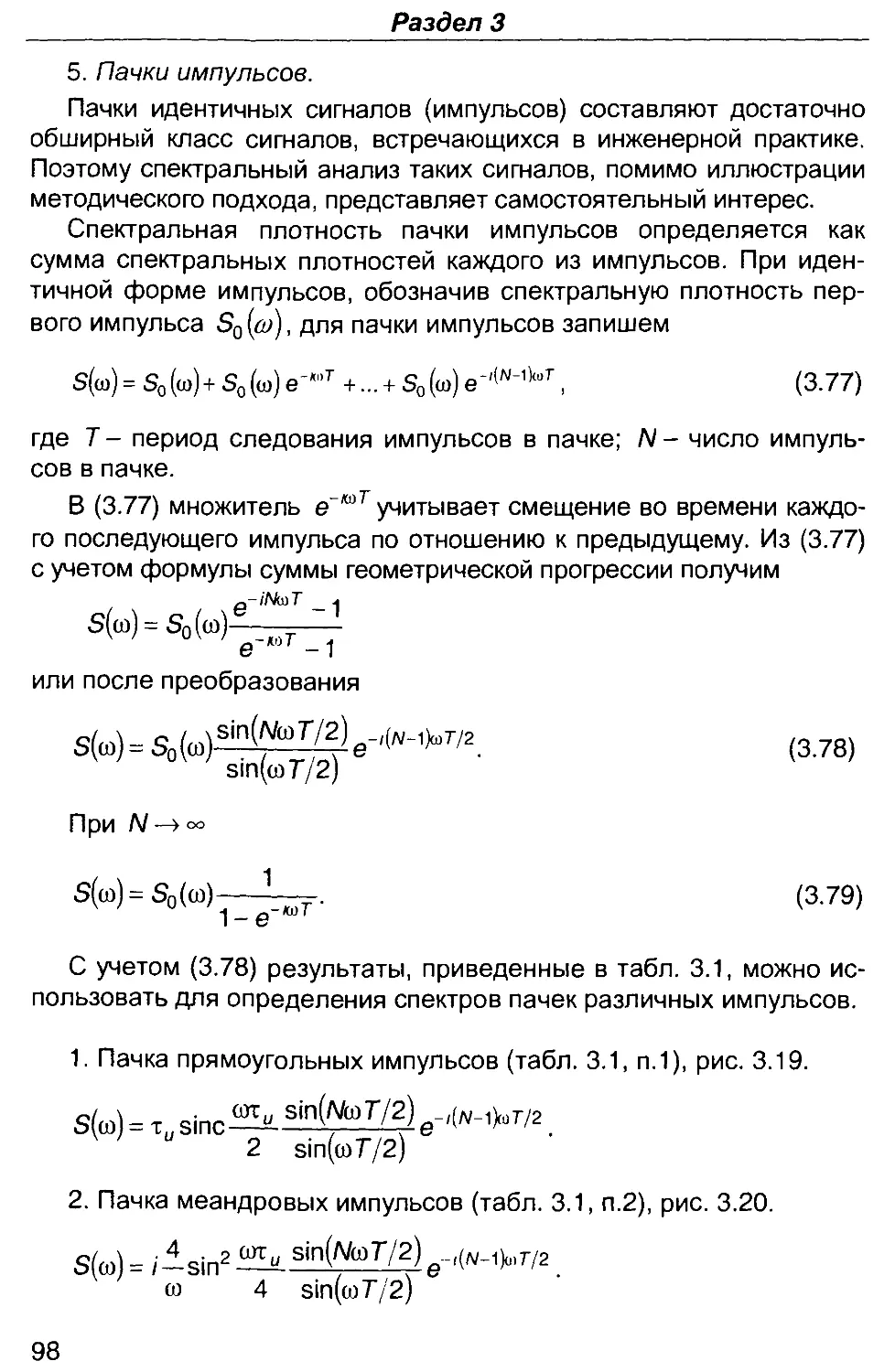

Year: 2005

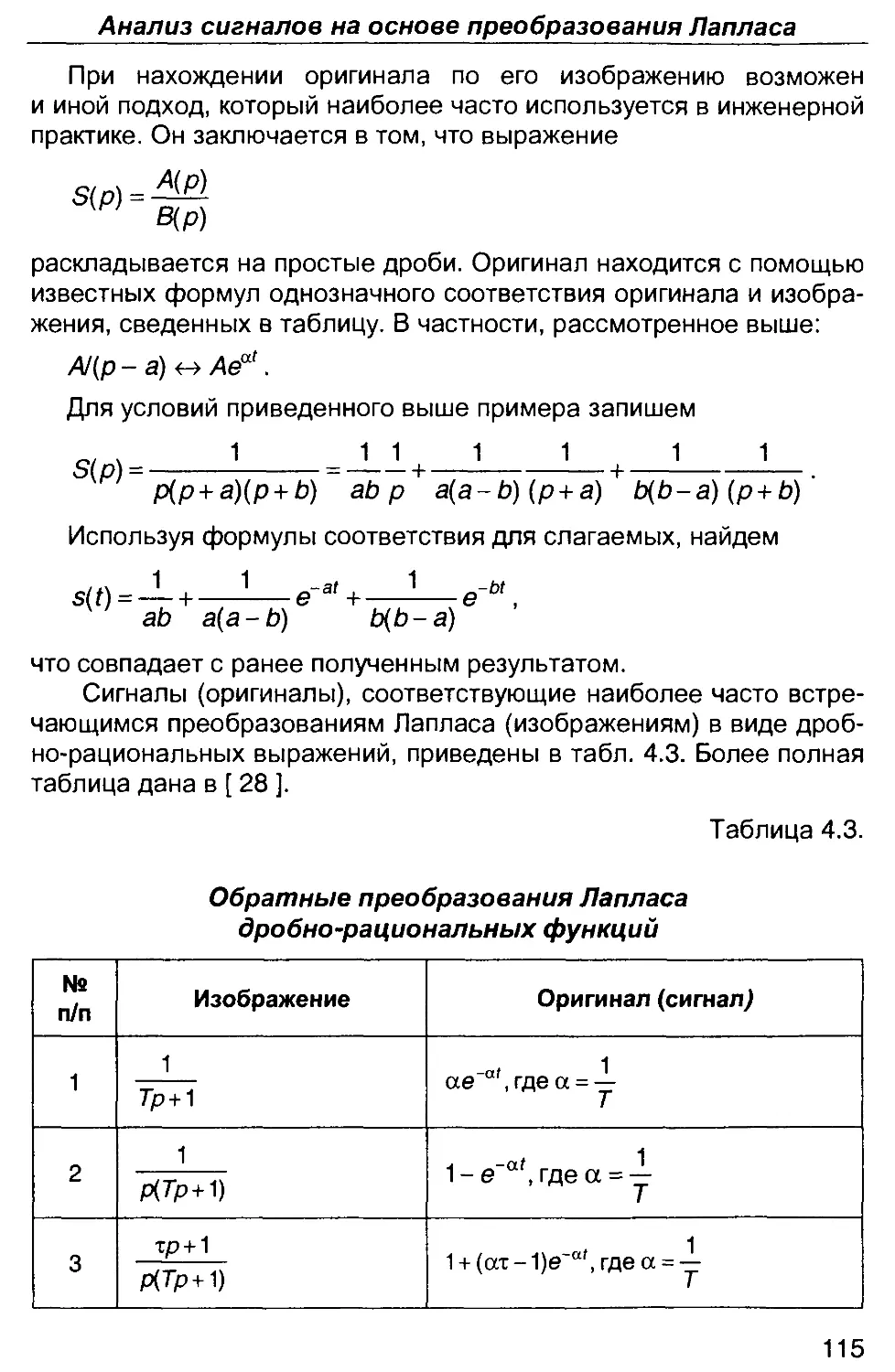

Text

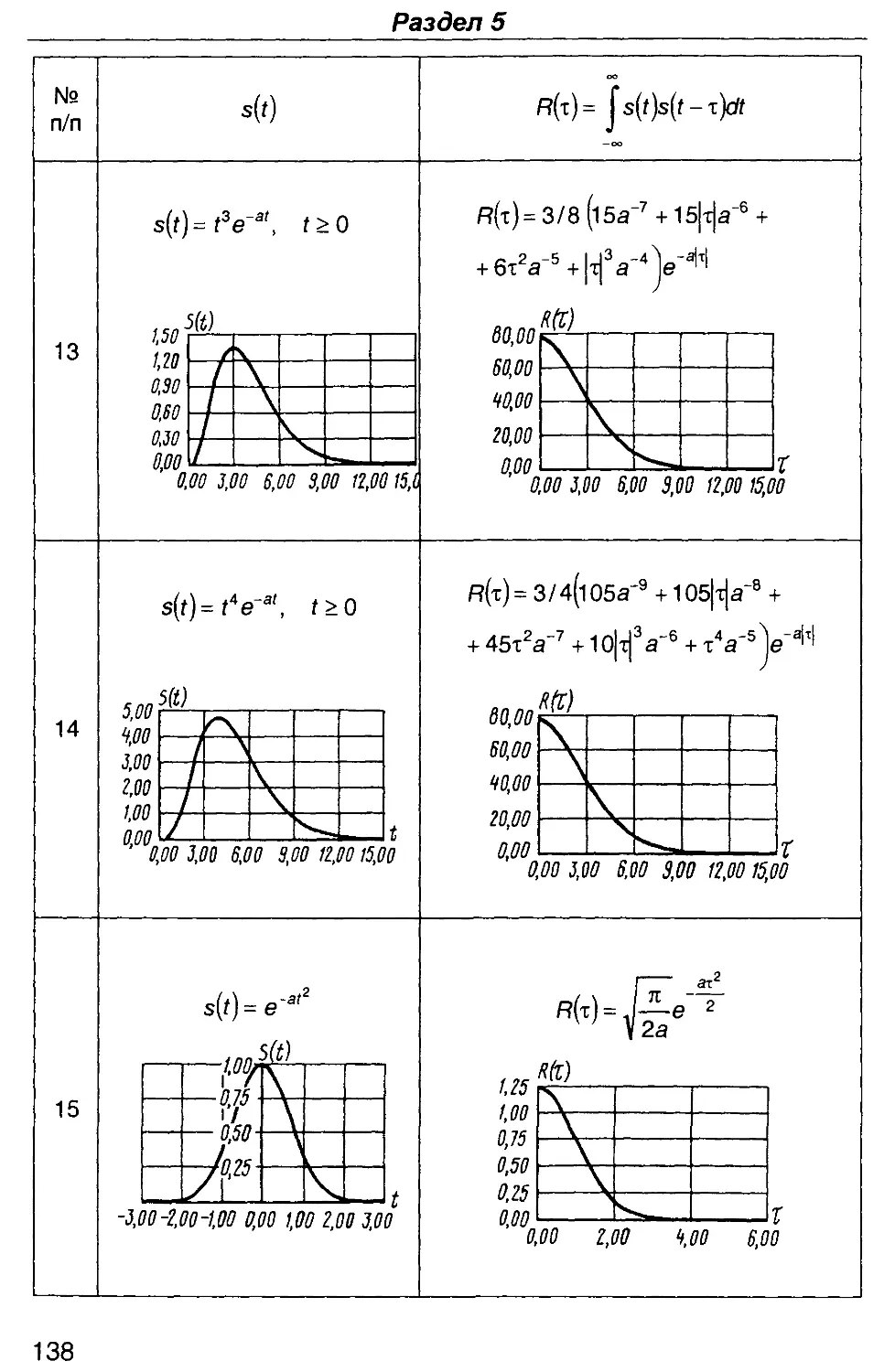

А. Н. Денисенко

Теоретическая

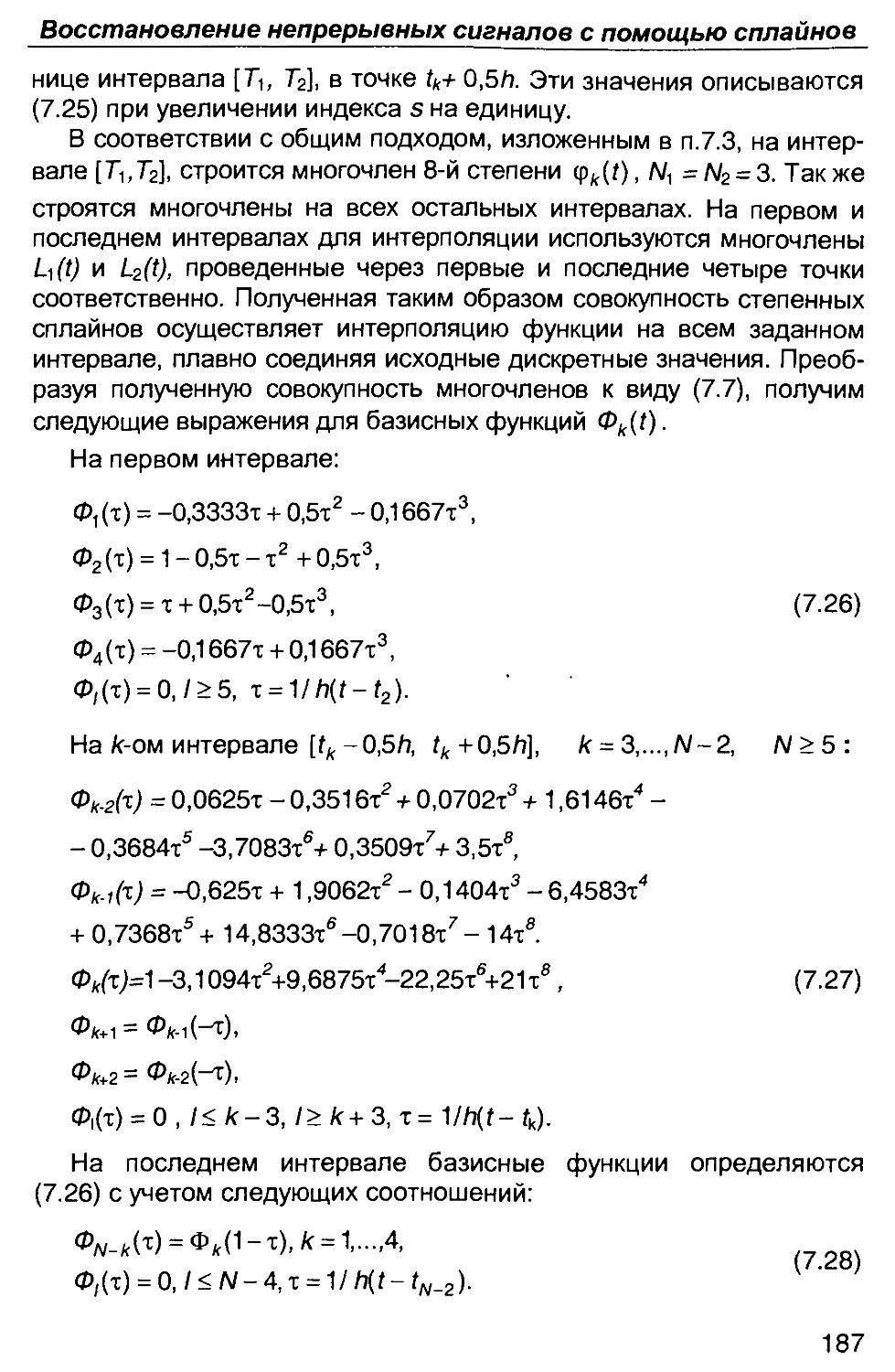

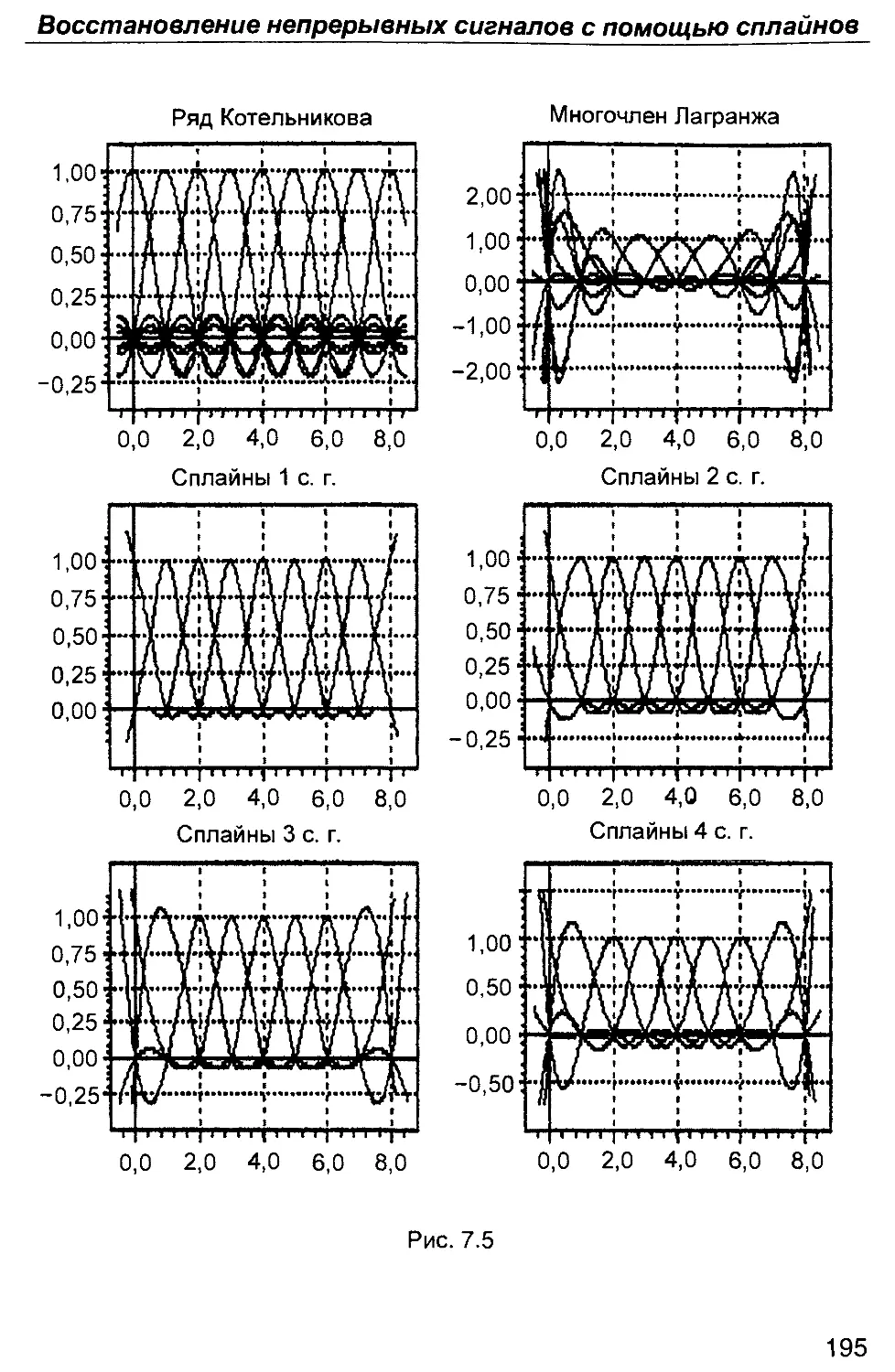

радиотехника

СПРАВОЧНОЕ ПОСОБИЕ

А. Н. Денисенко

УДК 621.398.97@31)

ББК 32.84

ДЗЗ

СИГНАЛЫ

Теоретическая

радиотехника

СПРАВОЧНОЕ ПОСОБИЕ

Денисенко А. Н.

ДЗЗ Сигналы. Теоретическая радиотехника. Справочное пособие. -

М: Горячая линия-Телеком, 2005. - 704 с: ил.

ISBN 5-93517-214-3.

В сжатой, приемлемой для инженерной и исследовательской практики

форме обобщены и достаточно полно изложены методы анализа детерми-

детерминированных сигналов (часть 1) и случайных сигналов и шумов (часть 2), ис-

используемые в теоретической радиотехнике. В каждом разделе теоретиче-

теоретическая часть заканчивается расчетными выражениями и примерами расчета

по ним.

Для инженеров и исследователей, работающих в области радиотехни-

радиотехники, преподавателей, студентов старших курсов радиотехнических факульте-

факультетов вузов, аспирантов.

ББК 32.84

Адрес издательства в Интернет www.techbook.ru

e-mail: radios_hl@ mtu-net.ru

Справочное издание

Денисенко Александр Николаевич

СИГНАЛЫ

ТЕОРЕТИЧЕСКАЯ РАДИОТЕХНИКА

Справочное пособие

Редактор А. Е. Павлов

Корректор В. П. Петрова

Художник Л. Г. Летинов

Подготовка оригинал-макета Ю. Н. Рысина

Лицензия ЛР № 071825 от 16.03.99 г.

Подписано к печати 02.10.2004. Формат 60x90 1/16

Уел печ л. 44. Изд №214. Тираж 1500 экз.

Москва

Горячая линия - Телеком

2005

ISBN 5-93517-214-3

© А. Н. Денисенко, 2005

© Оформление издательства

«Горячая линия-Телеком», 2005

С глубочайшим уважением и благодарностью

Т.В.Ковыловой и Д.С.Малисову,

моим феноменальным школьным учителям.

ПРЕДИСЛОВИЕ

Настоящее время - время информационных технологий и ком-

коммуникационных систем. Интернет, системы связи (в том числе нахо-

находящиеся в стадии интенсивного развития - мобильные системы),

телевизионные системы, системы мониторинга и другие различного

назначения, менее распространенные, но не менее важные, это все

проявления тенденций развития цивилизации. Основным носителем

информации всех известных и мыслимых систем описанного плана

являются сигналы. (Сигнал и определяется как физический процесс,

предназначенный для переноса информации или содержащий ее).

В этих условиях теория сигналов, методы их исследования пред-

представляют несомненный интерес не только для радистов, как это час-

часто считалось до последнего времени, но и для специалистов самых

различных областей. Особое внимание уделяется цифровой обра-

обработке сигналов. Именно цифровая обработка предоставляет наи-

наибольшие возможности при разработке и совершенствовании различ-

различного рода систем.

Книга «Сигналы», представляющая справочное пособие, по-

посвящена описанию и методам анализа детерминированных и слу-

случайных сигналов и шумов. Методы исследования сигналов находят-

находятся в динамике, обусловленной прежде всего технологическим про-

прогрессом. К настоящему времени накоплен достаточно большой

объем материала по исследованию различных видов сигналов;

список работ, посвященных этой тематике, обширен. Однако явно

ощущается недостаток в литературе, где в достаточно сжатой и

приемлемой для инженерной и исследовательской практики форме

обобщенно излагались бы методы анализа сигналов различного

вида. Тем более есть необходимость проведения анализа как де-

детерминированных, так и случайных сигналов в рамках единого ме-

методического подхода. Автор полагает, что в книге нашли отражение

все известные направления исследований основных видов сигна-

сигналов как детерминированных, так и случайных.

Основу книги, как указывалось, составляют известные методы

анализа детерминированных и случайных сигналов; они обобщены

Предисловие

и дополнены оригинальным материалом, полученным автором. Ка-

Каждый законченный фрагмент книги содержит расчетные выраже-

выражения, которые могут быть использованы для получения алгоритмов и

программ расчета основных характеристик сигналов. Однако рас-

расчетные выражения сами по себе не всегда позволяют оценить

влияние различных параметров на характеристики сигналов. Такую

оценку в определенной степени могут дать многочисленные приме-

примеры и графики, построенные по результатам расчета. Этим объяс-

объясняется то обстоятельство, что книга содержит большое число таб-

таблиц и рисунков (графиков).

В последнее время проявляется повышенный интерес к вейв-

лет-преобразованиям. Вейвлеты представляют семейство функций,

описывающих сигналы и используемых главным образом для пре-

преобразований изображений, в первую очередь их сжатия и переноса.

Содержание вейвлет-преобразований выходит за пределы пред-

представляемой книги, поскольку они находятся уже в области приме-

применения сигналов. Однако материал книги является той теоретиче-

теоретической базой, которая лежит в основе этого сравнительно нового ме-

метода обработки сигналов.

Книга содержит две части: часть 1 «Детерминированные сигна-

сигналы» и часть 2 «Случайные сигналы и шумы».

Первая часть посвящена методам исследования детерминиро-

детерминированных сигналов. В разд. 1 рассматриваются различные формы

представления сигналов, дается геометрическая интерпретация

сигналов. Приводится краткая классификация сигналов, которая

позволяет более четко понять логику построения книги.

В разд. 2 изложены основы обобщенного спектрального анали-

анализа сигналов. Рассматривается разложение сигналов по элементар-

элементарным составляющим (представленных временных функций, описы-

описывающих сигналы,в виде обобщенного ряда Фурье). Приведены

примеры такого разложения с использованием многочленов Ле-

жандра, Чебышева, Лагерра, Эрмита и функций Уолша. При анали-

анализе сигналов и цепей указанные функции могут иметь и другое при-

приложение, в том числе при аппроксимации и интерполяции сигналов

и их характеристик. Поэтому рассмотрение ортогональных систем

функций дает не только примеры обобщенного спектрального ана-

анализа, но имеет и самостоятельное значение.

В разд.З излагаются основы гармонического анализа сигналов:

временная функция, описывающая сигнал, раскладывается в три-

тригонометрический ряд Фурье или используется ее преобразование

Фурье. При анализе сигналов наряду с преобразованием Фурье

может найти применение и его модификация - преобразование

Предисловие

Хартли. Совместное рассмотрение этих двух видов преобразова-

преобразований дает возможность сравнительной оценки их эффективности.

Широкое применение при анализе сигналов находит и преобра-

преобразование Лапласа. Оно используется, прежде всего, при анализе

сигналов в линейных цепях. Особенности преобразования Лапласа

и его применения рассматриваются в разд. 4.

Содержание разд. 5 составляет корреляционный анализ де-

детерминированных сигналов. Определены корреляционные функции

периодических и непериодических сигналов. Даны соотношения,

связывающие корреляционные функции со спектрами сигналов.

Дискретизации и восстановлению непрерывных сигналов посвя-

посвящены разд. 6 и 7. Дискретизация и восстановление сигналов лежат

в основе цифровой обработки. Этим во многом определяется объем

и содержание разделов. Рассматриваются дискретные преобразова-

преобразования (преобразование Фурье, z-преобразование, дискретное преобра-

преобразование Хартли) и их применение при анализе сигналов. Дается об-

общая постановка задачи восстановления непрерывного сигнала по его

дискретным значениям. Как пример рассматривается интерполяция

непрерывного сигнала с помощью многочленов Лагранжа и ряда Ко-

тельникова. Содержание разд. 7 составляет сплайновая интерполя-

интерполяция сигнала. Приводятся расчетные выражения для получения вре-

временных функций непрерывных сигналов по их дискретным значениям

с помощью различных видов сплайнов, которые могут использовать-

использоваться при цифровой обработке сигналов.

Описанию и анализу узкополосных сигналов посвящен разд 8.

В нем рассмотрены характеристики и методы анализа в общей по-

постановке, безотносительно к видам узкополосных сигналов.

В последующих разделах проведен анализ различных видов узко-

узкополосных сигналов: с амплитудной модуляцией - разд. 9; с угловой

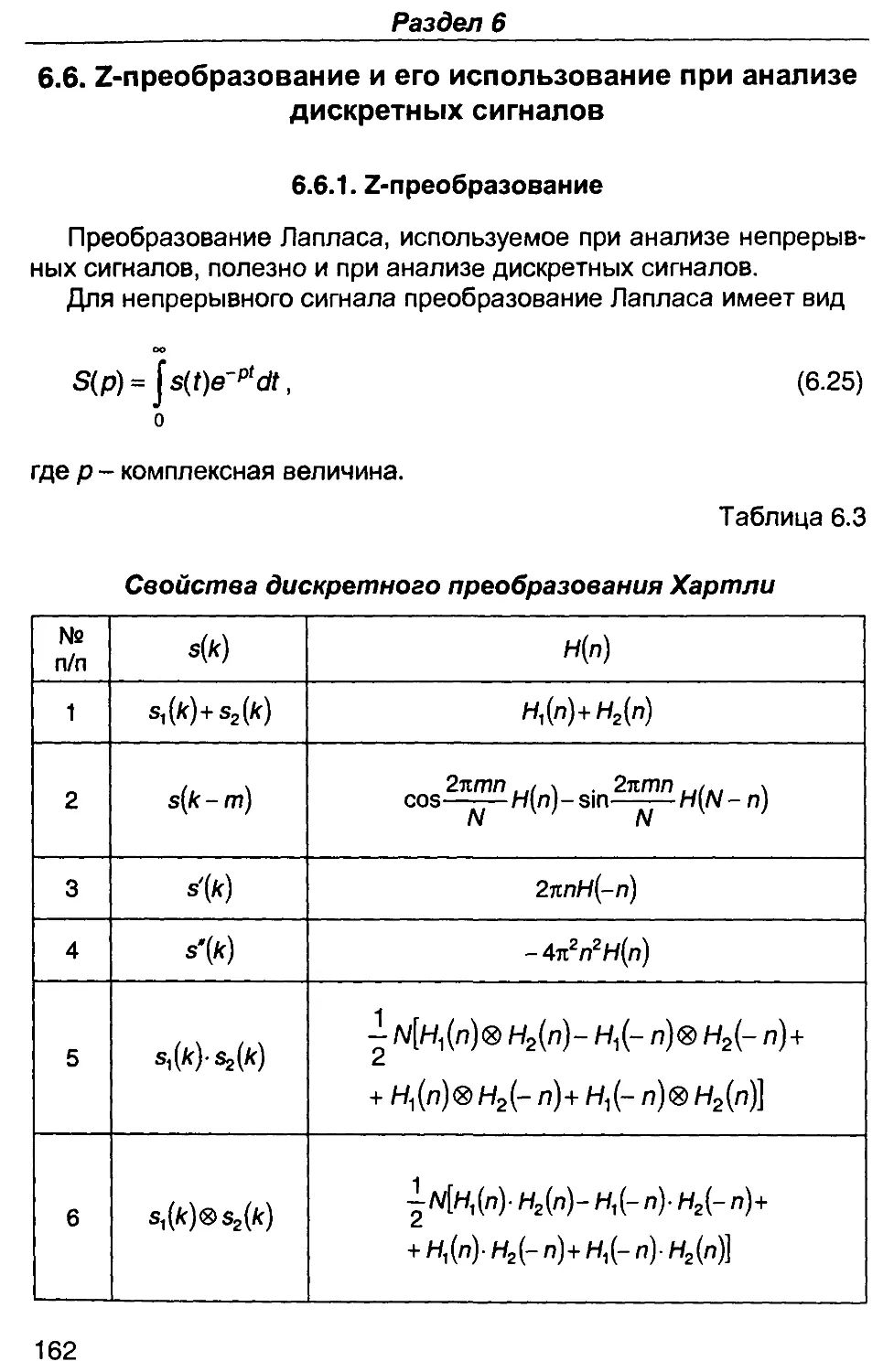

модуляцией - разд. 10; импульсных с частотной линейной и нелиней-

нелинейной модуляцией - разд. 11; кодированных сигналов - разд. 12.

Вторая часть книги посвящена описанию случайных сигналов

и шумов, объединенных общим понятием «случайные процессы»,

и методам их анализа. В соответствии с общим замыслом книги

основной целью является обобщение методов исследования слу-

случайных сигналов и шумов, нашедших наиболее широкое примене-

применение в статистической радиотехнике, изложение их в виде, доступ-

доступном для инженерной и исследовательской практики.

В разд. 14 приводится краткая классификация случайных про-

процессов, описание их характеристик. Одномерному распределению

случайных процессов посвящен разд. 15, многомерное распределе-

распределение случайных процессов рассматривается в разд. 16. Совместное

Предисловие

распределение случайных процессов и распределение их функцио-

функциональных преобразований рассмотрено в разд. 17. Спектральный ана-

анализ случайных процессов составляет содержание разд. 18. Методы

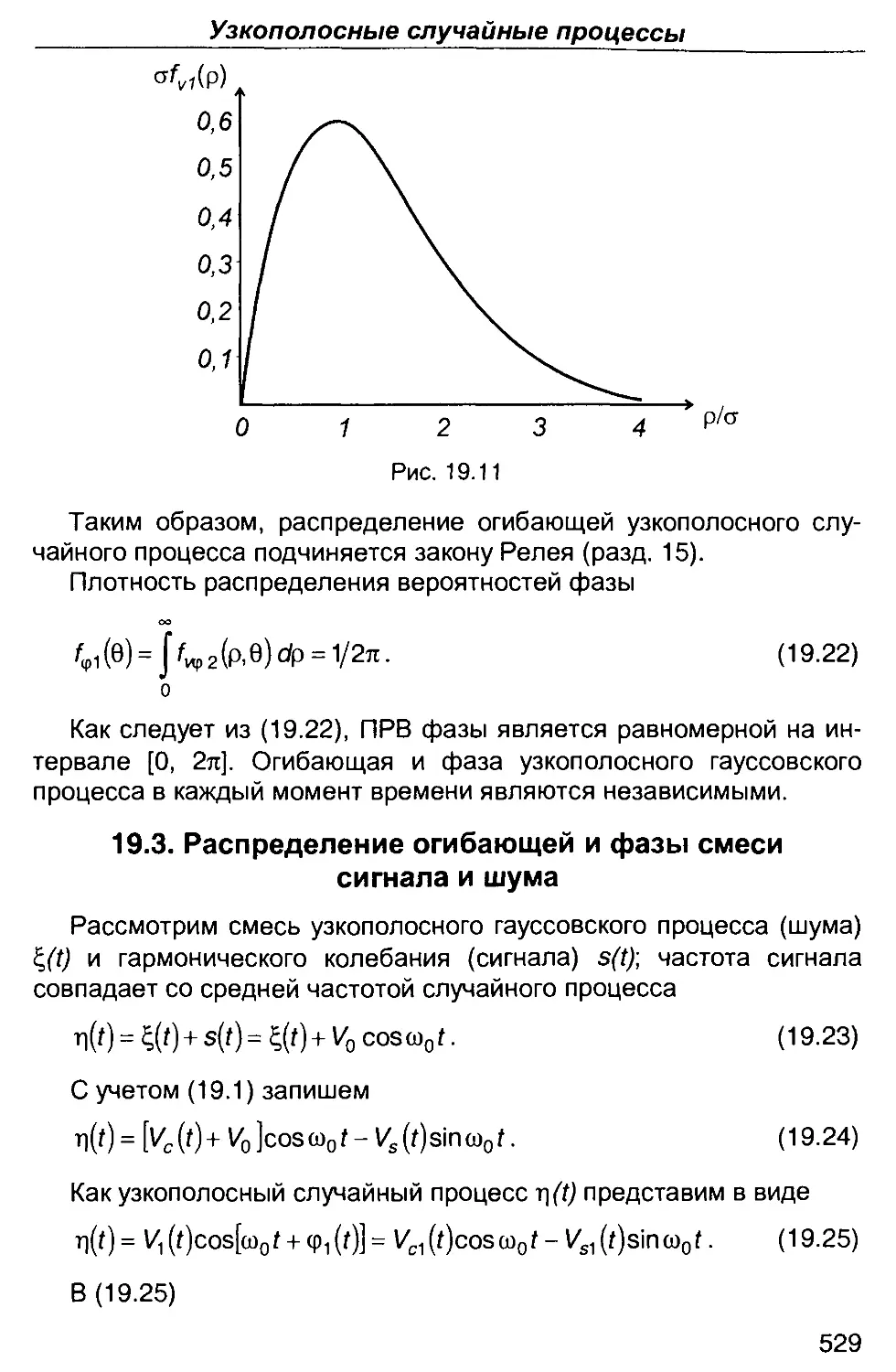

анализа узкополосных случайных процессов изложены в разд. 19.

Эти методы используются при анализе модулированных случайных

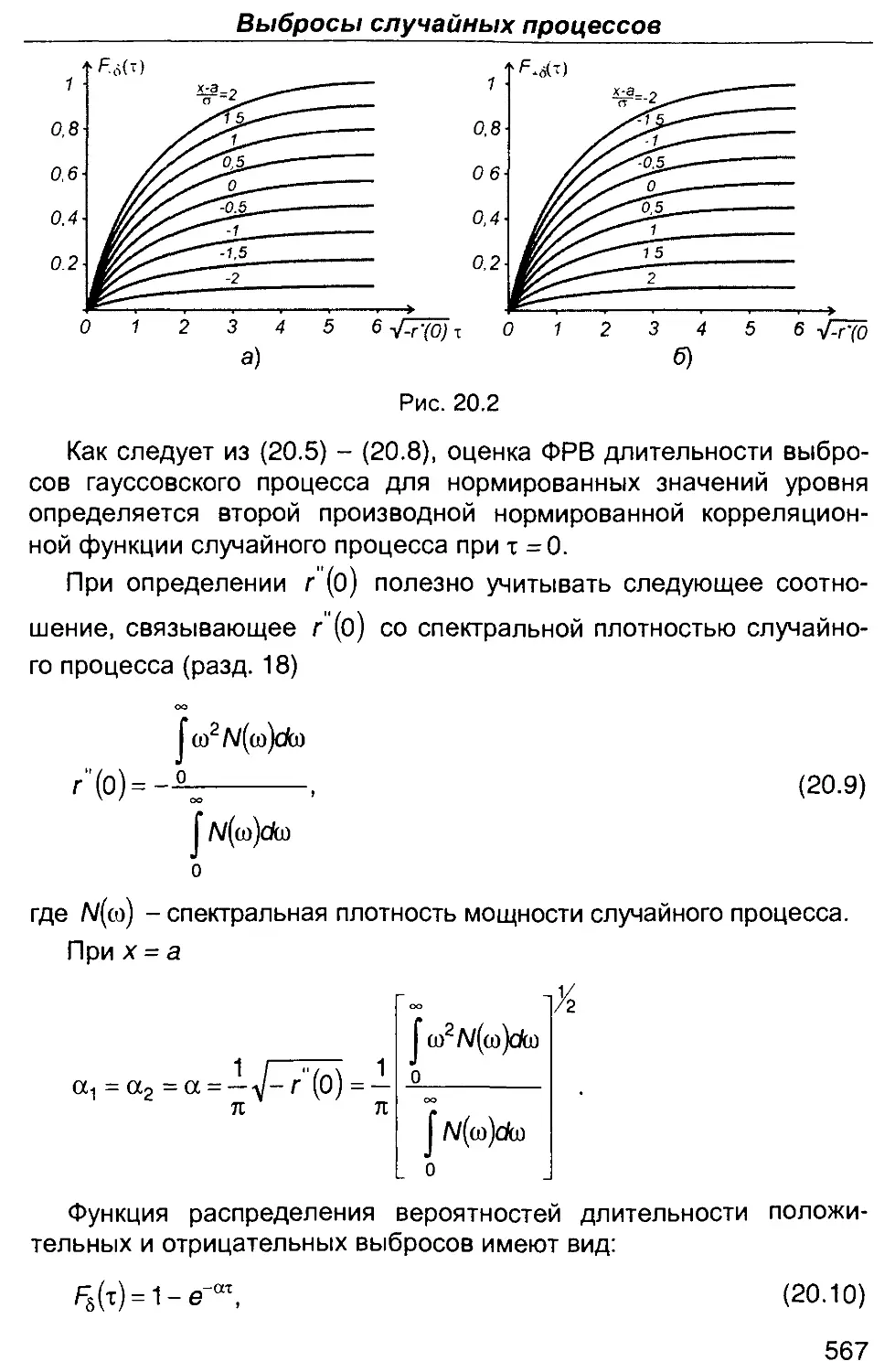

процессов: с амплитудной и угловой модуляцией. В разд. 20 рас-

рассматриваются выбросы случайных процессов, их характеристики,

методы описания и исследования. Методы анализа прохождения

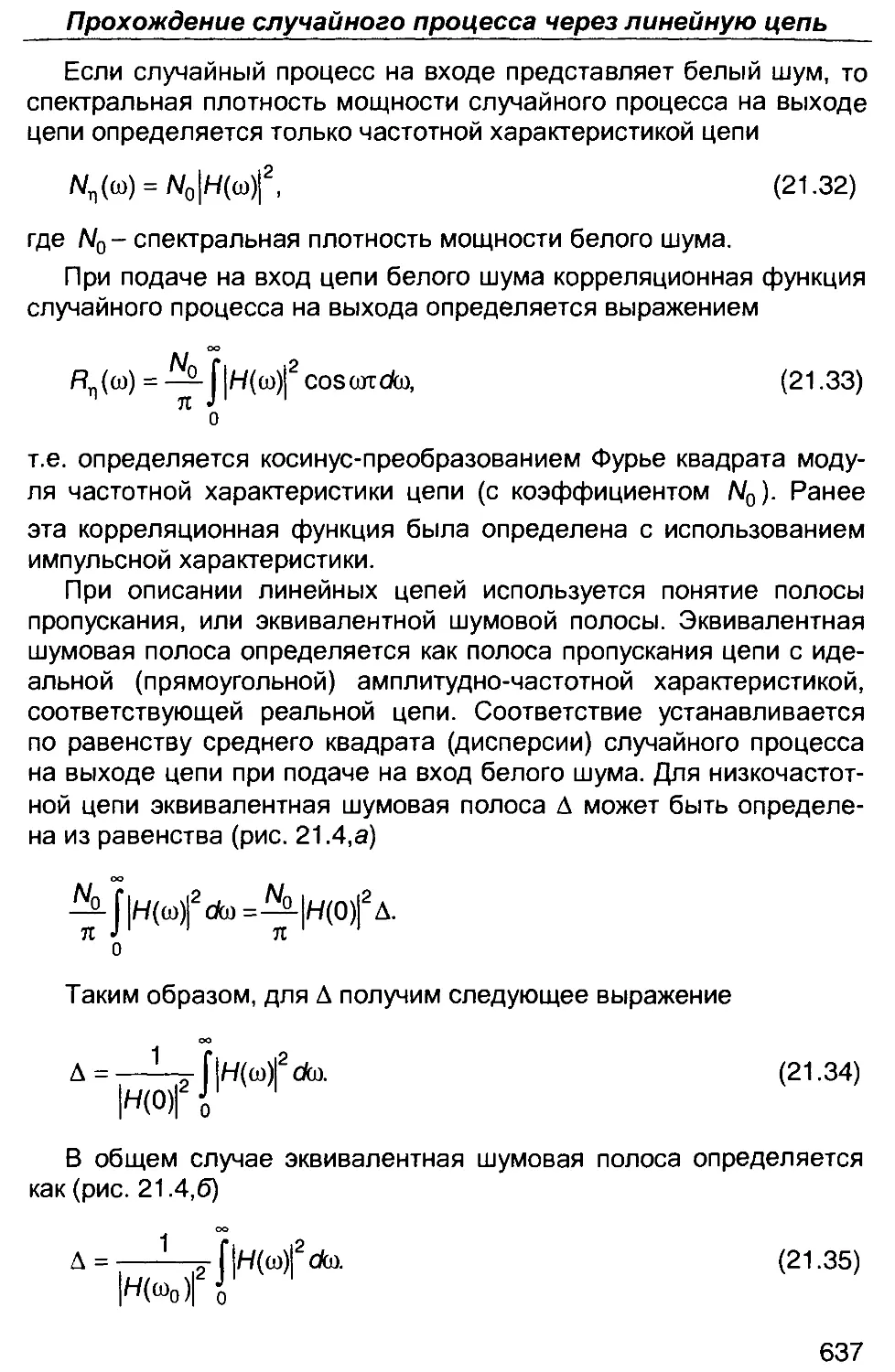

случайных процессов через линейные цепи изложены в разд. 21.

В разд. 22 приводятся методы анализа нелинейных преобразований

случайных процессов. Как иллюстрация методов анализа линейных и

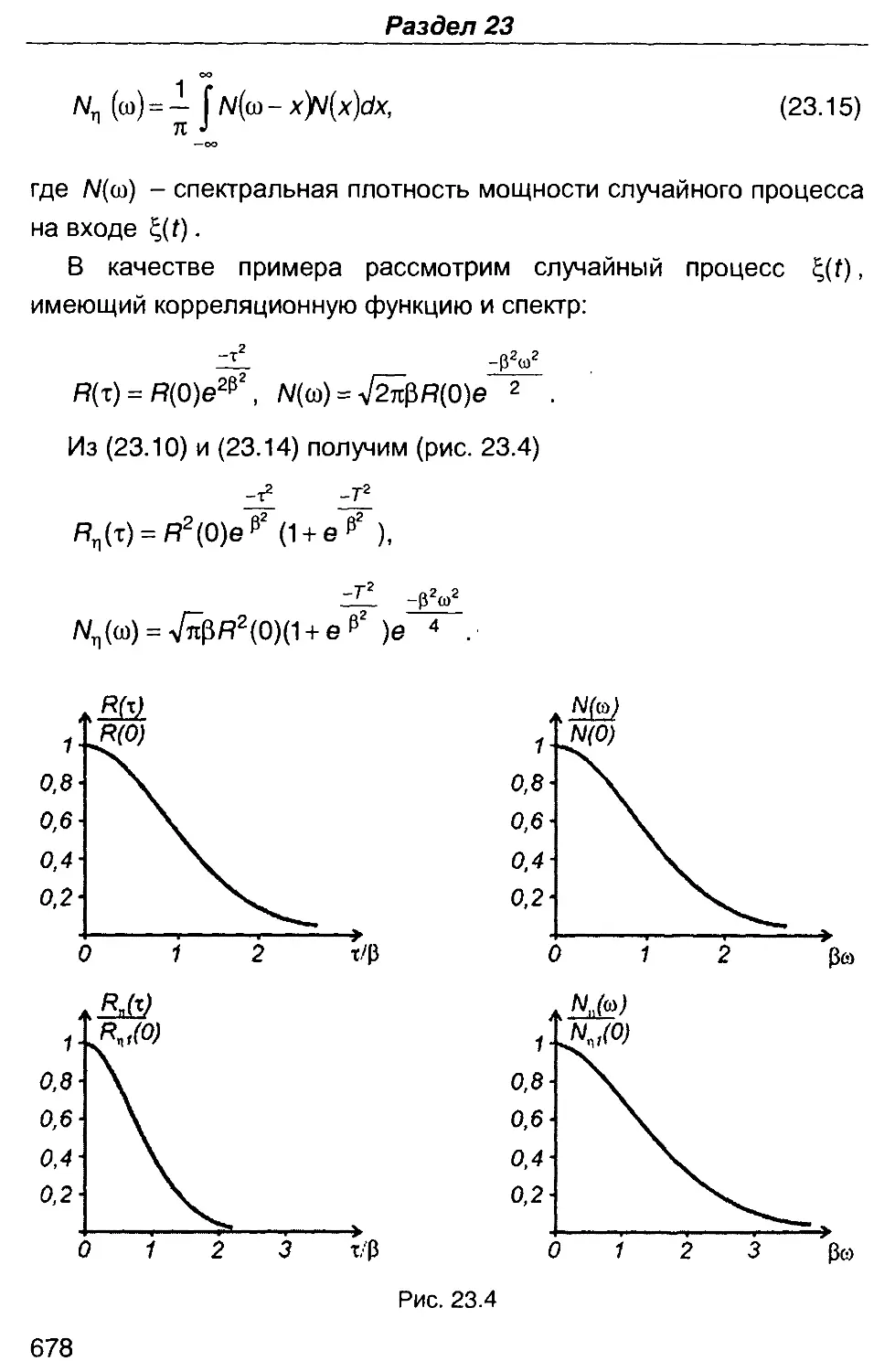

нелинейных преобразований в разд. 23 проводится анализ случай-

случайных процессов на выходе аналогового коррелятора.

Список литературы по каждой части книги включает книги, из-

изданные на русском языке за последние десятилетия. В него также

включены несколько ранних работ, которые в силу несомненных дос-

достоинств представляют не только исторический, но и практический

интерес. В их числе работы на английском языке, не переведенные

полностью на русский. Более полная, а точнее, просто библиогра-

библиография, в книге по такому широкому направлению, которое определено

ее названием, в условиях развитой информационной системы пред-

представляется нецелесообразной. Тем более, что число работ, связан-

связанных с выбранной темой, увеличивается с нарастающим темпом, и

любая библиография к моменту издания книги будет неполной.

Использованные во 2 части справочного пособия термины, оп-

определения и обозначения по возможности приводились в соответст-

соответствии с общепринятыми и рекомендованными ГОСТ 21878-76 «Слу-

«Случайные процессы и динамические системы», термины и определе-

определения. Однако вследствие неполноты и несовершенства указанного

ГОСТа и отсутствия установившейся терминологии и определений

ряда понятий, используемые в пособии, кому-нибудь могут показать-

показаться не совсем удачными.

Книга рассчитана на широкий круг читателей: студентов стар-

старших курсов вузов радиотехнических специальностей, аспирантов,

преподавателей вузов, радиоинженеров и исследователей. Приня-

Принятая последовательность изложения материала от простого к более

сложному позволяет использовать книгу как справочное, так и учеб-

учебное пособие по дисциплинам радиотехнического профиля, где объ-

объектом изучения являются сигналы.

Автор выражает искреннюю благодарность Р.С.Плотникову

и В.В.Гритченко за помощь при компьютерном построении графи-

графиков, приведенных в книге, и ее оформлении.

ЧАСТЫ.

ДЕТЕРМИНИРОВАННЫЕ СИГНАЛЫ

Раздел 1.

СИГНАЛЫ И ИХ ПРЕДСТАВЛЕНИЕ

Сигналом будем называть физический процесс, несущий ин-

информацию или предназначенный для ее передачи. В зависимости

от частоты несущего колебания различают сигналы звукового, ра-

радио, оптического и других диапазонов. Объектом изучения радио-

радиотехники являются радиосигналы. Их частоты лежат в интервале от

3 кГц до 3000 ГГц. Этот интервал разбит на девять диапазонов, ка-

каждый из которых занимает полосу от 0,3-10п до 3-1 ОТц D < п < 12)

(табл. 1.1).

Математический аппарат, используемый при анализе сигналов,

позволяет проводить исследования без учета природы сигналов.

Однако для понимания содержания характеристик сигналов удоб-

удобнее обращаться к их физическому наполнению. С учетом этого в

дальнейшем сигнал будем рассматривать как колебание в радио-

радиотехнической цепи.

Математическая модель сигнала, как правило, представляет

функцию времени, задаваемую в виде аналитического выражения,

графика или таблицы. Термин «сигнал» обычно и используется как

эквивалентный временной функции, описывающей колебание. Та-

Такое описание сигнала является наиболее распространенным, но

оно не исключает и другие формы представления сигналов.

Полезным является представление сигнала в виде взвешенной

суммы более простых составляющих - разложение временной

функции, описывающей сигнал, в ряд по системе базисных функ-

функций. Такое разложение позволяет свести анализ сложного сигнала

к анализу его более простых составляющих. С другой стороны,

представление сигнала в виде ряда может использоваться и как

исходное при его описании.

Для временной функции, описывающей сигнал и удовлетворяю-

удовлетворяющей некоторым условиям, возможно интегральное преобразование.

Интегральное преобразование позволяет перейти от временной

области определения сигнала к области выбранного параметра.

8

Сигналы и их представление

Таблица 1.1,

Классификация диапазонов частот

Но-

Номер

диа-

пазо-

пазона

4

5

6

7

8

9

Диапазон

частот

3 ... 30 кГц

30...

300 кГц

300 ...

3000 кГц

3...

30 МГц

30...

300 МГц

0,3...

ЗГГц

Назва-

Название

частот

Очень

низкие

(ОНЧ)

Низкие

(НЧ)

Сред-

Средние

(СЧ)

Высо-

Высокие

(ВЧ)

Очень

высо-

высокие

(ОВЧ)

Ультра-

высо-

высокие

(УВЧ)

Диа-

Диапазон

волн

100...

10 км

10...

1 км

1000...

100 м

100...

Юм

10...

1 м

100...

10 см

Назва-

Название

волн

Мириа-

метро-

вые

(сверх-

длин-

длинные)

Кило-

метро-

метровые

(длин-

(длинные)

Гекто-

метро-

вые

(сред-

(средние)

Дека-

метро-

метровые

(корот-

(короткие)

Метро-

Метровые

Деци-

метро-

метровые

Примеры

использования

Дальняя навигация,

связь с подводными

лодками

Радиовещание, на-

навигационные систе-

системы, маяки

Морские радиостан-

радиостанции, радиоканалы,

сигналы бедствия;

радиовещание

Радиовещание,

связь, телеграфия,

телефония

Радиовещание, те-

телевидение, назем-

наземная подвижная

связь, управление

воздушным движе-

движением, такси, навига-

навигационные средства,

радиолокация, ра-

радиоастрономия

Телевизионные,

навигационные сис-

системы, спутниковая

связь, радиовысо-

радиовысотомеры, радиоре-

радиорелейная связь

Раздел 1

Но-

Номер

диа-

пазо-

пазона

10

11

12

Диапазон

частот

3...

30 ГГц

30...

300 ГГц

300 ГГц ...

ЗТГц

Назва-

Название

частот

Сверх-

высо-

высокие

(СВЧ)

Крайне

высо-

высокие

(КВЧ)

Гипер

высо-

высокие

(ГВЧ)

Диа-

Диапазон

волн

10...

1 см

10...

1 мм

1...

0,1мм

Назва-

Название

волн

Санти-

метро-

метровые

Милли-

метро-

метровые

Деци-

милли-

метро-

вые

Примеры

использования

Радиолокация, ра-

радиоастрономия; ра-

радиорелейная,

спутниковая связь

Космическая связь

В ряде случаев анализ в области выбранного параметра оказы-

оказывается более простым и, следовательно, предпочтительным в ис-

исследовательской практике. Формула обращения интегрального

преобразования позволяет осуществить обратный переход к вре-

временной функции. Интегральное преобразование может быть исход-

исходным при задании сигнала.

Описанию сигналов большую образность придает их геометри-

геометрическая интерпретация. Представление сигналов в виде векторов

позволяет проводить их исследования известными методами мно-

многомерной геометрии.

Указанные формы представления сигналов рассматриваются

ниже, более подробно.

1.1. Описание сигналов временными функциями

1.1.1. Действительные сигналы

Разнообразие возможных видов сигналов отражается прежде

всего при их описании во временной области. Примерами аналити-

аналитического описания сигналов во временной области являются:

гармонический сигнал (рис. 1.1, а)

s(f)= Vcos(a>0t + <p),

импульсные сигналы:

10

Сигналы и их представление

s(t)=Ve~at,t>0 (рис. 1.1,6), s(t)=Ve-Vf2 (рис. 1.1,в),

модулированные сигналы:

с амплитудной модуляцией

s(f)=l4i + McosQf]cosco0f. (Рис- 1-1>г)>

с частотной модуляцией

s(t) = Vcos[(aQt + mslnQt], (рис. 1.1 ,д).

Число примеров описания сигналов временными функциями

увеличивают последующие разделы и табл. 3.1.

При описании сигналов полезными оказываются разрывные

функции, приведенные в табл. 1.2.

Единичная ступенчатая функция.

Определяется как скачок от 0 до 1 в момент t = О (рис. 1.2,а)

[i,f>0 v '

Скачок в момент убудет обозначаться как a(t-10) (рис.1.2,6).

Единичную ступенчатую функцию называют также функцией

включения, так как умножение а@на временную функцию s(t)

(рис. 1.2,в)

s,(t) = a(t)s(t) A.2)

означает начало сигнала в момент t = 0. Для сигнала, начинающе-

начинающегося в момент t0, можем записать (рис. 1.2,г):

St(t) = o(t-t0)s(t). A.3)

Сигнал, ограниченный во времени с двух сторон, может быть

представлен в виде (рис. 1.2,д)

s,(t) = [c(t-t,)-c(t-t2)]s(t). A.4)

Выражение в квадратных скобках в A.4) описывает прямо-

прямоугольный импульс, имеющий амплитуду, равную единице,

s(t) = a(t-t,)-a(t-t2). A.5)

11

Раздел 1

Рис. 1.1

Единичный импульс.

Для функции, описывающей прямоугольный импульс, иногда

вводят специальное обозначение

rect(x) =

1,-1/2 < х< 1/2

О, при остальных зачениях х

A.6)

12

Сигналы и их представление

Таблица 1.2.

Разрывные функции

№

п/п

Функция

График функции

a(t) =

\\t>0

10, / < О

c(t)

О

o(t-t0) =

\Xt>t0

[o,t<to

/

О U

5@ =

°°,t = О

o,?*o

fifth

too

w

b(t-to) =

~J=t0

o,t*to

$H)i

oo

\(t)

0 tr,

sign(t) =

1, f>0

-1, f<0

sip{t)

-1

rect(t/x) =

fi,|f/x|<1/2

[0,|f/i|>1/2

rectl

Л °i'

rect{[t-to]/z) =

1,|f-fo|/T<1/2

0, t-t0 /t>1/2

rect *-ф

1

0 fo-|t f0 fo-|t f

Прямоугольный импульс длительности хи определяется как

(рис. 1.3,а)

Г1,ти/2<Г<т0/2

/SCf(f/Tu) =

О, при остальных значениях t

A.7)

13

Раздел 1

Рис. 1.2

Обозначение запаздывающего на время t0 импульса имеет вид

(рис. 1.3,6)

rect(t~to/xu) =

%to-cu/2<t<to+Tu/2

О, при остальных значениях t

A-8)

Знаковая функция.

Функция знака sign(x) (сигнатура) равна единице, знак которой

изменяется при переходе t через нуль (рис. 1.4)

14

Сигналы и их представление

si9n{t) = {u>o° ¦ A-9)

Очевидно, функция знака связана со ступенчатой функцией со-

соотношением

a{t) = ^[[ + sign(t)]. A.10)

Импульсная функция.

Импульсная или 6-функция представляет импульс бесконечно

малой длительности в точке / = 0, имеющий бесконечно большую

амплитуду и площадь, равную единице:

5(" = teo°' 1ад<*=1- AЛ1)

Импульсную функцию можно рассматривать как предел, к кото-

которому стремится прямоугольный импульс длительностью х и ампли-

амплитудой 1/т при т->°° (рис. 1.5).

Импульсная функция представляет производную ступенчатой

функции

dv{t)/dt = S(t), A.12)

и наоборот, ступенчатая функция может рассматриваться как инте-

интеграл от импульсной функции

^Ф^'^ио- A13)

Из определения импульсной функции следует

со оо

\s(tW-to)dt = s(to)jb(t-to)dt = s(to). A.14)

— оо —оо

Соотношение A.14) отражает фильтрующее свойство импульс-

импульсной функции.

15

Рис. 1.3

•+t

1.1.2. Комплексные сигналы

При описании и анализе некоторых видов сигналов (в первую

очередь узкополосных) используется понятие комплексного сигнала

s@ = |s(f)|e^( A.15)

где s(f)|, (p(f) - модуль и аргумент комплексной величины s(t).

Комплексная величина s(t) может быть также представлена

в виде

s@ = Re[s@]+/lm[s(f)], A.16)

где Re, Im - действительная и мнимая части комплексной

величины.

Из A.15) и A.16) получим:

lm\s(t)

s(t} = jRe2\s(thlm2ls(t)]; фМ^гсГд-™. A.17)

16

Раздел 1

Сигналы и их представление

Рис. 1.6

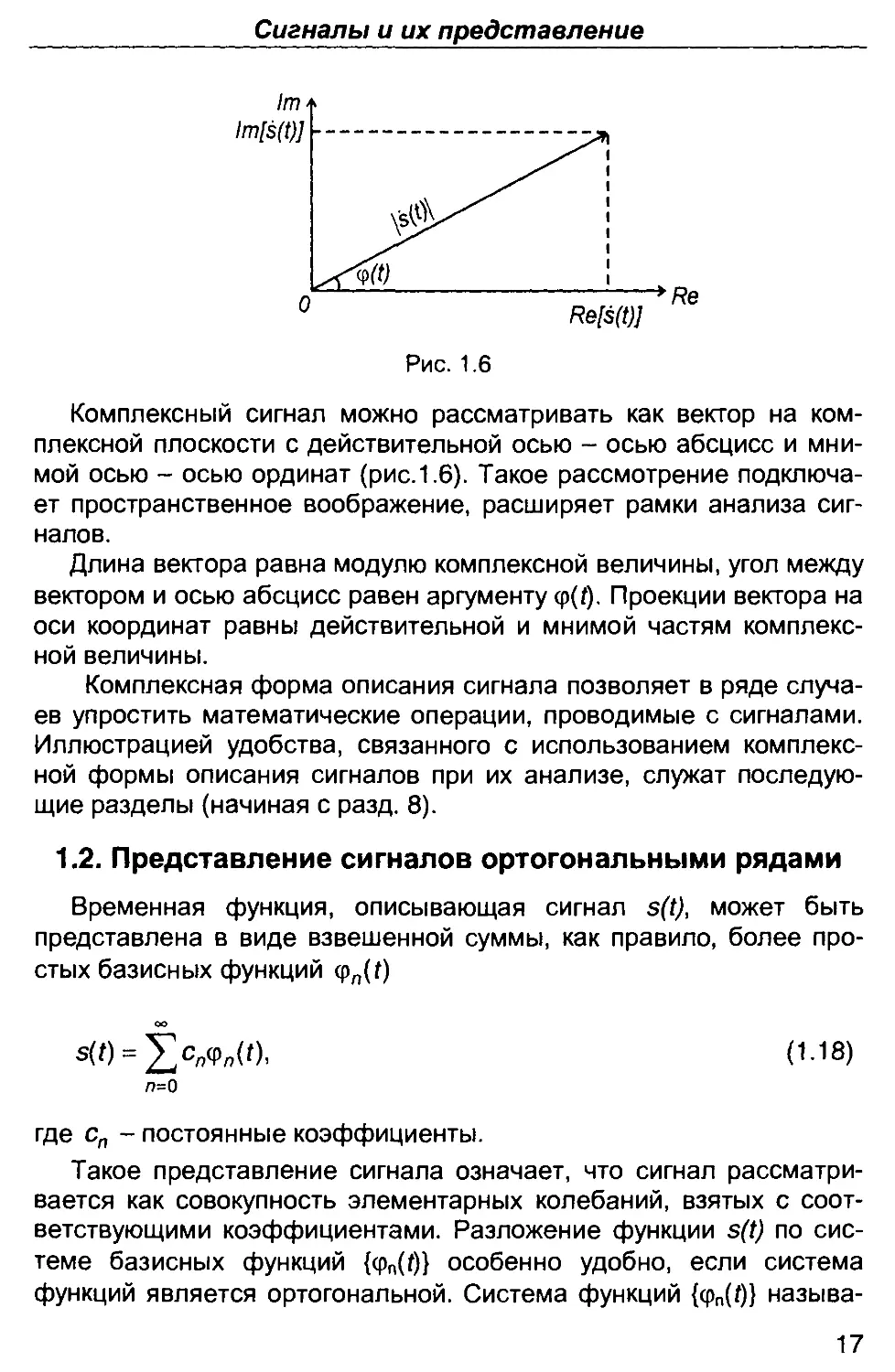

Комплексный сигнал можно рассматривать как вектор на ком-

комплексной плоскости с действительной осью - осью абсцисс и мни-

мнимой осью - осью ординат (рис.1.6). Такое рассмотрение подключа-

подключает пространственное воображение, расширяет рамки анализа сиг-

сигналов.

Длина вектора равна модулю комплексной величины, угол между

вектором и осью абсцисс равен аргументу cp(f). Проекции вектора на

оси координат равны действительной и мнимой частям комплекс-

комплексной величины.

Комплексная форма описания сигнала позволяет в ряде случа-

случаев упростить математические операции, проводимые с сигналами.

Иллюстрацией удобства, связанного с использованием комплекс-

комплексной формы описания сигналов при их анализе, служат последую-

последующие разделы (начиная с разд. 8).

1.2. Представление сигналов ортогональными рядами

Временная функция, описывающая сигнал s(t), может быть

представлена в виде взвешенной суммы, как правило, более про-

простых базисных функций фп@

A.18)

где сп - постоянные коэффициенты.

Такое представление сигнала означает, что сигнал рассматри-

рассматривается как совокупность элементарных колебаний, взятых с соот-

соответствующими коэффициентами. Разложение функции s(t) по сис-

системе базисных функций {фп@} особенно удобно, если система

функций является ортогональной. Система функций {фп@} называ-

17

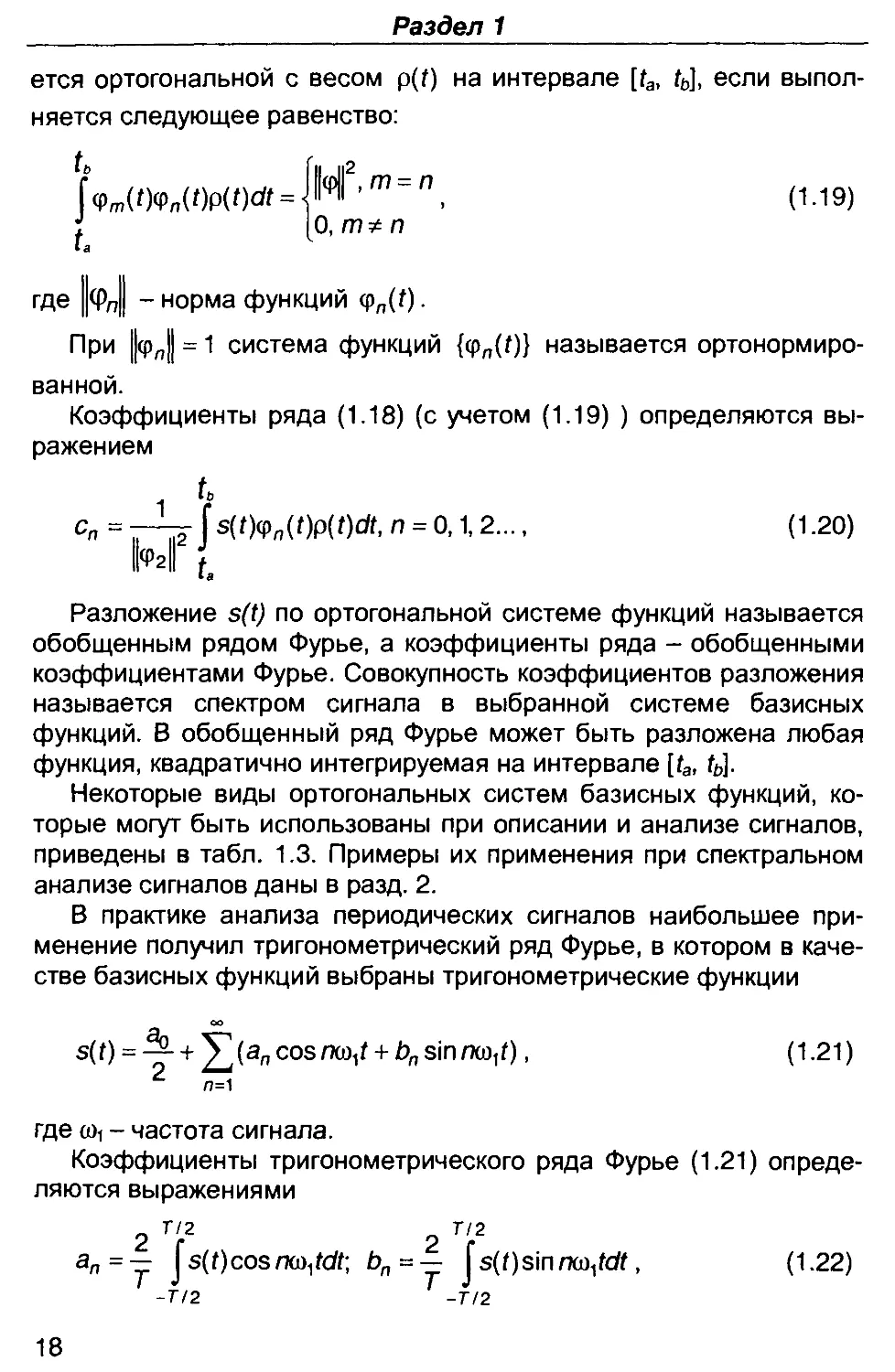

где ||фп|| - норма функций (pn(t).

При ||ф„| = 1 система функций {<pn(t)} называется ортонормиро-

ванной.

Коэффициенты ряда A.18) (с учетом A.19) ) определяются вы-

выражением

U

с" = Па \s(t)(pn(t)p(t)dt, л = ОД 2..., A.20)

Ы| I

Разложение s(t) по ортогональной системе функций называется

обобщенным рядом Фурье, а коэффициенты ряда - обобщенными

коэффициентами Фурье. Совокупность коэффициентов разложения

называется спектром сигнала в выбранной системе базисных

функций. В обобщенный ряд Фурье может быть разложена любая

функция, квадратично интегрируемая на интервале [ta, tb].

Некоторые виды ортогональных систем базисных функций, ко-

которые могут быть использованы при описании и анализе сигналов,

приведены в табл. 1.3. Примеры их применения при спектральном

анализе сигналов даны в разд. 2.

В практике анализа периодических сигналов наибольшее при-

применение получил тригонометрический ряд Фурье, в котором в каче-

качестве базисных функций выбраны тригонометрические функции

ею

s(t) = -5- + ^(ал cosrKo^t + bn sinrm^t), A.21)

где со, - частота сигнала.

Коэффициенты тригонометрического ряда Фурье A.21) опреде-

определяются выражениями

2 Гг2 2 7

ап = — j s@cosnoi^tdt; bn = — I s@sinm^tdt, A.22)

-772 -TI2

18

Раздел 1

ется ортогональной с весом p(t) на интервале [ta, tb], если выпол-

выполняется следующее равенство:

Сигналы и их представление

где Т = 2п1щ - период сигнала.

Форма записи тригонометрического ряда может быть несколько

иной

где

A.23)

A.24)

При представлении сигнала в виде A.23) он определяется сово-

совокупностью амплитуд Ап и фаз фл. Совокупность амплитуд Ап на-

называется амплитудным спектром, а совокупность фаз ф„- фазо-

фазовым спектром.

Тригонометрический ряд Фурье описывает разложение сигнала

на гармонические составляющие, позволяет проводить анализ сиг-

сигнала в частотной области. Анализ с его использованием называет-

называется гармоническим.

В качестве примера рассмотрим сигнал, представляющий пе-

периодическое колебание пилообразной формы (рис. 1.7,а). Для него

тригонометрический ряд A.23) имеет вид:

s(t) = 2/n(sin&J-'\/2sin2(xiJ + '\/3sin3(i)J-J\/4sin4(i)J+ ...),

где щ = 2п/Т - частота, Т— период сигнала.

Таблица 1.3.

Ортогональные системы функций

№

п/п

1

2

3

Ф„(х)л = 0Д2

1 cosnx sinnx n ЛП

1 , г- . i— i П - V-,-..

rLenr,n = 0,±1>...

л/2я

Многочлены Лежандра

Pn(x)= n1 d"(x2-ir

"v ' 2nrii dx" v '

[-Л.71]

[-71, Я]

[-1.1]

pW

1

1

1

1

1

2

2n + 1

19

Раздел 1

№

п/п

4

5

6

7

8

9

Фл(х)а7 = 0,1,2

Многочлены Чебышева 1 -го рода

Тп(х) = cos(narccos x)

Мне

у.(

гочлены Чебышева 2-го рода

л sin[(n + i)arccosx]

х) 1 ~

л/1-х2

Многочлены Лагерра

Ln(x) = ^^l(e-^)

л! dx" v ;

Многочлены Эрмита

Функции Радемахера

го(х) = 1, г„(х) = s/flf/7{sin2;I7cx)

п = 1,2,...

Функ

/Со

0 npi

/с=1

.ции Хаара

= 1,

2Л+1 2"+1

V^T2^-1 2/с

V ' 2-1 ^Х^2"+1

л других значениях х

,2,4 2"; л = 0, 1,2, ...

М.1]

[-1.1]

[О.оо)

[0,1]

[0,1]

р(х)

1

е^

1

1

я, л = 0

^,л^0

2

я

~2

1

2"п!л/а7

1

1

20

Сигналы и их представление

№

п/п

10

Фя(х)л = 0,1,2

Функции Уолша

т п"

pal(n,x) = Yllrk(x)}

пк - /с-й разряд представления п

в двоичном коде;

гк(х)- функции Радемахера

м,

hadfr^YlMx)]

(пкI - к-м разряд представления

п в инвертированном двоичном

коде

т • Ы

wal{n,x) = Y\lrk(x)]

(пк) = пк® лк+1,

© - символ поразрядного

суммирования по модулю 2

[0,1]

[0,1]

[0,1]

рМ

1

1

1

1

1

1

Амплитудный спектр сигнала приведен на рис. 1.7,6. Спектр да-

дает представление о распределении амплитуд сигнала по частоте.

а)

Рис. 1.7

21

Раздел 1

1.3. Интегральное представление сигналов

Одним из представлений сигналов, нашедших применение при

их описании и анализе, является интегральное представление сиг-

сигналов.

При некоторых условиях для функции, описывающей сигнал во

временной области s(t), существует интегральное преобразование

S(x)=\y(x,t)s(t)dt, A.25)

г

где \|/(x,f) - заданная функция (ядро интегрального преобразова-

преобразования); Т- область определения функции s(t).

Интегральное преобразование позволяет осуществить переход

от временной области определения функции к области параметра

х. Операциям над сигналом во временной области соответствуют

операции в области параметра х. Операции в области параметра х

могут быть проще, следовательно, расширяются возможности про-

проводимого анализа.

Формула, позволяющая восстановить сигнал s(t) по известной

функции S(x), называется формулой обращения интегрального

преобразования

s{t) = J4>{t,x)S{x)dx, A.26)

х

где (p(f, x) - базисная функция.

Выражения A.25) и A.26) устанавливают взаимно однозначное

соответствие между функцией s(t) и ее интегральным преобразова-

преобразованием S(x). Функция S(x) является интегральным представлением

сигнала, может быть исходной при описании сигнала.

Из известных интегральных преобразований одним из наиболее

часто используемых при анализе сигналов является преобразова-

преобразование Фурье

оо

S(co)= Js@e~fo'cfr, A.27)

где со - параметр преобразования, частота.

Ему соответствует обратное преобразование

22

Сигналы и их представление

s(f) = — f S(tu)e"" dhx A.28)

Интеграл Фурье A.28) дает описание сигнала в виде суммы гар-

гармонических составляющих с непрерывной последовательностью

частот ш. Спектральный анализ сигналов с использованием такого

представления входит в понятие гармонического. Функция S(w) на-

называется спектральной плотностью или спектром сигнала s(t).

С помощью A.28), имея спектральную плотность, можно перейти

к описанию сигнала во временной области.

В общем случае S(a) является комплексной величиной. Как ком-

комплексная величина она записывается в виде

SH^SMle^, A-29)

где |S(o))|, (р(со) - модуль и аргумент комплексной величины,

амплитудный и фазовый спектры сигнала.

Примером служит преобразование Фурье временной функции,

описывающей сигнал, экспоненциального вида

s(t) = Ve~at,t>0.

Преобразование Фурье s(t):

S((B)=-^7- .

а + кй

Амплитудный и фазовый спектры сигнала описываются выраже-

выражениями

V

рИ|= 2+ „ 1/2, Ф(о) = -arctg(co/a).

Графики амплитудного и фазового спектров сигнала представ-

представлены на рис. 1.8. Они дают представление о плотности распреде-

распределения амплитуд и фаз сигнала по частоте.

Другим интегральным преобразованием, широко используемым

при анализе сигналов, является преобразование Лапласа

S(p) = js(t)e-ptdt, A.30)

о

где р = а+ /со - комплексная величина.

23

Раздел 1

Рис. 1.8

Преобразование Лапласа в ряде случаев расширяет возможно-

возможности анализа сигналов по сравнению с преобразованием Фурье, ча-

чаще используется при анализе прохождения сигналов через цепи.

Переход от изображения сигнала S(p) к оригиналу s(t) осуществ-

осуществляется с помощью обратного преобразования Лапласа

A.31)

При а = 0 выражение A.30) переходит в интеграл Фурье для

функции s(t), равной нулю при t < 0.

Возможны и на практике используются другие виды интеграль-

интегральных преобразований. Некоторые из них, наиболее распространен-

распространенные, приведены в табл. 1.4.

Таблица 1.4.

Интегральные преобразования

№

п/п

1

2

S(x)

Преобразование Фурье

js(t)e^{dt

— QO

Преобразование Хартли

Г s(t) casa) tdt,

casa>t - cos о t + sin со t

s(t)

— fs(to)ew'ah)

CO

— fs(a))caso) tdoi

— oo

24

Сигналы и их представление

1.4. Векторное представление сигналов

При анализе сигналов часто обращаются к их геометрической

интерпретации. Такой подход придает описанию сигналов большую

образность, позволяет проводить исследования сигналов извест-

известными методами многомерной геометрии.

Элемент X Л/-мерного пространства представляется как точка

или вектор с координатами хь х2, ..., xN. Само пространство рас-

рассматривается как совокупность таких элементов или пространство

векторов.

Если определено расстояние между двумя точками пространст-

пространства Х(хь х2,..., xN) и Y(yh y2,..., Ул/)> то пространство называется мет-

метрическим. Наиболее часто используется метрика, определяемая

выражением

A.32)

л=1

25

Раздел 1

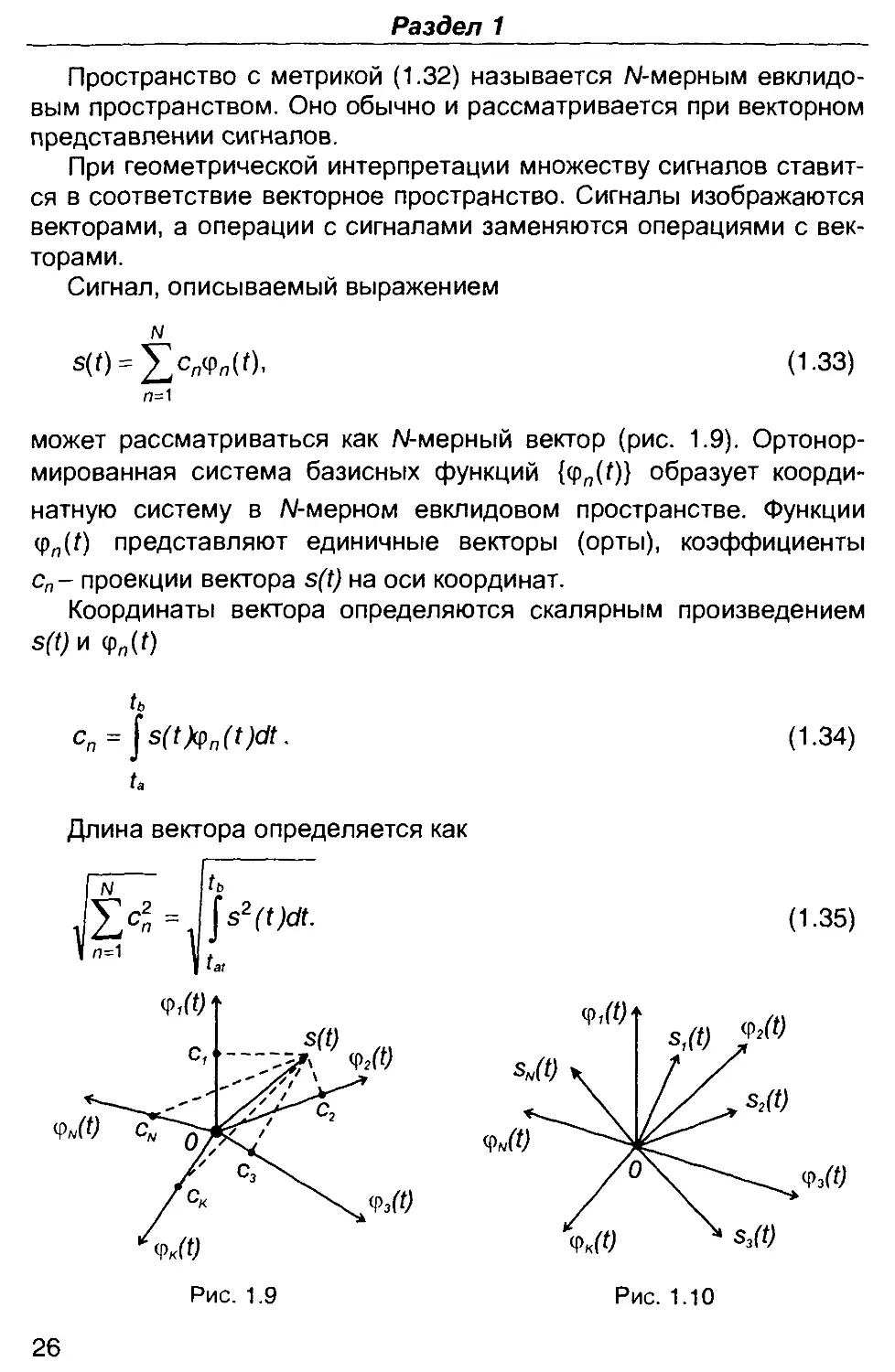

Пространство с метрикой A.32) называется Л/-мерным евклидо-

евклидовым пространством. Оно обычно и рассматривается при векторном

представлении сигналов.

При геометрической интерпретации множеству сигналов ставит-

ставится в соответствие векторное пространство. Сигналы изображаются

векторами, а операции с сигналами заменяются операциями с век-

векторами.

Сигнал, описываемый выражением

A.33)

может рассматриваться как Л/-мерный вектор (рис. 1.9). Ортонор-

мированная система базисных функций {(pn{t)} образует коорди-

координатную систему в Л/-мерном евклидовом пространстве. Функции

(pn(t) представляют единичные векторы (орты), коэффициенты

сп- проекции вектора s(t) на оси координат.

Координаты вектора определяются скалярным произведением

Длина вектора определяется как

A.34)

A.35)

Рис. 1.9

Рис. 1.10

Сигналы и их представление

Векторы можно рассматривать лишь тогда, когда они имеют ко-

конечную длину. Из A.35) следует, что геометрическую интерпрета-

интерпретацию допускают только сигналы с ограниченной энергией

tb

^s2(t)dt <oo. A.36)

ta

Совокупность сигналов с ограниченной энергией образует про-

пространство сигналов (рис. 1.10). В нем сумме сигналов

s(t)=s,(t)+s2(t) A.37)

соответствует сумма векторов. Если сигналы Si (t) и S2(t) заданы

на интервале времени [ta, tb] в единой системе координат

/V N

т = ^пЧ>п«); 52@ = 2>2ЛФл@. A.38)

Л=1 /7=1

то суммарный вектор s(t) определяется координатами с1п + с2п.

Его длина равна

N

л=1

Скалярное произведение двух векторов Si(t) и S2(t) определя-

определяется выражением

Величина, описываемая A.40), представляет взаимную энергию

сигналов.

Путем поворота системы координат относительно начала коор-

координат можно получить бесчисленное множество координатных сис-

систем. Замена координатной системы означает замену системы ба-

базисных функций, используемых при разложении сигнала, изменяет-

изменяется спектр сигнала. Свойства же векторов, отражающие свойства

сигналов, остаются неизменными, в том числе длины векторов,

расстояния и углы между векторами.

27

Представление сигнала в виде тригонометрического ряда Фурье

позволяет получить следующее выражение для энергии сигнала:

где Ап — коэффициенты ряда Фурье.

Таким образом, можем записать

jVaM=^J|sH2<*o; /s2^M=4+Z4' A-45)

'а Га

Соотношения A.45) представляют различные формы записи ра-

равенства Парсеваля, позволяют определить энергию сигнала, имея

преобразование Фурье временной функции, описывающей сигнал,

или ее представление в виде ряда Фурье.

28

Раздел 1

Все понятия Л/-мерного евклидова пространства при Л/—>°°

обобщаются на бесконечномерное гильбертово пространство.

1.5. Энергия и мощность сигналов

Важнейшими характеристиками сигналов являются энергия и

мощность. Энергия сигнала s(t) за интервал времени [ta, tb] опреде-

определяется выражением

Используя интегральное преобразование сигнала, выражение

для энергии можно записать иначе. Так, вводя преобразование Фу-

Фурье, получим

A.41)

A.42)

A.43)

A.44)

Сигналы и их представление

Энергия суммы двух сигналов за интервал времени [ta, tb] равна

tb tb tb tb

E = j[Si(t)+s2(t)]2dt = js?(t)dt + 2Js,(t)s2(t)dt + jsi(t)dt =

U ta ta tb

= E1+2E12 + E2,

где f ?, E2 - энергии сигналов s2(t) и s2(t); E12 - взаимная энергия

двух сигналов.

Если сигналы ортогональны и выполняется условие

tb

js,(t)s2(t)dt = O, A.47)

t.

то их энергии аддитивны:

Е=Е, + Е2. A.48)

Степень взаимозависимости двух сигналов в общем случае опи-

описывается корреляционной функцией

оо

R,2(x)= js,(t)s2(t + T)dt, A.49)

где т - смещение во времени одного сигнала относительно другого.

Выражение A.49) записано для непериодических сигналов с ог-

ограниченной энергией. Подчеркивая то, что рассматриваются два

сигнала, функцию Я12(т) называют взаимной корреляционной

функцией. При т = 0 взаимная корреляционная функция описывает

взаимную энергию сигналов

Я12@)= ]s,(t)s2(t)dt = E12. -A-50)

С учетом A.50) выражение A.46) можем записать в виде

Е= Е, + 2Я12@) + Е2. A.51)

Корреляционная функция может также характеризовать взаим-

взаимную зависимость двух значений одного сигнала s(t), разнесенных во

времени

29

Раздел 1

Ru(t)= js(t)s(t + T)dt. A.52)

В этом случае она называется автокорреляционной функцией.

При т = 0

Ru@)=]s2(t)dt, A.53)

автокорреляционная функция равна энергии сигнала.

Средняя мощность сигнала за интервал времени [ta, fc] опреде-

определяется выражением

Средняя мощность суммы двух сигналов за интервал времени

[ta, tb] равна

A.54)

A.55)

- взаимная мощность.

Для периодического сигнала, имеющего период, равный Т,

средняя мощность определяется выражением

Для двух периодических сигналов srft) и s2(t), имеющих один и

тот же период Т, взаимная корреляционная функция описывается

выражением

30

Сигналы и их представление

772

*12(T) = 7 \s,(t)s2(t + T)dt. A.57)

-7/2

При Si(t)=S2(t)=s(t) из A.57) получим выражение для автокорре-

автокорреляционной функции периодического сигнала

Г/2

Яц(т) = - js(t)s(t + T)dt. A.58)

-772

Прит = Оимеем

Rn@) = P. A.59)

Таким образом, автокорреляционная функция периодического

сигнала при т = 0 описывает среднюю мощность сигнала.

Рассмотренные энергетические характеристики сигналов явля-

являются основными, к ним приходится обращаться в дальнейшем при

анализе различных видов сигналов.

1.6. Основные виды сигналов

Все возможное разнообразие сигналов можно свести к несколь-

нескольким видам, которые составляют основу их классификации.

Одним из основных признаков, по которым различаются сигна-

сигналы, является предсказуемость сигнала (его значений) во времени.

Различают детерминированные и случайные сигналы. К детерми-

детерминированным (регулярным) относят сигналы, которые описываются

функциями времени, или для которых задано правило их получе-

получения. Такими сигналами, например, являются периодические после-

последовательности импульсов определенной формы, высокочастотные

колебания, модулированные по заданному закону, двоичные по-

последовательности символов, формируемые заданным способом, и

т. д. Значения детерминированного сигнала определены в каждый

момент времени. К случайным сигналам относятся сигналы, значе-

значения которых в любой момент времени невозможно предсказать с

вероятностью, равной единице. К ним относятся высокочастотные

колебания, модулированные шумом, колебание на входе приемни-

приемника, источником которого является космическое излучение, и др.

Строго говоря, все сигналы, которые встречаются на практике, яв-

являются случайными. Даже при формировании сигнала определен-

определенного вида всегда имеются случайные изменения во времени его

31

Раздел 1

параметров. Другие сигналы, такие как речевые, имеют случайный

характер вследствие самого содержания передаваемой информа-

информации. С этой точки зрения детерминированные сигналы представ-

представляют только математическую модель реальных сигналов. Однако

принятые модели часто достаточно хорошо описывают реальные

сигналы (в первую очередь, когда флуктуации имеют малые значе-

значения) и удобны при их анализе.

Передача информации с помощью сигналов может произво-

производиться непрерывно во времени или в некоторые фиксированные

моменты. В зависимости от характера передачи информации (не-

(непрерывно или дискретно) различают непрерывные или аналоговые

и дискретные сигналы. Аналоговые сигналы повторяют или зависят

от закона непрерывного изменения физических величин, информа-

информацию о которых они содержат; описываются непрерывными или ку-

кусочно-непрерывными функциями времени. Дискретные сигналы

представляют последовательность коротких импульсов, амплитуды

которых соответствуют мгновенным значениям непрерывного сиг-

сигнала или соответствующей физической величины. Значения сигна-

сигнала в выделенные моменты времени называются выборочными зна-

значениями или отсчетами. Дискретные сигналы (дискретные во вре-

времени), квантованные по уровню и представленные цифровым ко-

кодом, называются цифровыми сигналами. В связи с широким приме-

применением цифровой обработки цифровые сигналы становятся все

более распространенным видом сигналов. При анализе цифровые

сигналы чаще всего заменяются дискретными, а их отличие от

цифровых интерпретируется как шум.

В зависимости от ширины спектра выделяют узкополосные и

широкополосные сигналы. Узкополосным называют сигнал, спектр

которого сосредоточен в относительно узкой (по сравнению со

средней частотой) полосе. Понятие узкополосного сигнала являет-

является довольно условным. Однако с его введением связано удобство

описания и анализа сигналов.

Для передачи информации на расстояние и в ряде других слу-

случаев используются высокочастотные колебания. Непосредствен-

Непосредственным носителем информации, как правило, является низкочастот-

низкочастотный сигнал. Перенос информации на высокочастотное, несущее

колебание производится в процессе модуляции. В качестве несу-

несущего, кроме высокочастотного колебания, может быть использова-

использована также периодическая последовательность импульсов. Таким об-

образом, можно выделить немодулированные и модулированные сиг-

сигналы. Модулированные сигналы представляют несущее колебание

32

Сигналы и их представление

(гармоническое колебание или периодическую импульсную после-

последовательность), параметры которого изменяются под воздействием

модулирующего (управляющего) сигнала. Возможна амплитудная,

угловая и смешанная виды модуляции гармонического колебания.

Понятие угловой модуляции объединяет два вида модуляции: фа-

фазовую и частотную. При модуляции импульсной последовательно-

последовательности выделяют: амплитудную, фазовую, частотную и модуляцию

длительности импульсов (широтно-импульсную модуляцию). Воз-

Возможны смешанные виды модуляции.

В качестве модулирующего сигнала может использоваться кодо-

кодовая последовательность различных символов. Сигнал, получаю-

получающийся в результате модуляции несущего колебания такой последо-

последовательностью, называется кодированным сигналом.

Приведенная краткая классификация сигналов не рассчитана на

полноту охвата всего их разнообразия. Однако, помимо системати-

систематизации сигналов, она позволяет уяснить и принцип выбора структуры

книги.

33

Раздел 2.

ОБОБЩЕННЫЙ СПЕКТРАЛЬНЫЙ АНАЛИЗ СИГНАЛОВ

Спектральный анализ сигналов основан на представлении сиг-

сигнала в виде взвешенной суммы элементарных составляющих,

в математическом плане - разложении функции, описывающей сиг-

сигнал во временной области, в ряд по системе базисных функций.

Такое разложение позволяет свести анализ сложного сигнала

к анализу его более простых составляющих.

При разложении сигналов чаще всего используются: система

тригонометрических функций, ортогональные системы многочле-

многочленов, в первую очередь, Лежандра, Чебышева, Лагерра, Эрмита,

функций Уолша и др. При их применении для сигналов с ограни-

ограниченной энергией обеспечивается средняя квадратичная сходимость

ряда, в который раскладывается функция, описывающая сигнал.

Ортогональные системы функций полезны также при аппрокси-

аппроксимации и интерполяции сигналов и их характеристик, находят при-

применение при кодировании передаваемых сообщений, в вейвлетных

преобразованиях и в ряде других случаев. Таким образом, анализ

сигналов с использованием ортогональных систем функций имеет

широкое приложение, является неотъемлемой частью общего ана-

анализа сигналов. Описание ортогональных систем функций использу-

используется в дальнейшем - в других разделах книги, частей 1 и 2.

В этом разделе рассматриваются наиболее распространенные

ортогональные системы функций и их применение при спектраль-

спектральном анализе сигналов.

2.1. Обобщенный ряд Фурье

Функция, описывающая сигнал во временной области s(t), мо-

может быть представлена в виде взвешенной суммы базисных функ-

функций ортогональной системы {фп@}

s(O = f>ncpn(f), B.1)

34

Обобщенный спектральный анализ сигналов

где сп - постоянные коэффициенты.

Такое представление сигнала означает, что сигнал рассматри-

рассматривается как совокупность элементарных колебаний, взятых с соот-

соответствующими коэффициентами.

Для ортогональной на интервале [ta, tb] системы функций {фл@1

выполняется следующее равенство

где р (t) — весовая функция; ||<pn| - норма функций фп(г).

При ||ф„|| = 1 система функций {(pn(f)} называется ортонормиро-

ванной. Коэффициенты ряда B.1) с учетом B.2) могут быть опре-

определены как

сл=щ|5@Фп«р('К " = 0,1,2,... B.3)

Ряд, в который раскладывается функция s(t), сходится в сред-

среднем квадратичном, если выбранная система базисных функций яв-

является полной. Ортогональная система считается полной, если не

существует никакой другой функции, не входящей в систему, кото-

которая была бы ортогональна ко всем функциям данной системы.

В обобщенный ряд Фурье может быть разложена любая функ-

функция, квадратично интегрируемая на интервале [ta, tb]. Это означает,

что анализ с использованием обобщенного ряда Фурье может про-

проводиться для сигналов с ограниченной энергией на рассматривае-

рассматриваемом интервале. Разложение функции s(t) по ортогональной системе

функций B.1) называется обобщенным рядом Фурье. Совокупность

коэффициентов разложения называется спектром сигнала в вы-

выбранной системе базисных функций.

Коэффициенты Фурье обладают следующим свойством. Любая

частичная сумма ряда Фурье

N

*Л,М=1>пфп@ B'4>

/7=0

наилучшим образом аппроксимирует функцию s(t). Это означает,

35

B.2)

Раздел 2

что средняя квадратичная ошибка такой аппроксимации сигнала с

весом p(t)

B.5)

имеет наименьшее значение по сравнению с ошибками, сопровож-

сопровождающими описание сигнала в виде B.4) с коэффициентами, отлич-

отличными от B.3). Учитывая, что g2n >0, из B.5) получаем неравенство

Бесселя

Х|с/Ы|2 <ls2(t)p(t)dt, B.6)

п=0 *

la

которое при N —> °° переходит в равенство Парсеваля

Х1с/1ы2=152^^^- (z7)

Равенство B.7) означает, что ряд B.1) сходится в среднем квад-

квадратичном к функции s(t).

Некоторые ортогональные системы базисных функций, которые

могут быть использованы при описании и анализе сигналов и их

характеристик, приведены в табл. 1.3.

2.2. Спектральный анализ сигналов на основе системы

тригонометрических функций

При анализе сигналов наиболее часто используется разложение

временной функции, описывающей сигнал, в тригонометрический

ряд Фурье (разложение по ортогональной системе тригонометриче-

тригонометрических функций). Сигнал представляется в виде взвешенной суммы

гармонических составляющих. Спектральный анализ, основанный

на таком представлении сигналов, называется гармоническим. Ис-

Используемая система функций {cos nx, sin nx} является ортогональ-

ортогональной и полной на интервале [-я,я]. Эта система периодическая, со-

сохраняет свою ортогональность и полноту на любом интервале дли-

длительностью 2тг.

36

Обобщенный спектральный анализ сигналов

Периодический сигнал s(t), имеющий частоту повторения со^

можно представить в виде

s(t) - — + ^ (an cos no) т t + bn sin rm^ t), B.8)

л=1

где со, = 2к/Т; Г- период сигнала.

Ортогональность базисных функций приводит к следующим ра-

равенствам:

О, п ф m

Т/2, n = m

Предполагается, что функция s(t) является квадратично интег-

интегрируемой на интервале периодичности [-Г/2, Г/2]. Такие функции

описывают сигналы с конечной мощностью.

От B.8) можно перейти к несколько иной форме записи тригоно-

тригонометрического ряда Фурье

Периодический сигнал рассматривается как сумма гармониче-

гармонических составляющих с амплитудами Ап, и начальными фазами фп.

Совокупность амплитуд {Ап} -амплитудный спектр, а совокупность

начальных фаз {фп} -фазовый спектр сигнала. Спектры сигналов

37

Раздел 2

Рис. 2.1

в базисе тригонометрических функций называются частотными

спектрами.

Как следует из B.11), спектры периодических сигналов являются

дискретными или линейчатыми, интервал дискретизации по частоте

определяется частотой сигнала со1 (или его периодом Т,

щ=2п/Т), рис. 2.1.

В качестве примера рассмотрим прямоугольное колебание (ме-

(меандр), рис. 2.2,а. Для него из B.10) получим

Рис. 2.2

38

Обобщенный спектральный анализ сигналов

Таким образом,

_|4/ял, л = 1,3,5,...

п [0,л = 0,2,4,-

s(t) = 4/rc(sinoy +1/3sinScy+ 1/5sin5Gy + ...).

Переходя к форме записи B.11), имеем (рис. 2.2,6)

2.3. Спектральный анализ сигналов на основе

многочленов Лежандра

Система многочленов Лежандра {Pn(t)} ортогональна на интер-

интервале [-1, 1] с весом p(t) = 1. Многочлены Лежандра определяются

выражением

P"(() = rti;rS('2)"''7 = 0'1>2'- <212)

Многочлены первых порядков (рис. 2.3):

PoW=1.

P:(t)=t,

P2(t)=1/2Ct2- 1),

P3(t)= 1/2{5t3-3t), B.13)

P4M=1/8C5f4-3Of2+3),

P5Cf;=1/8F3f5-7Of3+15f).

Условие ортогональности многочленов Лежандра записывается

в виде

1 f 0, т * п

\pm(t)Pn(t)dt = \ 2 • B.14)

J , т = п

-1 [2п + 1

Функция s(t) раскладывается в ряд по многочленам Лежандра

оо

5@ = ?слРп@. B-15)

/7=0

с коэффициентами

39

Раздел 2

Рис. 2.3

B.16)

Совокупность коэффициентов B.16) представляет спектр сигна-

сигнала s(t) в базисе многочленов Лежандра.

В качестве примеров рассмотрим некоторые виды функций, опи-

описывающих сигналы во временной области.

1. Сигнал описывается степенным многочленом

где ап - постоянные коэффициенты.

Переходя к безразмерной величине х = 2t/xu, запишем

л=0

40

Разложим функцию в ряд по многочленам Лежандра

Обобщенный спектральный анализ сигналов

Приравнивая в левой и правой частях равенства коэффициенты

при слагаемых с одинаковыми степенями х, получим систему урав-

уравнений для определения коэффициентов сп.

При Л/ = 2; а0=1; а^ = 0; а2 = -1, находим Со = 2/3; с^ = 0; Сг = -2/3.

2. Косинусоидальный импульс

s(t) = cos—,Щ< — .

Переходя к безразмерной величине х = 2tlxu, запишем

41

Коэффициенты сп определяются выражением

Вычисляя интеграл получаем

сп = 21 я; Ст = 0; с2 = -0,68 ; с3 = 0; с4 = -0,03.

2.4. Спектральный анализ сигналов на основе

многочленов Чебышева

Многочлены Чебышева первого рода определяются выражением

B.18)

B.17)

Многочлены Tn(t) первых порядков (рис. 2.4):

h(t) = t,

T2{t) = 2t2-1,

T3(t) = 4t3-3t,

T^t) = Q^-Qt2 + '[,

T5(f) = 16f5-2Of3 + 5f.

Раздел 2

Рис. 2.4

Многочлены Tn(t) ортогональны на интервале [-1, 1] с весом

B.19)

Многочлены Чебышева второго рода Un(t) определяются через

многочлены первого рода

B.20)

Функция s(t) раскладывается в ряд по многочленам Tn(t)

B.21)

с коэффициентами

Совокупность коэффициентов B.22) представляет спектр сигна-

сигнала s(t) в базисе многочленов Чебышева.

42

Обобщенный спектральный анализ сигналов

Примеры разложения в ряд по многочленам Чебышева.

1. Функция s(t) = eat, \i\ < 1 •

В ряде случаев разложение функции s(t)'no многочленам Чебы-

Чебышева на интервале [-1, 1] сводится к разложению функции s(cost)

на интервале [-п,п] по косинусам. Для рассматриваемой функции

используем известное соотношение

где 1п(а) - функция Бесселя.

Замена f = cos(p дает

Аналогично, из разложений по косинусам можно получить сле-

следующие разложения по многочленам Чебышева.

43

Раздел 2

2.5. Спектральный анализ сигналов на основе

многочленов Лагерра

Многочлены Лагерра Ln(T) ортогональны на полуоси [0,°°) с ве-

весом p(t) = e'. Определяются выражением

Ln(t) = (-1) V -^-('V'), п = 0,1, 2,... B.23)

Многочлены Ln(t) первых порядков имеют вид:

Li(t)=t-1,

L2(t)=t2-4t+2, B.24)

L3(t)=t3-9t2+1Qt-6,

L4(t) = f4- 16f3+ 72f2- 96f + 24,

Ls(t) = t5- 25tA + 200t3~ 600f2+ 600Г- 120.

Условие ортогональности многочленов Лагерра:

7 , [0,гпфп

e\(W)df =

J [(n!J,m=n.

При t -> oo многочлены Ln(t) расходятся. Поэтому при разложе-

разложении сигналов обычно используют функции Лагерра

ln(t) = ±e-t!2Ln(t). B.25)

Графики Функций ln(t) первых порядков показаны на рис. 2.5.

Функции ln(t) ортогональны и нормированы

]^'Н:^п- <2-2б)

о L

Функция s(t) раскладывается в ряд по функциям Лагерра

оо

s(f) = XcnW B.27)

п=0

с коэффициентами

44

Обобщенный спектральный анализ сигналов

Рис. 2.5

B.28)

Совокупность коэффициентов B.28) представляет спектр сигна-

сигнала s(t) в базисе функций Лагерра.

Пример.

Сигнал описывается выражением s(t) = e~at-e~bt, t>0.

Из B.28) находим

2.6. Спектральный анализ сигналов на основе

многочленов Эрмита

Многочлены Эрмита Hn(t) ортогональны на всей оси (-°°,°°)

с весом е ^. определяются выражением

B.29)

Многочлены Hn(t) первых порядков:

45

Раздел 2

H0(t)=l,

H,(t) = 2t,

H2(t) = 4t2-2, B.30)

H4(t)=16t4- 48f2+12,

H5(^ = 32?5-160f3+120f.

Условие ортогональности многочленов Эрмита:

7 2 {0, т*п

\е'! HJt)Hn(t)dt = \ . B.31)

При f-»±<» многочлены Нл^ расходятся. Поэтому при разло-

разложении сигналов удобнее использовать функции Эрмита

hn(t) = е-'г/2"л@ф2лЛ • B-32)

Графики функций hn(t) первых порядков показаны на рис. 2.6.

Функции hn(t) ортогональны и нормированы

—оо ^

Разложение s(t) по функциям Эрмита

оо

s(f) = ]TcA@ B.33)

л=0

имеет коэффициенты

сп= js(t)hn(t)dt. B.34)

Совокупность коэффициентов B.34) представляет спектр сигна-

сигнала s(t) в базисе функций Эрмита

Пример.

Сигнал - гауссов импульс s(t) = е~а{2 •

46

Обобщенный спектральный анализ сигналов

Рис. 2.6

Коэффициенты разложения определяются выражением

2.7. Спектральный анализ сигналов на основе функций

Уолша

Спектральный анализ сигналов на основе функций Уолша нахо-

находит практическое применение прежде всего при исследовании сиг-

сигналов, формируемых в цифровых устройствах.

2.7.1. Системы функций Уолша

Функции Уолша являются кусочно-постоянными знакоперемен-

знакопеременными функциями, принимающими значения 1 или -1. Они опреде-

определяются с помощью функций Радемахера rn(t) (рис. 2.13)

B.35)

где л =1, 2,... - порядок функции; х= t/T, T- интервал времени.

Функции Радемахера имеют вид меандра, ортонормированы.

Все они являются нечетными относительно середины интервала

47

Вычисление интегралов дает

Раздел 2

определения и не образуют полной системы, следовательно, не

могут быть использованы при разложении функций в ряд Фурье.

Ортогональная система кусочно-постоянных функций становится

полной при переходе к функциям Уолша. Функции Уолша опреде-

определяются произведением функций Радемахера. Принцип формирова-

формирования этого произведения задает систему функций Уолша. Наиболь-

Наибольшее применение нашли системы функций Уолша, известные как

системы Пэли, Адамара и Хармута (Уолша).

Система Пэли. Функция Уолша с номером л в системе Пэли за-

задается произведением функций Радемахера с номерами к, равны-

равными разрядам двоичного представления л. При двоичном представ-

представлении число П записывается в виде

B.36)

где т - число разрядов.

Функции Уолша в системе Пэли определяются как

B.37)

где п - порядок функции Уолша.

Двоичное представление л для значений от 0 до 15 приведено

в табл. 2.1.

Таблица 2.1.

Двоичное представление порядка функций Уолша

в системах Хармута (Уолша), Пэли и Адамара

№

п/п

0

1

2

3

4

5

Система Хармута

(Уолша)

0000

0001

0011

0010

0110

0111

Система Пэли

0000

0001

0010

0011

0100

0101

Система Адамара

0000

1000

0100

1100

0010

1010

48

Обобщенный спектральный анализ сигналов

№

п/п

6

7

8

9

10

11

12

13

14

15

Система Хармута

(Уолша)

0101

0100

1100

1101

1111

1110

1010

1011

1001

1000

Система Пэли

0110

0111

1000

1001

1010

1011

1100

1101

1110

1111

Система Адамара

0110

1110

0001

1001

0101

1101

0011

1011

0111

1111

Система Адамара. Получается из системы Пэли записью раз-

разрядов двоичного представления номера функции Уолша п в обрат-

обратном порядке

B.38)

Комбинации nm.k+h соответствующие первым номерам функции

Уолша, приведены в табл. 2.1.

Система Хармута. Эту систему можно получить из системы Пэ-

Пэли, представляя номер соответствующей функции Уолша в коде

Грея. Код Грея получается последовательным суммированием по

модулю два соседних разрядов двоичного разложения п, начиная с

младшего.

Обозначив /с-ый разряд кода Грея <nk>, запишем

<nk>=nk®nk+,, B.39)

где знак ф означает операцию поразрядного суммирования по мо-

модулю два

@ 00 = 0,0 ©1 = 1,100 = 1,101 = 0).

Выражение для функции Уолша в системе Хармута имеет вид

wal(n,x) = fl[rk(x)]<nk>- B-40)

/с=1

49

Раздел 2

Рис. 2.7

Комбинации <л*>, соответствующие нумерации Функций Уолша,

приведены в табл. 2.1. Определение функций Уолша первых по-

порядков п < 15 в системе Хармута через функции Радемахера в со-

соответствии с B.40) дано в табл. 2.2.

Таблица 2.2.

№

п/п

0

1

2

3

4

5

6

7

8

9

Функции Уолша

(л4 лЗ п2 п1)

0000

0001

0011

0010

0110

0111

0101

0100

1100

1101

в системе Хармута (Уолша)

wal(n,rt) = П ШхЛпк

wal @,x) = 1

wal A,х) = п(х)

wal B,x) = г2(х)

wal C,х) = г2(х)

wal D,х) = г2(х) г3(х)

wal E,х) = п(х) г2(х) г3(х)

wal F,х) = п(х) г3(х)

wal G,x) = г3(х)

wal (8,х) = гз(х) г4(х)

wal (9,х) = п(х) г3(х) ц(х)

50

Обобщенный спектральный анализ сигналов

№

п/п

10

11

12

13

14

15

(л4 лЗ л2 л1)

1111

1110

1010

1011

1001

1000

wa\{n,k) = П WxJ\nk

wal A0,x) = п(х) г2(х) г3(х) г4(х)

wal A1,х) = г2(х) г3(х) г4(х)

wal A2,x) = г2(х) г4(х)

wal A3,х) = п(х) Г2(х) г4(х)

wal A4,х) = п(х) и{х)

wal A5,x) = г4(х)

Графики функций Уолша, упорядоченных по Хармуту, изображе-

изображены на рис. 2.8. Соответствующие нумерации функций Уолша в сис-

системах Пэли и Адамара приведены в двух правых столбцах на

рис. 2.8. Из графиков функций Уолша, приведенных на рисунке,

видно, что порядковый номер функции в системе Хармута равен

числу пересечений ее графика с осью абсцисс на интервале [0, 1].

Поэтому нумерация функций Уолша по Хармуту называется также

упорядочением по частоте.

В системе Хармута четные относительно середины интервала

функции чередуются с нечетными. Эти функции имеют соответст-

соответственно четные и нечетные номера. В этом функции Уолша в системе

Хармута подобны тригонометрическим функциям и их по аналогии

иногда обозначают:

четные cal(n,x) = wal(n,x), n = 2k,

нечетные sal(n,x) - wal(n,x), n = 2k+1.

Рассмотренные системы содержат одни и те же функции Уолша,

только расположенные в различной последовательности.

2.7.2. Свойства функций Уолша

Из свойств функций Уолша, определенных на интервале [0, 1],

отметим следующие.

1. Функции Уолша являются периодическими с периодом, рав-

равным единице

\ыа\{п,х±к) = wai(n,x), k= 1,2,... B.41)

2. Модуль функции Уолша равен единице, среднее значение для

л* 0 равно нулю

| wal(n, х)\ = 1; j wal(n, x)dx - 0.

B.42)

51

Раздел 2

Рис. 2.8

52

Обобщенный спектральный анализ сигналов

3. Функции Уолша ортонормированны на интервале [0, 1]

f wal(n, x)wal(k, x)dx = \ ' П ~ . B.43)

J [0,n*k

4. Произведение двух функций Уолша является также функцией

Уолша

wal(n,x)wal(/c,x) = wal(m,x). B.44)

Для систем Пэли и Адамара

m = n®k, B.45)

для системы Хармута

т=<<л>©</с>>, B.46)

где символ < > означает преобразование кода Грея в двоич-

двоичный код.

5. Параметры лих симметричны: любые выводы относительно

п справедливы для х и наоборот.

Такой вывод следует непосредственно из выражений B.37),

B.38) и B.40).

2.7.3. Спектры сигналов в базисе Уолша

Сигнал, описываемый интегрируемой функцией s(t) и опреде-

определенный на интервале [0, Т], можно разложить в обобщенный ряд

Фурье по функциям Уолша

оо

s{t) = ^cnwal{n,t/T),O<t/T<J\, B.47)

л=0

где

Совокупность коэффициентов сп представляет спектр сигнала в

базисе Уолша или спектр Уолша. При вычислении спектров Уолша

выражение для сп целесообразно представить несколько в иной

форме. Разобьем интервал значений t/T на N участков, в пределах

которых функция wal(n,t/T) постоянна. С учетом этого выражение

для сп запишем в виде

53

Раздел 2

ЛМ«с+1

сп=-^ \s(t)wal(n,t/T)dt. B.48)

Из B.48) получим

Л/-1 tfr+1

cn=-Ywal(n,k/N) fs(t)dt. B.49)

/(=0 ft

С учетом того, что функции Уолша равны ±1, выражение B.49)

запишем в виде

Л/-1 *+1

*=0 Г/с

где апG^ = 0 или 1, определяет знак функции Уолша на интервале

Примеры спектров Уолша.

1. Спектр Уолша прямоугольного импульса s(t) = 1, 0 < t < т

(рис. 2.9)

Из B.50) находим

' k=0

Спектр Уолша прямоугольного импульса зависит от соотноше-

соотношения между т и Т. При т/ Т = 2V, где v - целое положительное число,

с учетом значений функций Уолша получим

cn=M2\n = 0X-..,2v -^.

Разложение прямоугольного импульса по функциям Уолша име-

имеет вид

Спектр состоит из 2V составляющих с одинаковыми амплитуда-

амплитудами, равными 1/2V. Спектр содержит конечное число составляющих.

При х1Тф2х' структура спектра изменится.

54

Обобщенный спектральный анализ сигналов

Рис.2.9

2. Спектр Уолша треугольного импульса (рис. 2.10)

При описании треугольного импульса

(t/T,0<t<T/2

' \\-t/T,T/2<t<T

удобно перейти к безразмерному времени x = t/T

, х fx,0<x<1/2

S(X) = 4

[1-х,1/2<Г<1

В соответствии с B.50) находим:

55

Раздел 2

Спектры Уолша при нумерации Хармута и Пэли изображены на

рис.2.10, бив.

3. Спектр Уолша синусоидального импульса (рис. 2.11)

Для синусоидального импульса

s@ = sin—f,O<f<7",

переходя к безразмерному времени x = t/T, запишем

s(x") = sin7ix, 0< х<1.

Из B.50) в системе Хармута находим (рис. 2.11):

Г 2

с0 = sinnxdx = —;

Jo

56

Обобщенный спектральный анализ сигналов

Рис. 2.11

Спектры Уолша рассматриваемого сигнала при нумерации Хар-

мута и Пэли приведены на рис.2.11 ,б и в.

2.7.4. Свойства спектров Уолша

При анализе сигналов с использованием функций Уолша полез-

полезно учитывать свойства разложения сигналов в базисе Уолша -

спектров Уолша.

1. Спектр суммы сигналов равен сумме спектров каждого из сиг-

сигналов.

Спектр сигнала в системе функций Уолша определяется коэф-

коэффициентами разложения B.47). Для суммы сигналов коэффициен-

коэффициенты разложения определяются выражением

57

к=0

где апк- коэффициенты разложения сигнала sk(t).

2. Умножение сигнала на функцию Уолша с номером П изменяет

номера коэффициентов разложения ск по закону двоичного сдвига

по модулю два

s{t)wal(nJ/T) = ^ckwal{k®nJ/T) = Yjck(Bnwal{k,t/T). B.53)

к=0 к=0

3. Спектр Уолша произведения сигналов srft) и s2(t). определен-

определенных на интервале [0, 7) и имеющих спектры c\,cl, равен

4. Свертку сигналов s7^ и s2(^

т

s@ = Js,(f-T)S2(x)cfc B.55)

о

можно представить в виде

s(t) = Tj^clc2k, B.56)

к=0

где с^.с^ - спектры Уолша сигналов s^t) и s2(t).

Рассмотренные разложения по ортогональным системам при-

применимы к любым функциям, удовлетворяющим некоторым услови-

условиям, сформулированным ранее. Они могут использоваться как при

анализе сигналов, так и их характеристик. Ряды с ограниченным

числом членов могут рассматриваться как аппроксимирующие. Ко-

Коэффициенты разложения, определенные как коэффициенты Фурье,

обеспечивают оптимальность такой аппроксимации.

58

Раздел 2

Раздел 3.

ГАРМОНИЧЕСКИЙ АНАЛИЗ СИГНАЛОВ

В основе гармонического анализа детерминированных сигналов

лежит представление временной функции, описывающей сигнал, в

виде тригонометрического ряда Фурье или ее интегральное преоб-

преобразование Фурье - сигнал рассматривается как бесконечная или

конечная совокупность гармонических составляющих. В радиотех-

радиотехнике из всех видов спектрального анализа сигналов гармонический

анализ получил почти исключительное применение. Поэтому поня-

понятия спектральный и гармонический анализ часто имеют одно со-

содержание. Широкое применение гармонического анализа при опи-

описании сигналов объясняется рядом причин, главные из которых

связаны с распространением гармонических колебаний в природе и

простотой аппаратурной реализации методов их анализа.

3.1. Гармонический анализ периодических сигналов

Гармонический анализ периодических сигналов основан на раз-

разложении временной функции s(t), описывающей сигнал с периодом

Г и частотой u>i=2n/T, по ортогональной системе тригонометри-

тригонометрических функций {cos/tco^, sinnwiO- Для периодической функции s(t)

тригонометрический ряд Фурье имеет вид

оо

s@ = — + y?(ancosna}<lt+ bnSinno)^). C.1)

Коэффициенты ряда определяются выражениями

772 п Т/2

ап=— \ s(f)cos лш Jdt; bn = — I s(t)s'\nгко ^tdt. C.2)

-Т/2 -Т/2

Функция s(t) должна быть квадратично интегрируемой на ин-

интервале периодичности {-Т/2, Т/2]. Такие функции описывают пе-

периодические сигналы с ограниченной мощностью.

59

Раздел 3

Для четной функции s(t), как это следует из C.2),

Периодический сигнал представляется в виде суммы гармони-

гармонических составляющих с амплитудами Ап и начальными фазами фл.

Совокупность амплитуд {Ап} определяет амплитудный спектр,

а совокупность начальных фаз {фл} - фазовый спектр сигнала

(рис.3.1,а). Как следует из C.5), спектры периодических сигналов

являются дискретными или линейчатыми, интервал дискретизации

по частоте равен частоте сигнала а^ = 2л/ Г.

Тригонометрический ряд Фурье можно записать в комплексной

форме

где

7/2

-772

Переход от C.1) к C.7)

е'0) = cos oof + /sino)f.

60

C.7)

C.8)

очевиден с учетом формулы Эйлера

C.9)

для нечетной функции s(t):

Обычно при анализе сигналов используется разложение s(t)

в виде

Гармонический анализ сигналов

Рис.3.1

Коэффициенты сп в общем случае являются комплексными ве-

величинами

сп=\с„\еР" =ne[cn]+i\m[cn].

(З.Ю)

При использовании комплексной формы ряда Фурье сигнал оп-

определяется совокупностью комплексных амплитуд {сп}. Модули

комплексных амплитуд |с„| описывают амплитудный спектр, аргу-

аргументы фл - фазовый спектр сигнала (рис. 3.1,6).

Представив C.8) в виде

772 Т/2

cn=— \s(t)cosrm>itdt-i— {s(t)s\nn(i)^dt, C.11)

-Г/2

-Г/2

получим

Как следует из записанных выражений, амплитудный спектр об-

обладает четной, а фазовый - нечетной симметрией

61

Раздел 3

С„\ = \С-п\, ФЛ=Ф_Л- C-13)

Из сопоставления выражений C.2) и C.11) следует

an=2Re[cJ; Ь„ = -2lm[cJ; An=2\cn\. C.14)

В качестве примера рассмотрим периодическую последователь-

последовательность прямоугольных импульсов (рис. 3.2,а). При разложении пе-

периодической последовательности прямоугольных импульсов в три-

тригонометрический ряд Фурье из C.2) получим амплитудный и фазо-

фазовый спектры в виде (рис.3.2,б):

При использовании комплексной формы ряда Фурье

Амплитудный и фазовый спектры сигнала равны

Предельным видом ряда Фурье является интеграл Фурье. Пе-

Периодический сигнал при Г -»оо становится непериодическим. Под-

Подставив C.8) в C.7), запишем

C.16)

из C.8) следует:

62

Гармонический анализ сигналов

Рис. 3.2

Преобразуя C.16), при Т —> оо (в этом случае со у-> с/со и псо у= со),

получаем

C.17)

В квадратных скобках записан интеграл Фурье, он описывает

спектральную плотность сигнала

63

Раздел 3

Выражение C.17) примет вид

2тг

Записанные соотношения представляют прямое и обратное

преобразования Фурье. Они используются при гармоническом ана-

анализе непериодических сигналов.

3.2. Гармонический анализ непериодических сигналов

Прямое и обратное преобразования Фурье устанавливают вза-

взаимно однозначное соответствие между сигналом (временной функ-

функцией, описывающей сигнал s(t) ) и его спектральной плотностью

S(co):

S((o)= \s{t)e-btdt, s{t) = — fsMe^dh). C.18)

J 2я J

Соответствие по Фурье обозначим:

s(f)<-»S(o>). C.19)

Условием существования преобразования Фурье является аб-

абсолютная интегрируемость функции s(t)

оо

j\s(t)\dt <оо. C.20)

—оо

В практических приложениях более удобным является условие

интегрируемости квадрата этой функции

оо

\s2(t)dt<oo. C.21)

— оо

Для реальных сигналов условие C.21) эквивалентно условию

C.20), но имеет более очевидный физический смысл: условие

C.21) означает ограниченную энергию сигнала. Таким образом,

можем считать возможным применение преобразования Фурье к

сигналам с ограниченной энергией. Это непериодические (импульс-

(импульсные) сигналы. Для периодических сигналов разложение на гармо-

64

Гармонический анализ сигналов

нические составляющие производится с помощью ряда Фурье.

Функция S((o) в общем случае является комплексной

S(co) = Re[s(co)] + / lm[s(co)]; S(to) = ^((ф^, C.22)

где Re, Im - действительная и мнимая части комплексной величины;

|S(co)|, ф(о))- модуль и аргумент комплексной величины:

|sH = VRe2[S(m)]+lm2[s(<4 Ф(ш) = агс1д*|.

Модуль спектральной плотности сигнала |S(a)]j описывает рас-

распределение амплитуд гармонических составляющих по частоте, на-

называется амплитудным спектром. Аргумент ф(со) дает распределе-

распределение фазы по частоте, называется фазовым спектром сигнала. Ам-

Амплитудный спектр является четной функцией, а фазовый спектр -

нечетной функцией частоты

|S((o)| = |S(-co)|; ф(ш) = -ф(-ш). C.23)

С учетом формулы Эйлера C.9) выражение для S(to) запишем в

виде

S(co) = f s(f)cos со tdt - / f s(f)sin со tdt. C.24)

Если s(t)четная функция, то из C.24) получим

оо

S(w) = 2 f s(t)cos со tdt. C.25)

о

Функция S(w), как следует из C.25), является действительной

функцией. Фазовый спектр определяется как

ГО, S(w)>0,

[±я, S(o))<O.

Для нечетной функции s(t) из C.24) получим

S(co) = -/2[s(f)sinсо tdt. C.27)

о

65

Раздел 3

Функция S(o)) является чисто мнимой, фазовый спектр

[я/2 1тВД>0

44 y j-rc/2, lm[S(a))]<0

Любой сигнал можно представить как сумму четной ^(t) и нечет-

нечетной sH(t) составляющих

s(t) = s4(t)+sH(t). C.29)

Возможность такого представления становится ясной с учетом

следующих равенств:

«,(»)=*,(- 0={Ш* 4- 01 МО=-sH(-0={WO- s(- 01.

Из C.24) и C.29) получим

S(o) = 2f s^(f)coso) faff - /2fsH(f)sina) fcff. C.30)

о о

Следовательно, для действительной и мнимой частей спек-

спектральной плотности сигнала можно записать:

Re[s(o))]= z\s4(t)cos(D tdt; lm[s(co)]= -2f sH(f)sinco tdt.

о о

Таким образом, действительная часть спектральной плотности

представляет преобразование Фурье от четной составляющей,

мнимая часть - от нечетной составляющей сигнала. Действитель-

Действительная часть комплексной спектральной плотности сигнала является

четной, а мнимая часть - нечетной функцией частоты.

Спектральная плотность сигнала при ш = О

S@)= \s(t)dt C.31)

равна площади под кривой s(t).

В качестве примеров получим спектры некоторых сигналов.

1. Прямоугольный импульс (рис. З.З.а)

66

Гармонический анализ сигналов

где хи - длительность импульса.

Спектральная плотность сигнала

67

Раздел 3

Графики амплитудного и фазового спектров сигнала приведены

на рис. 3.3,б,в.

2. Сигнал, описываемый функцией

5("=(Й)Те'а' '>°-°=*

Спектральная плотность сигнала определяется выражением

Интегрируя по частям л-1 раз, получаем

имеет спектральную плотность

S(o) = -^-.

а + /со

Графики амплитудного и фазового спектров изображены на рис.

3.4Дв.

Сигнал (рис. 3.5,а)

s(t)=te~at, t>0,

имеет спектральную плотность

\а + ко)

Графики амплитудного и фазового спектров - рис. 3.5,6,в.

Число примеров увеличивает табл. 3.1.

Сравнение C.18) и C.8) показывает, что спектральная плотность

одиночного импульса при т«Г отличается от коэффициентов ряда

Фурье периодической последовательности импульсов только мно-

множителем 1/Г.

68

Гармонический анализ сигналов

С учетом указанного соотношения определение спектра периоди-

периодического сигнала в ряде случаев можно упростить, используя преобра-

преобразование Фурье C.18). Коэффициенты ряда Фурье находятся как

C.32)

где S(co) - спектральная плотность одного импульса.

Таким образом, при определении амплитудного и фазового

спектров периодических сигналов полезно иметь в виду следующие

равенства:

C.33)

69

Раздел 3

в)

Рис. 3.5