Author: Солодовников А.С.

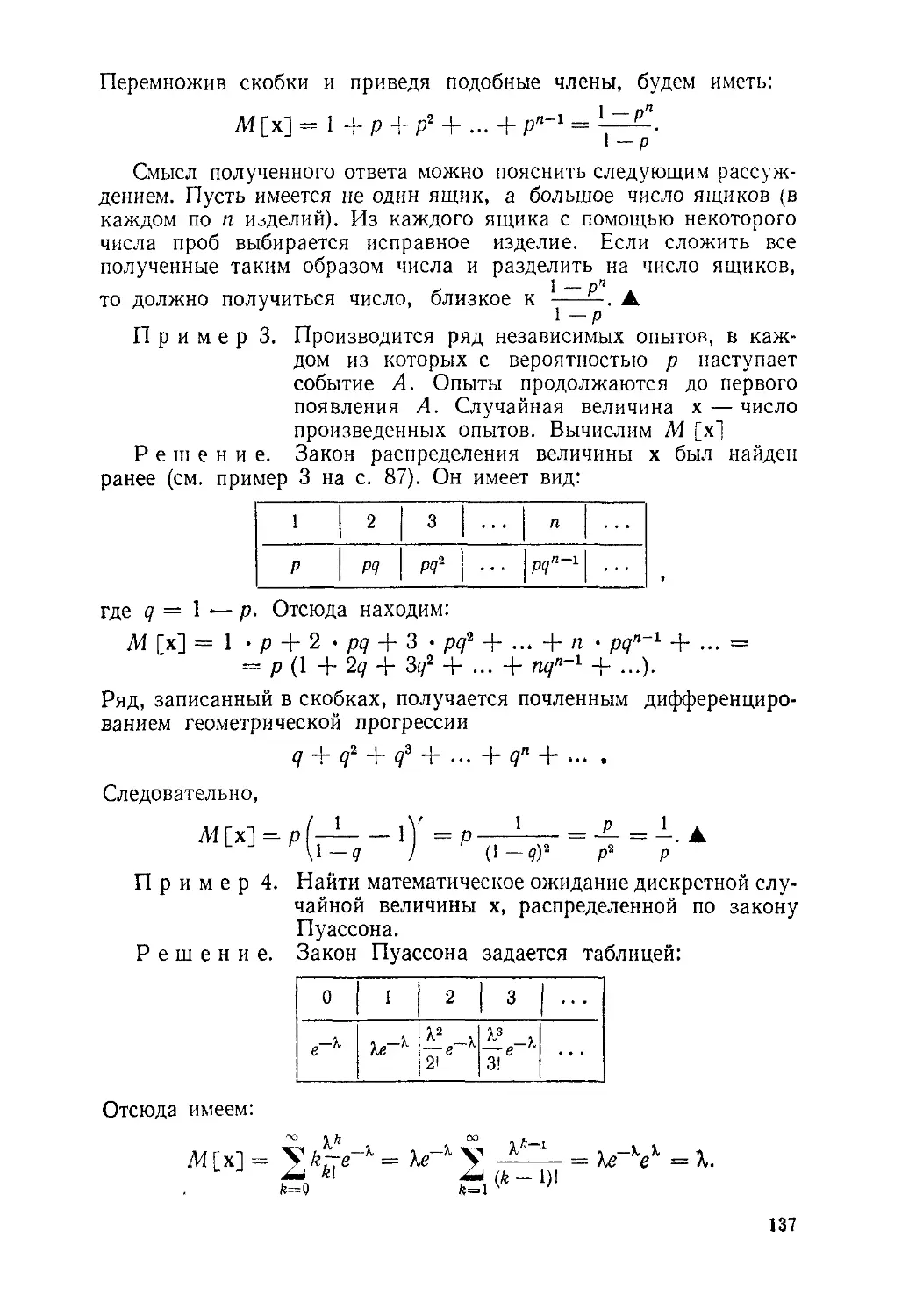

Tags: теория вероятностей математическая статистика комбинаторный анализ теория графов физика

Year: 1983

Text

ТЁЙ1 ВЕРОЯТНОЕ. ЕЙ

А.С.СОЛОДОВНИКОВ

А.С. солодовников

ТЕОРИЯ ВЕРОЯТНОСТЕЙ

Допущено

Министерством просвещения СССР в качестве учебного пособия для студентов педагогических институтов но математическим специальностям

Москва «Просвещение» 1983

ББК 22.171 С60

Рецензенты:

Кафедра геометрии МОПИ им. Н. К. Крупской (зав кафедрой, доктор физ.-мат. наук профессор Мантуров О. В.).

Доктор физ.-мат. наук, профессор Левин В. И. (МГПИ им. Ленина).

Солодовников А. С.

С 60 Теория вероятностей: Учеб, пособие для студентов пед. ин-тов по матем. спец.—М.: Просвещение, 1983.—207 с.

Учебное пособие по npoipaMMe физико-математических факультетов педагогических институтов содержит основные вопросы курса «Теория вероятностей», начиная с интуитивного подхода к понятиям случайного события и вероятности и кончая элементами математической статистики. Значительное место уделяется таким важнейшим фактам, как закон больших чисел и центральная предельная теорема, законы распределения случайных величин и их систем, числовые характеристики случайных величин. В книге на конкретных примерах показывается, как вероятностные еаконы применяются в практической деятельности.

с 4309010400 — 489

103 (03) — 83

223 — 83

ББК 22. 171

517. 8

© Издательство «Просвещение», 1983 г.

ОГЛАВЛЕНИЕ

Предисловие ................................................................................. 5

Глава 1. События и их вероятности ........................................................... 7

§ I. Интуитивный подход к понятиям случайного события и вероятности ..................................................... —

§ 2. Комбинации событий. Правило сложения вероятностей ... 12

§ 3. Аксиомы теории вероятностей .................................................... 17

§ 4. Классический способ подсчета вероятностей ........................................ 24

§ 5. Геометрические вероятности ..................................................... 30

Глава 2. Комбинаторика ................................................................. 32

§ 6. Правила суммы и произведения ........................... —

§ 7. Размещения и перестановки ...................... 35

§ 8. Сочетания. Бином Ньютона ...................... 37

§ 9. Размещения данного состава. Полиномиальная формула . . 40

§ 10. Применение комбинаторики к подсчету вероятностей .... 43

'лава 3. Независимость событий. Простейшие формулы ...... 47

§ 11. Условная вероятность .............................................................. —

§ 12. Независимые события и правило умножения вероятностей . . 50

§ 13. Формула полной вероятности ....................................................... 55

§ 14. Формула Байеса ................................................................... 57

лава 4. Схема Бернулли ..................................................................... 60

§ 15. Схема Бернулли. Биномиальные вероятности .......................................... —

§ 16. Наиболее вероятное число успехов. Среднее число успехов . . 64

§ 17. Вероятности Pn(k) при больших значениях п. Приближенные формулы Лапласа ................................................ 67

§ 18. Предельная теорема и приближенные формулы Пуассона ... 72

§ 19. Цепи Маркова ..................................................................... 75

лава 5. Случайные величины и законы их распределения........................................ 84

§ 20. Описательный подход к понятию случайной величины .... —

§ 21. Дискретные случайные величины .................................................... 86

§ 22. Случайные величины общего вида. Функция распределения . . 89

§ 23. Дискретные и непрерывные случайные величины. Плотность вероятности .................................................... 96

§ 24. Закон равномерного распределения на отрезке и закон нормального распределения на прямой .............................. 101

§ 25. Механическая модель случайной величины ................ 105

Глава 6. Системы случайных величин ..................... 107

§ 26. Формальное определение системы двух случайных величин. Система дискретного типа ........................................ —

§ 27. Функция распределения системы (х, у). Плотность вероятности ....................................................... 114

§ 28. Независимые случайные величины .................................................. 117

§ 29. Примеры двумерных распределений ................................................. 119

§ 30. Функции случайной величины ...................................................... 124

3

§ 31. Система любого числа случайных величин. Функции от нескольких случайных величин...................................... 129

Глава 7. Числовые характеристики случайных величин ......... 134

§ 32. Математическое ожидание случайной величины ........... —

§ 33. Свойства математическою ожидания..................... 144

§ 34. Дисперсия случайной величины......................... 149

§ 35. Дисперсия суммы случайных величин. Корреляционный момент 154

Глава 8. Закон больших чисел и центральная предельная теорема . . 156

§ 36. Неравенство Чебышева ..................................... 157

§ 37. Различные 4ормы закона больших чисел...................... 159

§ 38. Центральная предельная теорема теории вероятностей .... 163

§ 39. Применение центральной предельной теоремы ................ 166

§ 40. Примеры задач на нормальный закон распределения .... 169

Глава 9. Элементы математической статистики ........................ 173

§ 41. Вариационный ряд. Таблица частот. Гистограмма............. 174

§ 42. Оценки параметров распределения .......................... 177

§ 43. Доверительные оценки ..................................... 182

§ 44. Оценка неизвестной вероятности по частоте ................ 187

§ 45. Корреляция ............................................. 189

§ 46. Метод наименьших квадратов ............................... 193

Приложение 1. Условия, при которых наперед заданная функция F(x) является функцией распределения ......................... 196

Приложение 2. Теоремы сложения и умножения математических ожиданий ................................................. 199

Таблицы значений для функций ср (х) ='/==е и

1 п-----1£

1 Г 2 •'

ФМ = Ж)е di.................'...................... 202

0 Xй

Таблица значений функции —е~^ .............. 204

«1

Предметный указатель.................................. 205

ПРЕДИСЛОВИЕ

Настоящая книга является учебным пособием для студентов физико-математических факультетов педагогических институтов по курсу «Теория вероятностей». В соответствии с учебным планом этот курс изучается в 6-м семестре.

Предмет теории вероятностей отличается большим своеобразием. Необычный характер теоретико-вероятностных, понятий явился причиной того, что долгое время подход к этим понятиям основывался только на интуитивных соображениях. Настоящее и по-современному строгое обоснование теории вероятностей появилось сравнительно недавно — в 30-х годах нашего века — в трудах советского математика академика А. Н. Колмогорова. С этого времени теория вероятностей превратилась в стройную дисциплину, в такой же мере безупречную, как, скажем, математический анализ или теория чисел.

Учебная литература по теории вероятностей довольно резко разделяется на книги двух категорий: те, что доступны читателю с солидной математической подготовкой, и книги, которые излагают предмет на интуитивном уровне, с использованием понятий, лежащих вне поля зрения математики. В настоящем пособии автор стремился избежать каждой из этих крайностей. Изложение ведется в нем достаточно строго; вместе с тем каждому новому понятию предшествует неформальное объяснение, вскрывающее существо вводимого понятия, его происхождение и реальный смысл.

Отметим некоторые особенности изложения в данной книге.

В § 3 главы 1 вводится понятие «вероятностная схема». Это синоним понятия «вероятностное пространство», принятого в большинстве пособий.

Главы 5—8 посвящены теории случайных величин. При этом само понятие случайной величины, а также ряд сопутствующих ему вводятся таким образом, чтобы избежать обращения к абстрактной теории меры и интеграла Лебега.

5

Доказательства нескольких важных теорем о случайных величинах вынесены за рамки основного текста книги и даны в виде приложений. Это касается теоремы о задании случайной величины некоторой функцией F(x), теорем сложения и умножения математических ожиданий (последние две теоремы в основном тексте доказаны только для дискретного случая).

По поводу обозначений, принятых в книге, заметим только следующее: случайные величины обозначаются жирными буквами латинского шрифта (х, у и т. д.), окончание доказательства каждой теоремы или леммы отмечается знаком И, а завершение решения примера или задачи — знаком А.

В целом книга соответствует действующей программе, но последовательность изложения несколько изменена по сравнению с программой. Главное изменение заключается в том, что все сведения, касающиеся математической обработки результатов наблюдений, отнесены в отдельную главу 9, посвященную элементам математической статистики.

Для более углубленного знакомства с предметом мы рекомендуем следующие книги: Гнеденко Б. В. Курс теории вероятностей. М., Наука, 1969, иБоровковА. А. Курс теории вероятностей. М., Наука, 1976.

Глава 1.

СОБЫТИЯ И ИХ ВЕРОЯТНОСТИ

Эта глава посвящена введению двух важнейших понятий теории вероятностей: понятия случайного события и понятия вероятности. Сначала мы рассмотрим (§ 1) чисто интуитивный, неформальный подход к этим понятиям. Он базируется на совершенно естественных, но вместе с тем не вполне строгих рассуждениях. Формализация основных понятий дается позже, в § 3, где рассматриваются аксиомы теории вероятностей.

§ 1. ИНТУИТИВНЫЙ ПОДХОД К ПОНЯТИЯМ СЛУЧАЙНОГО СОБЫТИЯ И ВЕРОЯТНОСТИ

1°. Случайные события и предмет теории вероятностей. На практике часто встречаются такие ситуации, когда исход проводимого нами опыта (эксперимента, испытания) нельзя предсказать заранее с полной уверенностью. Например, невозможно предсказать, какая сторона выпадет при бросании монеты, — на исход этого опыта влияет огромное число факторов, таких, как начальное положение монеты в момент броска, начальная скорость, сопротивление воздуха, особенности поверхности, на которую падает монета, и т. д. Аналогичным образом невозможно предсказать, останется ли исправной купленная нами в магазине электрическая лампа после тысячи часов работы, выпадет ли выигрыш на лотерейный билет с таким-то номером и т. д. Во всех подобных ситуациях мы вынуждены считать результат опыта зависящим от случая, рассматривать его как случайное событие.

Примем на первых порах такое определение.

Некоторое событие называется случайным по отношению к данному опыту, если при осуществлении этого опыта оно может наступить, а может и не наступить.

Примером случайного события может служить выпадение герба в опыте с бросанием монеты, выигрыш по данному лотерейному билету, совпадение дней рождения у двух наугад выбранных людей.

Случайные события обозначаются в дальнейшем А, В, С и т. д.

Сделаем сразу же одно замечание. Согласно данному выше определению, событие считается случайным, если его наступление в результате опыта представляет собой лишь одну из возможностей. Под это определение формально подходят и такие события, которые в результате данного опыта обязательно наступают', эти события

7

называют достоверными. Например, достоверным является событие, состоящее в том, что при бросании игральной кости выпадает целое число очков или что выбранное наугад слово из данной книги содержит не более 50 букв. Итак, достоверное событие можно рассматривать как одну из разновидностей случайного события.

Аналогичное замечание относится и к невозможным событиям, т. е. таким, которые никогда не наступают при осуществлении данного опыта. Невозможное событие тоже можно рассматривать как случайное. Примером невозможного события может служить получение двух выигрышей по одному лотерейному билету1.

В дальнейшем нас будут интересовать только такие опыты, которые можно повторить (в принципе) неограниченное число раз; именно такой характер носит опыт с бросанием монеты, с покупкой лотерейного билета, с обследованием изделия на годность или брак. Любое случайное событие, наступление которого возможно в такого рода опытах, называется массовым или статистическим.

Массовые случайные события следует отличать от единичных, исключительных, обладающих той особенностью, что опыт, с которым связаны эти события, принципиально невоспроизводим. Например, событие «1 мая 1975 года в Москве шел дождь» является в этом смысле исключительным, так как воспроизвести наступление указанного дня невозможно. В то же время собьпие «1 мая в Москве шел дождь» (без упоминания о годе) является, несомненно, массовым: ведь наблюдать погоду в Москве 1 мая можно в течение многих лет.

Теперь мы в состоянии ответить на вопрос, с которого, собственно, и должно начинаться знакомство с теорией вероятностей: чем занимается, какие задачи ставит перед собой эта дисциплина? В самых общих словах предмет теории вероятностей может быть определен следующим образом.

Теория вероятностей занимается изучением закономерностей, присущих массовым случайным событиям.

Столь общая характеристика предмета, разумеется, еще мало что говорит о его содержании; она лишь очерчивает тот круг явлений, с которым имеет дело теория вероятностей. Больше того, эта характеристика кажется на первый взгляд противоречивой. Действительно, само утверждение о том, что случайным явлениям свойственны закономерности, звучит довольно неожиданно. Однако такие закономерности реально существуют, и их значение в целом ряде случаев очень велико.

Простейший пример закономерности такого рода дает опыт с бросанием монеты. Предположим, что бросание производится много раз подряд. Исход каждого отдельного бросания является случайным, неопределенным. Однако средний результат большого числа

1 Включая достоверное и невозможное события в общее понятие случайного события, мы поступаем аналогично тому, как делают, например, в курсе аналитической геометрии,' когда прямую линию рассматривают как частный случай кривой, или в курсе математического анализа, когда постоянную величину рассматривают как частный случай переменной.

8

бросаний утрачивает случайный характер, становится закономерным. А именно: «доля» тех бросаний, при которых выпадает герб (т. е. отношение числа таких бросаний к числу всех бросаний) с увеличением числа бросаний приближается к —.

Приведем другой пример, весьма важный с практической точки зрения. В сосуде заключен газ. Находясь в беспрерывном движении, молекулы газа ударяются друг о друга и вследствие этого постоянно меняют величину и направление своей скорости. Казалось бы, отсюда следует, что давление газа на стенки сосуда, обусловленное ударами отдельных молекул о стенки, должно меняться случайным, неконтролируемым образом. Однако мы хорошо знаем, что это не так: давление газа подчиняется строгой закономерности (закону Бойля-Л1ариотта). Причина этой закономерности кроется в том, что давление газа на стенки сосуда есть средний результат воздействия большого числа молекул. Случайные особенности, свойственные движению отдельных молекул, в массе (поскольку молекул много) взаимно погашаются, нивелируются, и возникает некоторая средняя закономерность.

Именно эта устойчивость среднего результата, его независимость от колебаний отдельных слагаемых и обусловливают широту применений теории вероятностей. Статистическая физика, аэро- и гидродинамика, ядерная физика, биология, медицина, лингвистика и т. д. — все эти области науки используют (одни в большей степени, другие в меньшей) понятия и выводы теории вероятностей и родственных ей дисциплин (математической статистики, теории информации и т. д.).

С простейшим типом закономерностей в случайных явлениях мы ознакомимся уже в следующем пункте.

2°. «Статистическое определение» вероятности случайного события. Сравнивая между собой случайные события, мы часто говорим, что одно из них более вероятно (имеет больше шансов наступить, в большей степени возможно), чем другое. Например, выпадение герба при бросании монеты — событие более вероятное, чем, скажем, совпадение дней рождения у двух наугад выбранных людей; последнее же событие в свою очередь более вероятно, чем получение максимального выигрыша в «Спортлото».

Чтобы придать подобным сравнениям точный количественный смысл, необходимо с каждым событием связать число, выражающее степень возможности данного события. Наиболее естественный путь для введения такого числа состоит в следующем.

Пусть А — случайное событие по отношению к некоторому опыту. Предположим, что опыт произведен N раз и при этом событие А наступило в NA случаях. Составим отношение

9

Оно называется частотой наступления события Л в рассматриваемой серии опытов.

Для весьма многих (практически для всех) случайных событий частота обладает свойством устойчивости. Это означает, что с увеличением числа опытов частота стабилизируется, приближается к некоторой постоянной р (Л). Естественно считать, что эта постоянная и измеряет как раз степень возможности события А. Она называется вероятностью события А.

Итак, в полном соответствии с интуитивным представлением о вероятности мы принимаем такое определение:

Вероятность случайного события — это связанное с данным событием постоянное число, около которого колеблется частота наступления этого события в длинных сериях опытов.

Заметим, что устойчивость частоты представляет собой одну из простейших закономерностей, проявляющихся в сфере «случайного». Эта закономерность в конечном счете составляет основу всех приложений теории вероятностей к практике.

Приведенное выше определение часто называют «статистическим определением» вероятности. Оно не является, конечно, математическим в строгом смысле этого слова, так как опирается на чуждые математике понятия: «опыт», «наступление события», «колебание около числа». Однако мы вовсе и не собираемся строить теорию, исходя из этого определения. Путь, который мы изберем, будет другим; этот путь типичен для математических дисциплин. В следующем параграфе будут установлены некоторые простейшие свойства вероятности. После этого статистическое определение как основа для дальнейших построений перестанет быть необходимым: вся последующая математическая теория будет исходить только из этих свойств, носящих характер четких математических положений (аксиом теории вероятностей).

Впрочем, сказанное еще не означает, что статистическое определение является чем-то лишним. Напротив, оно играет чрезвычайно важную роль, но не для самой теории, а для ее приложений. В дальнейшем мы будем находить вероятности различных событий путем расчетов, не обращаясь к эксперименту; практическое же истолкование полученных вероятностен будет связано именно со статистическим определением. Другими словами, если найденная путем некоторого расчета (по формулам теории вероятностей) вероятность события А равна числу р, то реальная ценность этого результата состоит прежде всею в возможности такого предсказания: при большом числе опытов частота наступления события А будет близка к р.

Укажем некоторые факты, непосредственно вытекающие из данного выше статистического определения.

Так как частота р всегда удовлетворяет условиям 0 р 1, то в тех же пределах заключена и вероятность любого события:

О <р(А)< 1.

При этом, если событие А достоверно, т. е. наступает при каждом осуществлении опыта, то NA = N и, значит, р = 1; тем самым вероятность достоверного события равна 1. В другом крайнем

10

случае, когда событие А невозможно, имеем: NA = 0 и, значит, р. = 0; таким образом, вероятность невозможного события равна нулю.

Рассмотрим несколько примеров случайных событий и для каждого из них постараемся, исходя из интуитивных соображений, указать соответствующую вероятность р(Д).

1. Опыт заключается в бросании монеты. Событие А — выпадение герба. Будем предполагать, что монета не деформирована (имеет правильную цилиндрическую форму), сделана из однородного материала и что чеканка на обеих ее сторонах не оказывает сколько-нибудь заметного влияния на распределение масс. Тогда естественно ожидать, что в длинных сериях бросаний герб и цифра будут появляться в среднем одинаково часто; как принято говорить в этом случае, обе стороны монеты «равноправны» («равновозможны»). Можно, таким образом, предполагать, что частота ц наступления события А будет колебаться около числа у. Отсюда напрашивается вывод, что р(А) =

2. В урне лежат 10 шаров: 4 белых и 6 черных. Шары неотличимы на ощупь. Из урны наугад извлекают один шар. Какова вероятность того, что он окажется черным?

Допустим, что указанный опыт проделан большое число раз. Учитывая «равноправие» шаров, можно ожидать, что частота появления черного шара будет приблизительно равна «доле», которую сос-тавляют черные шары в урне, т. е. —. Отсюда ясно, что р(А) = —.

3. Волчок приводится во вращение вокруг оси, после чего отпускается. Часть дискообразной поверхности волчка, —допустим, некоторый сектор, содержащий угол а (рис. 1), —закрашена. Событие А — касание волчком пола (после остановки) в точке, принадлежащей закрашенной части. Все те же соображения «равноправия» (на этот раз между различными точками окружности) подсказывают нам, что число наступлений события А будет составлять

примерно такую же долю от числа всех опытов, какую а составляет

от 2л; иначе говоря, что частота р будет колебаться около числа

а

2л”

Следовательно, р(Л) = —.

2л

Заметим, что последний пример можно свести к схеме извлечения шара из урны, частный случай которой был разобран в примере 2. В самом деле, представим себе, чго на окружности волчка каким-либо образом выделены с промежутками в один градус 3G0 точек. Час1ь из них, допустим k точек, приходится на закрашенный сектор. Пренебрегая дугами, меньшими 1°, будем считать, что точка соприкосновения волчка с полом является одной из выделенных точек. Тогда рассматриваемый опыт можно уподобить извлечению одного шара из урны,

Рис. 1

11

в которой находятся 360 шаров, причем k из них являются черными. Событие А в такой интерпретации будет означать извлечение черного шара. Вероятность k а

этого события равна ——, т. е. ——.

1 360 2л

Приведенные примеры характерны тем, что в каждом из них для нахождения искомой вероятности не потребовалось проводить опыты: интересующее нас число р(А) можно было указать, исходя из интуитивно ясной идеи «равноправия». Разберем еще один пример: в нем вероятность случайного события уже не может быть вычислена иначе, чем с помощью серии опытов.

4. Игральная кость имеет форму куба. На гранях, как обычно, написаны цифры от 1 до 6. Найти вероятность того, что при бросании кости выпадет цифра 1 (событие Л).

Если кость сделана из однородного материала, то опять-таки из соображений «равноправия» (между гранями) очевидно, что р(А) = —. Допустим, однако, что кость неоднородна (например, 6

где-то внутри нее запаян кусок свинца). Ясно, что в этом случае какие-то цифры будут выпадать чаще, чем другие. Для вычисления вероятности события А единственным способом является проведение большой серии бросаний. Найденная из этой серии частота п наступления события А может рассматриваться как приближенное значение для р(А).

§ 2. КОМБИНАЦИИ СОБЫТИЙ. ПРАВИЛО СЛОЖЕНИЯ ВЕРОЯТНОСТЕЙ

При нахождении вероятностей приходится, естественно, учитывать связи между событиями. Формы таких связей весьма многообразны. Наиболее простые из них заключаются в том, что одни события являются комбинациями других. В этом параграфе мы ознакомимся с тремя основными видами комбинаций: суммой событий, произведением событий, противоположным событием.

1°. Сумма событий. Пусть с некоторым опытом связаны события А и В. Их суммой называется третье событие А + В, которое (по определению) считается наступившим тогда и только тогда, когда наступает хотя бы одно из событий А или В. Если мы условимся наступление события обозначать знаком «+», а ненаступле-ние — знаком «—», то полную характеристику события А + В будет давать следующая таблица:

12

(Таблица читается по строкам. Например, первая строка расшифровывается так: если наступает А и наступает В, то наступает и А + В.)

Из приведенной таблицы можно видеть, что операция сложения событий есть в сущности операция дизъюнкции для высказываний. Говоря точнее, высказывание «наступило А + В» есть дизъюнкция высказываний «наступило Л» и «наступило В».

Аналогично определяется сумма трех событий, четырех и т. д. Вообще, сумма любого множества событий есть событие, которое наступает в тех и только в тех случаях, когда наступает хотя бы одно из событий данного множества.

Приведем пример. Пусть опыт заключается в выборе наугад точки из области й, являющейся квадратом на плоскости (такой опыт осуществляет брошенный наугад биллиардный шар — после ряда отражений от бортов биллиардного стола шар останавливается в случайной точке). Если А обозначает попадание точки в верхнюю половину квадрата (рис. 2), а В — попадание в правую половину, то Л + В будет означать попадание в область, являющуюся объединением указанных половин.

Дцугой пример. Пусть в опыте с бросанием игральной кости событие А есть выпадение числа, кратного 2, а В — выпадение числа, кратного 3. Тогда А + В будет выпадение хотя бы одного из чисел 2, 3, 4, 6.

2°. Произведение событий. Пусть Л и В — два события. Их произведением называется третье событие АВ, которое считается наступившим тогда и только тогда, когда наступают оба события А и В. Другими словами, АВ есть совместное наступление событий Л и В.

Таблица, характеризующая событие АВ, имеет вид:

А в АВ

+ + +

+ — —

— + —

— —

Рис. 2

13

Аналогично определяется произведение любого множества событий. Это событие, заключающееся в совместном наступлении всех событий данного множества.

Если, например, А и В — события из указанного выше примера с выбором точки внутри квадрата, то АВ будет означать попадание точки в правую верхнюю четверть квадрата. В примере с бросанием игральной кости событие АВ означает выпадение 6 очков. Если в том же примере в качестве А принять выпадение четного числа очков, а в качестве В — выпадение нечетного числа очков, то АВ будет означать невозможное событие.

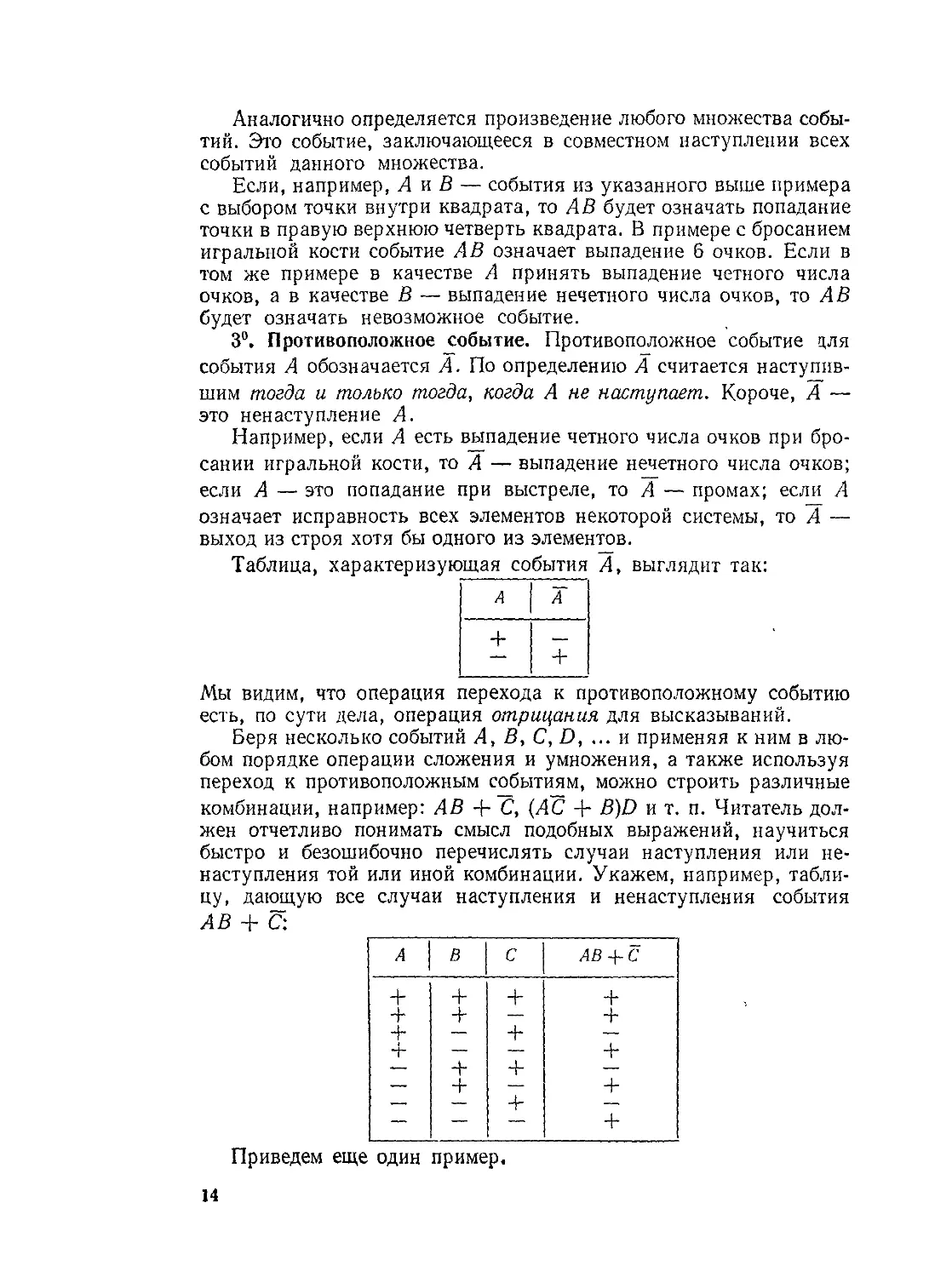

3°. Противоположное ^обытие. Противоположное событие для события А обозначается А. По определению А считается наступившим тогда и только тогда, когда А не наступает. Короче, А — это ненаступление А.

Например, если А есть выпадение четного числа очков при бросании игральной кости, то А — выпадение нечетного числа очков; если А — это попадание при выстреле, то А — промах; если А означает исправность всех элементов некоторой системы, то А — выход из строя хотя бы одного из элементов.

Таблица, характеризующая события А, выглядит так:

Мы видим, что операция перехода к противоположному событию есть, по сути дела, операция отрицания для высказываний.

Беря несколько событий А, В, С, D, ... и применяя к ним в любом порядке операции сложения и умножения, а также используя переход к противоположным событиям, можно строить различные комбинации, например: АВ + С, (АС + B)D и т. п. Читатель должен отчетливо понимать смысл подобных выражений, научиться быстро и безошибочно перечислять случаи наступления или не-наступления той или иной комбинации. Укажем, например, таблицу, дающую все случаи наступления и ненаступления события АВ + С:

АВЦ-С

+ + +

+ +

+ + + +

4-

4-

+ +

+ + +

Приведем еще один пример

14

Покупаются три лотерейных билета; событие означает выигрыш по первому билету, А2— выигрыш по второму, Аа— по третьему. Рассмотрим следующую комбинацию:

A^2 + А2А8 4- А^Ав- (1)

Согласно определению операций сложения и умножения, событие (1) наступает в любом из трех случаев: выигрывают 1-й и 2-й билеты, выигрывают 2-й и 3-й, выигрывают 1-й и 3-й. Другими словами, событие (1) означает выигрыш не менее чем по двум билетам.

Аналогичным образом, рассмотрев комбинацию

4- AjAzA3 4~ AjA^Ag, (2)

легко убедиться, что событие (2) означает выигрыш по двум билетам.

4°. Равенство между событиями. Некоторые замечания. В дальнейшем часто встречается запись А = В, означающая равенство между событиями А и В. Уточним смысл этой записи.

По определению события А и В считаются равными, если всякий раз, когда наступает одно из них, наступает и другое.

Разумеется, равные события могут иметь отличающиеся по форме словесные описания. Например, событие «не все студенты данного курса успешно сдали теорию вероятностей» и «по крайней мере один из студентов данного курса не сдал теорию вероятностей» равны, хотя и выражены различными оборотами речи.

Возвращаясь еще раз к операциям над событиями, выскажем ряд замечаний.

1. Выше уже говорилось о том, что операции сложения, умножения и перехода к противоположному событию равнозначны операциям дизъюнкции, конъюнкции и отрицания для высказываний. Отсюда следует, что все законы алгебры высказываний будут верны и для событий. Например, будут выполняться соотношения:

__________А = АВ + АВ,_

At + А2 4- 4~ Ал == AtA2 ... Ап,

АхА2 ... Ап — А{ + А2 + ••• 4- А„ и т. п.

2. Для наглядного истолкования различных соотношений между событиями удобно пользоваться так называемыми диаграммами Эйлера-Венна. В этом случае каждое событие рассматривается как попадание случайно брошенной точки в некоторую область на плоскости; иначе говоря, каждое событие задается некоторой фигурой на плоскости. При таком истолковании событие А + В будет не что иное, как попадание точки в область, являющуюся объединением фигур А и В (рис. 3), событие АВ — попадание в область, являющуюся пересечением фигур А и В, а событие А — попадание в область, дополнительную к фигуре А. Позже мы увидим, что такой подход является универсальным: с определенной точки зрения (см. § 3,

15

п. 2°) каждое событие можно истолковывать как некоторое множество, а операции А + В, АВ и А над событиями — как операции объединения, пересечения и дополнения для множеств.

5°. Правило сложения вероятностей. Согласно статистическому определению, вероятность случайного события можно оценить по частоте наступления этого события в большой серии опытов. Однако серию из большого числа опытов трудно осуществить практически. Поэтому непосредственное определение вероятности исходя из частоты возможно лишь в редких случаях. Как правило, вероятности различных событий стараются подсчитывать косвенным путем, не прибегая к эксперименту. Разработка правил для такого подсчета и составляет в значительной степени сод ер-

Рис. з жание теории вероятностей. Общий смысл

этих правил состоит в том, что различные соотношения между событиями влекут за собой определенные зависимости между их вероятностями.

Самое простое и в то же время самое важное из правил такого рода называется правилом сложения вероятностей. Как мы увидим дальше, оно можег быть положено в основу всей теории вероятностей.

Условимся называть два события А и В несовместными, если они не могут наступить вместе в одном опыте. Так, например, в опыте с бросанием игральной кости выпадение четного числа очков (событие А) и выпадение нечетного числа очков (событие В) — два несовместных события; в то же время выпадение числа очков, кратного 2, и выпадение числа очков, кратного 3, — события совместные (они наступают вместе при выпадении 6).

Правило сложения вероятностей формулируется следующим образом.

Если события А и В несовместны, то вероятность их суммы равна сумме их вероятностей:.

р(А + В) = р(А) + р(В). (3)

Приведем «доказательство» этого предложения (мы взяли слово «доказательство» в кавычки, желая этим подчеркнуть нестрогий характер рассуждений — ведь само понятие вероятности определено пока не вполне корректным образом).

Пусть опыт, с которым связаны данные события А и В, повторен N раз, при этом NA раз наступило событие А и NB раз — событие В. Ввиду несовместности событий А и В имеем:

16

*А+В = ^ +

Разделив обе части этого равенства на N, получим:

N, N

Л-|-£ л । в ~~N N~ ‘ ~Л^'

С увеличением N дробь, стоящая в левой части, будет колебаться около числа р (А + В), а слагаемые правой части — соответственно около чисел р (Л) и р (В). Отсюда и «следует» формула (3).

Методом полной индукции можно распространить правило сложения на любое конечное число событий. Назовем события Лп Л 2, ..., Ап попарно несовместными, если из i ф j следует несовместность событий At и Aj. Правило сложения для п событий утверждает: если события Аг, Л2, , А„ попарно несовместны, то справедливо равенство

Р Иг + Л2 + ... + А„) — р (Л4) + р (Л2) + ••• + Р Ия).

Из правила сложения для двух событий вытекает одно простое, но важное следствие.

Сумма вероятностей противоположных событий равна единице:

Р (А) + р (А) 1. (4)

Действительно, событие Л + Л достоверное (ибо при каждом осуществлении опыта событие Л либо наступает, либо не наступает), поэтому вероятность его равна 1. Учитывая, что события Л и А несовместны, и применяя правило сложения, получаем равенство (4).

Задачи на использование правила сложения будут рассмотрены позднее. Ограничимся пока простым примером.

Бросается игральная кость. Чему равна вероятность того, что выпадет четное число очков (событие Л)?

Обозначим через Лг выпадение t очков (i = 1, 2.... 6). Оче-

видно, событие А есть наступление хотя бы одного из событий Л2, Л4, Лв:

А — А2 А~ А± Ая.

Так как при этом события Л2, Л4, Ав попарно несовместны, то можно воспользоваться правилом сложения. Получим:

Р И) = Р (Л2) + р (Л4) 4 Р (Лв) =1+1 + 1=1. 6 6 6 2

§ 3. АКСИОМЫ ТЕОРИИ ВЕРОЯТНОСТЕЙ

До сих пор мы исходили из представления о вероятности случайного события как о числе, к которому приближается частота наступления этого события с увеличением числа опытов. Такое представление не может, конечно, служить основой для строгой

17

математической теории, так как в нем участвуют привходящие понятия (опыт, появление события и т. д.); кроме того (и это, пожалуй, самое существенное), не вполне ясно, какой точный смысл имеет само утверждение об устойчивости частоты.

Чтобы придать понятиям теории вероятностей строгость, присущую другим математическим понятиям, можно воспользоваться широко распространенным в математике аксиоматическим методом. Он состоит в том, что с самого начала фиксируются первичные, не подлежащие определению понятия данной теории. Их основные свойства формулируются в виде ряда аксиом. После этого все предложения теории (иначе говоря, все теоремы) выводятся из аксиом строго логическим путем, без обращения к посторонним понятиям, наглядности, «здравому смыслу» и т. д. Современная аксиоматика теории вероятностей принадлежит советскому математику А. Н. Колмогорову.

1°. Предварительные соображения. Чтобы сделать понятной точку зрения А. Н. Колмогорова, заметим, что в каждой конкретной теоретико-вероятностной задаче среди допускаемых к рассмотрению случайных событий можно выделить такие, которые являются в определенном смысле простейшими, элементарными. Элементарные события характеризуются, во-первых, тем, что при каждом осуществлении опыта наступает одно и только одно из них; во-вторых, любое событие А, связанное с данным опытом, должно распадаться на элементарные, т. е. представляться в виде суммы некоторого множества элементарных событий.

Предоставляем читателю убедиться в том, что данная выше характеристика элементарных событий эквивалентна следующей: во-первых, при каждом осуществлении опыта обязательно наступает какое-либо из этих событий, во-вторых, элементарные события «неразложимы». Последнее означает, что представление любого элементарного события С в виде суммы двух событий возможно лишь тривиальным образом: С = С + С или С = С + V, где V — невозможное событие.

Например, в опыте с бросанием игральной кости события

At, Аг, А3, Л4, Л8, Ав, (1)

где Ai означает выпадение i очков, являются элементарными. Действительно, любое событие, представляющее интерес в связи с бросанием игральной кости, формулируется как некоторое условие на число очков (например, «число очков четное», «число очков превосходит 2» и т. п.); напротив, любая информация, не касающаяся числа очков (скажем: «кость дважды ударилась об пол» или «кость закатилась под диван»), представляется несущественной. Отсюда ясно, что каждое событие, связанное с данным опытом, распадается на частные случаи из группы (1).

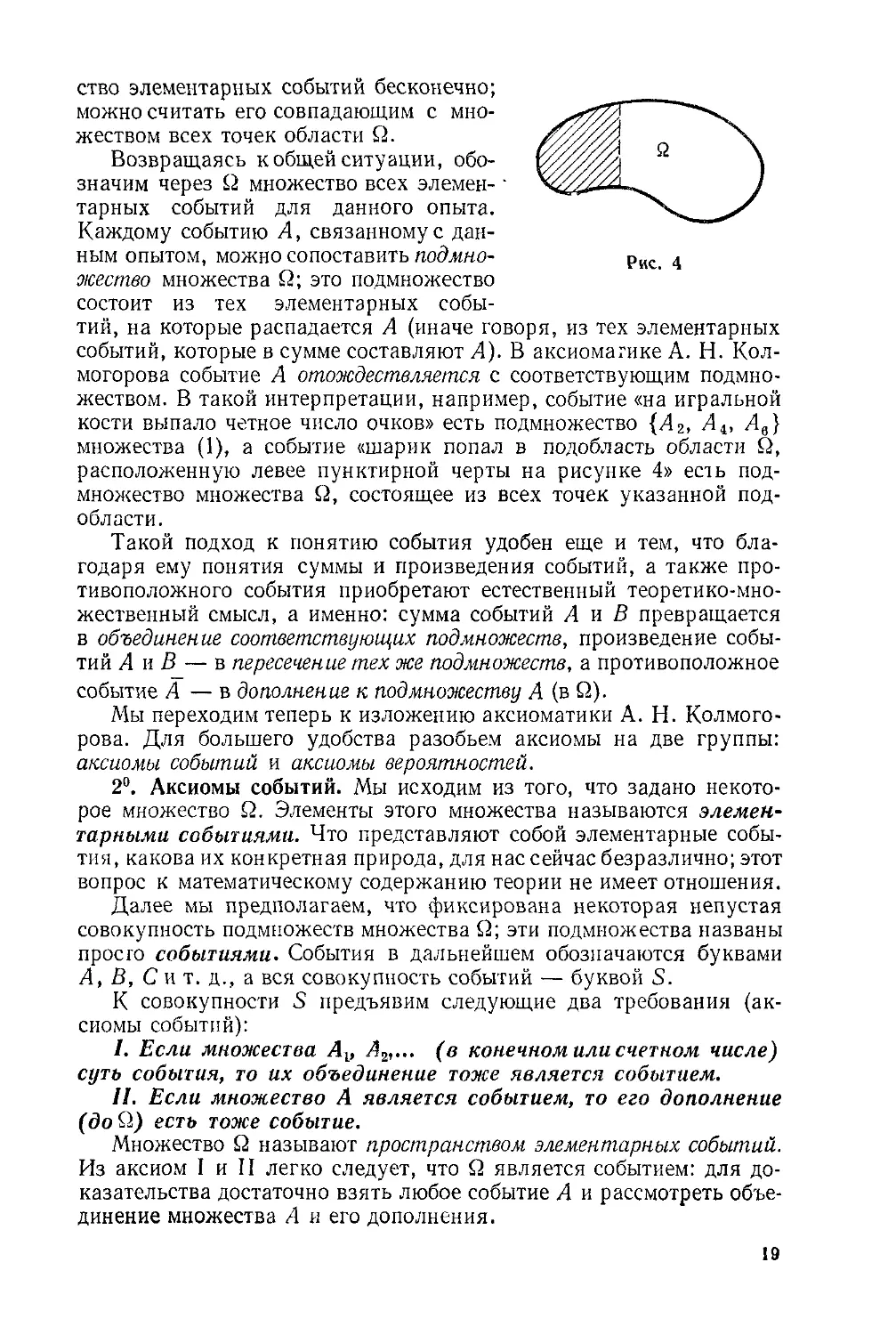

Рассмотрим еще один пример. Пусть опыт заключается в бросании маленького шарика в область Й на плоскости. Элементарное событие — это попадание шарика в определенную точку области й. Ясно, что суммами таких событий исчерпываются все мыслимые исходы опыта. В данном примере в отличие от предыдущего множе-18

ство элементарных событий бесконечно;

можно считать его совпадающим с мно- ''Х

жеством всех точек области Q. о

Возвращаясь к общей ситуации, обо- 2 )

значим через Q множество всех элемен-" 1

тарных событий для данного опыта.

Каждому событию А, связанному с дан-

ным опытом, можно сопоставить подмно- Рис 4

жество множества Q; это подмножество состоит из тех элементарных событий, на которые распадается А (иначе говоря, из тех элементарных событий, которые в сумме составляют Л). В аксиоматике А. Н. Колмогорова событие А отождествляется с соответствующим подмножеством. В такой интерпретации, например, событие «на игральной кости выпало четное число очков» есть подмножество {А2, Д4, Лв} множества (1), а событие «шарик попал в подобласть области Q, расположенную левее пунктирной черты на рисунке 4» есть подмножество множества Q, состоящее из всех точек указанной подобласти.

Такой подход к понятию события удобен еще и тем, что благодаря ему понятия суммы и произведения событий, а также противоположного события приобретают естественный теоретико-множественный смысл, а именно: сумма событий А и В превращается в объединение соответствующих подмножеств, произведение событий А и В — в пересечение тех же подмножеств, а противоположное событие А — в дополнение к подмножеству А (вй).

Мы переходим теперь к изложению аксиоматики А. Н. Колмогорова. Для большего удобства разобьем аксиомы на две группы: аксиомы событий и аксиомы вероятностей.

2°. Аксиомы событий. Мы исходим из того, что задано некоторое множество Q. Элементы этого множества называются элементарными событиями. Что представляют собой элементарные события, какова их конкретная природа, для нас сейчас безразлично; этот вопрос к математическому содержанию теории не имеет отношения.

Далее мы предполагаем, что фиксирована некоторая непустая совокупность подмножеств множества Q; эти подмножества названы просто событиями. События в дальнейшем обозначаются буквами А, В, С и т. д., а вся совокупность событий — буквой S.

К совокупности S предъявим следующие два требования (аксиомы событий):

/. Если множества Av Аг,... (в конечном или счетном числе) суть события, то их объединение тоже является событием.

II. Если множество А является событием, то его дополнение (до Q) есть тоже событие.

Множество Q называют пространством элементарных событий. Из аксиом I и II легко следует, что Q является событием: для доказательства достаточно взять любое событие А и рассмотреть объединение множества А и его дополнения.

19

Примем следующее соглашение. В тех случаях, когда число элементарных событий конечное (т. е. когда множество й состоит из конечною числа элементов), под событиями будем понимать все без исключения подмножества множества й (включая, разумеется, и пустое подмножество — оно является дополнением к Й и потому обязано быть событием). В этом случае аксиомы I и II становятся, конечно, ненужными — они выполняются автоматически.

Условимся операцию объединения множеств обозначать знаком «+» (знаком сложения), операцию пересечения множеств — знаком «•» (знаком умножения); наконец, если А — подмножество в Й, то дополнение к А будем обозначать А. Тогда аксиомы I и II запишутся следующим образом:

I. Ai £ S, А2 £ S, ... => Af + Д2 4- ... £ S;

II. А £ S => А С S.

Укажем одно следствие из аксиом I и II.

Если множества Аи Аг, ... суть события, то их пересечение — снова событие. Или в символической записи:

А{ $ S, А., £ S, ... => <4i<42 ... С S.’

Для доказательства воспользуемся соотношением

AtA2 ... = Ai + Аг + ..., (2)

справедливым, как известно, для любых подмножеств А{, Аг, ... фиксированного множества Й. В силу аксиом II и I множество, записанное в правой части (2), есть событие; значит, и AtA2 ... — событие. Снова применяя аксиому II, получим, что Лр42 ... тоже событие.

Введем следующие определения.

Два события А и В, не имеющие (как два подмножества) общих элементов, называются несовместными. События А и А называются противоположными.

3°. Аксиомы вероятностей. Теперь мы можем сформулировать аксиомы, задающие само понятие вероятности.

1. Каждому событию А поставлено в соответствие неотрицательное число р(А), называемое вероятностью события А.

2. Если события А], А2, ... попарно несовместны, то р(А\ 4- Д2 + •••) = Р(А\) + Р(Д2) +••• •

Заметим, что при бесконечном числе событий At, А2 ... в правой части написанного равенства стоит сумма ряда.

Очевидно, если множество й является конечным, то любая совокупность попарно не пересекающихся подмножеств состоит лишь из конечного числа подмножеств. Отсюда ясно, что для случая конечного й аксиома 2 равнозначна такому (в общем случае более слабому) требованию:

2'. р(А 4- В) — р(А) 4- р(В), если А и В несовместны.

20

Чтобы подчеркнуть различие между аксиомами 2 и 2', часто называют аксиому 2' аксиомой аддитивности, а 2 — аксиомой счетной аддитивности.

3. р(П) = 1.

Аксиомы 1—3 составляют основу всей теории вероятностей. Все теоремы этой теории, включая самые сложные, выводятся из них формально-логическим путем.

Укажем несколько примеров такою вывода.

Исходя из очевидного соотношения между подмножествами

А + А = И

и применяя аксиомы 2 и 3, получаем, что

Р (А) + р (А) = 1.

Отсюда, принимая во внимание неотрицательность чисел р (А) и р (А), находим:

Р (А) < 1

— факт, не содержащийся непосредственно ни в одной из аксиом 1 —3.

В качестве другого следствия аксиом выведем формулу

р (А + В) = р (А) + р (В) - р (АВ), (3)

в которой события А и В могут быть как совместными, так и несовместными.

Формула (3) получается следующим образом. Рассмотрим очевидные соотношения между событиями (как между подмножествами множества Q):

А = АВ + АВ, А + В = В + АВ

(рис. 5). Применяя к обоим равенствам аксиому сложения, получим два числовых равенства:

р (А) = р (АВ) + р (АВ)Л р (А+В) = р (В) + р (АВ).

Вычитая из последнего равенства предыдущее, приходим к формуле (3).

Докажем теперь теорему, устанавливающую одно важное свойство величин р (А).

Теорема (о непрерывной зависимости числа р (А) от события А).

Пусть последовательность событий

А},А2... такова, чтоА1=>А2=оА3щ> ... (записаны включения для подмножеств).

Тогда Ишр(Ал) =р(А), (4)

Л-*ОО

21

где А есть пересечение всех множеств А ь А 2 ... .

Доказательство. Рассмотрим произвольный элемент а С Аь Возможны только два случая:

1) а принадлежит любому из множеств А„, где п = 1, 2, ...;

2) а принадлежит некоторому Ап, но не принадлежит An+i, т- е. а С A„A„+i.

Из сказанного следует, что

At = А + А1/12 + А2А3 4* А3Л4 +

причем, как нетрудно видеть, слагаемые этой суммы попарно не пересекаются. По аксиоме 2 имеем:

Р ИО — Р И) + Р (AiA2) + р (Л2^з) + Р И3А4) + (5)

Так как при любом п последовательность Ап, Ал+1 ... также удовлетворяет условиям теоремы, то к ней применимы те же рассуждения. Следовательно,

Р Ия) = Р И) + Р (АпАп+д + р (АплЛАп+2) + ... . (6)

Обозначим через г,г сумму членов ряда (6), начиная со второго члена. Если мы докажем, что гп -> 0 при п->оо, то отсюда будет следовать (4). Но, как нетрудно видеть, гп совпадает с остатком ряда (5) после n-го члена; и так как ряд (5) сходится, то его остаток после п-го члена должен стремиться к О.И

4°. Вероятностные схемы. Предмет теории вероятностей. Аксиомы А. Н. Колмогорова дают весьма удобную математическую схему для исследования конкретных теоретико-вероятностных задач или, по-другому, для описания опытов со случайными исходами. В этой схеме содержится вся информация о данном опыте, представляющая интерес с точки зрения теории вероятностей. Схема включает в себя три объекта:

1) множество Q (называемое пространством элементарных событий);

2) систему S подмножеств множества Q (называемых событиями), удовлетворяющую аксиомам 1,11 пункта 2°;

3) функцию р (А), определенную на S и удовлетворяющую аксиомам 1, 2, 3 п. 3°.

Совокупность этих трех объектов условимся называть вероятностной схемой данного опыта или просто вероятностной схемой. Упоминание об опыте может быть опущено, поскольку понятие вероятностной схемы является, как мы видим, чисто математическим понятием и не требует привязывания к какому-либо конкретному опыту.

С введением понятия вероятностной схемы появляется возможность определить предмет теории вероятностей в не вызывающих сомнений точных терминах, а именно: теория вероятностей занимается изучением всевозможных вероятностных схем. Естественно, что эту теорию должны интересовать как теоремы, справедливые в любой вероятностной схеме (таких теорем сравнительно немного, примером может служить доказанная выше теорема о непрерывно

22

сти функции р (Л) или, скажем, формула (3)), так и теоремы, относящиеся к вероятностным схемам тех или других специальных типов. В частности, одно из центральных мест в теории вероятностей занимает изучение вероятностных схем, в которых множество Q есть множество всех точек числовой оси, а событиями являются подмножества вида {х\х < а}, а также все подмножества, получаемые из них конечным или счетным числом операций объединения, пересечения и дополнения, — такие вероятностные схемы носят название случайных величин. Изучению случайных величин посвящена большая часть этой книги (главы 5—9).

5°. Вероятность как мера. Нетрудно видеть, что свойства вероятности, зафиксированные в аксиомах, напоминают свойства площадей и объемов. Действительно, если в качестве Q взять множество всех точек некоторой области на плоскости, имеющей площадь 1, назвать событиями всевозможные квадрируемые подмножества области Q и сопоставить каждому событию А число р (Л), равное площади соответствующего подмножества, то будут выполняться требования аксиом 1, 2', 3; если же расширить класс событий, включив в него все подмножества из Q, измеримые по Лебегу, то будет обеспечено и выполнение аксиомы 2.

Аналогичное замечание справедливо и в отношении объемов.

В общем случае неотрицательная функция р (Л), определенная для подмножеств и удовлетворяющая аксиоме 2, называется мерой, а именно мы говорим, что р (Л) есть мера подмножества А. Таким образом, понятие меры является обобщением понятия площади или объема. В известной степени всю теорию вероятностей можно рассматривать как один из разделов общей теории меры.

Сказанное выше относительно общего понятия меры нуждается в уточнениях. Пусть задана некоторая непустая система подмножества множества Q. Обозначим эту систему S; таким образом, запись А € S будет означать, что подмножество А множества Q принадлежит заданной системе S. Условимся называть S боре-левской1 системой подмножеств, если выполняются следующие условия:

1) Из А б S следует А g S (где А есть Q \ Л).

2) Из Л1 С S, А2 g S, ... следует Ai + Л2 + ... С S.

Другими словами, борелевская система подмножеств характеризуется тем, что операции объединения и дополнения, выполненные в конечном или счетном числе, не выводят за пределы этой системы. (Заметим, что из условий I) и 2) вытекает О € S, поскольку для любого подмножества А справедливо соотношение А + А = £2.)

Предположим далее, что каждому подмножеству А из борелевской системы S сопоставлено некоторое неотрицательное число или символ оо; и то и другое условимся обозначить р (Л). При этом потребуем, чтобы соответствие Л ->• р (Л) обладало следующим свойством, носящим название свойства счетной аддитивности'.

Р (Лг + Л2 + ...) = р (Л1) + р (Л2) + ...,

1 Эмиль Борель (1871—1956)—французский математик, один из творцов теории меры. Термин «борелевская система подмножеств» часто заменяется другим: «а — алгебра подмножеств».

23

если подмножества Ai, А2, ... (из системы S) попарно не имеют пересечений. Не исключается и такой случай, когда левая часть или какие-то слагаемые правой части равны оо; чтобы охватить этот случай, условимся считать:

со + р = оэ, оо -j- оо = оо, если р — конечное число.

При соблюдении всех указанных условий функция р (Л) называется мерой. Таким образом, мера есть счетно-аддитивная функция, определенная на бо-релевской системе подмножеств. Следует, однако, помнить, что допускаются и бесконечные значения меры, т. е. для некоторыхЛ £ S может быть р (Л) = оо.

Нетрудно видеть, что если р (Й) есть конечное число (а не оо), то при любом Л € S число р (Л) будет конечным (это следует из равенства р (Л) + р (Л)= = р (Й)). В этом случае мера называется конечной. Примером конечной меры может служить мера Лебега, если в качестве системы S рассмотреть систему всех измеримых множеств па прямой, принадлежащих некоторому фиксированному отрезку Й, или систему всех измеримых множеств на плоскости, принадлежащих данному фиксированному прямоугольнику Й.

Рассмотрим случай конечной меры, т. е. положим р (й) = с, где с — конечное число. Тогда вместо р (Л) можно ввести новую меру р* (Л), определив ее равенством р* (Л) = - — Для меры р*(Л) будет выполняться условие: о

р* (Й)= 1.

Любая мера, удовлетворяющая такому условию, называется нормированной. Как показывает система аксиом А. И. Колмогорова, теория вероятностей есть, по сути дела, не что иное, как теория нормированных мер.

Изложенные выше построения свидетельствуют о том, что язык современной теории вероятностей есть язык теории множеств, или, выражаясь точнее, язык теории меры. Между тем прикладные задачи формулируются на другом, «практическом» языке (читатель может для сравнения еще раз прочитать примеры из § 1, где вообще нет упоминания о множествах). Поэтому для придания теоретиковероятностным рассуждениям полной строгости желателен перевод с одного языка на другой. В дальнейшем при разборе конкретных задач мы, как правило, не будем делать такого перевода. Однако в тех случаях, когда отсутствие должной строгости может затруднить понимание вопроса, мы полностью опишем вероятностную схему, отвечающую данной задаче: укажем пространство Й элементарных событий, систем S подмножеств, играющих роль событий, и определим во всем объеме функцию р (Л).

§ 4. КЛАССИЧЕСКИЙ СПОСОБ ПОДСЧЕТА ВЕРОЯТНОСТЕЙ

Рассмотрим тот частный случай, когда множество й — пространство элементарных событий — является конечным множеством. Пусть элементы этого множества (элементарные события) суть <о2, ..., сол. Согласуясь со схемой, изложенной в § 3, будем считать, что каждому подмножеству А множества й, т. е. каждому событию, сопоставлено неотрицательное число р (А), причем выполнены требования, сформулированные в аксиомах 1—3, В частности, из этих требований следует:

р(А1) + р(А2) + ...+р(Ал) = 1, (1)

где А; есть одноэлементное подмножество {со;}, (г — 1, 2, .... п);

24

чтобы получить это равенство, нужно к соотношению + ^2 + ••• + Аг =

применить аксиомы 2 и 3.

Нетрудно видеть, что весь набор чисел р (Д), где А — любое подмножество множества Й, определяется, если считать известными числа

р (А А, р (А), р (Ап). (2)

Действительно, если событие А есть сумма каких-то k элементарных событий, скажем Ait А 2, ..., Ак, то в силу аксиомы 2 мы должны иметь:

р (А) = р (At) + р (Аг) + ... + р (Аа), что и решает вопрос о нахождении числа р (Л).

Рассмотрим более подробно тот случай, когда все числа (2) равны между собой:

р (А) = р (Д2) = ... = р (Аа), другими словами, когда все элементарные события равновероятны. Из соотношения (1) в этом случае вытекает:

Р(А) = ~, = р(А) = -.

п п п

Следовательно, если какое-то событие А представляется в виде суммы k равновероятных элементарных событий, то справедливо равенство:

р (А) = + — (k слагаемых)

п п п

или просто

= (3)

Формула (3) позволяет решать многие задачи на нахождение вероятностей. В соответствии со сказанным ее применяют в тех случаях, когда для данного опыта можно указать группу из конечного числа событий Alt Л2, ..., Аа со следующими свойствами:

1) в результате опыта наступает каждый раз одно и только одно из этих событий',

2) указанные события по условиям данного опыта равновероятны.

Если выполнены эти условия, то, как показывают наши рассуждения, для любого события А, представимого в виде суммы каких-то k из указанных выше событий, будет справедливо равенство (3).

Обычно события Ль А2, ..., Ап, обладающие свойствами 1) и 2), называют элементарными исходами данного опыта (иногда шансами или случаями). При этом те элементарные исходы, которые в сумме составляют А, называют благоприятными для А, остальные элементарные исходы -неблагоприятными для А. В этой терминологии формула (3) читается так: вероятность собы

25

тия А равна отношению числа элементарных исходов, благоприятных для А, к общему числу элементарных исходов.

Способ подсчета вероятностей, основанный на формуле (3), получил название классического. Этим способом пользовались ученые XVII века, стоявшие у истоков теории вероятностей, -французские математики Блез Паскаль и Пьер Ферма, а также голландский математик Христиан Гюйгенс. Разумеется, в то далекое от нашей эпохи время трудно было предвидеть роль понятия вероятности, разнообразие и серьезность будущих приложений теории вероятностей к -естествознанию и технике. Первоначальным материалом, на котором «отрабатывались» простейшие факты теории, были азартные игры, весьма распространенные в обществе XVI — XVII веков. Названные выше ученые производили, в частности, подсчет вероятностей, с которыми может появиться та или иная комбинация карт (в карточной игре) или та или иная комбинация костей (при игре в кости). В переписке между ними, посвященной разбору конкретных задач, формировались . первые понятия теории вероятностей. Неудивительно, что с тех пор задачи о бросании игральной кости, об извлечении карт из колоды, шаров из урны и т. п. стали традиционными для теории вероятностей. Заметим, что и по сей день эти задачи сохраняют свою роль как тренировочные упражнения, а в некоторых случаях как наглядные модели для более серьезных вероятностных схем.

Историческая справка

Блез Паскаль (1623—1662)

Блез Паскаль (1623—1662)—французский математик, физик, отчасти философ. С его именем связан целый ряд понятий и фактов, ставших в науке классическими. Всем известен закон Паскаля в физике; широкой известностью пользуется теорема Паскаля в геометрии, арифметический треугольник Паскаля в комбинаторике.

Пьер Ферма (1601—1669)—французский математик, юрист по профессии. Прославился открытиями в теории чисел. Широкой публике Ферма известен как автор знаменитой «проблемы Ферма», не решенной до конца и в настоящее время. Известен принцип Ферма распространения света, согласно которому свет движется из одной точки в другую по такому пути, который требует наименьшей затраты времени.

Христиан Гюйгенс (1629—1695) — голландский математик и физик. Ему принадлежат исследования по колебанию маятника (заметим, что Гюйгенс был конструктором первых маятниковых часов). Гюйгенс — основоположник волновой теории света. Им же сделан ряд открытий в астрономии (кольца Сатурна, спутники Юпитера).

Рассмотрим ряд примеров, иллюстрирующих классический способ подсчета вероятностей.

Пример 1. В урне находятся 10 шаров: 4 белых и 6 черных. Из урны наудачу извлекают один шар, Какова

26

вероятность того, что он окажется черным (событие Л)?

Решение. Этот пример уже рассматривался ранее (§ 1) в рамках интуитивного подхода к понятию вероятности. Разберем его снова.

Представим себе, что шары снабжены номерами 1, 2, ..., 10, причем черные шары получили номера 1, 2, ..., 6.

Обозначим через Лг, где i — 1, 2, ..., 10, следующее событие: извлечение шара с номером I.

Тогда события Ль Л2, ..., Л1о будут элементарными исходами данного опыта; действительно, при каждом осуществлении опыта наступает одно и только одно из них, а оговорка «наудачу» в формулировке задачи служит указанием на то, что все события Л; равновероятны.

Интересующему нас событию Л благоприятны исходы Л2, ..., Лв. Значит, в данном случае п = 10, k = 6 и р (Л) =

= —.А

10

Замечание 1. При решении задач на подсчет вероятностей классическим способом решающее значение имеет правильный выбор элементарных исходов. Обычно такой выбор в условии задачи прямо не оговаривается, его приходится «домысливать», исходя из сюжета задачи. Например, в только что решенном примере условие, что выбор извлекаемого шара производится

истолковать как равновероятность исходов Лъ Л2, ..., Л1о.

Замечание 2. Приведенное выше решение примера 1 отличается некоторой громоздкостью. При соответствующем навыке можно рассуждать короче, например, так: опыт с извлечением шаров из урны имеет 10 равновероятных исходов, из них событию Л благоприятны 6 исходов, значит, р (Л) = —. Или еще короче: из 10 возможных случаев событию Л благоприятны 6, следовательно, р (Л) = —.

10

Рассмотрим следующий пример.

Пример 2. Дважды бросается игральная кость. Какова вероятность того, что сумма очков при обоих бросаниях окажется больше 6 (событие Л)?

Пьер Ферма (1601-1665)

Христиан Гюйгенс (1629—1695)

«наудачу», естественно

27

Решение. Через Aif обозначим событие, состоящее в том, что при первом бросании выпало j очков, а при втором /. Тогда 36 событий

Л() Л12 ... Л1Я

Л21 Л 22 Л26

^61 ^82 •••

можно рассматривать как элементарные исходы опыта, заключающегося в двукратном бросании игральной кости. Действительно, при каждом осуществлении опыта наступает одно и только одно из этих событий, а соображения «равноправия» (между гранями игральной кости, а также между первым и вторым бросаниями) позволяют считать указанные события равновероятными. Интересующему нас событию Л благоприятны исходы Л34, Л43, Л35, Л53, Л44, Л45, ^54’ -^48’ ^55> й4 (остальные неблагоприятны); следовательно, k = 10. Отсюда имеем:

р (Л) = - = - = п 36 18

Практический смысл полученного результата состоит в том, что если опыт с двукратным бросанием игральной кости производить 5 большое число раз, то частота наступления Л будет близка к —;

иначе говоря, в среднем в пяти опытах из 18 будет наступать событие Л. А

Пример 3. Десять книг наудачу расставляются на книжной полке. Какова вероятность того, что три конкретные из этих десяти книг (скажем, учебники математики, физики и химии) окажутся стоящими рядом (событие Л)?

Решение. Элементарным исходом опыта теперь следует считать любую расстановку десяти книг на полке; слово «наудачу» служит указанием на то, что всевозможные расстановки равновероятны. Число всех расстановок равно, очевидно, 10! Благоприятными для события Л являются расстановки, в которых данные три книги стоят рядом. Подсчитаем число таких расстановок.

Для этого представим, что данные три книги объединены в одну связку; условимся эту связку рассматривать как одну «большую» книгу. Тогда можно считать, что имеется всего 8 книг. Их расстановка возможна 8! способами. Теперь следует учесть, что внутри «большой» книги данные три книги могут переставляться 3! способами. Отсюда следует, что число благоприятных расстановок будет 8! • 3!. Таким образом, р(Л) = -! ' -- — ~ р- А

Пример 4. В лотерее разыгрывается 100 билетов. Выигрыши падают на 10 билетов. Некто покупает три билета. Какова вероятность того, что хотя бы один из них выиграет?

28

Решение. В данном случае опыт заключается в выборе наугад трех лотерейных билетов. Перенумеруем все возможные тройки билетов. В качестве номеров будут фигурировать числа 1, 2, ...

™ 100 . 99 . 98 „ л л

п, где п = Cf00 = --— -------. Пусть At — событие, заключающееся в покупке тройки с номером i. Тогда события Ait А2..Ап

можно рассматривать как элементарные исходы данного опыта.

Интересующее нас событие А состоит в том, что хотя бы один из выбранных билетов оказался выигрышным. Благоприятными для А являются такие группы из трех билетов, которые содержат хотя бы один выигрышный билет, неблагоприятными — такие, в которых ни на один билет не падает выигрыш. Число неблагоприятных групп равно Сдо, следовательно, число благоприятных есть k = Cwo — — Сзо- Отсюда

Р(Л) = - = 1 п

С3

Г’З с100

90 • 89 - 88

100 -99-98

(4)

Полученное выражение приближенно .равно:

1 —

(0,9)3 = 0,271 ... .

Впрочем, выражение (4) нетрудно подсчитать точно. Такой подсчет дает р (Л) = 0,2735 ... . ▲

Рассмотрим в связи с последним примером еще один пример.

Пример 5. В условиях лотереи примера 4 выяснить, какое минимальное число билетов нужно купить, чтобы вероятность получения хотя бы выигрыша оказалась большей, чем 0,5.

Решение. Пусть покупаются т билетов. Обозначим вероятность выигрыша хотя бы по одному из них через рт. Понятно, что с ростом т число рт будет возрастать. Наша цель — найти наименьшее значение т, при котором это число больше 0,5.

Рассуждая, как в примере 4, получим:

Л Л

Рт v ЮоД 99/ \

10

100 - (т — 1)

Следовательно, / 10 \т

При т — 6 правая часть больше 0,5 (проверьте!), следовательно, искомое значение т находится среди чисел 1, 2, 3, 4, 5, 6.

Непосредственным подсчетом по формуле (5) находим: Pi — 0,34 ..., — 0,43 ... .

Оба написанных числа меньше 0,5. Таким образом, искомое значение т есть 6. А

29

§ 5. ГЕОМЕТРИЧЕСКИЕ ВЕРОЯТНОСТИ

В § 3 мы ознакомили читателя с системой аксиом теории вероятностей. Конкретные реализации этой системы, возникающие при решении практических задач, могут быть самыми разными; например, в классической схеме рассматривается реализация, в которой пространство Q элементарных событий есть множество из конечного числа п элементов, причем вероятности этих элементов одинаковы. Рассмотрим теперь еще один интересный класс реализаций. В каждой из них пространство Q является бесконечным. По причинам, которые будут объяснены ниже, эти реализации называют геометрическими', соответственно этому вероятности р (Л) различных событий в таких реализациях называют геометрическими вероятностями.

Пусть Q — произвольное множество конечной лебеговой меры на прямой или в плоскости (более общо—в «-мерном арифметическом пространстве /?”). Условимся называть событиями всевозможные измеримые подмножества в Q. Каждому событию поставим в соответствие неотрицательное число

где р (А) обозначает (лебегову) меру множества А.

Все аксиомы — как для событий, так и для вероятностей, см. пп. 2° и 3° § 3 — будут в этом случае выполнены, и мы получим некоторую модель системы аксиом А. Н. Колмогорова. Особенностью этой модели является, конечно, ее геометрический характер; при этом существенно, что вероятность р (А) определяется не конкретной формой подмножества А, а единственно мерой А.

К указанной выше геометрической схеме сводится довольно большой круг задач. В каждой из них элементарное событие можно интерпретировать как случайный выбор точки в некоторой области Й. При этом условия задачи должны быть такими, чтобы все точки в й можно было считать «равноправными» (в смысле возможности их выбора).

В качестве примера рассмотрим следующую задачу.

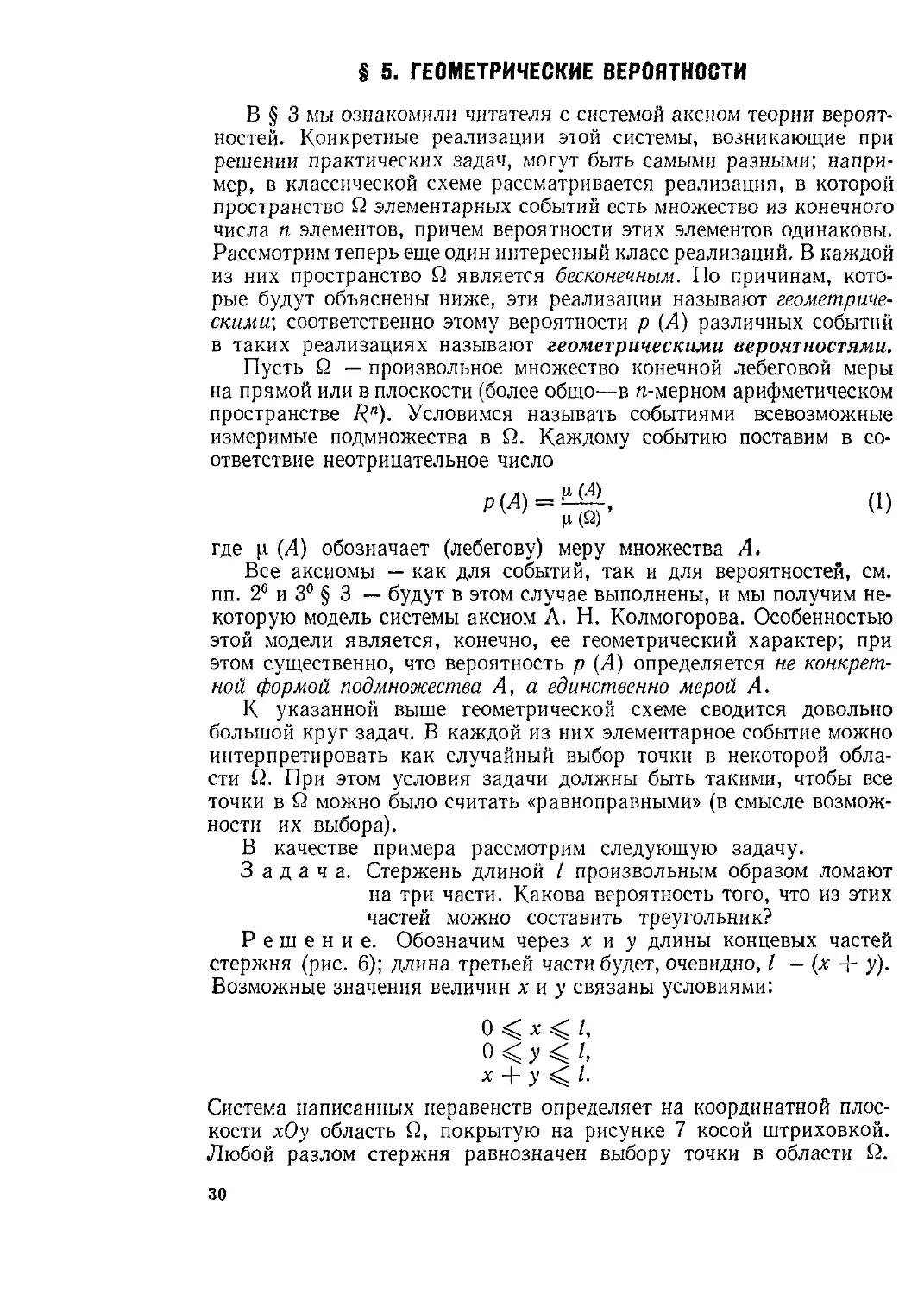

Задача. Стержень длиной I произвольным образом ломают на три части. Какова вероятность того, что из этих частей можно составить треугольник?

Решение. Обозначим через х и у длины концевых частей стержня (рис. 6); длина третьей части будет, очевидно, I - (х + у). Возможные значения величин х и у связаны условиями:

О «С х I, О < у < I, х + у I.

Система написанных неравенств определяет на координатной плоскости хОу область Q, покрытую на рисунке 7 косой штриховкой. Любой разлом стержня равнозначен выбору точки в области Q.

30

Для того чтобы из трех частей стержня можно было сложить треугольник, необходимо и достаточно выполнение условий:

X < I — X,

У < I ~ У, (2)

I - (х 4- у) < х + у

(мы записали, что каждая сторона треугольника должна быть меньше суммы двух других). Неравенства (2) выделяют из Q область А, зачерченную на рисунке двойной штриховкой.

Будем считать оправданным применение формулы (1) (основанием для этого служит «произвольность» разлома стержня). В этом случае можно записать:

р (д\ — площадь А = 2 А площадь Q 4

X Z-(X+Y) Y

Рис. 6

Глава 2.

КОМБИНАТОРИКА

В этой главе рассматриваются задачи комбинаторного характера. В каждой из них требуется подсчитать число различных вариантов, ответить на вопрос «сколько?» или «сколькими способами?». Например, интересно узнать, сколькими способами можно рассадить п людей в аудитории, где имеется п мест, сколько различных последовательно-параллельных соединений можно составить из п электрических ламп, каким количеством способов можно набрать на п вступительных экзаменах сумму баллов не ниже k, сколькими способами выпуклый n-угольник можно разбить на треугольники с помощью диагоналей.

Комбинаторика имеет весьма непосредственное отношение к теории вероятностей. Близость этих разделов обусловлена прежде всего классическим способом подсчета вероятностей. Формула

рИ) = -, п

где п — число всех элементарных исходов опыта, a k — число исходов, благоприятных для А, сводит вычисление р (А) к нахождению двух чисел п и k\ последняя задача во многих случаях носит явно комбинаторный характер. Кроме теории вероятностей, комбинаторика используется в теории вычислительных машин, теории автоматов, в некоторых задачах экономики, биологии и т. д.

§ 6. ПРАВИЛА СУММЫ И ПРОИЗВЕДЕНИЯ

Решение многих комбинаторных задач основывается на двух фундаментальных правилах, называемых соответственно правилами суммы и произведения.

1°. Правило суммы. Правило суммы выражает вполне очевидный факт: если X и Y — два непересекающихся конечных множества, то число элементов, содержащихся в объединении этих множеств, равно сумме чисел элементов в каждом из них.

Если мы условимся число элементов конечного множества X обозначать |Х |, то правило суммы запишется следующим образом:

|Х + К| = |Х| + |К|,

если X и К не имеют общих элементов.

Обычно правило суммы формулируют несколько иначе: если некоторый объект х можно выбрать п способами, а объект у — т

32

способами, причем любой способ выбора объекта х отличен от любого способа выбора у, то выбор «х или у» можно сделать п + т способами.

Столь же очевидным является и обобщение правила суммы на любое число k множеств: если Х4, Х2, .... ХА — какие-то попарно непересекающиеся конечные множества, то

|Х, + Х2 + ... + ХА| = PGI + |Х2| + ... + |ХЙ|.

Задачи, которые можно решить применением одного лишь правила суммы, по большей части тривиальны. Обычно правило суммы используют вместе с правилом произведения.

2°. Правило произведения. Будем рассматривать последовательности данной длины k:

(хь х2, .... хД,

состоящие из некоторых элементов хь х2, .... xk (не обязательно различных). Условимся для краткости называть такие последовательности строками. Две строки (хь х2, .... хД и (уь у2, ..., уД будем считать различными в том и только в том случае, если хотя бы для одного номера i (из совокупности 1, 2, .... /г) элемент х, отличен от уг.

Правило произведения может быть сформулировано следующим образом.

Пусть элемент Xi может быть выбран П\ способами; при каждом выборе Х[ элемент х2 может быть выбран п2 способами; при каждом выборе пары Х\,х2 элемент х3 может быть выбран п3 способами и т. д.; наконец, при каждом выборе xlt х2, ..., хЛ_1 элемент xk может быть выбран nk способами. Тогда число различных строк (xi, Хг, ..., xk) равно произведению п^ ... nk.

Докажем это правило, используя индукцию по k.

Пусть k — 2. Обозначим через пь аг, .... ап, различные значения для Xi. Среди строк (хи х2) имеется ровно п2 строк, начинающихся с щ (т. е. строк вида (щ, х2)), ровно п2 строк, начинающихся с а2, и т, д. Следовательно, число всех строк (хь х2) будет:

П2 ~ П1П2-

раз

Предположим теперь, что правило произведения справедливо для строк длины докажем тогда, что оно будет верно и для строк длины k + 1.

Любую строку {Xi, ...................... хк, хА+1) (1)

можно рассматривать как строку из двух объектов: строки (xt, х2, ..., хД и элемента хА+1. Первый объект, по предположению индукции, может быть выбран прг2 ... nk способами; при любом из этих способов элемент хй+1 по условию может быть выбран пА+) способами. Применяя уже доказанное правило для строк длины 2,

2 А. С. Солодовников

33

находим, что число различных строк (1) будет

(/2^2... n^-nk^==nji2... /гА+1-И

Пример 1. Сколько различных «целых» прямоугольников (т. е. прямоугольников, составленных из целых клеток) имеется на шахматной доске?

Решение. На рисунке 8 изображен один из «целых» прямоугольников. Проектируя его

на указанную на том же рисунке ось Ох, получим «целый» отрезок (т. е. отрезок с целочисленными концами), содержащийся в [О, 8]; аналогично проекция прямоугольника на ось Оу есть «целый» отрезок из [0, 8]. Таким образом, каждому «целому» прямоугольнику отвечает строка (а, Р), где а — «целый» отрезок оси Ох, а р — «целый» отрезок оси Оу, причем каждый из отрезков содержится в [0, 8]. Обратно, любая строка (а, Р), где а и (5 — «целые» отрезки на осях (оба отрезка из [0, 8]), определяет «целый» прямоугольник. Следовательно, «целых» прямоугольников имеется столько же, сколько строк (а, Р) указанного вида. Но по правилу произведения число строк (а, Р) должно равняться N • N, где N есть число «целых» отрезков числовой оси, содержащихся в [0, 8]. Предоставляем читателю проверить, что N = = 84-7 + 6 + 5 + 4 4-34-2+1= 36 (имеется ровно восемь

«целых» отрезков с левым концом 0, семь отрезков с левым концом 1 и т. д.). Следовательно, искомое число «целых» прямоугольников равно 36 • 36 = 1296.А

Пример 2. Сколько различных подмножеств имеет множество А — {at, а2, а„), состоящее из п эле-

ментов?

Решение. Пусть X — подмножество в А, Сопоставим этому подмножеству строку (хь хг, .... хп) длиной п — нечто вроде «шифра» подмножества X. А именно: положим хл равным 1 или 0, смотря по тому, входит или не входит элемент щ в подмножество X; положим х2 равным 1 или 0, смотря по тому, входит или не входит а2 в X, и так далее. В результате каждому подмножеству X будет соответствовать строка длиной п, состоящая из единиц и нулей. И обратно, любая строка длиной п, состоящая из единиц и нулей, однозначно определяет некоторое подмножество X (например, в случае п = 5 строка (0, 0, 0, 1, 1) определяет подмножество X = = {а4, а6}). Но число различных строк по правилу произведения равно 2 -2 •••2 = 2". Значит, число различных подмножеств множества А будет также 2", А

34

Пример 3. Сколько можно составить пятизначных чисел так, чтобы любые две соседние цифры числа были различны?

Решение. Пятизначному числу с цифрами xit xt, х3, х^, х5 можно сопоставить строку (хь х2, х3, х4, х5). При этом выбор цифры Xi возможен 9 способами; если xt выбрана, то для выбора х2 имеется тоже 9 возможностей (хг может быть любой из цифр 0, 1, 2, .... 9, отличной от X(); после выбора xt, х2 для х3 имеется снова 9 возможностей и т. д. Применяя правило произведения, находим, что искомое количество 'чисел есть 9"9-9-9-9 = 95. А

§ 7. РАЗМЕЩЕНИЯ И ПЕРЕСТАНОВКИ

1°. Размещения с повторениями. При использовании правила произведения удобно считать, что элементы xit хг, .... хк, служащие для образования строки

(Х1, х2, .... хЛ),

берутся из одного и того же фиксированного множества X. В этом случае говорят о строках длиной k, составленных из элементов множества X. Например, числа натурального ряда (точнее, их десятичные записи) можно рассматривать как строки, составленные из элементов множества X = {О, I, 2, 9), слова русского языка

суть некоторые строки, составленные из элементов множества X = = {а, б, в, я) (множества букв русского алфавита). Вернувшись к примерам из пункта 2° предыдущего параграфа, читатель может убедиться, что и там мы имели дело со строками, составленными из элементов некоторого множества X (в примере 1 таким множеством было множество «целых» отрезков из [0, 8], в примере 2 — множество {0, 1’}, в примере 3 — множество {0, 1, 2, ..., 9}).

Пусть множество X состоит из п элементов; в дальнейшем такие множества будем иногда называть п-членными. Любая строка длиной k, составленная из элементов множества X, называется размещением с повторениями из п элементов по k. Словосочетание «с повторениями» подчеркивает тот факт, что в строке (хь х2, .... хА), где xlt х2, .... xk принадлежат X, некоторые элементы могут повторяться. Например, слово «папа» есть размещение с повторениями из двух элементов (п и а) по четыре.

Число всех размещений с повторениями из п элементов по k зависит, очевидно, только от л и А (а не от природы множества X). Обозначим это число А*. Из правила произведения следует, что

Ап — п- п •... • п = пк,

k pai

Пример 1. Сколькими способами k пассажиров могут распределиться по п вагонам, если для каждого пассажира существенным является только номер вагона, а не занимаемое им в вагоне место?

Решение. Перенумеруем всех пассажиров (т. е. условимся, кого из них мы считаем первым, кого вторым и т. д.). Пусть Xj — 2* 35

номер вагона, выбранного первым пассажиром, х2 — номер вагона второго пассажира и т. д. Строка (хх, х2, .... хА) полностью характеризует распределение пассажиров по вагонам. Каждое из чисел xt, х2...xk может принимать любое це-

лое значение от 1 до п. Таким образом, различных распределений по вагонам бу-

дет столько, сколько строк длиной k можно составить из элементов множества X — {1, 2, .... п}. Следовательно, их будет

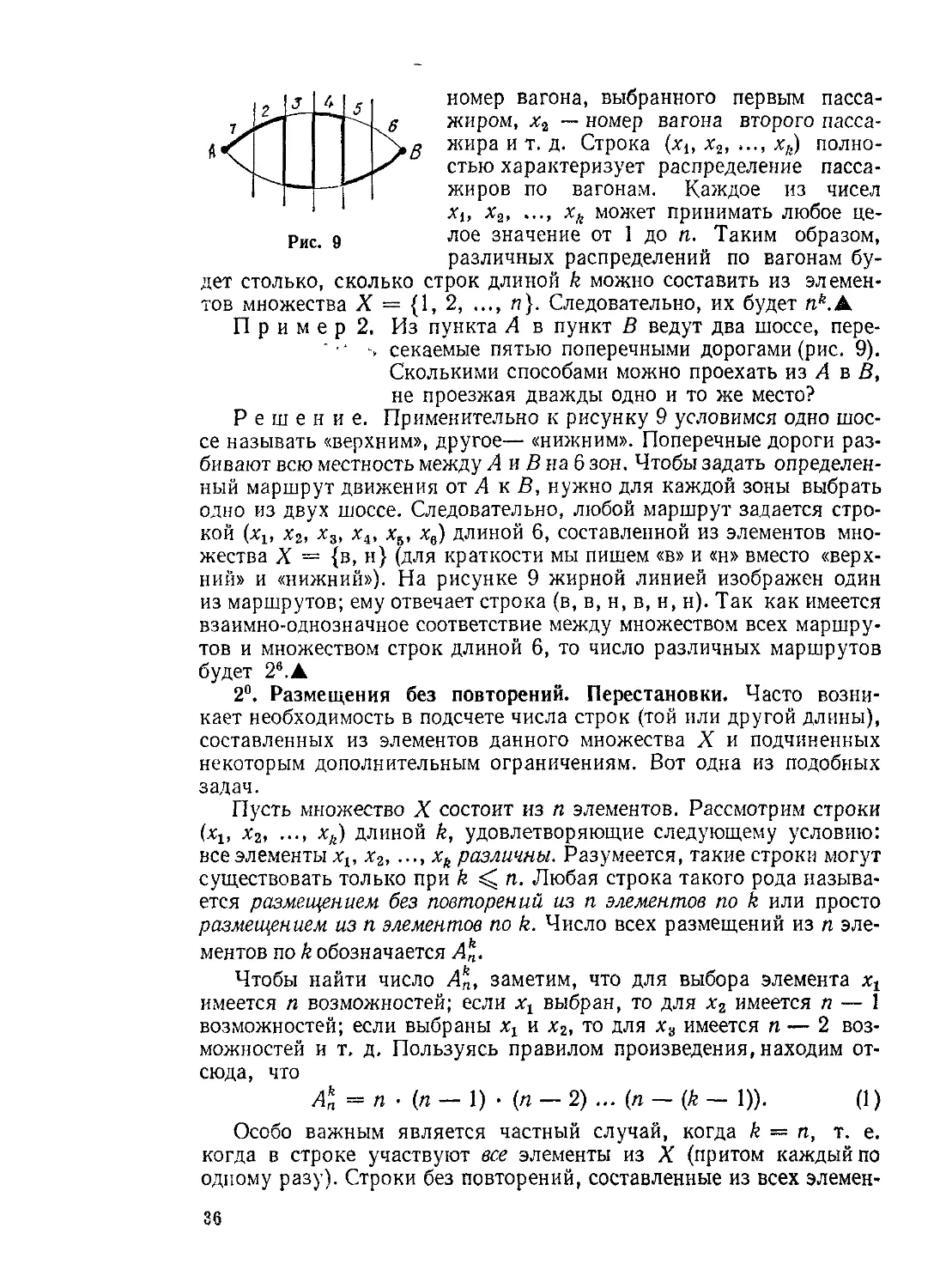

П р и м е р 2, Из пункта А в пункт В ведут два шоссе, пере-' секаемые пятью поперечными дорогами (рис. 9). Сколькими способами можно проехать из А в В,

не проезжая дважды одно и то же место?

Решение. Применительно к рисунку 9 условимся одно шоссе называть «верхним», другое— «нижним». Поперечные дороги разбивают всю местность между А и В на 6 зон. Чтобы задать определенный маршрут движения от Л к В, нужно для каждой зоны выбрать одно из двух шоссе. Следовательно, любой маршрут задается строкой (хх, х2, х3, х4, х5, хв) длиной 6, составленной из элементов множества X = {в, н) (для краткости мы пишем «в» и «н» вместо «верхний» и «нижний»). На рисунке 9 жирной линией изображен один из маршрутов; ему отвечает строка (в, в, н, в, н, н). Так как имеется

взаимно-однозначное соответствие между множеством всех маршрутов и множеством строк длиной 6, то число различных маршрутов будет 26.А

2°. Размещения без повторений. Перестановки. Часто возникает необходимость в подсчете числа строк (той или другой длины), составленных из элементов данного множества X и подчиненных некоторым дополнительным ограничениям. Вот одна из подобных

задач.

Пусть множество X состоит из п элементов. Рассмотрим строки (хх, х2, .... хА) длиной k, удовлетворяющие следующему условию: все элементы хх, х2,.... xk различны. Разумеется, такие строки могут существовать только при k п. Любая строка такого рода называется размещением без повторений из п элементов по k или просто размещением из п элементов по k. Число всех размещений из п элементов по k обозначается А*.

Чтобы найти число заметим, что для выбора элемента хх имеется п возможностей; если хх выбран, то для х2 имеется п — 1 возможностей; если выбраны хх и х2, то для х3 имеется п — 2 возможностей и т. д. Пользуясь правилом произведения, находим отсюда, что

Л*=„. (/:-!). (п-2)... («-(£-!)). (1)

Особо важным является частный случай, когда k = п, т. е. когда в строке участвуют все элементы из X (притом каждый по одному разу). Строки без повторений, составленные из всех элемен

36

тов n-членного множества X, называются, как известно, перестановками из п элементов. Пользуясь формулой (1), находим, что число различных перестановок из п элементов равно:

п • (п — 1) • (п — 2) ... 2 • 1 = п\

Добавим к этому равенство

О! = 1, которое принимают по определению.

§ 8. СОЧЕТАНИЯ. БИНОМ НЬЮТОНА

1°. Числа Скп и их свойства. Пусть X — множество, состоящее из п элементов. Любое подмножество Y множества X, содержащее k элементов, называется сочетанием k элементов из п; при этом, разумеется, k п.

Число различных сочетаний k элементов из п обозначается С„. Одной из важнейших формул комбинаторики является следующая формула для числа С„:

п ~ k\ (п -k)\ '

Ее можно записать после очевидных сокращений следующим образом:

rk __ л (п — 1) (п — 2)... (л — (fe — 1)) П~ k\

В частности,

это вполне согласуется с тем, что в множестве X имеется только одно подмножество из 0 элементов — пустое подмножество.

Приведем доказательство формулы (2). Пусть Y — какое-либо подмножество множества X, содержащее k элементов. Составив всевозможные перестановки из этих элементов, получим kl различных строк длиной k. Если указанную операцию проделать с каждым подмножеством Y, содержащим k элементов, то получим всего С„ • kl различных строк длиной k. Но очевидно, что таким путем должны получиться все без исключения строки длиной k без повторений, которые можно составить из элементов множества X. Поскольку число таких строк равно А*, то имеем соотношение С„-kl =

. k

= An, из которого следует Сп = _2L, т. е. формула (2). И kl

Числа Сп обладают рядом замечательных свойств. Эти свойства в конечном счете выражают различные соотношения между подмножествами данного множества X. Их можно доказывать непосредственно, исходя из формулы (1), но более содержательными являются доказательства, опирающиеся на теоретико-множественные рассуждения.

37

1) Справедлива формула

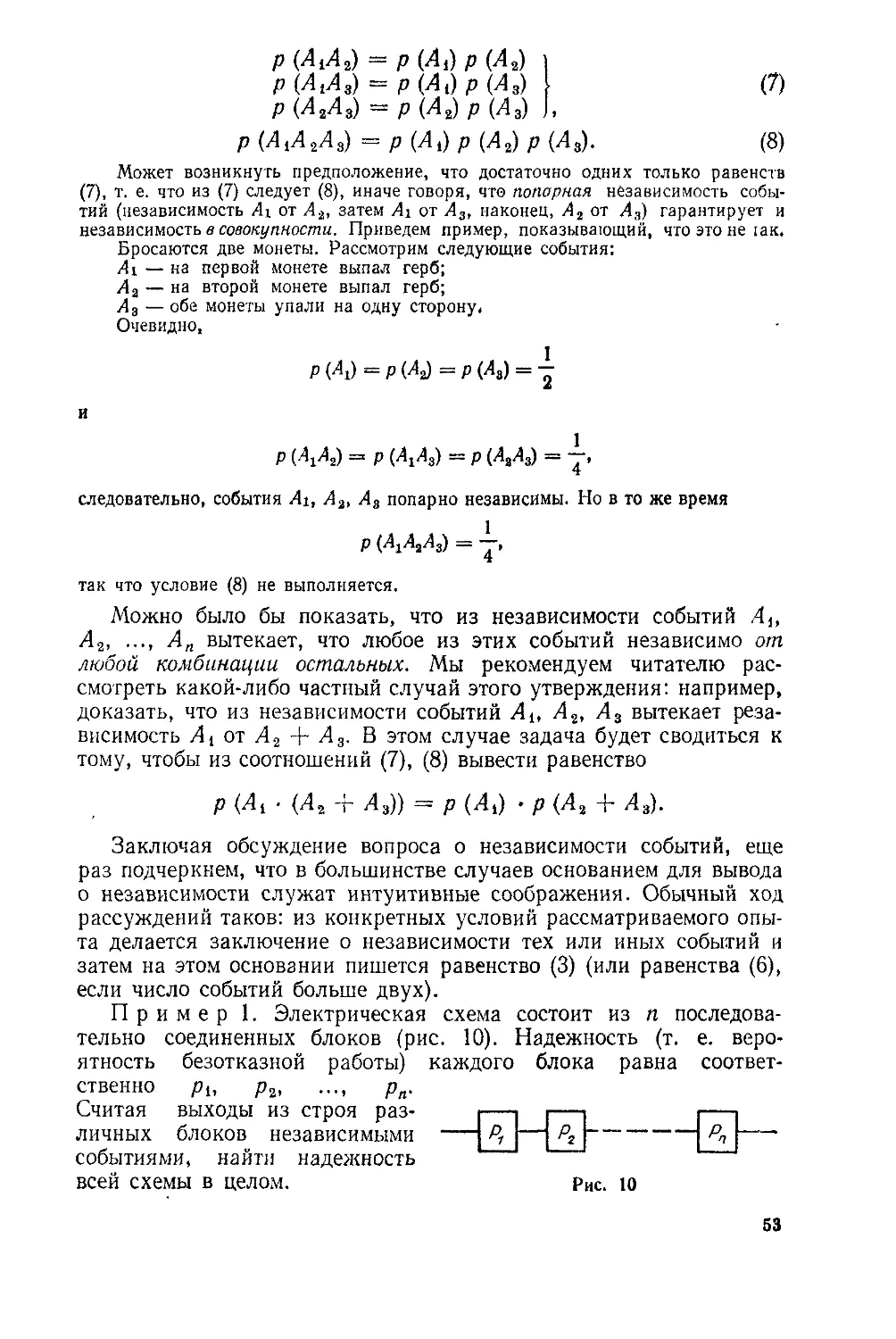

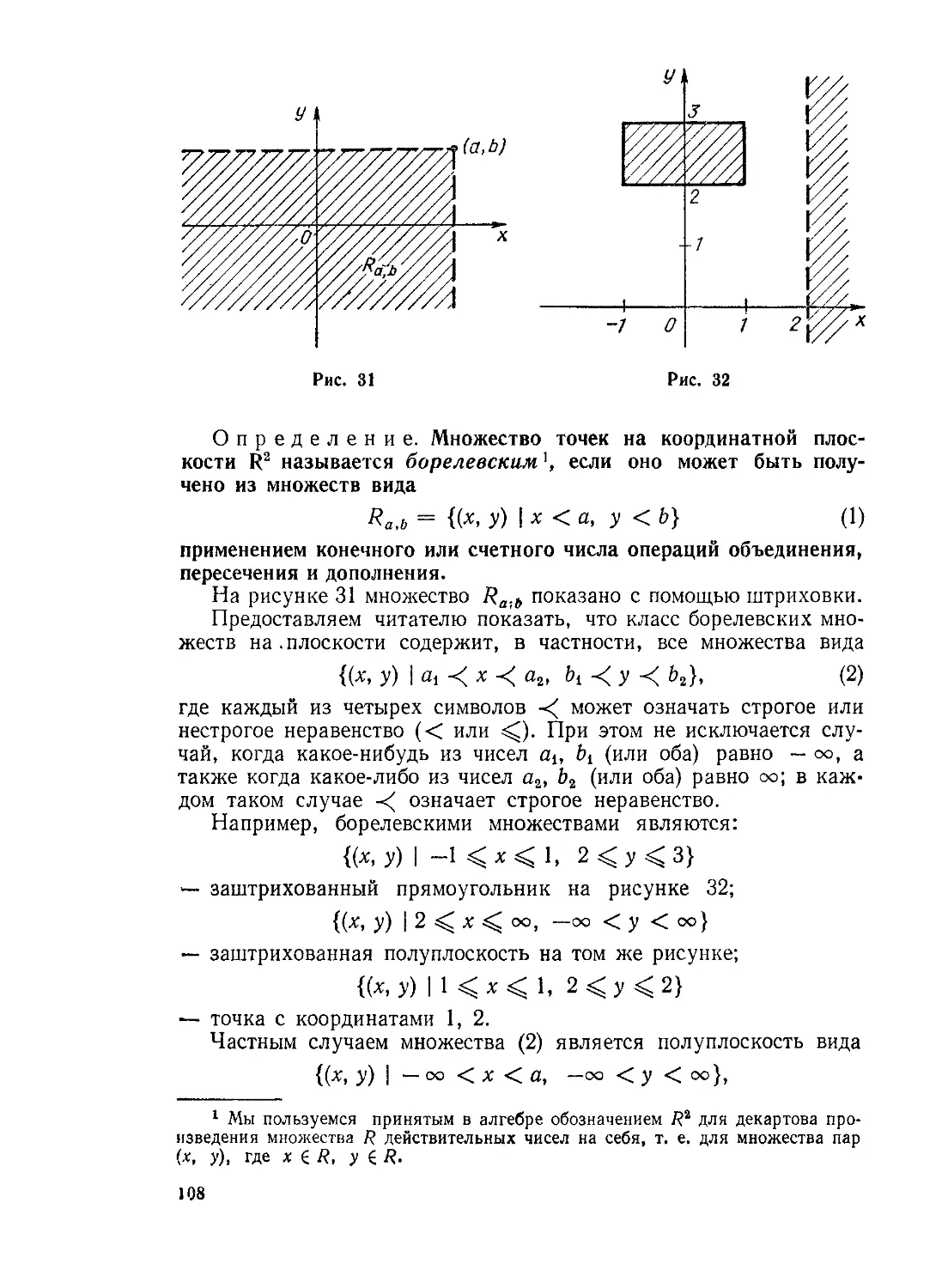

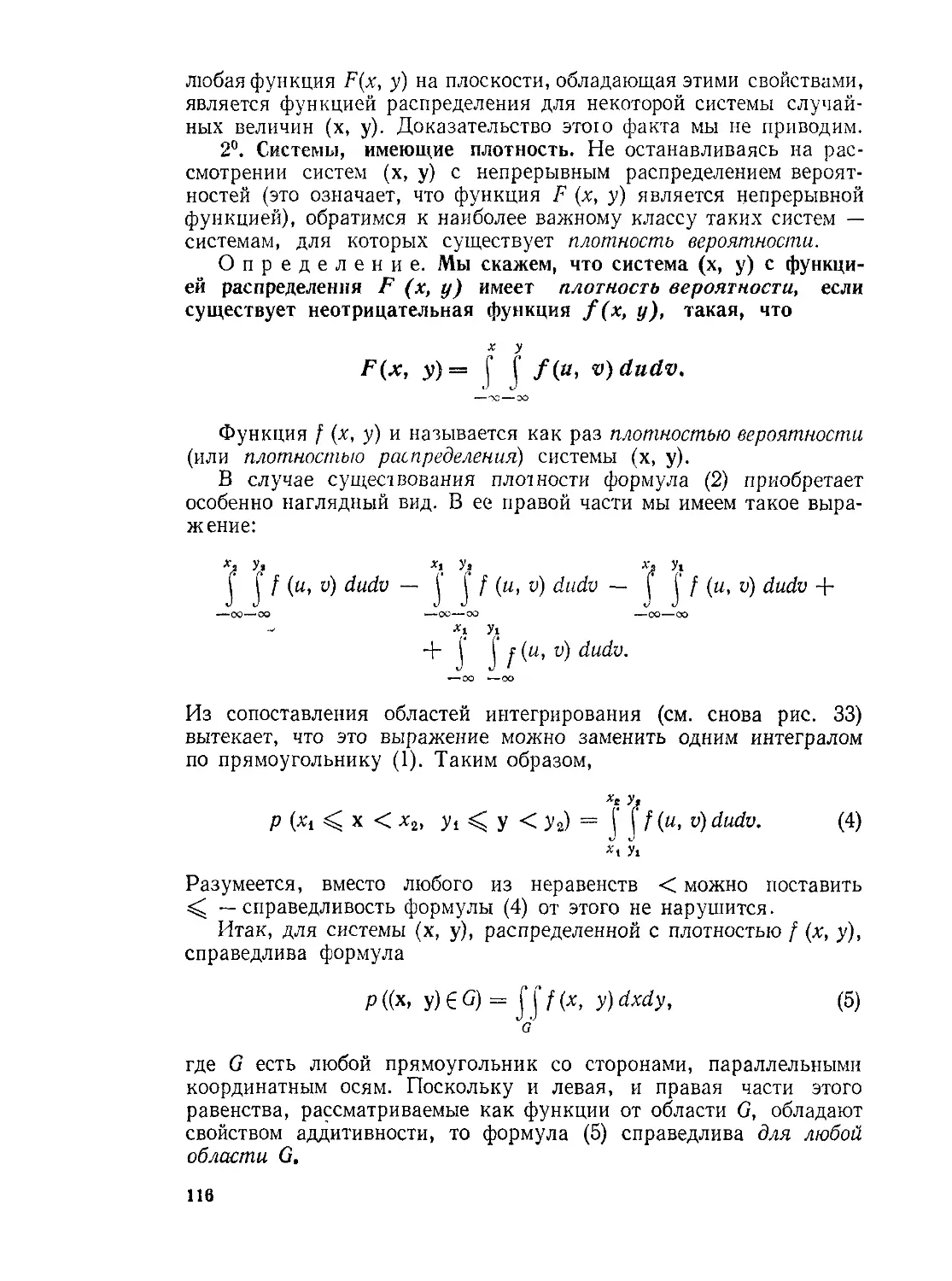

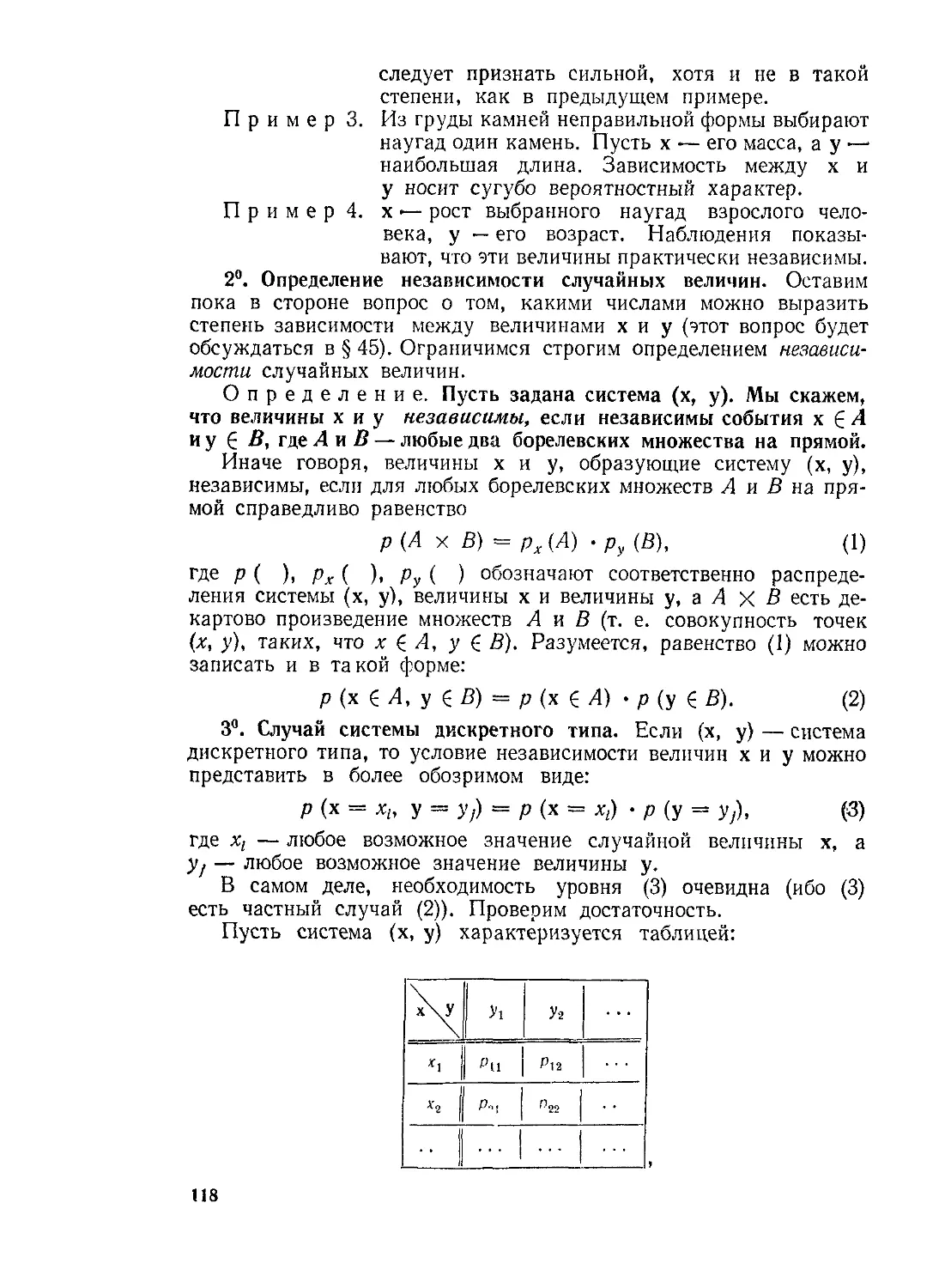

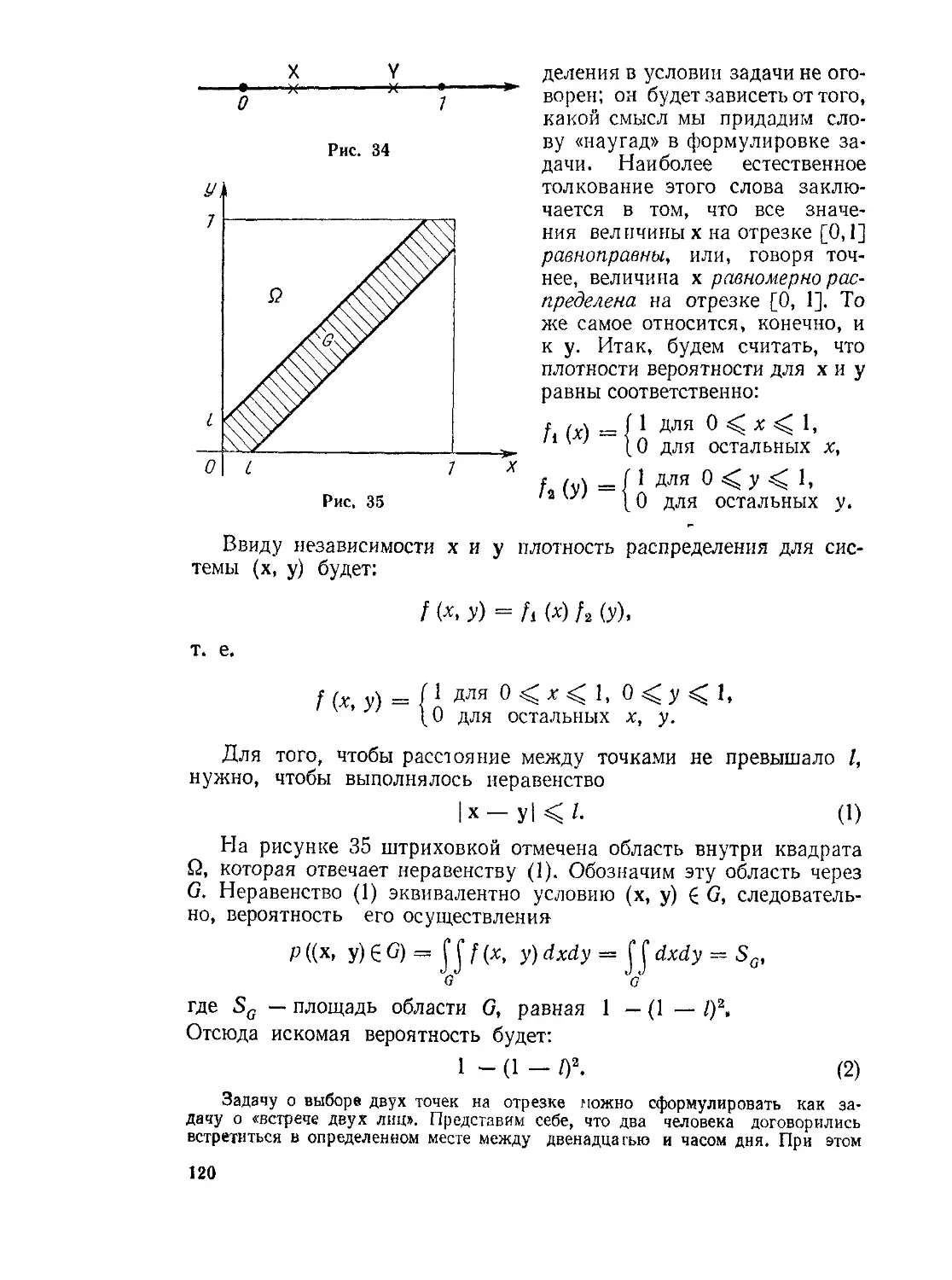

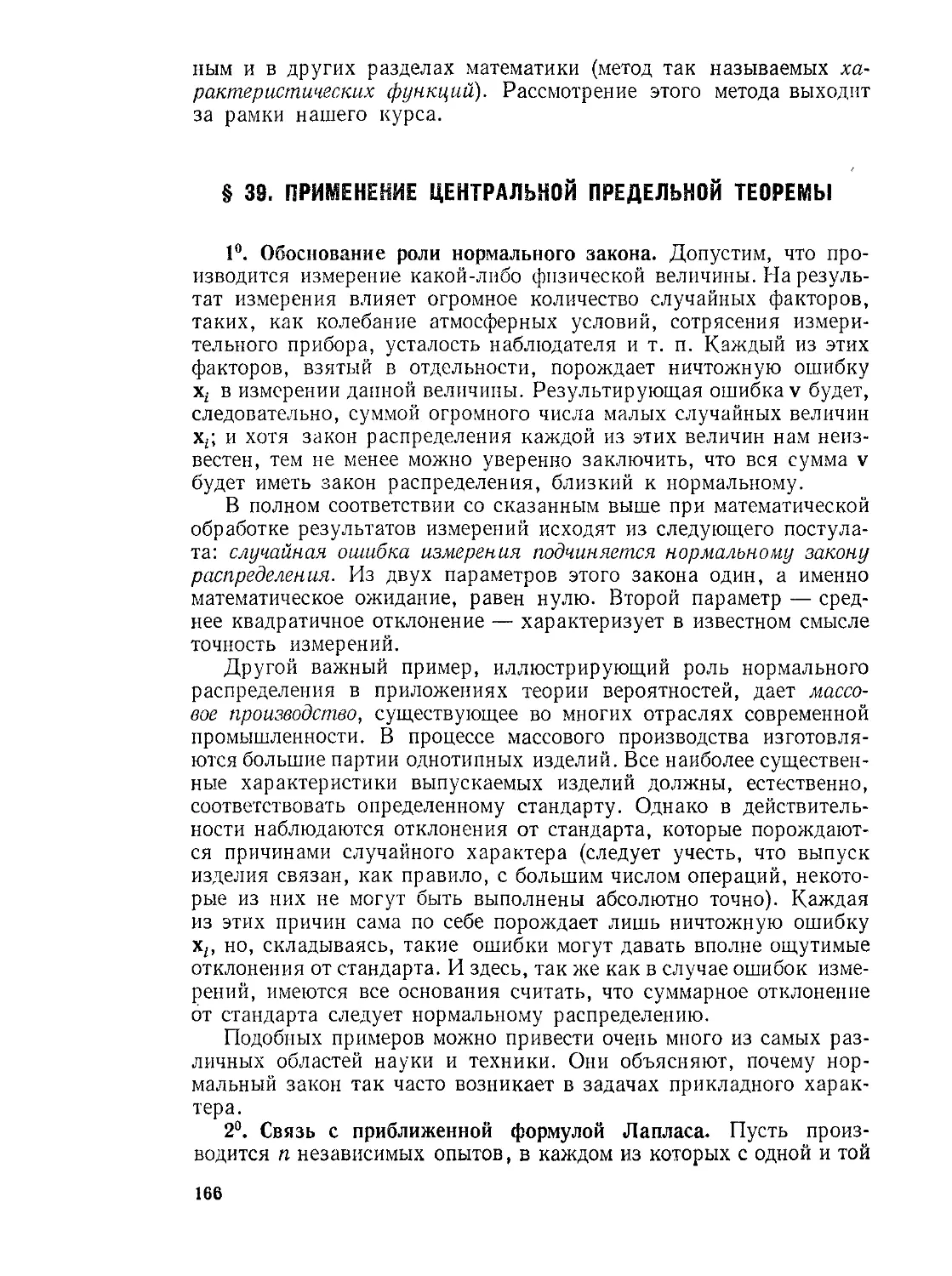

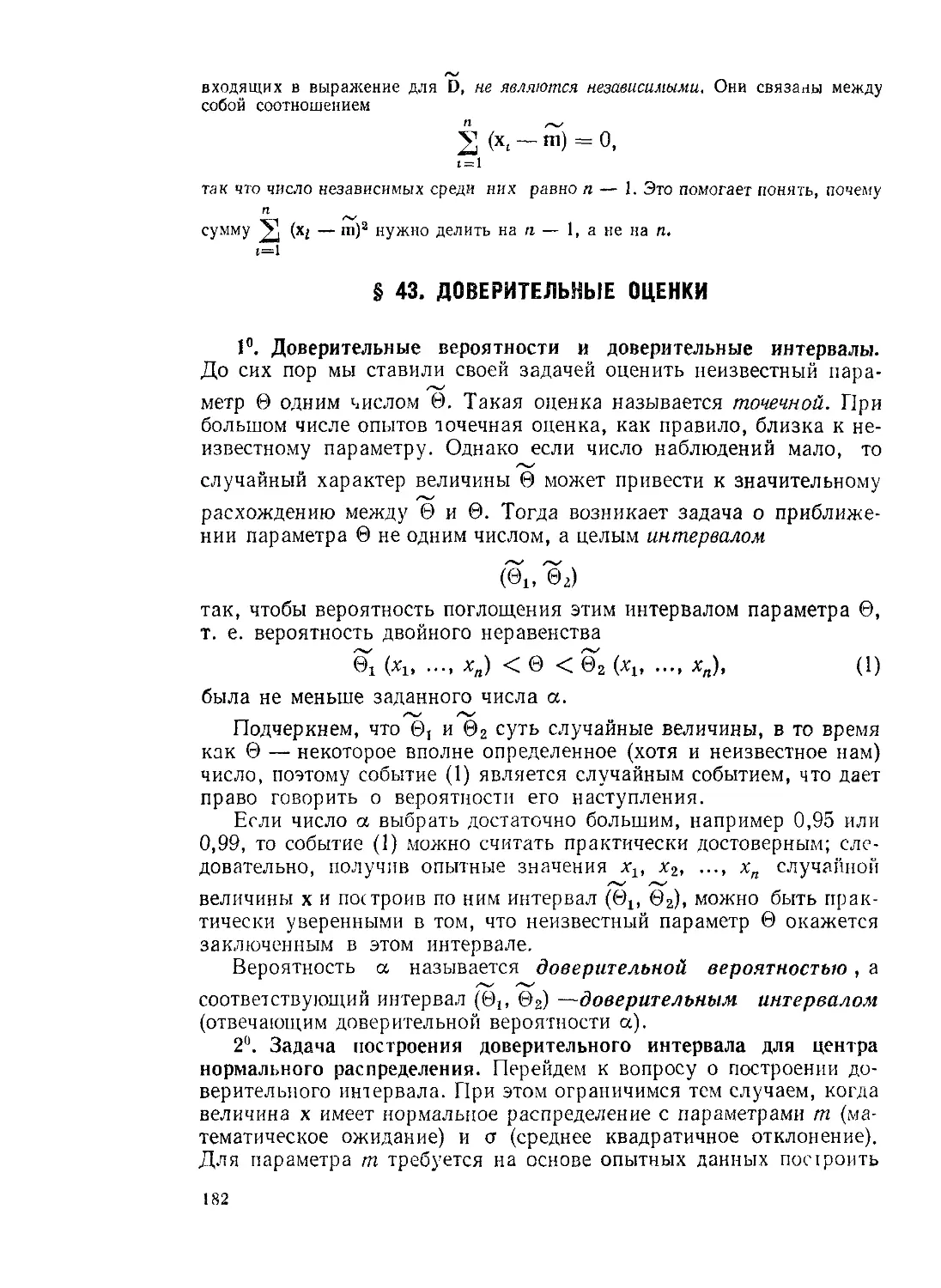

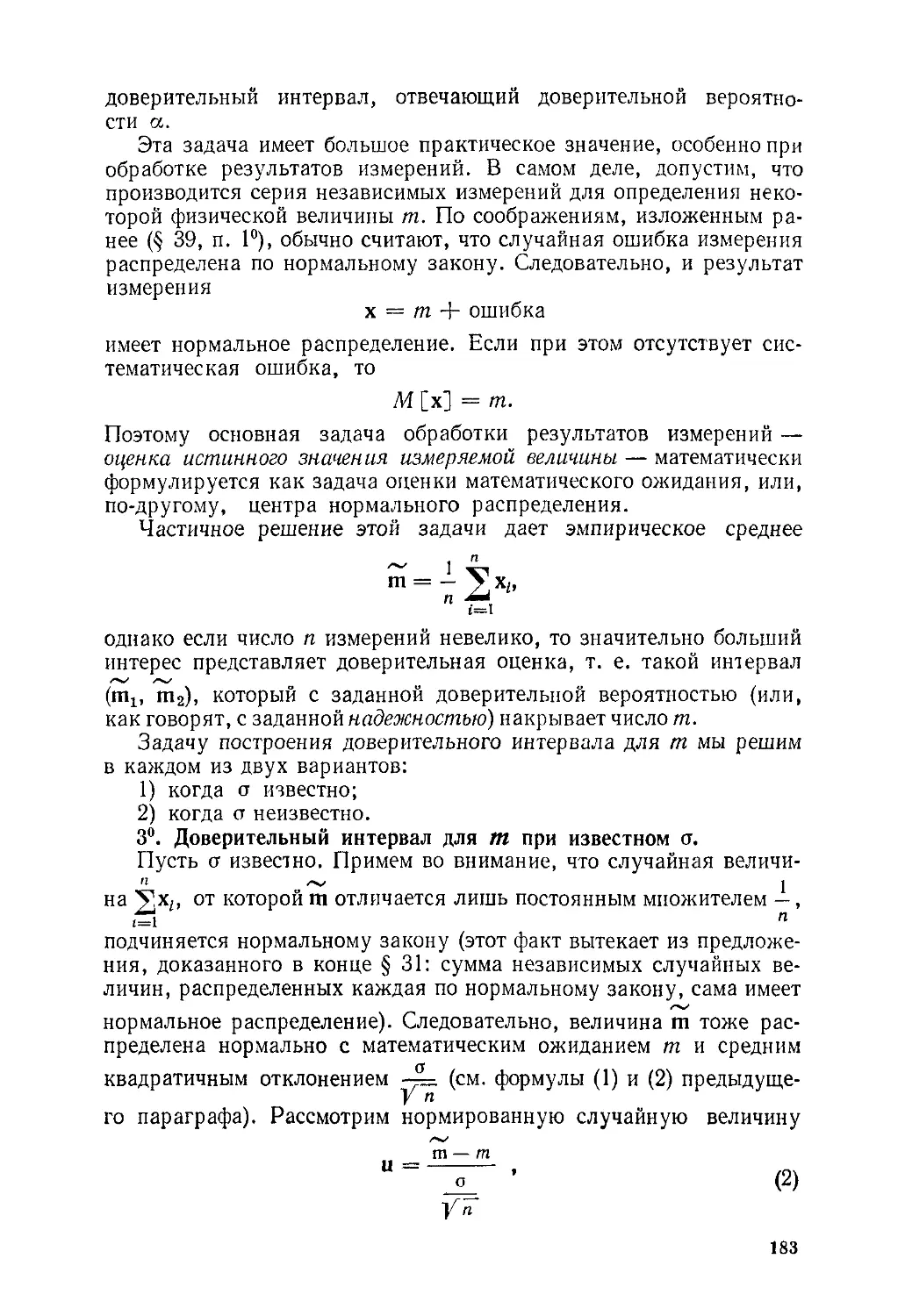

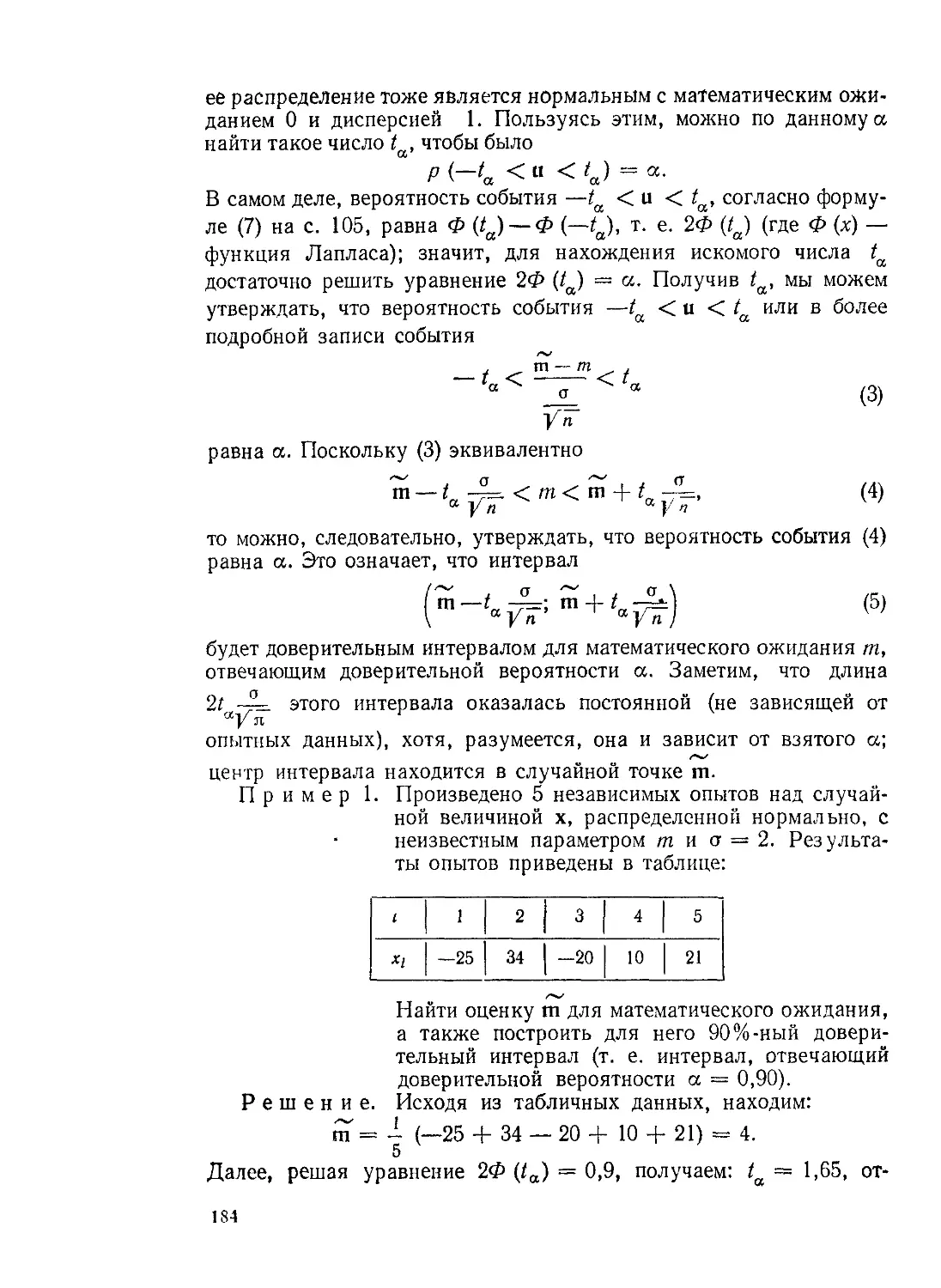

С* = Спп~\ (3)