Text

АКАДЕМИЯ НАУК СССР

Б.А.Березовский

А.В.Гнедин

ЗАДАЧА

НАИЛУЧШЕГО

ВЫБОРА

Издательство * Наука

АКАДЕМИЯ НАУК СССР

МИНИСТЕРСТВО ПРИБОРОСТРОЕНИЯ,

СРЕДСТВ АВТОМАТИЗАЦИИ

И СИСТЕМ УПРАВЛЕНИЯ СССР

ОРДЕНА ЛЕНИНА ИНСТИТУТ ПРОБЛЕМ УПРАВЛЕНИЯ

Б. А. Березовский, А. В. Гнедин

ЗАДАЧА

НАИЛУЧШЕГО

ВЫБОРА

Ответственный редактор

доктор технических наук

Э. А. ТРАХТЕНГЕРЦ

ИЗДАТЕЛЬСТВО «НАУКА»

МОСКВА 1984

ВВЕДЕНИЕ

За последние двадцать лет в рамках статистической теории

решений сформировался круг задач, получивших название задач

наилучшего выбора. Интерес к этим задачам возник по двум

причинам. Во-первых, они отражают некоторые существенные

особенности реальных процессов выбора и, во-вторых, всегда имеют

содержательную постановку и легко интерпретируемые решения.

Старая истина гласит, что самый лучший способ описания

какого-нибудь нового класса заключается в указании его наиболее

типичного представителя. Таким представителем в нашем случае

является классическая задача наилучшего выбора. Приведем ее

формулировку.

Предположим, что имеется N вариантов, сравниваемых между

собой по какому-то критерию, из которых требуется выбрать

всего один вариант. Ознакомление с вариантами происходит в

случайном порядке, а на процесс выбора наложены следующие

ограничения: в каждый момент может быть выбран только

непосредственно наблюдаемый вариант, и ничего не известно о качестве

последующих вариантов. Требуется так остановить процесс

выбора, чтобы выбранный вариант с максимальной вероятностью

оказался наилучшим1.

Решение задачи хорошо известно: требуется пропустить

примерно N/e вариантов, а затем остановиться на первом же варианте,

который окажется лучше abex гввои:£ -предшественников, а если

такого варианта нет, то фыбрать последний вариант. При этом

вероятность выбора наилучшего варианта при больших N равна

примерно 0,37.

Эта задача является самой простой, тем не менее она имеет

все характерные черты задач наилучшего выбора:

выбор осуществляется в несколько этапов, т. е. происходит во

времени;

на процесс выбора наложены стратегические и информационные

ограничения, связанные с полной или частичной недоступностью

для выбора пропущенных вариантов и статистической

неопределенностью качества будущих вариантов;

эффект выбора зависит только от сравнения выбранных

вариантов со всеми остальными вариантами, из которых выбор в

принципе можно было бы сделать и, быть может, от некоторых

факторов, внешних по отношению к сравнениям вариантов (например,

от затрат на проведение наблюдений);

эффект выбора тем выше, чем лучше выбранные варианты.

Таким образом, в задачах наилучшего выбора за основу

берется сравнение вариантов, и даже если сравнение производится пу-

3

тем измерения или числовой оценки, то оценка отдельно взятого

варианта, безотносительно к оценкам других вариантов, никакой

роли не играет. Иначе говоря, про вариант нельзя сказать, хорош

он или плох, но можно сравнить его с другими вариантами, т. е.

качество выступает только как сравнительное качество. Именно

этот «ординализм» и выделяет задачи наилучшего выбора из

остальных задач последовательного анализа. С формальной точки

зрения сказанное означает, что если под наблюдением

понимается число (интерпретируемое как оценка качества очередного

варианта), то критерий эффективности стратегий выбора должен быть

инвариантен относительно изменения масштаба на числовой шкале.

В настоящей книге рассматриваются задачи наилучшего

выбора, в которых требуется выбрать всего один вариант, и выбор

может быть сделан только с одной попытки (за исключением п. 2.6,

в котором этих попыток несколько). Под способом выбора

понимается правило остановки, т. е. определенное предписание,

которое на каждом этапе по результатам проведенных наблюдений

указывает, следует выбрать очередной вариант или же следует

перейти к следующему варианту, если такая возможность имеется.

Эффект выбора определяется исключительно результатами

сравнения выбранного варианта со всеми остальными и выражается

через способ описания предпочтений на множестве вариантов.

«Чистая» зависимость эффекта выбора от сравнений делает легко

сопоставимыми различные задачи.

Основная схема, принятая в книге, следующая.

Пусть Аг, . . ., An — последовательность вариантов,

рассматриваемая как случайная выборка из некоторого глобального

множества SK. Предполагается, что на 31 задана структура

предпочтений, т. е. задан определенный способ упорядочения вариантов

по качеству. Если Аг = а1? . . ., Αν = &ν, то эффект выбора

варианта On из множества {а1? . . ., ajv} всех наблюденных вариантов

полагается равным q (a^ {αϊ, . . ., αχ}), причем функция q (·, ·)

зависит только от сравнения вариантов между собой. Далее,

предполагается заданным некоторый класс 3R правил остановки τ,

т. е. случайных величин, принимающих значения η = 1, . . ., N

таких, что значение τ = η определяется результатами

наблюдений, приведенных к моменту появления Ап. Под событием {τ =

= η) понимается выбор варианта Ап, а математическое ожидание

Mq(Ax, {Аи . . ., AN})

интерпретируется как средний выигрыш правила τ. Требуется

максимизировать средний выигрыш по классу 3R, т. е. указать

такое правило остановки τΝ, что

Mq(A_Ni {Аи . . ., AN}) = sup Mq(AXi {Аъ . . ., AN}),

и найти значение vN этого супремума.

Чтобы полностью конкретизировать задачу наилучшего

выбора, остается указать, что такое структура предпочтений, каков

4

явный вид функции выигрыша q (·, ·) и, наконец, о каком классе

991 идет речь. Если варианты Л1? . . ., An можно линейно

упорядочить по качеству, то вся информация о сравнениях

вариантов исчерпывается последовательностью Хг, . . ., XN абсолютных

рангов, где Хп есть ранг Ап среди A х, . . ., An (лучшим вариантам

отвечают меньшие ранги). Исходное предположение о зависимости

эффекта выбора исключительно от сравнений вариантов приводит

к тому, что

q(Any {А1ч . . ., An}) = q (Хп),

т. е. эффект выбора зависит только от абсолютного ранга

выбранного варианта. Если считать число вариантов N случайным, или

же параметром задачи, то в общем случае следует ввести также

зависимость эффекта выбора от N. Однако введение такой

зависимости, равно как и введение платы за наблюдения, делает совершенно

несопоставимыми различные задачи и при этом теряется

наглядность среднего выигрыша как некоторой величины, выраженной

через сравнения.

Коротко изложим содержание книги.

Гл. 1 носит вспомогательный характер.

В п. 1.1 приводятся стандартные сведения об измеримости и

интеграле Лебега.

В п. 1.2 содержится постановка задачи оптимальной остановки

процессов с дискретным временем. Наиболее пристальное

внимание здесь следует обратить на метод обратной индукции,

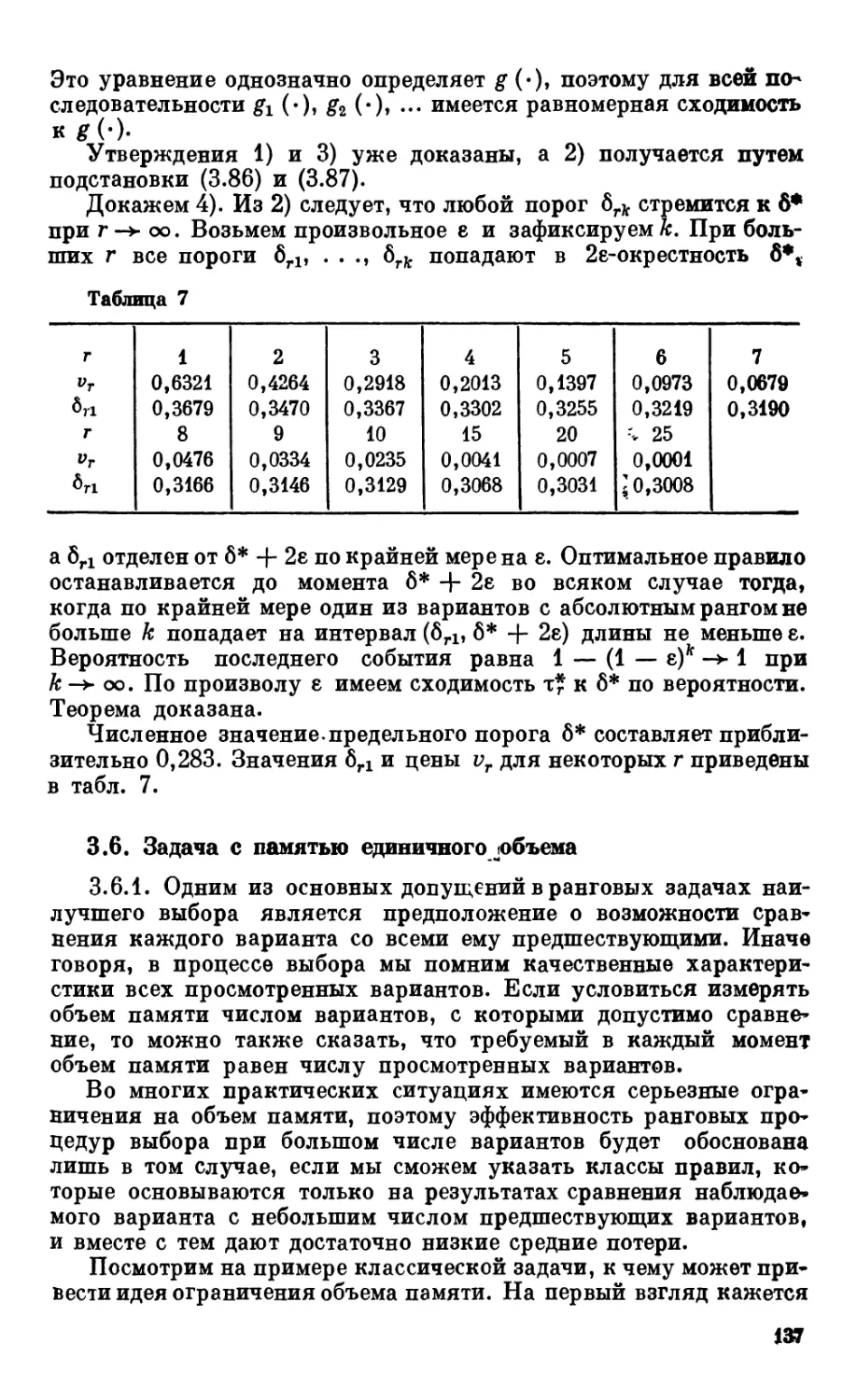

позволяющий в случае конечного числа наблюдений конструктивно

находить оптимальное правило, а также на так называемый

монотонный случай.

В п. 1.3 изложены элементы теории оптимальной остановки

марковских цепей. Важную роль в дальнейшем играет случай

независимых наблюдений и теорема 1.11 о возможности исключения

из рассмотрения рандомизированных правил остановки

(приводимая без доказательства).

Второстепенное значение имеет теория, излагаемая в п. 1.4,

ее выводы используются только в п. 2.6.

В гл. 2 рассматривается самая простая функция выигрыша:

q (Хп) равно 1, если Хп = 1 и равно 0 во всех остальных

случаях. Таким образом, все множество вариантов Аг, . . ., An

разбивается на два уровня качества —- первый уровень состоит из

единственного варианта с единичным абсолютным рангом

(называемого наилучшим), а второй уровень состоит из всех остальных

вариантов. Средний выигрыш Mq (Xx) в этом случае равен

вероятности остановки на наилучшем варианте.

В п. 2.1 рассматривается классическая задача. Классом 3R

здесь является совокупность правил остановки, основанных на

наблюдении относительных рангов Yly . . ., Yn, где Yn есть ранг

Ап среди Аъ . . ., Ап, η = 1, . . ., N. Оптимальным оказывается

правило τΝ, которое предписывает пропустить А1ч . . ., -4d*-ir

а затем остановиться на первом же относительно лучшем варианте

5

Ап, т. е. таком, что Yn = 1. Правила такого типа называются

пороговыми, их эффективность в задачах наилучшего выбора

обусловлена самой природой этих задач и связана с простым принципом

монотонности: ожидаемое качество относительно лучших

вариантов неуклонно возрастает во времени (назовем его первым

принципом монотонности). Второй принцип монотонности выражается

в том, что νΝ монотонно убывает, доказательство его обычно

связано с различными способами «вложения» задачи с меньшим

числом вариантов в задачу с большим числом вариантов и

использованием теоремы 1.11 (о рандомизации). Содержательно второй

принцип монотонности означает, что из большего числа вариантов

наилучший вариант выбрать труднее, нежели из меньшего их числа,

даже при использовании оптимального правила.

Сразу же оговоримся, что термин «задача» будет пониматься

достаточно вольно — это не только предмет изучения, но и

некоторый набор формальных объектов, с которыми можно

производить какие-то операции (например, «вкладывать» одну задачу

в другую).

В п. 2.2 рассматривается задача, в которой число вариантов N

случайно, а наблюдению опять-таки подлежат только

относительные ранги. Эта задача дает пример, в котором нарушаются все

принципы, присущие задачам наилучшего выбора, в частности,

оба принципа монотонности. Оптимальное правило может уже

не быть пороговым, т. е. множество номеров п, на которых

следует останавливаться при появлении относительно лучших

вариантов может не иметь вид {d*, . . ., Ν), как в классической

задаче, а состоять из нескольких «островов». Эффект появления

островов объясняется чрезвычайно просто. Предположим, что нам

известно, что N с большой вероятностью принимает значение 100,

и с очень малой дополнительной вероятностью — значение 1000.

Тогда начав процесс выбора, мы «почти» находимся в условиях

классической задачи и пропускаем примерно 100/^^^ 37 вариантов

с целью остановиться до Αί00 на относительно лучшем варианте.

Если же среди Лз7, . . ., А100 не оказалось относительно лучшего

варианта, а N = 1000, то в момент η = 100 мы опять находимся

в условиях классической задачи и, следовательно, должны

пропустить А юн . · ., -4 370· Тем не менее, если дисперсия N не очень

велика, то класс пороговых правил является асимптотически

оптимальным, когда N велико.

В п. 2.3 изучается задача, в которой наблюдения

относительных рангов производятся в моменты скачков пуассоновского

процесса. Оптимальное правило выглядит намного сложнее, нежели

в классической задаче, но когда среднее число наблюдений

бесконечно увеличивается, то все равно асимптотически

оптимальным является некоторое пороговое правило, а вероятность

остановки на наилучшем варианте стремится к е-1, как и в

классической задаче.

В п. 2.4 рассматривается задача с полной информацией, в

которой за исходный класс 5К берутся правила, основанные на

6

наблюдении независимых одинаково распределенных случайных

величин ί/χ, . . ., t/jv, интерпретируемых как оценки качества

вариантов А и . . ., An. Функция распределения оценок F

предполагается известной. Непрерывность F гарантирует возможность

линейного упорядочения вариантов по величине их оценок.

Задача наилучшего выбора, таким образом, ставится как задача

максимизации вероятности события {U = шах (£/г . . ., Un)}·

Оптимальное правило оказывается таким: нужно остановиться

на первом же относительном максимуме Un = max (£/х, . . ., ί/Λ),

для которого F (Un) > i/n-п, где ук = 1 — с/к + о (1/Л). Оба

принципа монотонности остаются в силе, и vN -*0,58 ... при

N -*оо.

В п. 2.5 рассматривается пуассоновский вариант задачи с

полной информацией. Асимптотически эта задача эквивалентна

предыдущей, но здесь удается получить аналитическое выражение

оптимальной вероятности остановки на наилучшем варианте

как функции от среднего числа скачков. Первый принцип

монотонности остается в силе, а второй нарушается.

Предмет п. 2.6 составляет задача, в которой наблюдаются

относительные ранги, а в качестве способов выбора рассматриваются

наборы правил остановки, т. е. выбор можно производить

несколько раз. Асимптотическое решение определяется системой

дифференциальных уравнений. И в этом случае оптимальным

оказывается набор пороговых правил. Оба принципа монотонности

сохраняются.

В п. 2.7 изучаются сразу две задачи. Предполагается, что

наблюдаются оценки иг, . . ., Un вариантов, но их распределение

неизвестно. Под правилом остановки понимается функция τ (ux, . . .

. . ., un) такая, что значение τ = η зависит только от иг, . . ., ип.

Первая постановка — байесовская, распределение Fq

предполагается равномерным на (О, Θ), а неизвестный параметр — имеющим

одностороннее распределение Парето. За максимизируемый

критерий берется вероятность события {Ux = max (h0, £/х, . . ., J7jv)}

(h0 -— нижняя грань носителя распределения Парето).

Оказывается, что байесовским правилом является пороговое правило, но

порог смещен по отношению к порогу из классической задачи.

Вторая постановка — минимаксная в том же классе

распределений Fq. С помощью принципа инвариантности задача сводится

к изложенной выше байесовской постановке путем перехода

к проективным координатам. Здесь доказывается, что пороговое

правило из классической задачи является минимаксным, и дается

объяснение смещению порога в байесовской задаче. Таким

образом, недостаток сведений о распределении оценок делает

бесполезным наблюдение собственно оценок по сравнению с наблюдением

относительных рангов. Оптимальное правило из задачи с полной

информацией оказывается чувствительным к незнанию одного-

единственного параметра.

В гл.З имеется полное единообразие постановок, но сложность

задач значительно увеличивается. За исходное берется предполо-

7

жение о том, что функция q (Хп) имеет общий вид, т. е. это

произвольная монотонная последовательность q (1), q (2), .... Здесь

q (·) интерпретируется как потери, чтобы иметь возможность

рассматривать неограниченные q('), считая при этом что все значения

одного знака. Таким образом, q (·) не убывает, и задача ставится

как задача минимизации средних потерь Mq (Xx) по классу

правил ЗЙ, основанных на наблюдении относительных рангов

У1? . . ., Υν·

В п. 3.1 показано, что оптимальное правило τΝ задано набором

порогов (cff, . . ., (In), эти пороги не убывают по нижнему индексу,

а оптимальное правило выглядит т-ак: пропустить Аи . . ., AdN.f

затем выбрать первый вариант Ап из Aan, . . ·,Ααν , еслиУп =

= 1; а если такого нет, то следует выбрать первый Ап из Α ν, · · ·

. . ., А г* у если Уп ^ 2, и т. д. Второй принцип монотонности

д3-1

выражается в возрастании минимальных средних потерь ι;Ν,

а первый принцип остается верен на каждом уровне качества,

определяемом фиксированным значением относительных рангов.

В п. 3.2 изучается предельная форма задач наилучшего

выбора, число вариантов здесь бесконечно, а моменты наблюдения

вариантов с фиксированным значением относительного ранга

образуют неоднородный пуассоновский процесс интенсивности l/t

на единичном интервале. Оптимальное правило существует всегда,

если минимальные средние потери ν конечны, и задано набором

порогов (6Ь δ2, . . .).

В п. 3.3 исследуется связь между задачей с конечным числом

вариантов и ее предельной формой. Путем введения ряда

промежуточных моделей доказывается, что νΝ '\ ν и c$/N —> δΛ.

В п. 3.4 находятся условия, при которых ν < оо, и при которых

и = оо. Оказывается, что для всех функций потерь

полиномиального роста ν < оо.

В п. 3.5 исследуется задача, в которой максимизируется

вероятность остановки на варианте, имеющем абсолютный ранг не выше г.

Пороговые правила остановки вида «пропустить фиксированную

часть вариантов, а затем остановиться на первом же варианте,

имеющем относительный ранг не выше г», оценивают

(асимптотически по Ν) вероятность успеха величиной (1/г)1^г~1> ~

~ 1 — (In r)/r, однако истинный порядок сходимости этой

вероятности к 1 при оптимальном правиле является

экспоненциальным.

В п. 3.6 рассматривается задача, в которой имеются очень

сильные ограничения на возможности сравнения вариантов.

Предполагается, что в каждый момент разрешается помнить только

один вариант, и очередной вариант можно сравнивать только

с находящимся в памяти. Задача сильно усложняется

невозможностью использования обратной индукции из-за необходимости

управления памятью. Несмотря на это, при любой полиномиаль-

В

ной функции потерь можно указать последовательность правил,

для которых средние потери остаются конечными, когда N —» оо.

В гл. 4 рассматриваются задачи, в которых структура

предпочтений на глобальном множестве вариантов 3( не описывается

линейным упорядочением.

Предположим, что варианты Αλ, . . ., An могут быть

упорядочены по нескольким, скажем т, независимым критериям, т. е.

каждому Ап отвечает w-компонентный вектор Хп абсолютных

рангов среди Аг, . . ., An и вектор Yn относительно рангов среди

Аг, . . ., Ап. Таким образом, на множестве {Аг, . . ., An}

возникает естественное частичное упорядочение: один вариант лучше

другого, если он лучше по всем т критериям. Пусть q (Xn) —

монотонная функция потерь, a 3R — класс правил остановки,

основанных на наблюдении Y1? . . ., Υ^.

В п. 4.1—4.3 изучается задача минимизации Mq (Χτ).

В п. 4.1 показано, что оптимальное правило задается частично

упорядоченным набором порогов. Первый принцип монотонности

проявляется на каждом уровне качества, отвечающем

фиксированному значению вектора относительных рангов. Второй

принцип сохраняется без изменений.

В п. 4.2 изучается предельная форма задачи из предыдущего

параграфа и устанавливается ее связь с этой задачей. Аналогия

между предельной и допредельной задачами оказывается

значительно менее полной, нежели в задачах предыдущей главы.

Основная трудность состоит в невозможности вложения одной

задачи в другую, что связано с различными формами несравнимости

вариантов. Дело в том, что при переходе к пределу наблюдается

качественный скачок: мы наблюдаем не одну большую

совокупность, сравниваемую по т критериям, а т больших групп

вариантов. Внутри каждой группы сравнение производится по

своему критерию, а эффект выбора определяется функцией потерь вида

ql(i) = q(oo, . . ., ί, оо . . .). Варианты из различных групп между

собой несравнимы. На содержательном уровне подобное

«расслоение вариантов» означает, что вероятность существования варианта,

хотя бы пара абсолютных рангов которого остается

ограниченной при 7V —> оо, бесконечно мала, поэтому в каждой группе

варианты имеют только один небольшой ранг, а все остальные ранги

бесконечно велики.

В пп. 4.4—4.6 рассматривается задача максимизации

вероятности остановки на лучшем варианте, сформулированная в

терминах функций выбора. Пусть С — функция выбора на SI, т. е.

отображение, которое ставит в соответствие любому набору

(аь . . ., ап) е 9tn множество С {аъ . . ., ап) С {аь . . ., ап}

лучших среди а1? . . ., а^ вариантов, η = 1,2, ... . Для каждого

правила τ, основанного на наблюдении Αχ, Л2, · · ·» Ανι число

Ρ {4τΕ С {Аъ . . ., An}} есть вероятность остановки на лучшем

варианте. Пороговое правило %а есть предписание «пропустить

9

Аг, . . ., Ad-ъ а затем остановиться на первом же относительно

лучшем Ап, т. е. таком, что ΑηΕΞ С {Аг, . . ., Ап}».

В п. 4.4. показано, что в задаче остановки на лучшем по Па-

рето варианте класс пороговых правил дает сколь угодно близкую

к 1 вероятность остановки на лучшем варианте, когда 7V —> оо.

Второй принцип монотонности, очевидно, нарушается.

В п. 4.5 выделен класс функций выбора, для которых

пороговые правила дают нижнюю оценку вероятности успеха, равную

(l/r)1^1*"1), где г — число лучших вариантов.

В п. 4.6 рассматривается задача остановки на максимальном

йо некоторому частичному порядку варианте, т. е. когда С —

графодоминантная функция выбора. Используя аналоги правил

из п. 2.4, опять получается оценка (l/r)1/^-1), но г уже может

принимать нецелые значения.

Авторам приятно выразить благодарность за помощь и

поддержку Э. А. Трахтенгерцу, Ю. М. Барышникову, А. Е. Гнединой и

Е. Ю. Добровой.

10

Глава 1

ЗАДАЧА ОПТИМАЛЬНОЙ ОСТАНОВКИ

1.1. Предварительные сведения из теории вероятностей

1.1.1 Система подмножеств множества Ω называется

σ-алгеброй, если она содержит пустое множество φ и замкнута

относительно взятия дополнения и объединения ее членов в не более чем

счетном числе. Ясно, что система всех подмножеств Ω образует

σ-алгебру; это же верно и для системы, состоящей из φ и Ω.

Для любой системы А подмножеств Ω пересечение всех

содержащих Λ σ-алгебр является наименьшей σ-алгеброй, содержа^

щей А, Это пересечение называется о-алгеброй, порожденной А-

и обозначается 33 (<А). Если Λ есть система всех интервалов

расширенной действительной прямой R = [—оо, оо], то 3d (А)

называется σ-алгеброй борелевских множеств и обозначается 3d.

Множество Ω с выделенной на нем σ-алгеброй подмножеств $

называется измеримым пространством (Ω, §).

Пусть (Ω, F) и (Е, Ш) — два измеримых пространства.

Функция X = Χ (со), определенная на Ω и принимающая значения в Е$

называется $7#-измеримой, если прообраз X""1 (А) принадлежит

f для любого Α ΕΞ Ш. В теории вероятностей такие функции

называются случайными элементами. Если Ε = R и $ = 3d, то

#7<9-измеримые функции называются случайными величинами

(часто говорят о f -измеримых случайных величинах).

Случайные величины, определенные на пространстве (R, 3d),

называются борелевскими функциями. Если {Xt, tE=T) — семейство

случайных величин, то наименьшая σ-алгебра, по отношению к

которой все случайные величины Xt, t ΕΞ Τ измеримы, обозначается

3d (Xf, t ΕΞ Τ) и называется σ-алгеброй, порожденной семейством

{Хи »ε Τ).

Неотрицательная действительная функция Ρ (А),

определенная на σ-алгебре f измеримого пространства (Ω, W)y называется

вероятностной мерой (вероятностью), если Ρ (Ω) = 1 и

Ρ(0λ,)=Σρ(4)

n=l nc=i

для любых Ап е #", п = 1, 2,. . ., таких, что Ап f) Ат = фя

η Φ т. Совокупность трех объектов (Ω, §, Ρ) называется

вероятностным пространством. Точки ше!2 часто называют

элементарными событиями, а множества 4 изГ- событиями.

а

Конечное семейство {$ГЪ . . ., ψк) под-σ-алгебр F называется

Независимым, если Ρ (Аг (~) · · · Π Ак) = Ρ (Аг) . . . Ρ (Лк)

для любого набора Аг^ fu ... Л^ е FV Произвольное се-

мейство под-а-алгебр {&t, t £Ξ Γ} является независимым, если

любое его конечное подсемейство независимо. Семейство

случайных величин {Xty t ΕΞ Τ} называется независимым, если семейство

под-а-алгебр {33 (X*), iGf} является независимым. Аналогично,

случайная величина X называется независимой от под-а-алгебры

$, если S (X) и S независимы.

1.1.2. Пусть (Ω, f, Ρ) — вероятностное пространство и

X = χ (со) — неотрицательная случайная величина.

Математическое ожидание (обозначаемое MX) есть интеграл Лебега j XdP,

Ω

по определению равный

п2П

lim (2 k2-*V {£2-n < Χ < (k -f 1) 2~η} + Ρ {Χ > η})

(где {...} обозначает «множество всех точек ω из Ω таких, что...»).

Для произвольной, не обязательно неотрицательной,

случайной величины X математическое ожидание определяется только

в том случае, когда одно из математических ожиданий МХ+ или

МХ~ конечно (здесь Х+ = max (X, 0), X" == — min (X, 0)), и

полагается равным MX = МХ+ — MX". Случайная величина X

называется интегрируемой, если Μ | X | = МХ+ + MX" <C оо.

Для Μ (1аХ)у где Ια = Ια (ω) (другое обозначение — J (A))

есть функция-индикатор события А, равная 1 при оЕ4 и0

при ω ΕΞ Л" = Ω \ А, часто используется обозначение ^ XdP.

А

В случае, когда случайная величина X дискретна, т. е.

принимает конечное или счетное число значений хъ х2, . . . с

вероятностями рг, р2, . . ., из определения интеграла Лебега легко

получается формула

оо

мх= S*fr/v

В общем же случае математическое ожидание выражается как

интеграл Лебега — Стилтьеса

оо

МХ= J xdFx(x),

—оо

где Fx (χ) = Ρ {Χ < χ} — функция распределения случайной

величины X. Можно также показать, что для любой борелевской

функции / (х)

оо

Mf(X)= \f(x)dFx(x). (1.1)

12

Перечислим основные свойства математических ожиданий:

1) MX > 0, если X > 0;

2) если существует MX, то для любого числа с существует

Μ (сХ) и Μ (сХ) = сМХ;

3) если X и У интегрируемы, то Μ (X -f Y) = MX + MY;

4) Ml = 1;

5) если MX существует, то | MX| <! Μ | X |;

6) если X >0 и MX = 0, то X = 0 (п.н.) *;

7) если Х и У интегрируемые независимые случайные

величины, то М| ΧΥ |< оо и Μ (ΧΥ) = МХМУ.

1.1.3. Напомним виды сходимости случайных величин и

основные теоремы о предельном переходе под знаком

математического ожидания.

Последовательность случайных величин Хь Х2, . . . сходится

почти наверное к случайной величине X (обозначается Хп —*> X),

если Р{ХП->Х} = 1.

Последовательность случайных величин Хь Х2, . . . сходится

ρ

по вероятности к случайной величине X (обозначается Хп —> X),

если для любого е>0Р{ [Хп — X |> ε} -> 0, и —> оо.

Последовательность случайных величин Хх, Х2, . . . сходится

по распределению к случайной величине X (обозначается Хп —> X),

если для любой ограниченной непрерывной функции / (х)

М/ (Хп) -* М/ (X), п-^оо.

Из формулой (1.1) следует, что это эквивалентно сходимости

оо оо

5 f(x)dFZn(x)-+ $ f(x)dFx(x),

—оо —00

называемой в анализе слабой сходимостью функций распределения

(слабая сходимость, в свою очередь, эквивалентна сходимости

Fx (χ) к Fx (x) в каждой точке непрерывности Fx (x)). Поскольку

сходимость по распределению случайных величин определяется

только в терминах их функций распределения, то этот вид

сходимости имеет смысл и тогда, когда случайные величины определены

на разных вероятностных пространствах.

Следует отметить, что из сходимости почти наверное вытекает

сходимость по вероятности, а из сходимости по вероятности

вытекает сходимость по распределению.

Будем писать Хп f X, если Хп -* X и Хп <^ Хп+1 (п.н.).

Аналогично определяется сходимость Хп | X.

Теорема 1.1. (о монотонной сходимости). Если Хп\ X

и MXf < оо, то МХП | MX. Аналогично, если Хп | X и МХХ <

< оо, то МХп I MX.

Назовем последовательность случайных величин Хг, Х2, . . ·

Почти наверное (п.н.) означает, что соответствующее соотношение

выполняется с вероятностью 1.

13

равномерно интегрируемой, если

limsup $ |Χη|α7Ρ = 0.

о-со η {|ζη|>α}

Теорема 1.2. (лемма Фату). Если последовательность

Χη, η = 1, 2, . . . равномерно интегрируема и существует

Μ (limnsup Хп), то Μ (Нп^ sup Xn) > lin^ sup МХП*.

Теорема 1.3. Пусть 0 < Хп —► X u МХП < оо. Гог5а

МХП —> MX <х β толе и только в том случае, если

последовательность Хх, Х2, ... равномерно интегрируема.

Теорема 1.4 (Лебега о мажорируемой сходимости). Пусть

ρ

Хп —> X и существует такая интегрируемая случайная величина

У,что | Хп |< У, п = 1,2, .... ГогдаМ | Х|< оо и Μ (Хп -X)-*

«-►О, и—» оо.

1.1.4. Пусть $ —под- σ-алгебра f, X — неотрицательная

случайная величина. Условным математическим ожиданием X

относительно & (обозначается Μ (Χ \ &)) называется

^-измеримая случайная величина такая, что для любого 4GS

$XdP = $M(X|$)dP.

А А

Существование и единственность (с точностью до значений на

множестве нулевой вероятности) условного математического ожидания

вытекают из известной теоремы Радона—Никодима.

ЕслиХ — произвольная случайная величина, для которой MX

существует, то условное математическое ожидание определяется

формулой

Μ(Χ|ί§) = Μ(Χ+|$)-Μ(Χ-|$).

В том случае, когда X = 1А — индикатор события А,

условное математическое ожидание Μ (Ια \ $) обозначается Ρ (Α \ &)

и называется условной вероятностью события А относительно $.

Функция Ρ (ω, А), определенная для всех ©ЕЙи^Е?,

называется регулярной условной вероятностью относительно $,

если:

1) для каждого о)ЕЙР(о), ·) есть вероятностная мера на f\

2) для каждого Α ΕΞ f функция Ρ (·, А) является

^-измеримой и Ρ (ω, А) = Ρ (А | Щ (п.н.).

Существование такой функции означает, что условные

математические ожидания могут быть найдены как интегралы по

условным вероятностям, а именно:

Μ (X | &) (ω) = J X (ω') Ρ (ω, dco') (π. η.).

Ω

* Через limnsup Xn обозначается верхний предел последовательности

Хи Х2» · · ·» т· е· *п* SUP Хщ· Аналогично, нижний предел limninf Xn

η rri^n

есть sup inf Xm.

η rri^n

14

Положим Μ (Χ Ι У) = Μ (Χ | 33 (У)). Можно показать, что

всегда найдется такая борелевская функция / (у), для которой

Μ (X | У) = / (У) (п.н.), т. е. Μ (X | Г) есть функция от Υ. Это

обстоятельство позволяет определить математическое ожидание

Μ (X | Υ = у) при условии, что Υ принимает фиксированное

значение у, полагая Μ (Χ \ Υ = у) = / (у). Пусть пара (X, У)

имеет плотность распределения /χγ (#> ϊ/)» τ· е· Для любого боре-

левского множества на плоскости

Р{(Х, Y)<=B} = yxY(x, y)dxdy

в

и ίχ\γ {х | у) — плотность условного распределения

вероятностей:

А , . ч ifx\Y% y)\fy(y)i если /у (ι/)> О,

/w(*U)=|o, если /г(у)-О,

где /у (ι/) — плотность распределения У. Тогда

оо

М(Х|У=у)=$ */х|у(*| */)<**·

—оо

Перечислим основные свойства условных математических

ожиданий, предполагая при этом, что математические ожидания

рассматриваемых случайных величин существуют и $ С «F*.

1) Μ (X | S) > 0, если X > 0;

2) Μ (1 | &) = 1;

3) |М(Х|Э) |<М(|Х ||9);

4) Μ (αΧ + bY \&) = аМ(Х \&) + Ш (У | 9), если

сумма аМХ + ЬМУ не является неопределенностью вида +оо — с»;

5) если Х& -измерима, то Μ (X | $) = X;

6) если X не зависит от 9, то Μ (X | %}) = MX;

7) если &± с #„ то Μ (М (X | »,) I 2?ι) = Μ (Χ | &г);

8) если &г ID 38, то Μ (Μ (Χ | S.) Ι 9г) = Μ (Χ | Э,);

9) если Χ и ХУ интегрируемы и У5? -измерима, то Μ (ХУ |5?) =

= УМ (X | &).

Все приведенные соотношения справедливы почти наверное.

Теоремы 1.1-1.4 остаются верными, если в их формулировках

математические ожидания заменить на условные математические

ожидания.

Важную роль в статистике играет следующее свойство

условных математических ожиданийг известное как обобщенная

теорема Байеса. Пусть θ — случайная величина такая, что условные

вероятности Ρ {Β | θ = а} являются регулярными и допускают

представление

Ρ{£|θ=α} = $ρ(ω, α) άλ

в

где ρ (ωλ α) — неотрицательная измеримая по обеим переменным

15

функция, а λ есть σ-конечная мера * на (Ω, $). Если Μ | g (θ) | <

< оо, то

оо ос

Μ (g (θ) 18) = [ 5 g (α) ρ (ω, α) dFe (α)]/[ ξ ρ (ω, a) dFe (a)].

1.2. Задача оптимальной остановки

1.2.1. Пусть (Ω, <F, P) — некоторое вероятностное

пространство, f χ С f2 С . . . — неубывающая последовательность под-σ-

алгебр <?\ и Хх, Х2, ... — последовательность случайных

величин таких, что Хп измеримы относительно fn, η = 1, 2,. ...

Пара последовательностей {Хп1 $ίη}? называется стохастической

последовательностью. Будем интерпретировать fn как

совокупность событий, которые могут быть наблюдены к моменту /г, а Хп —

как выигрыш, который мы получаем при прекращении

наблюдений в момент п. Правилом остановки называется случайная

величина τ со значениями 1,2,. . ., оо такая, что τ < оо с вероятностью

1 и {τ = η} ΕΞ <Fn для любого п = 1, 2,. . .. Случайная величина

~ ГХП, если τ = /г, η = 1, 2, . . .,

Χχ с== ^J Хп* {τ=η} = (л

ι£ίι 10, если τ=οο

представляет собой выигрыш, который мы получаем при

прекращении наблюдений в случайный момент τ, а математическое

ожидание ΜΧτ (если оно существует) трактуется как средний выигрыш,

соответствующий правилу остановки τ. Цена ν стохастической

последовательности { Хп, fn}T определяется как sup MXT, где

супремум берется по множеству всех правил остановки, для

которых это математическое ожидание существует. Задача

оптимальной остановки состоит в нахождении оптимального правила

остановки, для которого средний выигрыш равен v.

Задачу оптимальной остановки часто рассматривают

относительно некоторого подкласса 91 всех правил остановки, значение

супремума supMXt называется ценой класса 3Ϊ и обозначается

ι; (Я).

В случае произвольной стохастической последовательности

может вообще не существовать ни одного правила остановки, для

которого определен средний выигрыш. Мы ограничимся

рассмотрением лишь тех стохастических последовательностей, для

которых Μ (sup Хп) < оо, тогда МХХ существует для любого

правила остановки. Смысл указанного условия заключается в том,

что даже если мы имеем возможность производить наблюдения

сколь угодно долго и затем выбирать любое из значений Хъ

Х2, . . .в качестве выигрыша, то все равно наш средний выигрыш

не будет бесконечно большим.

* Мера называется σ-конечной, если пространство допускает разбиение на

не более чем счетное число подмножеств, мера каждого из которых конечна.

16

В большинстве конкретных постановок задач оптимальной

остановки имеется некоторая основная последовательность

случайных величин Υχ, Υ2, ... с известным совместным pacnpefleflemieMt

значения которой интерпретируются как результаты наблюдений,

и выигрыш от прекращения наблюдений на /г-м шаге является

функцией уже проведенных наблюдений, т. е. Хп = Хп (ΥΊ, . . .

. . ., Уп). В этом случае fn = 33 (Уχ, . . ., Уп) и условие

измеримости {τ = η} Ε= § η в точности означает, что решение о

прекращении наблюдений на п-м шаге должно зависеть только от уже

известных значений Уь . . ., Уп и не зависеть от будущих значений

Поясним сказанное. Нетрудно видеть, что случайная величина

τ измерима относительно о-алгебры §<* = 33 (У1э У2, . . .),

поэтому всякое правило остановки можно рассматривать как

функцию τ (у1у у2У . . .), определенную на пространстве бесконечных

последовательностей (уъ у2, . . .). Из условия измеримости

{τ = η} е 53 (Ух, . . ., Уп) следует, что если τ (ylf j/2> ; · ·) = л

для некоторой последовательности (ι/ι, ι/2, . . .)» а (ί/ι> ί/2ΐ · · ·) —

Другая последовательность, для которой ук = ук при А = 1,. . .

. . ., п, то τ (ι/ί, ι/2' . . .) = w. Разумеется, верно и обратное —

любой функции τ (у1? г/2, . . .), принимающей конечные значения

η = 1, 2,. . . и обладающей указанным свойством, можно

поставить в соответствие правило остановки τ = τ (Ух, У2, . . .).

Таким образом раскрывается двоякий смысл понятия «правило

остановки»: во-первых, это есть некоторая процедура, т. е. соответствие

между результатами наблюдений и предпринимаемыми

действиями, и, во-вторых, это есть случайное число наблюдение

проводимых согласно этой процедуре.

Излагаемые далее общие результаты не зависят от конкретного

строения σ-алгебр 3Fn, однако случай $п = 3d (Ух, . . ., Уп)

полезно иметь ввиду.

1.2.2. Пусть ЗЙП обозначает совокупность всех правил

остановки таких, что τ ]> η, η = 1,2,. . .. Очевидно,, что 9Κχ ZD $R2 Z)

Ζ) · · .*» поэтому ν = ι;χ ^ ν2 > . . ., где ρη = ν (9Κη).

Положим *

yn = esssupM(Xx\fn).

Наглядный смысл γη очевиден — это максимальный средний

выигрыш, который может быть получен после момента η при условии

уже проведенных наблюдений.

С точки зрения общей идеологии динамического программиро-

вания особого внимания заслуживает случайная величина

* Пусть {X/, t е Т) — семейство случайных величин, заданных на одном

вероятностном пространстве. Существенным супремумом ess sup Xt этого

семейства называется такая случайная величина У, что У ^ Xt (п.н.)

для каждого t е Т, и если Ζ > Xt (п.н.) для каждого t, то Ζ > У (п.н.).

Существенный супремум всегда существует и У = sup Xt для

некоторого счетного подмножества {tj, if, . . .} С Г.

17

τ* = min {η \ Χη = γη} (в определениях правил остановки

бесконечной стохастической последовательности мы полагаем min φ =

= оо). Вообще говоря, τ* может принимать значение оо с

положительной вероятностью, (условия {τ* = η} е= fn> n = 1, 2,. . .

всегда выполняются), но если все-таки τ* является правилом

остановки, то оно является подозрительным на оптимальность,

поскольку предписывает остановку лишь в тех ситуациях, когда это

дает наибольший возможный выигрыш. Как мы увидим далее, если

τ* <С ©о (п.н.), то .это правило оптимально; в противном случае

оптимального правила остановки не существует *.

Основная идея последующих рассуждений такова: если нам

удастся найти последовательность правил остановки хк таких,

что МХХ]е ->■ ν и хк -> τ*, то переход к пределу MXTfc -*· ΜΧτ» под

знаком математического ожидания и докажет оптимальность τ*,

если только τ* окажется правилом остановки. Оптимальность

τ* при этом естественно связывается с одновременной

оптимальностью в классах ЗЛЛ правил остановки хп = min {к^ η \ Хк = ук}.

Назовем правило остановки τ £= 9Rn п-регулярным, если

Μ (Χτ I f^ > Xjt на множестве {τ > к} для всех к ;> п. Иначе

говоря, если и-регулярное правило в момент к ;> η предписывает

продолжение наблюдений, то общий средний выигрыш

обязательно уменьшается за счет остановки. Напротив, если правило из

класса 3Rn не является и-регулярным, то с положительной

вероятностью на одном из шагов к = и, η + 1, . · . оно

предписывает продолжение наблюдений, хотя остановка могла бы

увеличить средний выигрыш. Из следующей леммы будет следовать, что

в классе 3Rn можно ограничиться рассмотрением только и-регу-

лярных правил.

Лемма 1.1. Для любого правила остановки τ £= 9Rn

найдется η-регулярное правило остановки χ' <^ τ такое, что Μ (Χτ> \ fn) ;>

> Μ (X, |f η).

Доказательство. Пусть τ £= SKn, положим τ' =

= min {k ;> η Ι Μ (Χτ \ fk) < %*}- На множестве {τ = к) имеем

равенство Μ (Χτ | #\) = Χ&, поэтому τ' <^ к. Следовательно,

τ' <ζ τ. Для любого к > η и А €= fk

— J Xxd¥.

Поскольку А произвольно, то при к = η получаем Μ (Х%> I fn) >

^ Μ (Xx | fn). Далее, на множестве {τ' > /с} Μ (Хг | ^л) >

^ Μ (Xt j ^]t) > Xfr, что доказывает и-регулярность τ'. Лемма

доказана.

• Пусть, например, Хп = 1 — 1/п, тогда уп = 1 и τ* = оо какими бы ни были

<Fn, η = 1,2,. . .. Легко видеть, что ν = 1, но оптимального правила

остановки не существует.

18

Пусть теперь τι, τ2, ... — такая последовательность правил

остановки из класса 9Rn, что MXXjc -► vn, и τί, τ2, . . . —

последовательность определенных леммой 1.1 /г-регулярных правил.

Тогда

МХЧ = Μ (М (Хч | fn)) < Μ (Μ (Х^ I fn)) = ΜΧτν

Следовательно, sup MX > > vn, а поскольку строгое неравен-

ство невозможно, то этот супремум равен νη. Таким образом,

сужение 3Rn до класса /г-регулярных правил остановки не уменьшает

цены.

Из следующей леммы следует, что класс /г-регулярных правил

замкнут относительно операции взятия максимума конечного

числа правил и что эта операция не уменьшает средний выигрыш.

Лемма 1.2. Пусть правила остановки τ± и τ2 п-регулярны,

тогда правило τ = max (tx, τ2) также η-регулярно и

M(Xx\fn)^M(X4\fn), i = i, 2.

Доказательство. Очевидно, что τ е 9R„· Для любого

к > η и ieii

ΑΓΗτι>*} i=fc Αη{τι=ί<τ} ΑΠ{τι=ί=τ}

οο

> Σ ( S Xi№ + $ XidP) = J X*dP.

*«k ΛΠ{τι=ί<τ} ΑΠ(τι=-ί=τ} АП{ъ>к)

При /с = /г по произволу А получаем Μ (Χτ \ fn) > Μ (Χτι \fn).

В силу симметрии между τχ и τ2 последнее неравенство верно и

для τ2.

Заметим, что {τ > /с} = {τ! > /с} (J {τ2 > 1с} и на множестве

{τ* ^> к} в силу произвольности Л

М (X, | ?„) > Μ (Xt. I f») > Xk, i = 1, 2,

что доказывает /г-регулярность τ. Лемма доказана.

Из следующей леммы тривиально следует, что в классе 9Rn

можно ограничиться рассмотрением правил остановки, не

превосходящих τ*.

Лемма 1.3. Пусть τ €Ξ 9Rn wt'= min (τ, τ*). Тогда

Μ (Χχ. Ι ^η) > Μ (Χ, I f η).

Доказательство. По определению существенного

супремума (см. сноску в п. 1.2.2.) Μ (Хх \ fn) ^ γη (п.н.) для

любого τ ΕΞ ®ϊη· Следовательно, для любого iEfn

оо оо

S xT*dp=S S x^p=S S w*p>

ΑΠ(τί<τ} λ·=ηΛη{τ*=Λ<τ} *=ηΛΠ{τ*=λ<τ>

19

k=n ΑΠ {t£-fr<%} ΑΠ {τ* < τ}

Отсюда получаем

$Xrd P= J Χ^Ρ + J Χτ*<Ζ P>5 Χτ<Ζ Ρ

* АП<Х<«ф АП(т>*| П А

и, следовательно, Μ (Xr | $Fn) ^ Μ (Χτ | ^η). Лемма доказана.

Мы подходим к основному месту в нашем построении. Из

свойств существенного супремума вытекает, что существует такая

последовательность хк ΕΞ 3Rn» А; = 1, 2, ..., что уп = sup Μ (Χτ \ fn).

к κ

В силу леммы 1.3 мы можем считать, что τλ ^ τ*. Лемма 1.1

позволяет считать правила тк и-регулярными. Положим тпк =

= max (Τχ, . . ., tfr). Последовательность τη1, τη2, . . . при

каждом фиксированном η не убывает, и по лемме 1.2 имеет место

монотонная сходимость Μ (Χτ I fn) I γη. Далее мы будем

считать правила остановки τηΛ с указанными свойствами заданными.

Первое важное следствие состоит в том, что νη = Μγ . Дей-

ствительно^ пусть ΜΧτ f vn, тогда по лемме Фату (напомним, что

Μ (sup Χ η) < οο) νη = limfc sup Μ (Μ (XTfc | f J) < Μ lim* sup Μ (ΧΧ]ς \

| ^η) ^ Μγ . С другой стороны, по теореме о монотонной

сходимости

νη > Μ Х%п1с = Μ (Μ (X,nfc I f n)) t MVn.

Из· следующей леммы будет следовать, что хпк \ тп.

Лемма 1.4. Пусть тк е ЗЙП, Λ = 1, 2, . . .— неубывающая

последовательность правил остановки такая, что MXTjt | рп.

Тогда lim τΛ > τ* (п. н.).

k-кзо

Доказательство. Положим τ = Hm τκ и предполо-

жим, что для некоторого i > и событие Л = {τ = i < τη} имеет

положительную вероятность. Тогда найдется ε > О такое, что

J TidP-3e>5 XidP.

Λ Α1

Пусть при всех к > η Вк = {τλ = i < τ*}^ тогда /вл -* /а и по

теореме Лебега о мажорируемой сходимости для всех достаточно

больших к

JxtdP< JvidP — 2ε. (1.2)

По определению последовательности хпи & =* 1* 2, . . . для всех

в*

20

достаточно больших к

$|xtn,rfP> ξγ^Ρ-ε. (1.3)

V в\

Положилг рк = тпк1Вк + хк1- . Тогда ps e 3R„ и для всех

достаточно больших к из (1.2) и (1.3) получаем

Вь

= MIXfct8.

Следовательно, sup MXP > i;n'+ ε. Полученное противоречие

завершает доказательство леммы.

Теорема 1.5. Если τ*η < оо (п.н.), то правило остановки

τ* оптимально в классе 9ЛП. В противном случае в классе 9Rn

оптимального правила не существует.

Доказательство. По лемме 1.4 τη1: | τη. По лемме

Фату

νη = ПпПИХ^ < Μ (linkup XTJ < $ XT*dP +

+ J limfrsupXfcdP.

Действительно, при каждом элементарном исходе ω

последовательность τη1ζ (ω) либо стабилизируется на значении τη (ω) < оо,

либо τη1ί (со) | оо, & -> оо. Если τ* < оо (п.н.), то MX * ;> ν,

τη

*

η»

так как τ* = max (η, τ*) < оо (п.н.), и тогда правило τ*

оптимально в классе SRn, η = 1, 2, . . ..

Если событие {τ* = оо} имеет ненулевую вероятность, то это

же верно и для всех τ*, η ^> 1. Предположим, что μ —

оптимальное в одном из классов 9КП правило. Тогда по лемме 1.3 правило

остановки μ' = min (μ, τ*) также 9Кп-оптимально. Полагая в

условии леммы 1.4 тк = μ', к = 1, 2, . . ., мы видим, что μ' = τ*,

т. е. τη — правило остановки. Полученное противоречие

завершает доказательство теоремы.

Теорема 1.6. Для любого η = 1, 2, . . .

уп = шах(Хп, Μ (γη+11 fn)). (1.4)

Доказательство. Пусть τ — произвольное правило

остановки из класса 9Rn. Положим τ' = max (л_+ 1, t) и В =

= {г = п}. На множестве Л τ = τ', поэтому на В Μ (Χτ I fn) =

== Μ (Xr I ^n) = Μ (Μ (Χτ> I ^n+1) I f n)< Μ (Vn I fn), так как

τ e 3Rn+i· Следовательно,

21

Μ (Χ, I f η) = ΙΒΧη + /5Μ (Χ, I fn) < max (Χη, Μ (γη+1 | fn))r

откуда ν„ < max (Χη, Μ (γη+1 | f „)).

В другую сторону, по теореме о монотонной сходимости для

условных математических ожиданий

γη> Μ (Xtn+i>k I F„) - Μ (Μ XXn+lk I $n+1) | f„) ί Μ(γη+11 Г„).·

Неравенство γη ^ Χη очевидно. Теорема доказана.

Формула (1.4) позволяет записать

τ* = min {η Ι Xn > Μ (γη+1 J f n)}. (1.5)

Таким образом, τ* на каждом шаге предписывает

останавливаться, если выигрыш от остановки не меньше максимального среднего

выигрыша, который может быть получен при продолжении на·

блюдений.

1.2.3. До сих пор мы рассматривали задачу оптимальной

остановки бесконечной стохастической последовательности, однако

задача оптимальной остановки конечной стохастической

последовательности {ХПУ $ίη}¥ является частным случаем, так как мы

всегда можем формально положить fn = fn и Хп = XN при

n^>N. Нетрудно видеть, что в этом случае γ^ = Χν, поэтому

уравнение (1.4) позволяет рекуррентно вычислять γη от больших

значений η к меньшим, отправляясь от η = Ν, а поскольку τ* ^

^ Ν, то это правило оптимально. Метод нахождения

оптимального правила остановки с помощью уравнения (1.4) по очевидным

причинам получил название «принцип обратной ^индукции».

В общей задаче оптимальной остановки бесконечной

стохастической последовательности {Хп, <Г}~ отсутствует «граничное

условие» γ^ = Xnj поэтому мы не можем воспользоваться

уравнением (1.4) непосредственно. Тем не менее, при N -*· оо задача

оптимальной остановки последовательности {Хп, fn}i^ Τ· е· с

конечным числом шагов, в определенном смысле аппроксимирует общую-

задачу. Чтобы описать такой способ аппроксимации, положим

5»£ = {τ е 9Rn Ι τ < Ν], γ? = ess supM(XT \f n), i£ = ν («?).

η

Задача оптимизации в классе 3RN = SRJ^ эквивалентна задаче

оптимальной остановки последовательности {Xn, fn}i , поэтому

обратная индукция дает

У ν = ΧΝ, γ? = max (Xn, Μ (γ£+11 f J), η = N - 1, . . ., 1.

Поскольку 3R£ с ®n+1 С · . ., то γ£ < γΓ1 < ν · и νηη <

^ νη+1 <ζ · · ·ι так что существуют пределы уп = Hm γ£ и

ι4 = Hm v^. По теореме о монотонной сходимости Μγή = Vn и

iV-*oo

Y^ = max(Xn, M(Y;+1|fn)), (1.6)

22

т. е. {у'п} удовлетворяет тому же рекуррентному уравнению, что

я {γη}, н0 в общем случае эти последовательности не совпадают.

Теорема 1.7. Пусть для любого правила остановки χ

lim sup J (Yn)~<2P = 0, (1,7)

Ν {τ>Ν}

тогда уп = γη, η = 1, 2, ....

Доказательство. В силу уравнения (1.6) для всех п

справедливо неравенство уп > Μ (γη+ι I Fn), которое

равносильно тому, что для любого В £Ξ fn

lyndP>\y'n+ldP. (1.8)

в в

Для любого w, A G f η и τ ^ 5Кп

N

$γ^Ρ=2 $ TmdP+ ) VidP =

А т=*п АП(т>т-1} ΑΓ\{τ>Ν)

N

= 2 ( $ V-dp- S VmdP)+ J γ^Ρ.

m=n АП(т>т-1} АП(^>т} ΑΠΙτ>Ν>

Из того, что Α Π {х^>т —1} е fm-i и (1-8) вытекает, что при

т^> η

J Ym-idP^ J y'mdV.

Afl(t>m-i} АП{т>т-1}

Следовательно,

fv^P<fv;dP- $ TVJP+ $ YtdP<

Α Α ΑΠ(τ>^} ΑΠ{τ>^^

<Jv;dP+ J Ш~аР+ 5 vxdP.

Α Afm>iV} Af\{t>N)

Устремляя N —►■ oo по подпоследовательности, для которой

интеграл в (1.7) стремится к нулю, мы видим, что второе слагаемое

в последнем неравенстве стремится к нулю. То же верно и для

третьего слагаемого, так как х <С оо (п.н.). По произволу А отсюда

получаем уп > Μ (у'х \ fn) для любого х е 5КП» следовательно

Уп > Упу так как γ^ > Χί, k = 1, 2, ... и Μ (γ^ | ^η) > Μ (Χτ| fn).

Обратное неравенство γη <^ γη следует из включения 9R^ CZ

С 5Rn, дающего при всех N^n неравенство γ^ ^ γη· Таким

образом, уп = γη. Теорема доказана.

Для выполнения условия (1.7) достаточно равномерной

интегрируемости последовательности Хъ Х2, . . . или выполнения

неравенства Μ sup Χή < оо.

23

В общем случае оптимальное правило остановки невозможна

найти без операции предельного перехода, но в некоторых

случаях это можно сделать даже в задаче с бесконечным числом шагов.

Скажем, что имеет место монотонный случай, если стохастическая

последовательность {Хп, frn)? удовлетворяет следующим

условиям: положим Ап = {М (ХП41 I f п) < Хп} /г = 1, 2, ...

и потребуем, чтобы

Лс^с, ρ ( и ап) = ι. (1в9)

п=1

Смысл этих условий заключается в том, что в процессе

наблюдения мы обязательно придем к состоянию, в котором невыгодна

делать ровно одно очередное наблюдение, причем на

последующих шагах ситуация не изменяется. Ясно, что если Хп < Μ (Χη+ι \

| fn), то имеет смысл сделать, по крайней мере, еще один шаг,

поэтому в монотонном случае подозрительным на оптимальность

является правило остановки

μ = min {n\IAn = 1}.

Теорема 1.8. Пусть выполняется условие (1.7), тогда

в монотонном случае μ = τ*.

Доказательство. Покажем сначала, что в классе 9KW

оптимально правило остановки μ^ = min (Ν, μ). Для этого

достаточно доказать, что μΝ = min {п\ Хп = Уп}· На множестве

^ш η ^ Ν, имеем γ^ = Хп; действительно, у% = Χχ, и если

Уп+г = Χη+ι на Лп+1, η < Ν, то в силу (1.9) и рекуррентного

уравнения на Ап получаем у% = max (Χη, Μ (γη+ι I fn)) =

= max (Xn, Μ (Xn+i \ fn)) = Xn· Из того, что на множестве Лп

выполняется неравенство Хп < M(Xn+1 | fn) < Μ (γη+ι I f n)

теперь следует, что μΝ = min {н \ Хп = γ^}.

По теореме 1.7 ΜΧμΝ = νΝ j ν, поэтому по лемме 1.4 μ^ |

| μ ;> τ*. Обратное неравенство μ <ζ τ* вытекает из очевидного

неравенства μΝ ^ τ*. Таким образом, μ = τ*. Теорема доказана*

1.3. Оптимальная остановка марковских

случайных последовательностей

1.3.1. Напомним теперь определение марковской цепи и

изложим некоторые основные факты теории оптимальной остановки

марковских цепей.

Пусть (Ω, f, Ρ) — вероятностное пространство с выделенным

на нем семейством σ-алгебр f0CfiC · .Cf, и(£, ?) —

измеримое пространство, все одноточечные подмножества которого

принадлежат <Е. Точки Ε будем называть состояниями, а сама

пространство (£, 8) — фазовым пространством.

Последовательность {Zn, Fn}o°» гДе %п являются fn/<g — измеримыми случай-

24

ными элементами со значениями в Е, называется марковской цепью,

если для любых и^т^ОиЙЕ?

P{Zn^B\fm) = ¥{Zn^B\Zm}.

Это условие выражает марковский принцип независимости

«будущего» от «прошлого» при фиксированно^^ «настоящем».

В том частном случае, когда §п = 53 (Z1? . . ., Zn) и

последовательность {Ζη, ^η}Γ образует марковскую цепь, говорят, что

сама последовательность {Zn} является марковской цепью.

Нетрудно видеть, что если {Zn, fn}™ — марковская цепь, то и {Zn}

также есть, марковская цепь.

В исследовании марковских цепей особо важную роль играют

переходные вероятности Ρ {Ζη+1 £Ξ Β | Ζη} за один шаг. Если

существуют регулярные условные вероятности Рп+1 (ζ, В),

являющиеся при фиксированном ζ мерами на (Е, $) и при

фиксированном В измеримыми функциями по ζ такие, что

Ζη) — Pn+i

(Zn, В) (п.н.),

то Рп (ζ, В) называются переходными функциями.

Марковская цепь называется однородной, если переходные

вероятности за один шаг не зависят от п\ если при этом существуют

переходные функции, то все они совпадают и обозначаются

просто Ρ (ζ, Β).

Другой важной вероятностной характеристикой марковской

цепи является начальное распределение вероятностей,

определяемое как Q (В) = Ρ {Ζ0 g5}. В случае однородной марковской

цепи пара (Q, Р) полностью определяет все вероятностные

свойства марковской цепи. Более точно: для любого η и ^-измеримых

множеств BQ, . . ., Вп справедлива формула

Ρ {Zo S Во, · · ·, Zn s Вп) =5 Q (dz0)J Ρ (zo, dzx) . .. $ Ρ (zn.lt dzn)9

Bo Bi вп

определяющая все конечномерные распределения марковской

цепи.

Для достаточно широкого класса однородных марковских

цепей регулярные переходные вероятности за η шагов

РЮ (Ζ0, В) = Ρ {Ζη е В | Ζ0) (п. н.).

можно выбрать так, чтобы выполнялось уравнение Чепмена —

Колмогорова!

р(Ы) (Zf β) = J i><*> (ζ, dz') PW (z\ В) (1.10)

в

Для всех ζ <= Ε.

Важным следствием регулярности переходных вероятностей

25

является формула для условных математических ожиданий

М (/ (ZJ | Zn) = J / (ζ) /Χ*-» (Ζη, dz) (п.н), (1.11)

где m > η ;> 0.

1.3.2. Перейдем к задаче оптимальной остановки. Все

утверждения п. 1.2 остаются верными, если вместо условий, которые

накладывались на исходную стохастическую последовательность,

потребовать выполнения одного-единственного условия

равномерной интегрируемости. Поэтому нам удобно будет

предположить, что стохастическая последовательность {Хп, iFn}o°

равномерно интегрируема. Из этого предположения, в частности,

следует, чтоу^ | γη, т. е. последовательность γη, η ^> 0 может быть

по крайней мере в принципе вычислена с помощью обратной

индукции и предельного перехода.

Скажем, что стохастическая последовательность {Хп, £п}о

имеет марковское представление, если существует марковская

цепь {ΖΛ, fn}™ с фазовым пространством (2?, 8) такая, что

Хп = gn (Zn), гДе Sn (z) — некоторая измеримая функция на

фазовом пространстве.

По-видимому, ясно, что в марковском случае решение об

остановке должно зависеть только от состояния системы в текущий

момент. Этот принцип часто считают само собой разумеющимся

в задачах оптимальной остановки. Формально указанный

принцип означает, что мы можем ограничиться рассмотрением класса

ί0 правил остановки τ таких, что τ = min {n \ Zn ^ Bn}f где

Вг, 2?2, ... — некоторая последовательность ^-измеримых

подмножеств Е. Множество Вп естественно интерпретируется как

область окончания наблюдений, а его дополнение Вп = Е\Вп —

как область продолжения наблюдений.

Положим ©п = © Π ^п·

Теорема 1.9. В марковском случае для каждого η = 0,1, ...

γη = ess sup Μ (Χχ Ι f n) = ess sup Μ (Χχ | Ζη), νη = sup MXX.

фп К %

Доказательство. Случайная величина γ$ является

ЯП (глг)-измеримой, так как γ$ = XN = gn (ZN). Если γη+1

является 3ϋ (£п+1)-измеримой, η -f 1 < TV, то в силу

обратной индукции у% = max (Хп, Μ (γη+1 (f n)) = max (gn (Zn),

Μ (γη+ι I Zn)) является S3 (Z^-измеримой. Следовательно, при

всех η <ζ N случайная величина γ^ является 53ч(£Л)-измеримой.

Отсюда вытекает, что существуют функции vi4 (ζ) на (Ε, %) такие,

что γ£ =ν£ (Ζη) (п. н.).

Полагая Tk = {z e E\gk (z) = v*(z)}, мы можем оптимальное

в классе <$R% правило остановки τ% = min {k > n\Xk = γ^}

26

представить в виде

t£ = min{ft>i»|Zk erf},

ПОЭТОМУ Τη S Sn-

Остается заметить, что Μ (Χ Ν | Fn) = Μ (Χ ν|Ζ„) = γη Τ Υπ

при Ν ->οο. Теорема доказана.

Поскольку γη является пределом 33 ^п)-измеримых функций

у% = у^ (Ζη), то мы можем также записать уп = νη (Ζη), где

Vn (z) t vn (z) ПРИ Ν -*~οο. В марковском случае

последовательность функций vn (я), п = О, 1, . . . играет ту же роль, что и

{уп} в общей задаче оптимальной остановки. В частности,

τ* = min {η | νη (Ζη) = gn (Ζη)},

или, полагая Γη = {ζ е Ε \ νη (ζ) = gn (z)}y

τ* = min {η | Ζη e Γη}.

В том случае, когда τ* является правилом остановки, τ* 6Ξ S.

Поэтому из теоремы 1.5 следует, что если оптимальное правило

остановки существует, то его можно искать в классе S. С другой

стороны, если существует ©-оптимальное правило, то по теореме

1.9 оно является оптимальным и среди всех правил остановки.

Из этого, конечно, не следует, что все оптимальные правила, а не

только τ*, принадлежат ©.

Предположим теперь, что марковская цепь Ζ0, Ζ1? . . .

является однородной с переходной функцией Ρ (ζ, В). Уравнение (1.4)

мы можем записать, воспользовавшись формулой (1.11), в виде

νη (ζ) = max (gn (z), Tvn+i (ζ)) (1.12)

где оператор Τ действует на ^-измеримые функции по формуле

Tf(z)=^f(z')P(z, dz').

Ε

Ситуация существенно упрощается, если выигрыш при

попадании в какое-либо состояние не зависит от момента попадания,

т. е. когда gn (ζ) = g (ζ), η = 0, 1, .... В этом случае νη (ζ) =

= ν (ζ) и Γη = Γ = {ζ е Ε | g (ζ) = ν (ζ)} при всех п. При этом

ν (ζ) естественно называть ценой состояния, а Г —множеством

остановки, так как τ* — это момент первого попадания цепи

в Г. Уравнение (1.12) превращается в функциональное

уравнение для ν (ζ):

v(z) = m*x(g(z), Tv (z)). (1.13)

В теории марковских цепей функции, удовлетворяющие

неравенству Tf (z) ^ / (ζ), называют эксцессивными. Можно показать,

Что ν (ζ) является наименьшей эксцессивной мажорантой функции

выигрыша, ί. е. ν (ζ) меньше любой эксцессивной функции / (ζ) ^>

27

Особенно просто выглядит марковский вариант монотонного

случая. Определим G как множество состояний ζ£Ξ Ε, для

которых g (ζ) ^ Tg (z). Первое условие монотонности (1.9)

превращается в условие Ρ (ζ, G) = 1 для всех ζ, принадлежащих С

В монотонном случае Г = G.

1.3.3. Пусть {ХП1 fn}T равномерно интегрируемая

стохастическая последовательность. Скажем, что имеет место случай

независимых наблюдений, если Χη+ιΗβ зависит от fn, η = 1, 2, . . .♦

Нетрудно видеть, что в этом случае Х1э Aj, . . . — независимые

случайные величины.

Наиболее типичный пример: У1э У2, ... — независимые

наблюдаемые случайные величины, fn = $3 (Yu . . ., Υη), и Хп

является функцией от Υη.

Из теоремы 1.9, примененной к марковской

последовательности Zn = Xn-n η = 1, 2, . . ., вытекает следующий результат.

Теорема 1.10. Пусть имеет место случай независимых

наблюдений. Тогда

1) случайные величины γι, γ2> · · · являются независимыми;

2) γη = max (Χη, ι;η+1), ι>η = Μ max (Xn, ι>η+1), η = 1, 2, . . .;

3) ι>η является ценой класса ©n, η = 1, 2, . . .;

4) τ* = min {η \ Χη > ι>η+ι};

5) оптимальным в классе $RN является правило остановки

xN = min{n\Xnp>Vn+i},

где yjv+i = —оо и v% = Μ max (Χη, ι>*+1).

Как утверждает теорема 1.9, в марковском случае можно

исключить из рассмотрения те правила остановки, которые

предписывают принимать то или иное решение не только в зависимости

от текущего состояния, но и от некоторых прошлых состояний.

Иначе говоря, информация о прошлых состояниях является

излишней, поскольку ее наличие не увеличивает средний выигрыш.

Вообще, введение дополнительной информации, которая может

влиять на выбор решения, но не влияет на будущее течение

процесса, называют рандомизацией. Интуитивный метод

рандомизации заключается в проведении «не относящегося к делу»

дополнительного случайного эксперимента (например, подбрасывания

монеты) для выбора решения.

Более формально, пусть {Хп, £п}Т —произвольная

стохастическая последовательность и 2?1э $2> · · · — неубывающее

семейство под-о-алгебр iF, удовлетворяющее двум условиям:

для каждого η = 1, 2, ...

1) Г η С »»;

2) Ρ (Л | gn) = Ρ (А | Гп) для любого 4e»(U ^k)· Пра-

вило остановки τ такое, что {τ = η} е &ηί η = 1, 2, ...

называется рандомизированным правилом остановки относительно

стохастической последовательности {Хп, §-п}?.

28

Теорема 1.11. Если выполнены условия 1) и 2), то

значения уп для последовательности {ХПУ $П}Г совпадают со

значениями уп для последовательности {Χη, #\ι}ί°·

Для равномерно интегрируемой последовательности Х1э Х2,...,

теорема может быть доказана путем перехода к усеченным

последовательностям {Хп, £η}ι и {Хп, $П}Г с помощью обратной

индукции и последующим предельным переходом по N. В общем

случае доказательство требует более сложных предельных

переходов (точнее, большего числа предельных переходов).

По теореме 1.11 рандомизация не увеличивает цены, что

подтверждает вполне понятный факт, что серьезные решения не

следует принимать посредством подбрасывания монеты. Несмотря

на это, рандомизация часто оказывается полезным

вспомогательным приемом в задачах оптимальной остановки.

Пусть £п = 33 (Уг, . . ., Υη), η = 1, 2, . . .. Решение задачи

оптимальной остановки стохастической последовательности {Хп,

£η}Τι не зависит от конкретной структуры вероятностного

пространства (Ω, £, Ρ), лишь бы на нем существовали случайные

величины Yly F2, ... с заданным совместным распределением.

Часто в качестве пространства элементарных исходов Ω

естественно рассматривать пространство последовательностей (ι/ι, ι/2» .. .)»

однако это пространство оказывается слишком бедным, если мы

хотим, чтобы наши решения могли зависеть от результатов

подбрасывания монеты. Таким образом, желание использовать

рандомизацию может привести к усложнению вероятностной

модели эксперимента. В общем случае достаточно ввести новое

пространство (S, f\_ P), где Ω = Ω χ Ω', £ = £ <g) £', Ρ =

= Ρ (g) Ρ' и (Ω', £', Ρ') — некоторое измеримое пространство

«рандомизирующих» исходов *.

1.4. Задача с двумя возможностями остановки

1.4.1. Использование методов оптимальной остановки

оказывается полезным и в других задачах последовательного принятия

решений.

Предположим, что последовательно наблюдаются значения

случайных величин Ух, У2, ... с известным совместным

распределением. На каждом шаге мы можем либо продолжить процесс

наблюдения этой последовательности, либо прекратить. Если

наблюдение прекращается на m-м шаге, то далее наблюдается

другая последовательность случайных величин Ym% т+1, Ут, т+2,....

Если наблюдение второй последовательности прекращается в

Момент η ^> т, т. е. на значении Утп> то наш окончательный

* Пусть (Ωχ, &и Ρχ) и jp2j &2, Р2) — два вероятностных пространства.

Произведением &χ® & г называется σ-алгебра подмножеств Ωχ Χ Ω2,

порожденная множествами вида Αλ χ Л2, где Аг е &и А2 <= &■ ъ.

Произведением Рх ® Рг называется вероятностная мера на ^ΐ<8> ^j такая,

что \\ ® Р2 (Аг X А2) = Pi (Αλ) Ρ2 (Л2).

»

выигрыш составляет Хтп, где Хтп зависит от всех наблюденных

значений У1? . . ., Ym, Ym%m+1, . . ., Утп. Требуется

максимизировать средний выигрыш при условии, что совместное

распределение семейства {Ymn, 1 ^ т <^ п) известно.

Более общая ситуация такова. Пусть заданы следующие

объекты:

1) вероятностное пространство (Ω, §, Р);

2) неубывающее семейство σ-алгебр f ι (Ζ $ъ (Ζ · · · df\

3) для каждого фиксированного т = 1, 2, ...

стохастическая последовательность {Хтп, fmn}n=m+i такая, что fmCfmnCI

d fm, n+ь П^> ГЛ.

В частном случае, о котором говорилось вначале, следует

положить £т = SB (Fx, . . ., Ym) и f mn = 3d (Yl9 . . ., Ym,

* m, m+i» · · · ^,jnn)·

Составным правилом остановки называется пара случайных

личин (σ, τ), принимающих значения 1, 2, . . ., оо таких, что

1) σ <τ< оо (п. н.);

2) {σ = m}&fm, m= 1, 2, . . .;

3) {σ = m, τ = η} e imn, /г > m > 1.

Из этого определения следует, что σ является правилом остановки

относительно последовательности fx, f2, .... Аналогично,

τ можно рассматривать как правило остановки относительно

fm,m+ij fm,m+2y · · · на множестве {σ = т}.

Будем интерпретировать fm как информацию, накопленную

наблюдателем к моменту т при условии, что до этого момента

ни одна из возможностей остановки не была использована. Точно

так же, fmn интерпретируется как информация, имеющаяся к

моменту η при условии, что первая возможность остановки уже

была использована ранее в момент т.

Для каждого составного правила остановки (σ, τ) определим

случайную величину

Хах 2j ^l XmnI{o=m, t=n} =

m=i n=m+l

(Хтп, если σ = /τι и τ = η, т<^п;

[О, если σ^>τ или τ=οο,

-{г

которую будем также обозначать Χ (σ, τ). Под средним

выигрышем составного правила остановки будем понимать

математическое ожидание ΜΧστ, а чтобы средний выигрыш был определен

для всех (σ, τ), потребуем чтобы семейство {Хтп} удовлетворяло

условию

Μ sup C/m< oo, (1.14)

где Um = Μ (U | f т) и U = sup ХшП.

Пусть @т обозначает класс составных правил остановки (σ,

τ) таких, что σ > т, a @mn обозначает подкласс @т, состоящий из

30

пар вида (т, τ), где τ > л. Положим

ym = sup ΜΧστ, i;mn = sup MX^.

®m ®τηη

Составное правило остановки, для которого один из этих супре^

мумов достигается, будем называть оптимальным в

соответствующем классе.

1.4.2. Задача с двумя возможностями остановки сводится

к поочередному решению двух обычных задач оптимальной

остановки.

Предположим, что первая возможность остановки всегда

используется в момент т, тогда объектом оптимизации является

класс @т> т+1. Мы приходим, таким образом, к задаче оптимальной

остановки стохастической последовательности {Xmm fmn} i£=m+i*

Пусть

Кп = ess sup Μ (Χστ | fmn). (1.15)

По теореме 1.6 pmn удовлетворяет рекуррентному уравнению

fimn = max(Xmn, Мфж,п+1|^тп)). (1.16)

Кроме того, из теоремы 1.5 следует, что если τ&η < <*> (п. н.)>

где τ£η = min {fc > п\ Xmli = β^}, то составное правило

остановки (т, xtin) оптимально в классе @mn, и, как следует из леммы

1.3 и (1.5),

Kn = M(X(m,rtn)\fmn). (1.17)

Полагая

pm = Mtfm,m+1|fm), (1.18)

мы из (1.17) и (1.18) получаем

рт = Μ (X (т, τ*, т+1) | §т),

если только правило остановки тт, m+i почти наверное конечно.

Это означает, что β™ есть условный ожидаемый выигрыш, который

мы получаем, если сначала останавливаемся в момент т, а далее

действуем оптимальным образом.

Теперь рассмотрим задачу оптимальной остановки

стохастической последовательности {pm, FmK0· Из предположения (1.14)

следует, что Μ (sup β™) < оо. Положим

Ym = ess sup Мфа|^т),

где 9Кт есть класс правил остановки σ ^ т. В силу

использованных выше аргументов, имеем

Vm = max(pm,M(Vm+i|fm)), (1.19)

а если случайная величина

oti = min {& > m | β* = γ^}

3£

является правилом остановки (т. е. σ™ < оо (п. н.)), то

Ym = M0(a*)|^m).

Теорема 1.12. Пусть

a* = min {m|Pm = Vm)

и на множестве {σ* = т)

T* = min{w>m|Xwn = pmn}.

Если σ* < τ* <С °° (π· н.), mo (σ*, τ*) является оптимальным

составным правилом остановки, т. е. Μ (Χ (σ*, τ*) | fi) = γχ

и MX (σ*, τ*) = νχ.

Доказательство. Для любого составного правила

остановки (σ, τ) определим последовательность правил остановки

tm = τ/{σ=ηι> + (т + 1) 1{о^т).

Поскольку тт е @т, т+ь то в силу (1.15), (1.17) и (1.18) на

множестве {σ = т) имеем $т ;> Μ (Ζ (m, xm) | ^m), причем для

(σ*, τ*) имеет место равенство, так как хт совпадает с τ^,ηι+ι на

\σ = m}. Следовательно, для любого Л €= f±

JP(a)dP=2 J pmdP>

Α т=1 АГ[{о=*т)

со

>S S M(X(m,Tm)|^m)dP =

m«i АП{а=т)

оо

— 2 S X0», tw) dP = J *<n <*P,

τη=1 АП{<1==т| А

я, в силу произвольности Α, Μ (β (σ) | fx) ^ ΜΧστ, причем

для (σ*, τ*) имеет место равенство. Поскольку Υι > Μ (β (σ) | f г)

и уг = Μ (β (σ*) Ι ^), то Μ (Χ (σ*, τ*) | Гг) = уг и MX (σ*,

τ*) = ι?!· Теорема доказана.

В отличие от обычной задачи оптимальной остановки пара

(σ*, τ*) может с положительной вероятностью принимать значения

оо, даже если оптимальное составное правило остановки

существует (ср. с теоремой 1.5).

1.4.3. Теперь предположим, что мы имеем дело всего лишь

с конечным числом наблюдений, т. е. индексы семейства {Хтп,

fmn) пробегают конечное число значений 1 <^ га ^ Af, т <^п ^

^ N (т). Соотношения (1.17) и (1.19) дают

β*ι, N(m) = Хт, N(mh * < т < М^ ί1 ·20)

Кп = max (ХтпУ Μ фт,n+i | fmn))f ™> < η < N (m),

l<m<M; (1.21)

ΤΜ = βΜ; (1.22)

Ym -= max фт, М (Vw+1| f w)), 1 < m <Μ (1.23)

32

Эти формулы есть не что иное как вариант метода обратной

индукции применительно к задачам с двумя возможностями

остановки. В принципе они позволяют вычислять последовательность

f>mn при фиксированном т от больших значений η к меньшим,

а затем последовательность ут от больших значений т к

меньшим. Пара (σ*, τ*), определенная через {Pmn} и {ут}, является

конечнозначной, поэтому (σ*, τ*) есть оптимальное составное

правило остановки.

Нетрудно сформулировать аналогичную задачу с к

возможностями остановки. Теорема 1.12 легко обобщается и на этот

случай, но нахождение оптимального правила, состоящего из к

правил остановки, потребует вычисления к семейств случайных

величин (имеются ввиду аналоги ут и Pmn), число индексов

которых изменяется от 1 до к.

Глава 2

ВЫБОР НАИЛУЧШЕГО ВАРИАНТА

2.1. Классическая задача наилучшего выбора

2.1.1. Эта задача будет исходной для рассматриваемого круга

задач, она имеет много других названий, среди прочих такие, как

задача о выборе наилучшего объекта, задача о секретаре, задача

о выборе жениха или невесты.

Предположим, что имеется N упорядоченных по качеству

вариантов, из которых мы хотим выбрать наилучший.

Ознакомление с вариантами происходит в случайном порядке так, что все

N\ возможных перестановок равновероятны. На каждом шаге

мы можем сравнить очередной вариант со всеми предыдущими,

но ничего не знаем о том, каковы будут последующие варианты.

В зависимости от результатов проведенных сравнений очередной

вариант может быть либо выбран, и тогда процесс выбора

закончен, либо пропущен, и тогда мы смотрим следующий вариант,

если еще не все варианты просмотрены. Требуется с

максимальной вероятностью выбрать наилучший вариант.

Препятствием для выбора наилучшего варианта в этой задаче

является невозможность возврата к отвергнутым вариантам.

Если бы это ограничение отсутствовало, то мы всегда могли бы

выбрать наилучший вариант, просмотрев все N вариантов.

В известной интерпретации, связанной с выбором жениха,

разборчивая невеста хочет остановить свой выбор непременно на

наиболее достойном кандидате. При этом она каждый раз должна

решать вопрос об избраннике до поступления следующего

предложения. Однажды отвергнутый жених считает это решение

окончательным и более не навязывается. Искусственность

некоторых условий в этой интерпретации (например, о том, что

невеста знает наперед число предложений) будет частично устранена

в других постановках задачи наилучшего выбора.

Уточняя и формализуя постановку задачи, мы рассмотрим

в качестве пространства элементарных исходов Ω множество

всех перестановок чисел 1, 2, . . ., Ν, считая при этом все

перестановки ω = (ω1? . . ., ω^) равновероятными. Число Хп (ω) =

= ωη, 1 <^ η <; Ν, мы будем называть абсолютным рангом и-го

по порядку просмотра варианта и считать, что вариант тем лучше,

чем меньше его абсолютный ранг. Так, абсолютный ранг 1

соответствует наилучшему по качеству варианту, 2 — второму по

качеству и т. д. Определим относительный ранг n-το по порядку

просмотра варианта, как число членов последовательности Х1У.. -

34

.. ., Хп, не превосходящих Хп, η = 1, . . ., N. Значение Υη

определяется результатами сравнений п-то варианта со всеми

предыдущими. Обратно, по значениям Ух, . . ., Уп однозначно

определяются результаты сравнений первых η вариантов. Таким

образом, последовательностью Ух, . . ., Υη исчерпывается вся

информация, которая может быть получена путем ознакомления

с первыми η вариантами. Это означает, что решение о выборе

п-то по порядку просмотра варианта должно определяться

относительными рангами Ух, . . ., Уп. Иначе говоря, в качестве

способов выбора следует рассматривать правила остановки

последовательности наблюдений Ух, . . ., У^. Задача наилучшего выбора

заключается в нахождении такого правила остановки τΝ, для

которого вероятность Ρ {Хх = 1} выбора наилучшего варианта

принимает наибольшее значение.

Чтобы привести нашу задачу к обычному виду задач

оптимальной остановки, следует положить

Qn = P{Xr\=i\fnh n = l,...,W,

где fn — iB (У1? . . ., Уп) — σ-алгебра, порожденная

относительными рангами первых η вариантов. Для любого правила

остановки τ относительно последовательности f±, . . ., fn

Μ<?χ= 2 S Cn<*P=2 5 P{Xn = i\fn}d¥ =

= 2Ρ{Χη=1,τ = η>=Ρ{Χτ = 1>,

П=1

поэтому задача наилучшего выбора эквивалентна задаче

оптимальной остановки конечной стохастической последовательности

{Qni ^η}ι у причем Qn — это условная вероятность того, что и-й

вариант окажется наилучшим.

2.1.2. Оптимальное правило остановки и оптимальная

вероятность удачного выбора легко находятся методом обратной

индукции. Прежде всего следует определить совместное

распределение относительных рангов и явный вид выигрышей Qn.

Лемма 2.1. Относительные ранги Ух, . . ., Yn

независимы и Ρ {Υη = к} = 1/п, к = 1, . . ., п.

Доказательство. Положим Ymn, где т > п, равным

числу членов последовательности Хх, . . ., Хт, не превосходящих

Хп. Нетрудно видеть, что Уп = Упп, YNn = Хп и если Ут+1 <

^ ^тгп Т0 ^m+i, η = *тп "Г 11 а вСЛИ Ут+1 ^> *тпч Т0 Ут+ι, η = Утп·

Всякую перестановку (sx, . . ., sN) чисел 1, 2, . . ., N можно

рассматривать как взаимнооднозначное преобразование s

пространства Ω, действующее по формуле s (Х±, . . ., XN) = (XSi, ·..

• · м Xsn)· Поскольку все точки Ω равновероятны, то s сохраняет

вероятность.

Пусть 5т+1 = т + 1, ..., sN = N для некоторого т < N.

Под действием преобразования s событие {Ут1 = 1, . . ., Ymm =

2* 35

=5г т] переходит в событие равной вероятности {Ym\ = s±J ...

• . м Υ mm = $т}· В СИЛу ПРОИЗВОЛЬНОСТИ (s±, . . ., 5m) ВСв mj

Возможных значений вектора (Ут1, . . ., Утт) равновероятны.

Обозначим / (У1э . . ., Уп) вектор (УпЬ . . ., Упп), взаимно·

однозначно определяемый относительными рангами Ух, . . ., Yny

тогда при любых ι/λ < к, к = 1, . . ., п,

^{Гп=2/п|У1=2/ь ..., ^η-ι=Μ = Ρ {У! = ylf . .., Уп-1 = у^} =

Р{/(^..мУп)=/(У1,...Уп)} 1/д1 J_

β Ρ {/ (Уь . . ., Ум) = / (ylf . . ., y^)} = l/(n-l)! = η ·

Лемма доказана.

Как следствие получаем, что

^п = Р{Хп = 1|Уь...,Уп} = Р{Хп = 1ЩЬ

так как абсолютный ранг Хп однозначно определяется

относительными рангами Уп, . . ., У#. Скажем, что и-й вариант является

относительно лучшим, если он лучше всех своих

предшественников, т.е. Уп=1. Если и-й вариант не является относительно

лучшим, то он не может оказаться наилучшим среди всех вариантов.

Если же я-й вариант является относительно лучшим, то он оказы ·

вается наилучшим тогда и только тогда, когда больше

относительно лучших вариантов не появляется. Из сказанного следует,

что

=/

P{Yl, = l,yn.1>l,...,yjv>l}

<гя=*> Г{Г„ = 1}

-/0>*> Π (l-^-) = f/(yn=1, (2.1)

Мы видим, что имеет место случай независимых наблюдений,

по теореме 1.10 в этом случае оптимальным является правило

остановки

τ* = min{n| Qn> v^}, (2.2)

Ν Ν

где последовательность νι , . . ., νΝ удовлетворяет рекуррентному

уравнению

!# = Μ (max (Qn, ς£ι;)), ν*+ι = — °°·

Учитывая (2.1), перепишем это уравнение в виде

(2.3)

Заметим, что Vn не возрастает, а η/Ν строго возрастает по п9

поэтому найдется d* = d* (N) такое, что неравенство η/Ν >

> νη+ι равносильно/г ^d*. Таким образом, неравенство Qn >'ι>ί+ι

равносильно одновременному выполнению условий η ^ d* и Уп =*

= 1. Это позволяет представить (2.2) в виде

τ* = miii {л| η > d*, Уп = 1},

где мы полагаем min φ = Ν.

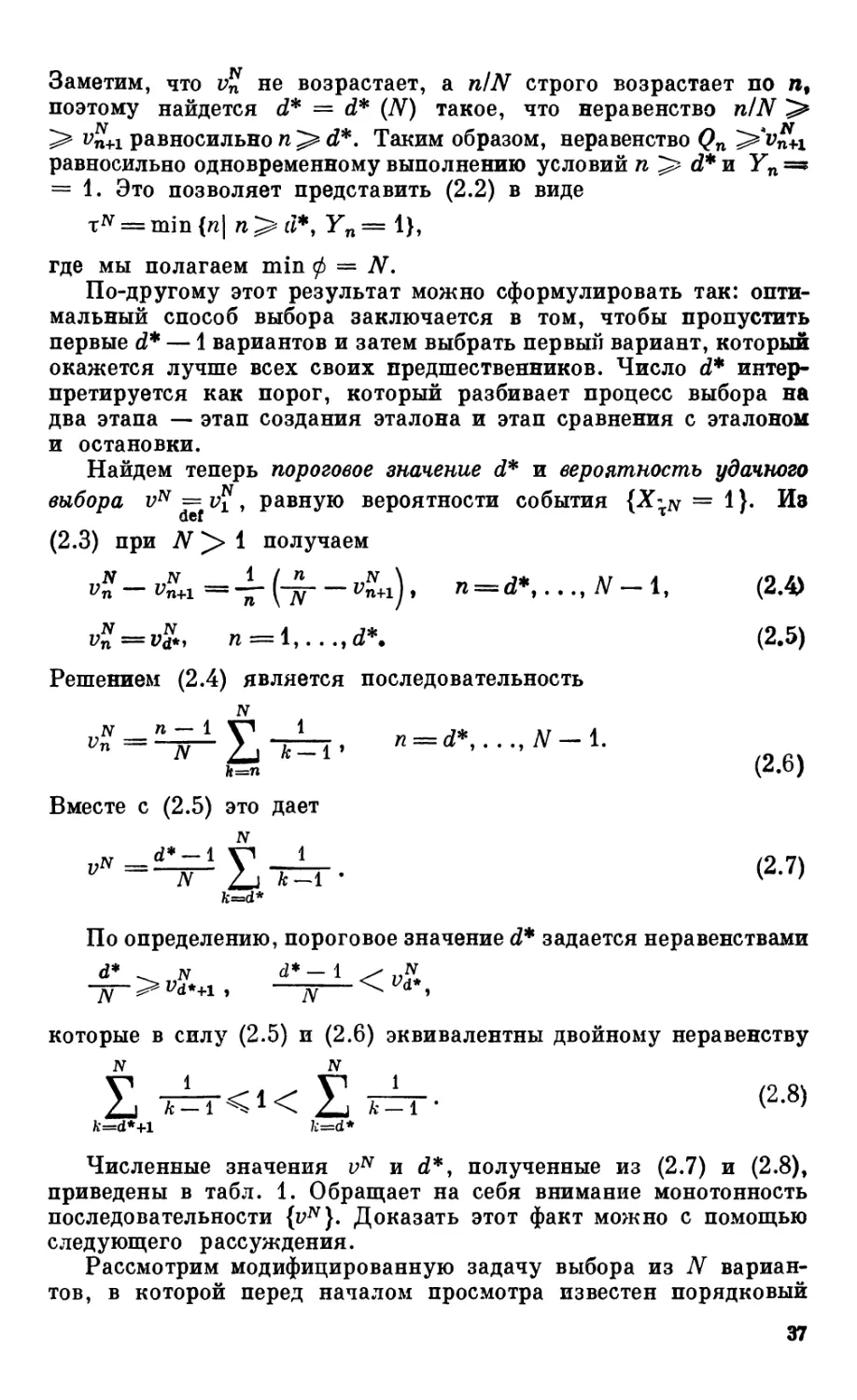

По-другому этот результат можно сформулировать так:

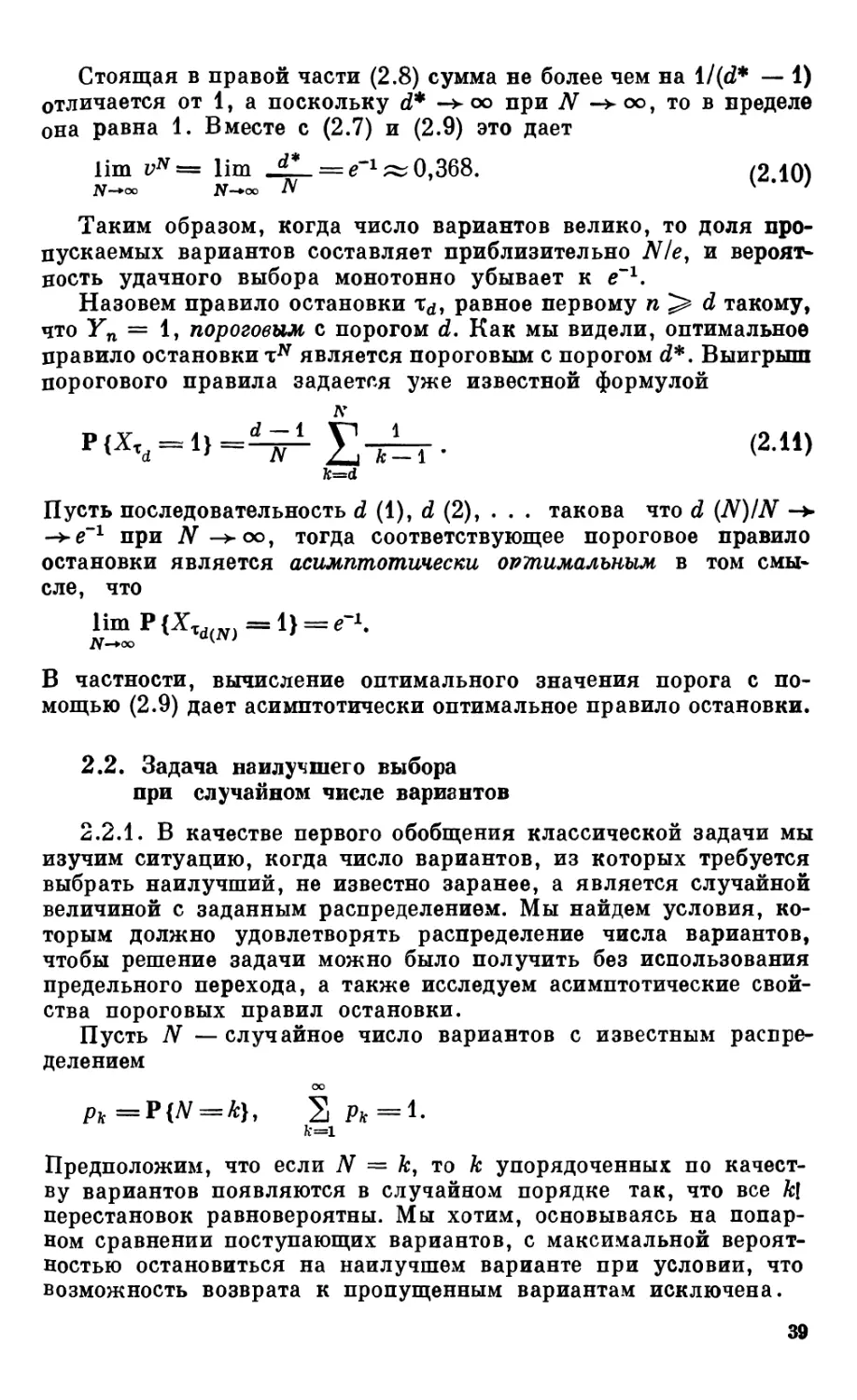

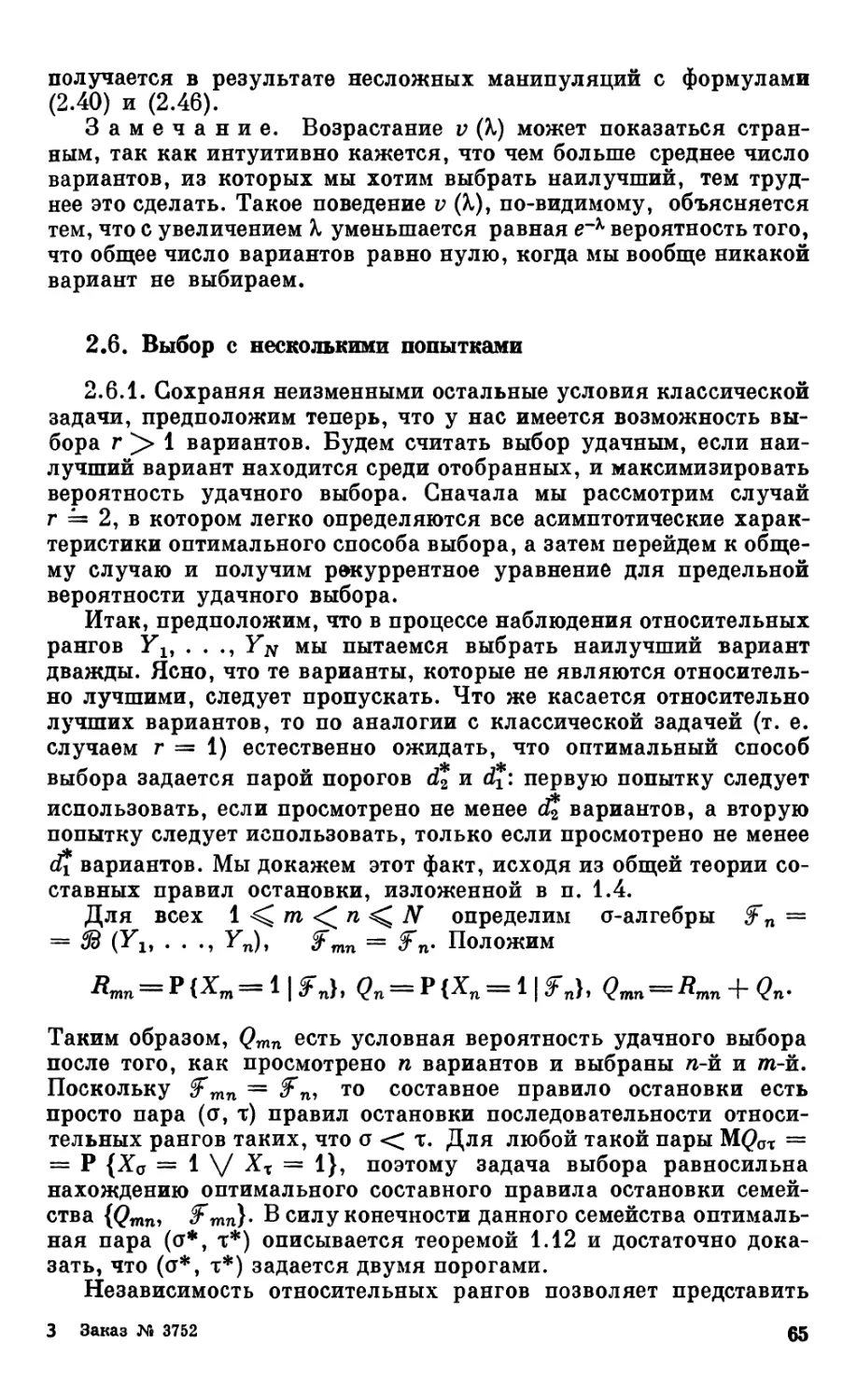

оптимальный способ выбора заключается в том, чтобы пропустить