Author: Айвазян С.А. Мхитарян В.С.

Tags: теория статистики статистические методы математическая экономика статистика методы экономических исследований теория вероятностей эконометрика математическая статистика

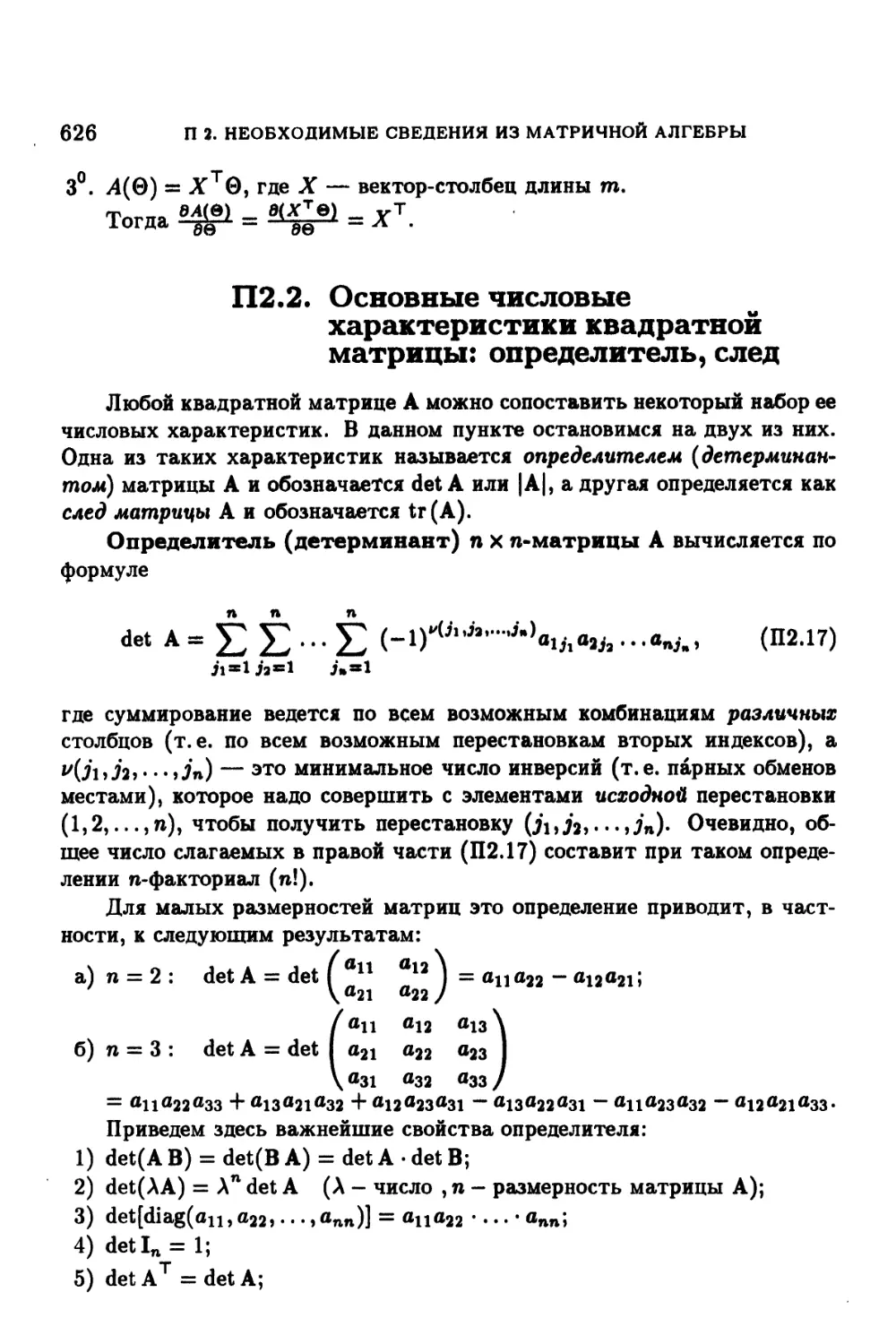

ISBN: 5-238-00304-8

Year: 2001

Прикладная

статистика

Основы

ЭКОНОМЕТРИКИ

В двух томах

ИЗДАНИЕ ВТОРОЕ, ИСПРАВЛЕННОЕ

S. A. Aivazian

V. S. Mkhitarian

PROBABILITY THEORY

AND

APPLIED STATISTICS

Volume!

Textbook

ЮНИТИ

UNITY

Moscow

2001

С. А. Айвазян

В. С. Мхитарян

ТЕОРИЯ

ВЕРОЯТНОСТЕЙ

и ПРИКЛАДНАЯ

СТАТИСТИКА

Том

1

Рекомендовано Министерством общего

и профессионального образования Российской

Федерации в качестве учебника для студенюв

экономических специальностей высших

учебных заведений

юнмти

UNITY

Москва

2001

УДК 311+330.43@75.8)

ББК 60.6+65в6я73

П85

Первое издание данного учебника подготовлено в рамках Проекта Tads "Преподавание экономических и бизнес-д

средних школах, технических и классических университетах**, реализованного Фо1

ситета "Эразмус", Роттердам (SEOR/EUR) и Государственным университетом — Высшей школой:

Рецензенты:

кафедра статистики С.-Петербургского государственного университета

экономики и финансов; проф. Э.Б. Ершов (ГУ ВШЭ) и проф. Я. Магнус (Университет Тилбурга)

Главный редактор издательства Н.Д. Эриашвили

Прикладная статистика. Основы эконометрики: Учебник для вузов: В 2 т.

П85 2-е изд., испр. — Т. 1: Айвазян С. А., Мхитарян B.C. Теория вероятностей

и прикладная статистика. — М: ЮНИТИ-ДАНА, 2001. — 656 с.

ISBN 5-238-00304-8

Содержание и стиль изложения в учебнике соответствуют принятым Министерством

образования РФ стандартам и учебным программам высших учебных заведений экономического

профиля по дисциплинам 'Теория вероятностей", "Математическая статистика" и

"Многомерные статистические методы" (или "Многомерный статистический анализ"). При этом первые две

дисциплины входят в учебные планы 1-й ступени образования (бакалавриата), а третья может

присутствовать (в зависимости от конкретного вуза) в учебных планах бакалавриата или

магистратуры. Усвоение включенного в этот том материала предусматривает для каждой из

упомянутых дисциплин общий объем аудиторных занятий, равный приблизительно 64 часам C2 часа

лекций и 32 часа практических занятий). Изложение построено таким образом, чтобы добиться

цельного (системного) восприятия всего блока эконометрических дисциплин, представленных

в двух томах второго издания: упомянутые три дисциплины первого тома дополнены во втором

томе широким набором моделей регрессионного анализа, методами и моделями анализа

временных рядов и методами построения и анализа систем одновременных уравнений.

Для студентов, аспирантов, преподавателей, а также специалистов по прикладной

статистике и эконометрике.

ББК 60.6+65в6я73

Учебник

Айвазян Сергей Артемьевич, Мхитарян Владимир Сергеевич

ТЕОРИЯ ВЕРОЯТНОСТЕЙ И ПРИКЛАДНАЯ СТАТИСТИКА

Оформление художника Л. В. Лебедева

Лицензия серия ИД № 03562 от 19.12.2000 г. Подписано в печать 10.08.2001. Формат 70x100 1/16

Усл. печ. л. 53,3. Уч.-изд. л. 43. Тираж 20 000 экз. A-й завод - 5000). Заказ 1639

ООО «ИЗДАТЕЛЬСТВО ЮНИТИ-ДАНА». Генеральный директор В.Н. Закаидзе

123298, Москва, ул. Ирины Левченко, 1-9. Тел. @95) 194-00-15. Тел/факс @95) 194-00-14

www.unity-dana.ru E-mail: unity@msm.ru

Отпечатано во ФГУП ИПК «Ульяновский Дом печати». 432980, г. Ульяновск, ул. Гончарова, 14

Качество печати соответствует предоставленным оригиналам

ISBN 5-238-00304-8 © С.А. Айвазян, B.C. Мхитарян, 1998, 2001

© «ИЗДАТЕЛЬСТВО ЮНИТИ-ДАНА^, 1998,2001

Воспроизведение всей книги или любой ее

части запрещается без письменного

разрешения издательства

ОГЛАВЛЕНИЕ

К читателю 15

Предисловие к первому изданию 16

Предисловие ко второму изданию 20

Введение. Вероятностно-статистические методы в

моделировании социально-экономических процессов и анализе данных . 23

8.1. Математико-статистический инструментарий экономических

исследований 24

В. 1.1. Назначение и составные части учебника 24

В. 1.2. Прикладная статистика 26

В.1.3. Теория вероятностей и математическая статистика . . 28

8.2. Теоретико-вероятностный способ рассуждения в прикладной

статистике и эконометрике 29

8.2.1. Границы применимости теоретико-вероятностного

способа рассуждения 29

8.2.2. Что дает объединение теоретико-вероятностного и

статистического способов рассуждения? 35

8.3. Вероятностно-статистическая (эконометрическая) модель как

частный случай математической модели 40

8.3.1. Математическая модель 40

8.3.2. Основные этапы вероятностно-статистического

моделирования 43

8.3.3. Моделирование механизма явления вместо формальной

статистической фотографии 45

Выводы 48

6 ОГЛАВЛЕНИЕ

Раздел I: Основы теории вероятностей si

Глава 1. Правила действий со случайными событиями и

вероятностями их осуществления 52

1.1. Дискретное вероятностное пространство 52

1.1.1. Процесс регистрации наблюдения на объекте исследуемой

совокупности (случайный эксперимент) ...... . 52

1.1.2. Случайные события и правила действий с ними .... 53

1.1.3. Вероятностное пространство. Вероятности и правила

действий с ними 58

1.2. Непрерывное вероятностное пространство (аксиоматика

А.Н.Колмогорова) 69

1.2.1. Специфика общего (непрерывного) случая

вероятностного пространства 69

1.2.2. Случайные события, их вероятности и правила действий

с ними (аксиоматический подход А.Н.Колмогорова) . . 71

Выводы 75

Глава 2. Случайные величины (исследуемые признаки) ... 77

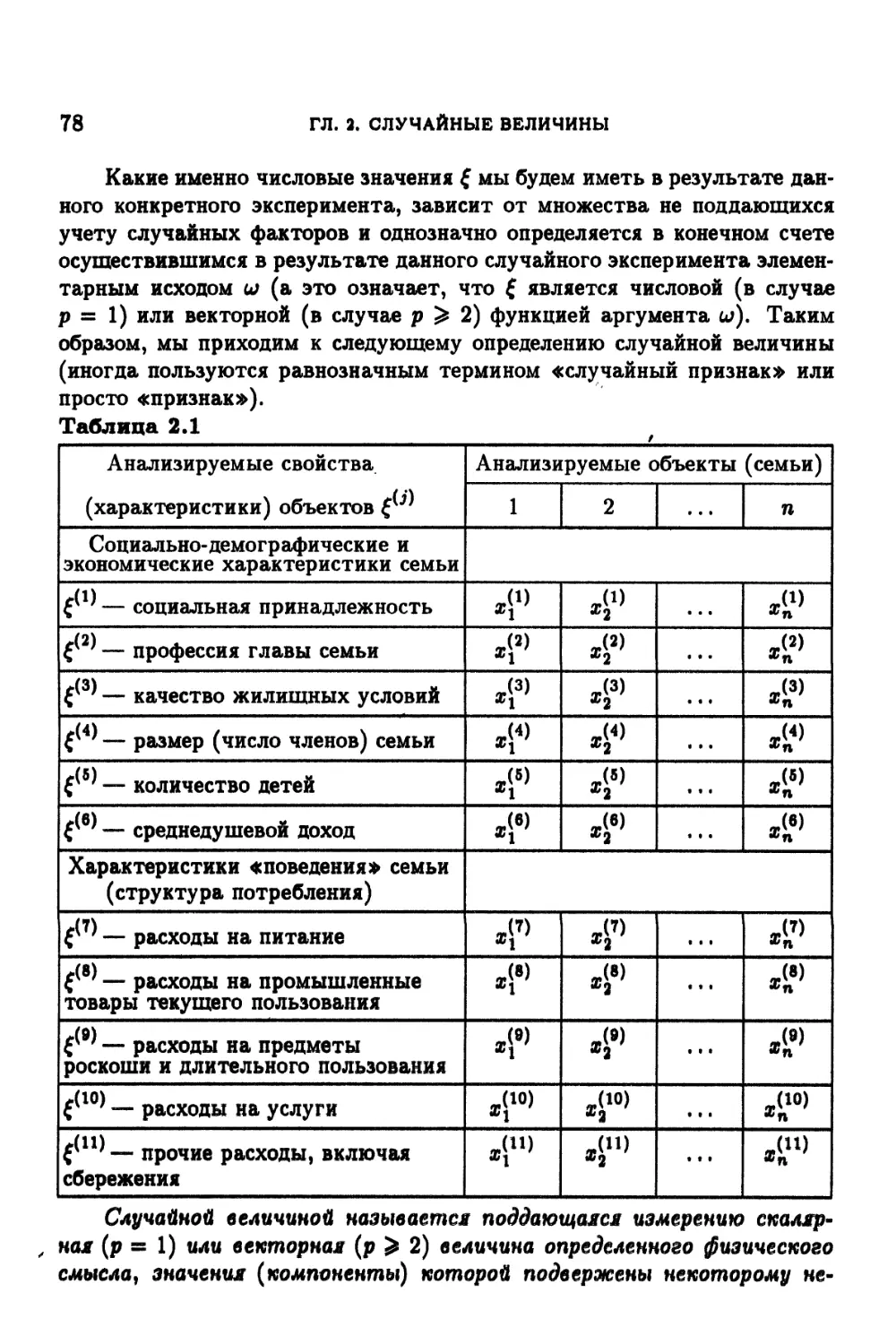

2.1. Определение и примеры случайных величин 77

2.2. Возможные и наблюденные значения случайной величины . . 79

2.3. Типы случайных величин 80

2.4. Одномерные и многомерные (совместные) законы

распределения вероятностей случайных величин 83

2.5. Способы задания закона распределения: функция

распределения, функция плотности 89

2.5.1. Функция распределения вероятностей одномерной

случайной величины 89

2.5.2. Функция плотности вероятности одномерной случайной

величины 92

2.5.3. Многомерные функции распределения и плотности.

Статистическая независимость случайных величин .... 94

2.6. Основные числовые характеристики случайных величин ... 98

2.6.1. Понятие о математических ожиданиях и моментах ... 99

2.6.2. Характеристики центра группирования значений

случайной величины 102

2.6.3. Характеристики степени рассеяния значений случайной

величины 104

2.6.4. Квантили и процентные точки распределения 106

2.6.5. Асимметрия и эксцесс 108

ОГЛАВЛЕНИЕ 7

2.6.6. Основные характеристики многомерных распределений

(ковариации, корреляции, обобщенная дисперсия и др.) . 109

Выводы 112

Глава 3. Модели законов распределения вероятностей,

наиболее распространенные в практике статистических

исследований 114

3.1. Законы распределения, используемые для описания механизмов

генерации реальных социально-экономических данных . ... 115

3.1.1. Распределения, возникающие при анализе

последовательности испытаний Бернулли: биномиальное и

отрицательное биномиальное 115

3.1.2. Гипергеометрическое распределение 119

3.1.3. Распределение Пуассона 121

3.1.4. Полиномиальное (мультиномиальное) распределение . . 123

3.1.5. Нормальное (гауссовское) распределение 125

3.1.6. Логарифмически-нормальное распределение 129

3.1.7. Равномерное (прямоугольное) распределение 132

3.1.8. Распределения Вейбулла и экспоненциальное

(показательное) 134

3.1.9. Распределение Парето 139

3.1.10. Распределение Коши 140

3.2. Законы распределения вероятностей, используемые при

реализации техники статистических вычислений 141

3.2.1. «Хи-квадрат»-распределение с m степенями свободы

(Х2(ет»)-распределение) 142

3.2.2. Распределение Стьюдента с m степенями свободы (t(m)-

распределение) 143

3.2.3. Распределение дисперсионного отношения с числом

степеней свободы числителя mi и числом степеней свободы

знаменателя тг (F(mi,п»2^распределение) 145

3.2.4. Гамма-распределение (Г-распределение) 147

3.2.5. Бета-распределение (^-распределение) *. . . 148

Выводы 151

Глава 4. Основные результаты теории вероятностей 153

4.1. Неравенство Чебышева 153

4.2. Закон больших чисел и его следствия 155

4.2.1. Закон больших чисел 155

4.2.2. Теорема Бернулли 156

8 ОГЛАВЛЕНИЕ

4.3. Особая роль нормального распределения: центральная

предельная теорема 157

4.3.1. Центральная предельная теорема 158

4.3.2. Многомерная центральная предельная теорема 159

4.3.3. Комментарии к центральной предельной теореме . . . 159

4.4. Законы распределения вероятностей случайных признаков,

являющихся функциями от известных случайных величин . . 161

Выводы 166

Глава 5. Цепи Маркова 168

5.1. Последовательности случайных экспериментов и случайных

величин в дискретном вероятностном пространстве 168

5.2. Последовательности, образующие цепь Маркова (определения,

примеры, прикладные задачи) 170

5.3. Основные характеристики и свойства цепей Маркова .... 177

5.3.1. Основные характеристики 177

5.3.2. Классификация состояний и цепей 179

5.3.3. Свойства цепей Маркова 182

5.4. Анализ некоторых задач и примеров 185

Выводы 190

Раздел II: Основы математической статистики . ш

Глава 6. Основы статистического описания и статистика

нормального закона 194

6.1. Генеральная совокупность, выборка из нее и основные способы

организации выборки 194

6.2. Основные выборочные характеристики и их свойства .... 200

6.2.1. Выборочные (эмпирические) функции распределения,

относительные частоты и функции плотности 201

6.2.2. Выборочные аналоги начальных и центральных моментов

случайной величины 207

6.2.3. Эмпирические аналоги центра группирования

генеральной совокупности 208

6.2.4. Эмпирические аналоги показателей вариации

рассеивания случайной величины 209

6.2.5. Выборочные коэффициенты асимметрии и эксцесса . . . 210

6.2.6. Статистическая устойчивость выборочных

характеристик 214

6.2.7. Асимптотически-нормальный характер случайного

варьирования основных выборочных характеристик . . . 216

ОГЛАВЛЕНИЕ 9

6.2.8. Поведение выборочных характеристик в нормальной

генеральной совокупности (статистика нормального закона). 219

6.3. Вариационный ряд и порядковые статистики 224

6.3.1. Закон распределения вероятностей i-ro члена

вариационного ряда V . 225

6.3.2. Совместные (многомерные) распределения членов

вариационного ряда 227

6.3.3. Порядковые статистики как эмпирические (выборочные)

аналоги квантилей и процентных точек распределения . 229

Выводы 229

Глава 7. Статистическое оценивание параметров 231

7.1. Начальные сведения о задаче статистического оценивания

параметров 232

7.1.1. Постановка задачи 232

7.1.2. Статистики, статистические оценки, их основные

свойства 233

7.1.3. Состоятельность 234

7.1.4. Несмещенность 236

7.1.5. Эффективность 238

7.2. Функция правдоподобия. Количество информации,

содержащееся в п независимых наблюдениях относительно неизвестного

значения параметра 241

7.3. Неравенство Рао-Крамера-Фреше и измерение эффективности

оценок ° 244

7.4. Понятие об интервальном оценивании и доверительных

областях (постановка задач) 248

7°.5. Методы статистического оценивания неизвестных параметров. 249

7.5.1. Метод максимального (наибольшего) правдоподобия . . 249

7.5.2. Метод моментов 258

7.5.3. Оценивание с помощью «взвешенных» статистик;

цензурирование, урезание выборок и порядковые статистики

как частный случай взвешивания 261

7.5.4. Построение интервальных оценок (доверительных

областей) 263

7.6. Байесовский подход к статистическому оцениванию 269

7.6.1. «Философия» байесовского подхода 269

7.6.2. Общая логическая схема и базовые формулы байесовского

метода оценивания параметров . . . 270

7.6.3. Примеры байесовского оценивания 273

Выводы 279

Приложение к гл. 7 (доказательство неравенства информации) . . 281

10 ОГЛАВЛЕНИЕ

Глава 8. Статистическая проверка гипотез (статистические

критерии) 283

8.1. Основные типы гипотез, проверяемых в ходе статистического

анализа и моделирования 284

8.1.1. Гипотезы о типе закона распределения исследуемой

случайной величины 284

8.1.2. Гипотезы об однородности двух или нескольких

обрабатываемых выборок или некоторых характеристик

анализируемых совокупностей 285

8.1.3. Гипотезы о числовых значениях параметров исследуемой

генеральной совокупности 285

8.1.4. Гипотезы об общем виде модели описывающей,

статистическую зависимость между признаками 286

8.2. Общая логическая схема статистического критерия 287

8.3. Построение статистического критерия; принцип отношения

правдоподобия 290

8.3.1. Сущность принципа отношения правдоподобия .... 290

8.3.2. Критерий логарифма отношения правдоподобия для

проверки простой гипотезы 292

8.3.3. Критерий отношения правдоподобия для проверки

сложной гипотезы 293

8.4. Характеристики качества статистического критерия .... 294

8.5. Последовательная схема принятия решения (последовательные

критерии) 297

8.5.1. Последовательная схема наблюдений 297

8.5.2. Последовательный критерий отношения правдоподобия

(критерий Вальда) и его свойства 299

8.6. Методы проверки статистических гипотез: примеры

статистических критериев 300

8.6.1. Критерии согласия #. 300

8.6.2. Критерии однородности 309

8.6.3. Проверка гипотез о числовых значениях параметров . . 317

Выводы 325

Раздел III: Методы прикладной статистики ... 327

Глава 9. Введение в прикладной статистический анализ ... 328

9.1. Назначение и содержание прикладной статистики 328

9.1.1. Два подхода к интерпретации и анализу исходных

статистических данных 328

ОГЛАВЛЕНИЕ 11

9.1.2. Три центральные проблемы прикладной статистики . . 331

9.1.3. Новые постановки задач и ослабление ограничительных

условий в канонических математико-статистических и

эконометрических моделях 338

9.2. Основные этапы прикладного статистического анализа . . . 339

Выводы 346

Глава 10. Статистическое исследование зависимостей

(основные понятия и постановки задач) 349

10.1. Общая формулировка проблемы, пример 349

10.2. Какова конечная прикладная цель статистического

исследования зависимостей 359

10.3. Математический инструментарий 362

10.4. Некоторые типовые задачи практики эконометрического

моделирования 364

10.5. Основные типы зависимостей между количественными

переменными 370

10.6. Основные этапы статистического исследования зависимостей. 375

10.7. Выбор общего вида функции регрессии 382

10.7.1. Использование априорной информации о

содержательной сущности анализируемой зависимости 383

10.7.2. Предварительный анализ геометрической структуры

исходных данных 385

10.7.3. Статистические критерии проверки гипотез об общем

виде функции регрессии 386

10.7.4. Некоторые общие рекомендации 390

Выводы 392

Глава 11. Корреляционный анализ многомерной генеральной

совокупности 396

11.1. Назначение и место корреляционного анализа в

статистическом исследовании 396

11.2. Корреляционный анализ количественных признаков .... 398

11.2.1. Коэффициент детерминации как универсальная

характеристика степени тесноты статистической связи . . . 399

11.2.2. Исследование линейной зависимости у от единственной

объясняющей переменной х: парный коэффициент

корреляции 404

11.2.3. Исследование парных нелинейных связей:

корреляционное отношение 412

12 ОГЛАВЛЕНИЕ

11.2.4. Исследование линейной зависимости у от нескольких

объясняющих переменных х^г\х^2\... }х^:

множественный и частные коэффициенты корреляции .... 417

11.3. Корреляционный анализ порядковых (ординальных)

переменных: ранговая корреляция 428

11.3.1. Исходные статистические данные (таблица или

матрица рангов типа «объект-свойство») 429

11.3.2. Понятие ранговой корреляции 430

11.3.3. Основные задачи статистического анализа связей

между ранжировками 431

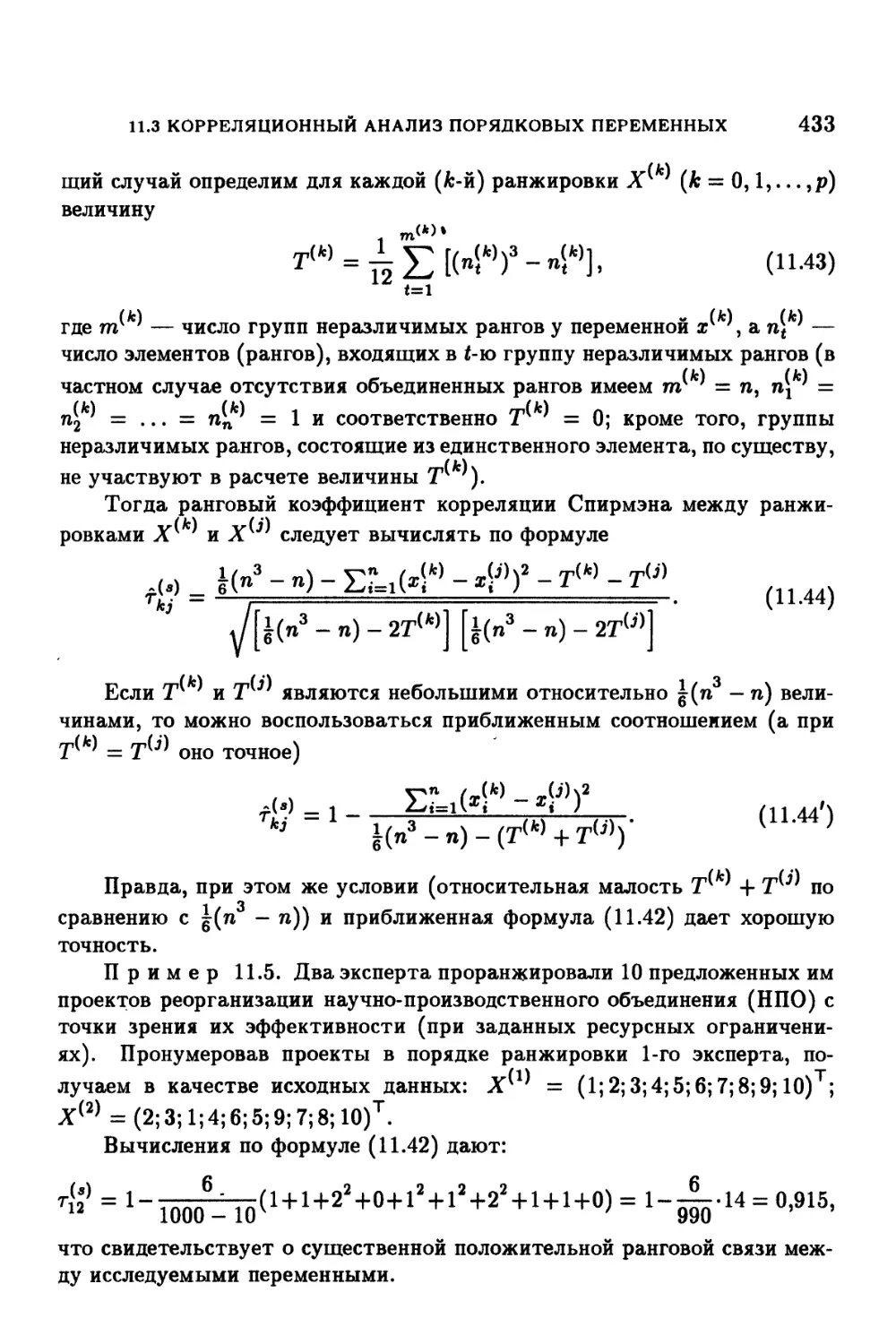

11.3.4. Ранговый коэффициент корреляции Спирмэна .... 432

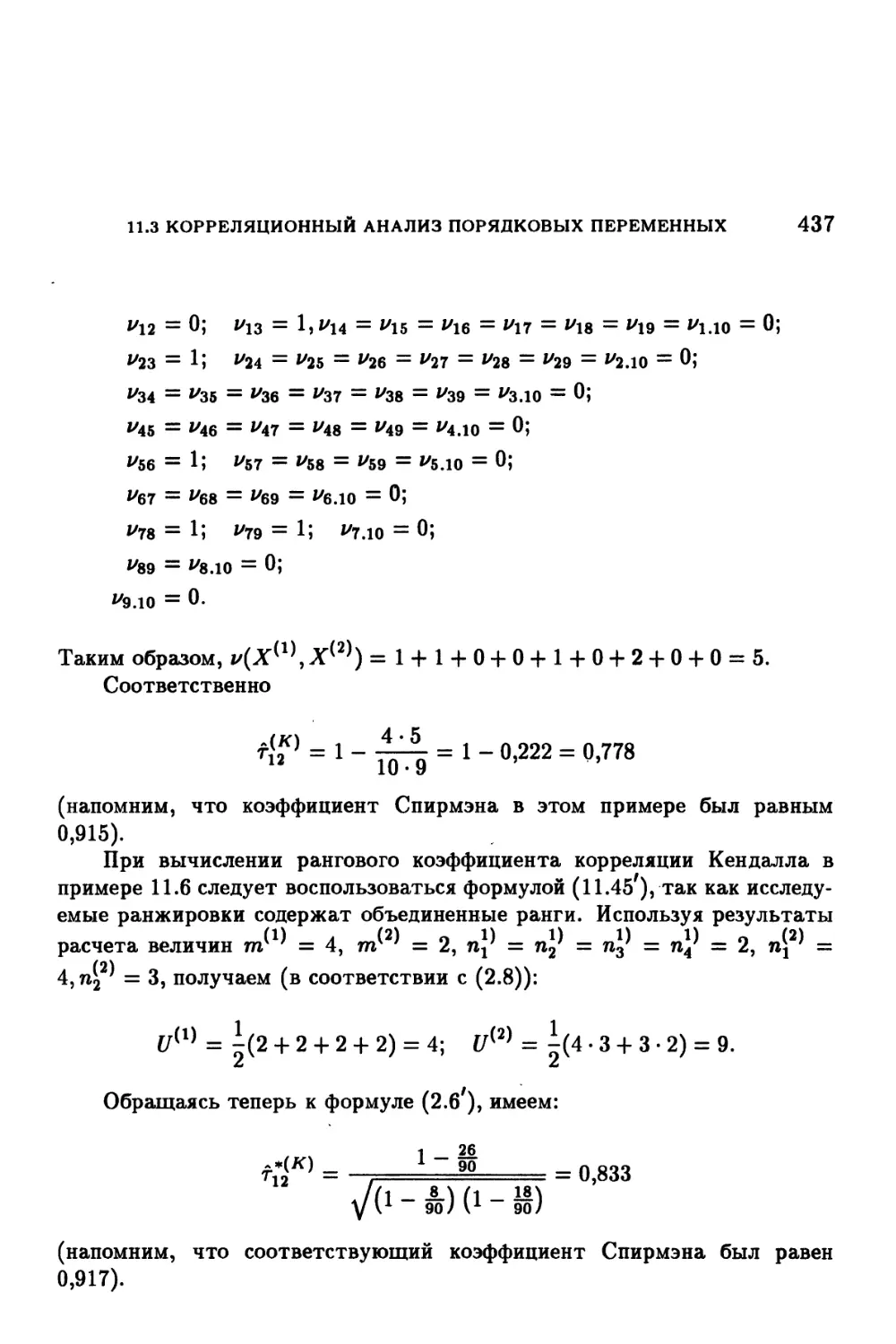

11.3.5. Ранговый коэффициент корреляции Кендалла .... 434

11.3.6. Обобщенная формула для парного коэффициента

корреляции и связь между коэффициентами Спирмэна и

Кендалла 438

11.3.7. Статистические свойства выборочных характеристик

парной ранговой связи 439

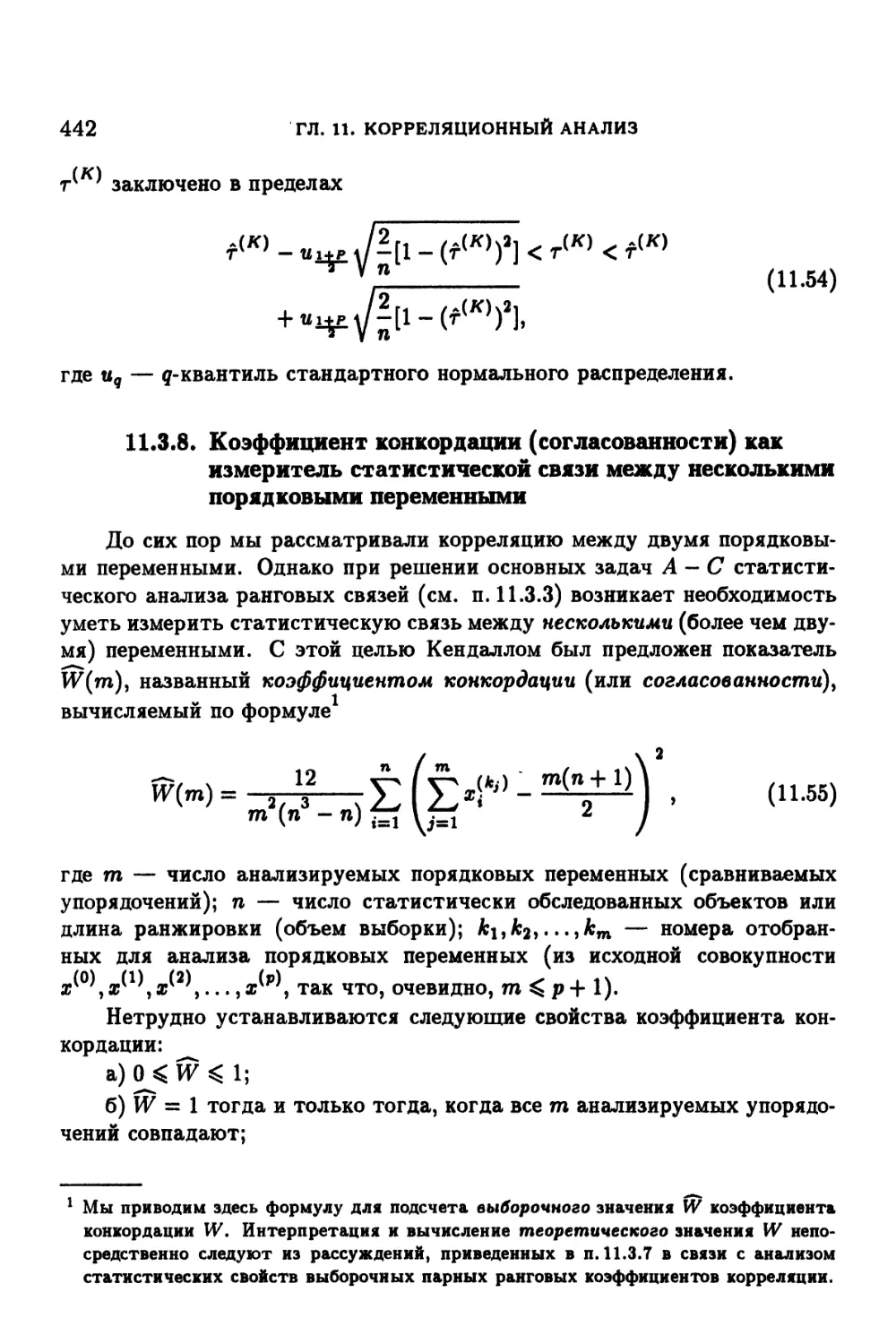

11.3.8. Коэффициент конкордации (согласованности) как

измеритель статистической связи между несколькими

порядковыми переменными 442

11.3.9. Проверка статистической значимости выборочного

значения коэффициента конкордации 444

11.4. Корреляционный анализ категоризованных переменных:

таблицы сопряженности 447

11.4.1. Исходные статистические данные (таблицы

сопряженности) 447

11.4.2. Основные измерители степени тесноты статистической

связи между двумя категоризованными переменными . 448

Выводы 453

Глава 12. Распознавание образов и типологизация объектов в

социально-экономических исследованиях (методы

классификации) 457

12.1. Сущность, типологизация и прикладная направленность задач

классификации объектов 457

12.2. Классификация при наличии обучающих выборок (дискрими-

нантный анализ) 471

12.2.1. Класс как генеральная совокупность и базовая идея

вероятностно-статистических методов классификации . 471

12.2.2. Функции потерь и вероятности неправильной

классификации 472

ОГЛАВЛЕНИЕ 13

12.2.3. Принципиальное решение общей задачи построения

оптимальных (байесовских) процедур классификации . 473

12.2.4. Параметрический дискриминантный анализ в случае

нормальных классов 476

12.3. Классификация без обучения (параметрический случай):

расщепление смесей вероятностных распределений 479

12.3.1. Понятие смеси вероятностных распределений .... 480

12.3.2. Задача расщепления смесей распределений 486

12.3.3. Общая схема решения задачи автоматической

классификации в рамках модели смеси распределений

(сведение к схеме дискриминантного анализа) 487

12.4. Классификация без обучения (непараметрический случай):

методы кластер-анализа 488

12.4.1. Общая постановка задачи автоматической

классификации 488

12.4.2. Расстояния между отдельными объектами и меры

близости объектов друг к другу 491

12.4.3. Расстояния между классами объектов 495

12.4.4. Функционалы качества разбиения на классы и

экстремальная постановка задачи кластер-анализа 498

12.4.5. Формулировка экстремальных задач разбиения

исходного множества объектов на классы при неизвестном

числе классов 503

12.4.6. Основные типы задач кластер-анализа и основные типы

кластер-процедур 503

12.4.7. Иерархические процедуры 505

12.4.8. Параллельные кластер-процедуры 507

12.4.9. Последовательные кластер-процедуры 512

Выводы 516

Глава 13. Снижение размерности исследуемого многомерного

признака и отбор наиболее информативных показателей . . . 520

13.1. Сущность, типологизация и прикладная направленность задач

снижения размерности 520

13.2. Метод главных компонент 526

13.2.1. Основные понятия и определения 526

13.2.2. Вычисление главных компонент 529

13.2.3. Основные числовые характеристики главных

компонент 531

13.2.4. Геометрическая интерпретация главных компонент . . 538

13.2.5. Оптимальные свойства главных компонент 541

14 ОГЛАВЛЕНИЕ

13.2.6. Статистические свойства выборочных главных

компонент, статистическая проверка некоторых гипотез . . 544

13.2.7. Применение свойств выборочных характеристик

главных компонент 547

13.3. Факторный анализ . . . . 551

13.3.1. Сущность модели факторного анализа 551

13.3.2. Общий вид линейной модели, ее связь с главными

компонентами 552

13.3.3. Основные задачи факторного анализа 556

13.3.4. Вопросы идентификации модели факторного анализа . 558

13.3.5. Статистическое исследование модели факторного

анализа 559

13.4. Некоторые эвристические методы снижения размерности . . 570

13.4.1. Природа эвристических методов 570

13.4.2. Метод экспериментальной группировки признаков . . 571

13.4.3. Метод корреляционных плеяд 577

13.5. Построение сводного (интегрального) латентного показателя

качества (или эффективности функционирования) сложной

системы 580

13.5.1. Общая постановка задачи 580

13.5.2. Сводный показатель («выходное качество») и его

целевая функция 581

13.5.3. Исходные данные 583

13.5.4. Алгоритмические и вычислительные вопросы

построения неизвестной целевой функции 585

13.5.5. Примеры построения интегрального показателя с

помощью экспертно-статистического метода 589

13.6. Многомерное шкалирование 592

13.6.1. Постановка задачи метрического многомерного

шкалирования 592

13.6.2. Решение задачи метрического многомерного

шкалирования 593

13.6.3. Понятие о неметрическом многомерном шкалировании

(МШ) 595

Выводы 595

Приложение 1. Таблицы математической статистики 601

Приложение 2. Необходимые сведения из матричной алгебры .... 619

Литература 642

Алфавитно-предметный указатель . 644

К ЧИТАТЕЛЮ

Рекомендую студентам и преподавателям, специализирующимся в

области прикладной статистики и эконометрики, 2-е издание учебника

«Прикладная статистика и основы эконометрики», том 1: «Теория вероятностей и

прикладная статистика». Книга подготовлена выдающимися специалистами,

имеющими богатый опыт преподавания излагаемого предмета и ведущими,

наряду с этим, серьезную исследовательскую работу в области эконометрического

анализа социально-экономических процессов. «Предисловия» авторов

данного издания содержат точную, с моей точки зрения, характеристику основного

замысла книги и ее места в ряду аналогичных изданий. Книгу выгодно

выделяют, по меньшей мере, два ее свойства. Во-первых, отбор материала

первого тома, стиль изложения, расставленные в ней акценты подчинены общей

идее востребованности излагаемых методов и моделей именно теорией и

практикой эконометрики. Во-вторых, содержание и структура учебника

отражают более широкий (по сравнению с традиционным) взгляд авторов на

состав вероятностно-статистического инструментария эконометрики. В

частности, авторы включили в состав этого инструментария и цепи Маркова (гл. 5),

зарекомендовавшие себя полезным инструментом в исследовании динамики

различного рода структурных социально-экономических изменений, и различные

многомерные статистические методы (дискриминантный и кластер анализы,

гл.12, методы снижения размерности, гл.13), органично дополняющие

«законно прописанные» в эконометрике методы и модели регрессионного анализа,

и, наконец, байесовский подход к идентификации моделей (п. 7.6), повышенная

востребованность которого обусловлена именно экономической спецификой

статистических исследований, при которой объем исходных данных (число

имеющихся наблюдений), как правило, не слишком превышает размерности

анализируемых моделей.

Много лет я поддерживал самые тесные научные контакты с одним из

авторов книги — Сергеем Артемьевичем Айвазяном, в первые пятнадцать лет, —-

в качестве его научного руководителя (вначале — на механико-математическом

факультете МГУ им. М.В. Ломоносова, затем — в Математическом

институте им. В.А. Стеклова Российской академии наук). Уже в самом начале своего

творческого пути он умел удачно соединять глубокие математические

исследования с живым интересом к различным областям приложений вероятностно-

статистической науки, в том числе и к экономике. Я твердо уверен, что 2-е

издание книги будет встречено читателями с таким же энтузиазмом, как и

первое.

Академик Юрий Васильевич ПРОХОРОВ,

заведующий отделом теории вероятностей Математического института

им. В.А. Стеклова РАН, заведующий кафедрой математической статистики

факультета вычислительной математики и кибернетики МГУ им. М.В. Ломоносова.

25 июля 2001 г.

ПРЕДИСЛОВИЕ К ПЕРВОМУ ИЗДАНИЮ

Эконометрика — одна из базовых (наряду с микро- и

макроэкономикой) дисциплин экономического образования во всем мире. К

сожалению, до начала 90-х годов эконометрика по существу не была признана в

СССР и России, не включалась в учебные планы подготовки специалистов

(студентов, аспирантов) экономического профиля. Объяснение этому

найти нетрудно: из трех основных составляющих эконометрики —

экономической теории, экономической статистики и математико-статистического

инструментария две первые были представлены в нашей стране явно

неудовлетворительно. Не было доброкачественной экономической теории,

не было системы национальных счетов и необходимого информационного

обеспечения эконометрического моделирования.

Теперь ситуация изменилась. Авторам предлагаемого вниманию

читателя учебника довелось принять непосредственное участие в процессе

«восстановления в своих законных правах» эконометрики: в

формировании базовых положений концепции современного экономического

образования в российской высшей школе, в составлении первых программ и

чтении первых курсов лекций по этой дисциплине на экономическом

факультете Московского государственного университета им. М.В.

Ломоносова (МГУ), начиная с 1992 г., и в Московском государственном

университете экономики, статистики и информатики (МЭСИ), — с 1993 г. В

формировании своей позиции по данной проблеме авторы опирались на

многолетний опыт исследовательской и педагогической работы в

области разработки и практического использования методов

эконометрического моделирования: один из них (С. А. Айвазян), работая с 1969 года в

Центральном экономико-математическом институте Российской академии

наук, занимается эконометрическим моделированием распределительных

отношений в обществе, одновременно являясь автором учебных программ

и постоянным лектором по всему спектру дисциплин эконометрического

профиля — теории вероятностей, математической статистике,

многомерному статистическому анализу (МГУ им. М. В. Ломоносова,

МЭСИ, Российская экономическая школа — РЭШ), методам

прогнозирования в бизнесе (Московское отделение Калифорнийского государственного

университета, г. Хэйвард); другой (В. С. Мхитарян) использует эконо-

ПРЕДИСЛОВИЕ К ПЕРВОМУ ИЗДАНИЮ 17

метрические методы в социально-экономических исследованиях и задачах

статистического контроля качества изделий, а также много лет читает

курсы лекций вероятностно-статистического профиля в МЭСИ.

Что побудило авторов написать этот учебник! Ведь богатые

традиции европейских и северо-американских университетов в области эконо-

метрической науки и ее преподавания в системе экономического

образования всех уровней (undergraduate, graduate, post-graduate) отражены в

разнообразной и интересной монографической и учебно-методической

литературе по данному предмету. Достаточно назвать широко

распространенные учебники Дж. Джонстона, Э. Маленво, A. Goldberger, R. S. Pindyck-

D. L. Rubinfeld, W. Greene, C. Dougherty, E. R. Berndt (см. список

литературы в конце книги). Почему бы не повторить переводы двадцатилетней

давности первых двух учебников и не перевести с английского языка

некоторые из других, здесь упомянутых? Мы полагаем, что в условиях острого

дефицита на отечественном рынке эконометрической учебной литературы

эта деятельность была бы крайне желательной, более того —

необходимой. Однако издание нашей книги имеет свой замысел, свою специфику,

и вот в чем они заключаются.

Во-первых, в предлагаемом учебнике отражено понимание

содержания математико-статистического инструментария эконометрики,

несколько отличающееся от общепринятого. По нашему мнению, современные

достижения математико-статистической науки (особенно в многомерном

статистическом анализе), с одной стороны, и существенное расширение

круга экономических задач, требующих эконометрических методов

решения, — с другой, обусловили необходимость более широкого взгляда

на математико-статистический инструментарий эконометрики и, т

частности, включения в него, помимо традиционных разделов по

регрессионным моделям, анализу временных рядов и системам одновременных

уравнений, таких разделов многомерного статистического анализа, как

марковские цепи, классификация многомерных/наблюдений и снижение

размерности анализируемого факторного пространства. Говоря о

широком спектре экономических задач, требующих выходящих за

традиционные рамки эконометрических/методов решения, мы имели в виду,

в частности, статистическое исследование динамики структурных

изменений (в демографии, в стратификационной структуре общества и т.п.),

выявление скрытых (латентных) факторов, определяющих течение того

или иного социально-экономического процесса, построение интегральных

индикаторов качества или эффективности функционирования социально-

экономической системы, типологизацию социально-экономических

объектов и др.

18 ПРЕДИСЛОВИЕ К ПЕРВОМУ ИЗДАНИЮ

Во-вторых, в ходе многолетнего опыта преподавания различных

дисциплин вероятностно-статистического профиля в экономических вузах и

на экономических факультетах университетов мы пришли к убеждению,

что необходимо строить учебный процесс таким образом, чтобы

добиваться цельного, системного восприятия всего блока этих дисциплин.

Речь идет, в частности, о курсах по элементарным методам

статистической обработки данных (или дескриптивной статистике), теории

вероятностей, математической статистике, многомерному статистическому

анализу (или многомерным статистическим методам), анализу временных

рядов и, наконец, эконометрике. Очевидно, реализации этой цели должен

способствовать и учебник, одновременно содержащий взаимосвязанное

изложение всех этих курсов.

Другими словами, мы попытались написать такую книгу, которую

нам бы хотелось иметь под рукой в процессе нашей преподавательской

деятельности. К сожалению, среди многих прекрасных зарубежных книг по

эконометрике книги, обладающей двумя вышеуказанными особенностями,

не оказалось.

Заметим, что несмотря на наличие ряда иллюстративных примеров

и упражнений, предлагаемый учебник не решает проблемы задачника по

эконометрике. Поэтому для проведения полноценного учебного процесса

он должен быть дополнен набором эконометрических задач и упражнений

(например, в духе книги [Berndt, Б. R.]).

Материал учебника и ответственность распределены между

авторами следующим образом. В. С. Мхитарян принимал участие в написании

глав 6, 7, 8 и 13, а также предложил большую часть задач, которыми

снабжены главы учебника. Остальной материал (включая упомянутые

главы) написаны С.А.Айвазяном. Им же выполнено общее научное

редактирование учебника.

В заключение мы хотим выразить свою признательность. Мы

благодарны, во-первых, руководителям образовательного проекта EU-TACIS

«Преподавание экономических и бизнес дисциплин в средних школах,

технических и классических университетах» профессору Соломону Кохену

(S.Cohen, SEOR и Эразмус Университет, Роттердам, Голландия) и

ректору Государственного университета-Высшей школы экономики —

профессору Ярославу Ивановичу Кузьминову: финансовая поддержка этого

проекта сыграла решающую роль в том, чтобы авторы смогли определить

для себя приоритетной задачей написание данного учебника. Мы

выражаем также свою признательность нашим коллегам: профессору

эконометрики Тилбургского университета и Высшей экономической школы

Лондона Яну Магнусу и профессору Государственного университета-Высшей

ПРЕДИСЛОВИЕ К ПЕРВОМУ ИЗДАНИЮ 19

школы экономики — Эмилю Борисовичу Ершову. Их внимание к

учебнику было постоянным (в процессе его написания), взыскательным и

одновременно доброжелательным. Высказанные ими замечания и советы,

бесспорно, способствовали улучшению качества рукописи. Существенное

влияние на замысел и содержание книги оказал опыт исследовательской

и педагогической работы авторов, их постоянные контакты с коллегами

по ЦЭМИ РАН, по научному семинару «Многомерный статистический

анализ и вероятностное моделирование реальных процессов». Без них и

без наших главных критиков и генераторов вопросов — многих поколений

студентов МГУ им. М. В.Ломоносова, МЭСИ, РЭШ, — эта книга вряд ли

появилась бы на свет. Мы благодарны Алле Павловне и Галине

Юрьевне Грохотовым за самоотверженный труд по подготовке оригинал-макета

рукописи книги, а также Николаю Владимировичу Третьякову и Елене

Владимировне Герасимовой за очень полезную и профессиональную

консультационную поддержку Грохотовых в этом объемном и непростом

производственном процессе. Что касается слабых мест и недостатков

учебника, то за них всю ответственность несут, естественно, только авторы.

Мы будем признательны читателям за их отзывы о книге и критические

замечания, направленные в издательство или непосредственно нам.

Москва-Роттердам-

деревня «Плужково» С. А. Айвазян

Московской области. В. С. Мхитарян

1996-1998 гг.

ПРЕДИСЛОВИЕ КО ВТОРОМУ ИЗДАНИЮ

Что побудило нас подготовить второе издание учебника? Во-первых,

весь пятитысячный тираж первого издания разошелся за неполные два

года несмотря на внушительный объем книги и относительно

специфическую область знаний, к которой она относится. Во-вторых, — это

наш опыт общения со студентами и коллегами-преподавателями. В

том, что учебник пользуется спросом у студентов, убеждает не

только статистика продаж, но и специальные анкетные обследования,

и информация, размещаемая на студенческих интернетовских сайтах

(см. www.sachok.ru). Что касается вузовских преподавателей

эконометрики, то прекрасную возможность общения с ними

предоставила одному из авторов серия специально организованных для них

семинаров в разных регионах России и бывших республик СССР, на которых

отечественные и зарубежные специалисты (в их числе — С.А. Айвазян)

представляли свои циклы лекций в рамках общей программы повышения

квалификации преподавателей по эконометрике. С 1997-го по 2001 год

такие семинары прошли в Москве (дважды), Санкт-Петербурге (дважды),

Екатеринбурге, Нижнем Новгороде, Сочи, Владивостоке, Воронеже,

Перми, Вильнюсе и других городах.

Второе издание выходит стереотипным, без серьезных

доделок или изменений. Устранены лишь обнаруженные (к сожалению, в

весьма большом количестве) опечатки и явные погрешности. Кроме

того, мы предложили издательству выпустить учебник в двух томах:

том 1 — «Теория вероятностей и прикладная статистика» (введение и

главы 1-13 первого издания); том 2 — «Основы эконометрики» (главы

14-17 первого издания). Поскольку материал второго тома подготовлен

полностью С.А. Айвазяном, этот том выходит только под его авторством.

Практика использования студентами и преподавателями первого издания

учебника подсказала нам, что двухтомный вариант книги может

оказаться более технологичным и удобным в использовании.

Отметим, что со временем несколько трансформируются

представления специалистов о самом предмете эконометрики, пополняется багаж его

методов, смещаются акценты. Не со всеми такими представлениями,

принятыми, скажем, в научных кругах США, согласны авторы этого учебни-

ПРЕДИСЛОВИЕ КО ВТОРОМУ ИЗДАНИЮ 21

ка. Там, например, принято включать в продвинутые курсы (и учебники)

по эконометрике «Теорию больших выборок» (или «Асимптотическую

теорию»), «Непараметрические и полупараметрические методы принятия

статистических решений», развернутое изложение ме!ода

максимального правдоподобия. С нашей точки зрения, вся эта тематика

традиционно представлена в качестве разделов в других самостоятельных научных

дисциплинах — теории вероятностей и математической статистике. В то

же время важнейшие для эконометрического анализа прикладные методы

многомерной статистики (дискриминантный и кластер анализы,

главные компоненты и др.) по непонятным для нас причинам отсутствуют

в эконометрических курсах и учебниках Северной Америки и Западной

Европы.

Следует, однако, признать, что во втором томе предлагаемого

издания представлены, конечно, далеко не все важнейшие разделы

современной эконометрики (поэтому этот том и называется «О с н о в ы

эконометрики»). В нем нет, например, обобщенного метода моментов, методов

анализа панельных данных, раздела, посвященного моделям с

урезанными и цензу pup ов анными выборками, недостаточно внимания уделено

проблемам исследования стационарности временного ряда и, в связи с этим,

приемам коинтеграции и анализу единичных корней

характеристического уравнения временного ряда. Подобным образом расширенный вариант

нашего второго тома составит, по существу, новый учебник, создание

которого входит в ближайшие планы одного из авторов.

Наконец, о задачах и упраженениях, которыми

необходимо оснастить аудиторные занятия со студентами по прикладной

статистике и эконометрике. Одновременно с выходом данного двухтомного

издания издательство «Юнити-Дана» публикует нашу книгу

«Прикладная статистика в задачах и упражнениях», которая является

естественным дополнением (задачником) к первому тому. Аналогичное дополнение

ко второму тому (задачник по эконометрике) один из авторов планирует

представить в течение ближайшего года.

В заключение хотим поблагодарить профессора Гарвардского

университета Дэйла Джоргенсона (Dale Jorgenson) за внимание, к книге и

очень полезные обсуждения, которые состоялись во время пребывания

С.А. Айвазяна в Гарвардском университете в апреле 2001г. Мы

благодарны также д-ру Джону Киммелу (John Kimmel) из

Североамериканского отделения издательства «Шпрингер-Верлаг» за организацию

рецензий западных специалистов на наш учебник. Мы искренне благодарны

преподавателям статистики и эконометрики различных вузов России и

Литвы — участникам упомянутых выше региональных семинаров по пре-

22 ПРЕДИСЛОВИЕ КО ВТОРОМУ ИЗДАНИЮ

подаванию эконометрики за полезные обсуждения отдельных фрагментов

учебника. Наконец, мы благодарны коллективам и руководству

Центрального экономико-математического института Российской академии наук и

Московского государственного университета экономики, статистики и

информатики, плодотворная профессиональная среда существенно помогла

нам в работе над учебником.

Москва, июнь 2001 г.

Введение

THO-

ие

ВВЕДЕНИЕ. ВЕРОЯТНОСТНО-СТАТИСТИЧЕСКИЕ

МЕТОДЫ В МОДЕЛИРОВАНИИ

СОЦИАЛЬНО-ЭКОНОМИЧЕСКИХ

ПРОЦЕССОВ И АНАЛИЗЕ ДАННЫХ

В.1. Математико-статистический

инструментарий экономических

исследовании

В.1.1, Назначение и составные части учебника

Бели экономист строит рассуждения и выводы, опираясь в своих

модельных построениях на результаты конкретных измерений

интересующих его экономических, социально-экономических и (или) демографиче:

ских показателей, то тем самым определяется эконометрический

подход к проблеме, а ирструментарий, которым он при этом пользуется,

обязательно содержит те или иные методы и модели прикладной

математической статистики. Ведь назначение эконометрики —

придавать конкретное количественное выражение общим (качественным)

закономерностям экономической теории на базе экономической статистики и

с использованием средств математической статистики (подробнее

определение эконометрики см. в п. 1.1 в томе 2).

Так вот, предлагаемый вниманию читателя учебник как раз и

посвящен описанию математико-статистического инструментария

экономических исследований. Почему же тогда не назвать этот учебник

просто «Методы эконометрики»? По-существу можно было бы считать такое

название этой книги вполне оправданным. Однако от такого решения

авторов удержали два обстоятельства.

Первое обстоятельство связано с установившимся традиционным

пониманием методов эконометрики, при котором они ограничивались

B.I ИНСТРУМЕНТАРИЙ ЭКОНОМИЧЕСКИХ ИССЛЕДОВАНИЙ 25

линейным регрессионным анализом (включающим классический и

обобщенный методы наименьших квадратов, случаи гетероскедастичных

и автокоррелированных регрессионных остатков, стохастических

объясняющих переменных, а также использование фиктивных и

инструментальных переменных), методами и моделями анализа временных

рядов (так называемые AR-, МА-, ARMA- и ARIMA-модели, а в

последние годы и модели коинтеграции, ARCH- и GARCH-модели) и, наконец,

системами одновременных уравнений. Этот набор традиционных

эконометрических методов описан во втором томе учебника.

Второе обстоятельство связано с первым и заключается в том, что

по своему назначению, по своим инструментальным возможностям

прикладная статистика — самостоятельная научная дисциплина,

обслуживающая значительно более широкий класс реальных задач статистического

анализа данных, чем тот, который традиционно непосредственно

связывается с эконометрикой. К таким задачам в сфере социально-экономической

теории и практики относятся, в частности:

• исследование динамики структуры состояний объектов

(демографической или социальной структуры общества, структуры типологии

потребительского поведения домашних хозяйств и т. п.);

• типологизация социально-экономических объектов (семей, фирм,

предприятий, регионов, стран и т. п.);

• построение интегральных индикаторов качества или

эффективности функционирования социально-экономической системы (уровня или

качества жизни, качества населения, эффективности функционирования

предприятия и т. п.);

• выявление скрытых (латентных) факторов, определяющих течение

того или иного социально-экономического процесса;

• исследование и моделирование генезиса анализируемых

статистических данных.

К традиционным экономическим задачам применения

эконометрических методов принято относить (эта точка зрения представлена,

например, в [Джонстон Дж., с. 16]) макромоделирование функционирования

национальной экономики (агрегированное, не агрегированное,

детализированное) или ее секторов. Традиционные приложения эконометрических

методов на лшкро-уровне сводятся обычно к моделированию поведения

потребителя, производителя и продавца, а также к моделированию

некоторых процессов, происходящих на финансовых рынках.

Современные университетские учебные планы подготовки

экономистов и экономистов-статистиков построены таким образом, чтобы

обеспечивать непрерывность и преемственность обучения по блокам дисци-

26 В. ВВЕДЕНИЕ

плин:

• гуманитарному;

• экономическому;

• предметной статистики;

• математико-статистического инструментария;

• информационных технологий.

В качестве обязательных компонентов в блоке

математико-статистического инструментария представлены курсы по элементарным

методам статистического анализа данных (или дескриптивной

статистике), теории вероятностей^ математической статистике,

прикладной статистике (или многомерным статистическим методам),

эконометрике. Данный учебник посвящен взаимосвязному изложению всех

упомянутых дисциплин блока математико-статистического инструментария.

В.1.2. Прикладная статистика

Нужно ли использовать этот термин или можно ограничиться более

привычным понятием «математическая статистика»? Как соотносится

прикладная статистика с другими статистическими дисциплинами,

такими, как «математическая статистика», «анализ данных», «методы

эконометрики»? Для обоснования правомерности и целесообразности

рассмотрения прикладной статистики как самостоятельной научной дисциплины

следует упомянуть, как минимум, о двух моментах.

Во-первых, до сих пор развитие теории, методологии и практики

статистической обработки анализируемых данных шло по существу в двух

параллельных направлениях. Одно из них представлено методами,

предусматривающими возможность вероятностной интерпретации

обрабатываемых данных и полученных в результате обработки

статистических выводов. Именно эти методы и составляют содержание

подавляющего большинства монографий и руководств по математической

статистике. Другими словами, под методами математической статистики принято

понимать лишь те методы статистической обработки исходных данных,

разработка и использование которых апеллируют к вероятностной

природе этих данных,1 При этом развиваемый в рамках второго направления

1 Такова ситуация, сложившаяся лишь de facto. Формально же, de jure, если исходить

из определения Большого энциклопедического словаря (М., Большая Российская

энциклопедия, 1997, с. 701), математическая статистика понимается более широко, а

именно как «наука о математических методах систематизации и использования

статистических данных для научных и практических выводов. Во многих своих

разделах математическая статистика опирается на теорию вероятностей, позволяющую

B.I ИНСТРУМЕНТАРИЙ ЭКОНОМИЧЕСКИХ ИССЛЕДОВАНИЙ 27

весьма широкий и актуальный класс методов статистической

переработки исходной информации, а именно вся совокупность тех методов, которые

априори не опираются на вероятностную природу обрабатываемых

данных (представителями методов такого типа являются, например,

разнообразные методы кластер-анализа, многомерного шкалирования, теории

измерений и др.)) остается за общепринятыми рамками научной

дисциплины «математическая статистика».

Во-вторых, специалисты, занимающиеся разработкой и конкретными

применениями методов статистической обработки исходной информации,

не могут игнорировать ту внушительную дистанцию, которая разделяет

момент успешного завершения разработки собственно математического

метода и момент получения результата от использования этого метода в

решении конкретной практической задачи. В процессе прохождения этой

трудной дистанции математику-прикладнику приходится, в частности:

• глубоко вникать в содержательную сущность задачи, адекватно

«прилаживать» исходные модельные допущения (на которых строится

любой математический метод) к выяснению сущности реальной задачи;

• решать задачу преобразования имеющейся исходной информации к

стандартной (унифицированной) форме записи обрабатываемых

статистических данных;

• разрабатывать практически реализуемые вычислительные

алгоритмы и программное обеспечение с учетом специфики обрабатываемой

статистической информации и возможностей имеющейся

вычислительной техники.

Понятийный аппарат, методы и результаты, позволяющие проходить

эту дистанцию, вместе с этапом «прилаживания» и доработки

необходимого математического инструментария и составляют главное

содержание прикладной статистики.

Таким образом, мы приходим к определению прикладной

статистики как самостоятельной научной дисциплины, разрабатывающей и

систематизирующей понятия, приемы, математические методы и

модели, предназначенные для организации сбора , стандартной записи, си-

оценить надежность и точность выводов, делаемых на основании ограниченного

статистического материала».

1 Говоря об «организации сбора» статистических данных, мы имеем в виду лишь

определение способа отбора подлежащих статистическому обследованию единиц (семей,

предприятий, стран, пациентов и т.п.) из всей исследуемой совокупности (см. п.6.1,

а также в п. 9.1 описание типа 2). Мы не включаем сюда разработку методологии

измерителей анализируемых свойств отображаемого объекта: эта работа

предполагает профессиональное (экономическое, техническое, медицинское и т.п.) изуче-

28 В. ВВЕДЕНИЕ

стематизации и обработки статистических данных с целью их

удобного представления, интерпретации и получения научных и практических

выводов.

Для определения той же самой системы понятий, приемов,

математических методов и моделей некоторые специалисты используют термин

«анализ данных», понимаемый в расширительном толковании. Описанию

методов прикладной статистики, выходящих за традиционные рамки

методов эконометрики и одновременно наиболее актуальных для

экономических и социально-экономических приложений, посвящен раздел III данного

учебника.

В.1.3. Теория вероятностей и математическая статистика

Эти две дисциплины основные «доставщики» математического

инструментария для прикладной статистики и эконометрики.

«Теория вероятностей — наука, позволяющая по вероятностям

одних случайных событий находить вероятности других случайных

событий, связанных каким-либо образом с первыми ... Можно также

сказать, что теория вероятностей есть математическая наука,

выясняющая закономерности, которые возникают при взаимодействии

большого числа случайных факторов» (Математическая энциклопедия, М.,

Советская энциклопедия, 1976, т. 1, с. 655-656). Подчеркнем, что

упомянутые в определении закономерности формулируются в терминах модельных

соотношений.

Идеальной средой применимости теоретико-вероятностного способа

рассуждения (и соответствующего математического аппарата) является

ситуация, когда мы находимся в условиях стационарного (т. е. не

изменяющегося во времени) действия некоторого реального комплекса условий,

включающего в себя неизбежность «мешающего» влияния большого

числа случайных (не поддающихся строгому учету и контролю) факторов,

которые в свою очередь не позволяют делать полностью достоверные

выводы о том, произойдет или не произойдет интересующее нас событие.

При этом предполагается, что мы имеем принципиальную возможность

(хотя бы мысленно реально осуществимую) многократного повторения

нашего эксперимента или наблюдения в рамках того же самого реального

комплекса условий. Именно такую ситуацию принято называть

условиями действия статистического ансамбля или условиями соблюдения ста-

ние сущности задач, для решения которых требуется статистическая информация,

а потому она относится к компетенции предметной статистики соответствующей

области.

В.2 ТЕОРЕТИКО-ВЕРОЯТНОСТНЫЙ СПОСОБ РАССУЖДЕНИЯ 29

тистической однородности исследуемой совокупности (подробнее об этом

см. п. В.2).

Необходимый для нормального понимания методов прикладной

статистики и эконометрики минимум сведений из теории вероятностей

приводится в разделе I данного учебника.

Одно из возможных определений математической статистики

приведено в п. В.1.2 (см. сноску на с. 26). Добавим к этому, что

математическая статистика, являясь по отношению к прикладной статистике и

эконометрике разработчиком и поставщиком существенной части

используемого в них математического аппарата, полностью отстранена от таких

функций этих прикладных дисциплин, как:

• «прилаживание» и доработка необходимого математического

инструментария в соответствии со спецификой анализируемого класса

реальных социально-экономических задач;

• разработка невероятностных (логико-алгебраических,

оптимизационных и др.) методов анализа и моделирования реальных исходных

данных, т.е. методов, не опирающихся на модельные допущения о

вероятностной природе этих данных;

• преобразование разнообразных форм исходных

социально-экономических данных с целью их удобного представления для дальнейшего

анализа и моделирования;

• разработка практически реализуемых вычислительных алгоритмов и

удобного программного обеспечения для используемых в ходе эконо-

метрического анализа методов и моделей.

Раздел II учебника посвящен изложению основных результатов

математической статистики, включая элементарные методы статистического

анализа данных (методы дескриптивной статистики).

В.2. Теоретико-вероятностный способ

рассуждения в прикладной статистике

и эконометрике

В.2.1. Границы применимости теоретико-вероятностного

способа рассуждения

В п. В. 1.2 упоминалось о двух подходах к статистическому анализу

данных: математико-статистическом, основанном на вероятностном

способе рассуждения, и логико-алгебраическом. Ко второму подходу

исследователь вынужден обращаться лишь тогда, когда условия сбора (регистра-

30 В. ВВЕДЕНИЕ

ции) исходных данных не укладываются в рамки так называемого

статистического ансамбля, т.е. в ситуациях, когда не имеется

практической или хотя бы принципиально мысленно представимой возможности

многократного тождественного воспроизведения основного комплекса

условий, при которых производились измерения анализируемых данных.

В условиях же статистического ансамбля исследователь имеет

возможность воспользоваться классическими математико-статистическими

методами обработки данных, когда для обоснования наилучшего выбора

методов статистической переработки, итогового представления и

интерпретации анализируемых данных он использует те или иные априорные

сведения об их случайной (стохастической) природе. При этом мы

исходим из того, что даже постулируемая нами тождественность

воспроизведения основного комплекса условий эксперимента или наблюдения в

большинстве реальных ситуаций (с учетом их сложности,

множественности и частичной неизученности формирующих их факторов) не избавляет

нас от неконтролируемого (случайного) разброса в самих результатах

наблюдения. Так, даже практически идеально отлаженный станок

автоматической линии не в состоянии производить абсолютно идентичные

между собой (и заданному номиналу) изделия. В аналогичных условиях

статистического ансамбля и соответствующего неконтролируемого

разброса изучаемых показателей или событий мы окажемся, например, при

изучении числа дефектных изделий в партиях заданного объема,

отбираемых от массовой продукции и производимых в стационарном режиме

производства, или при регистрации среднедушевого дохода семей,

случайно отбираемых из некоторой однородной (в социальном, географическом и

экономическом смысле) совокупности, и т. д.

Именно разнообразные математические модели таких скрытых

закономерностей вместе с теоретическим и эмпирическим анализом их свойств

и взаимоотношений и предоставляют исследователю теория

вероятностей и математическая статистика.

Наиболее простые и убедительные примеры реальных ситуаций,

подчиняющихся требованию статистической устойчивости (или

укладывающихся в рамки статистического ансамбля), предоставляет нам область

азартных игр. Действительно, подбрасывая монету, бросая игральную

1 Исторически именно эта область существенно стимулировала зарождение и развитие

элементов теоретико-вероятностной научной дисциплины. Первые достаточно

интересные результаты теории вероятностей принято связывать с работами Л. Пачоли

(«Сумма арифметики, геометрии, учения .о пропорциях и отношениях», 1494 г.),

Д. Кардано («Книга об игре в кости», 1526 г.) и Н.Тартальи («Общий трактат

о числе и мере» 1556-1560 гг.). См. [МайстровЛ. Б., с. 6, 25-37].

В.2 ТЕОРЕТИКО-ВЕРОЯТНОСТНЫЙ СПОСОБ РАССУЖДЕНИЯ 31

кость или вытягивая наугад карту из колоды и интересуясь при этом

вероятностью осуществления события, заключающегося соответственно в

появлении «герба», «шестерки» или «дамы пик», мы имеем все

основания полагать, что

а) можно многократно повторить тот же самый эксперимент в тех же

самых условиях;

б) наличие большого числа случайных факторов, характеризующих

условия проведения каждого такого эксперимента, не позволяет делать

полностью определенного (детерминированного) заключения о том,

произойдет в результате данного эксперимента интересующее нас событие

или не произойдет;

в) чем большее число однотипных экспериментов мы произведем, тем

ближе будут подсчитанные по результатам экспериментов относительные

частоты появления интересующих нас событий к некоторым постоянным

величинам, называемым вероятностными для этих событий, а именно:

относительная частота появления «герба» будет приближаться к 1/2,

выпадения «шестерки» — к 1/6, а извлечения «дамы пик» (из колоды,

содержащей 52 карты) — к 1/52.

Очевидно, требования статистического ансамбля применительно к

указанным выше трем типам экспериментов означают необходимость

использования одной и той же (или совершенно идентичных)

симметричной монеты, Симметричной кости, а в последнем случае — необходимость

возвращения извлеченной в предыдущем эксперименте карты в колоду и

тщательного случайного перемешивания последней.

Соблюдение условий статистического ансамбля в более серьезных и

сложных сферах человеческой деятельности — в экономике, в

социальных процессах, в технике и промышленности, в медицине, в различных

отраслях науки — это вопрос, требующий специального рассмотрения в

каждом конкретном случае.

Оценивая специфику задач в различных областях человеческого

знания с позиции соблюдения в них свойств а)-в) статистической

устойчивости и принимая во внимание накопившийся опыт вероятностно-

статистических приложений, можно условно разбить все возможные

приложения на три категории.

К первой категории возможных областей применения — категории

высокой работоспособности вероятностно-статистических

методов — отнесем те ситуации, в которых свойства а)-в) статистической

устойчивости исследуемой совокупности бесспорно имеют место либо

нарушаются столь незначительно, что это практически не влияет на

точность статистических выводов, полученных с использованием теоретико-

ог в. введение

вероятностных моделей. Сюда (помимо упоминавшейся «игровой»

области) могут быть отнесены отдельные разделы экономики и социологии и

в первую очередь задачи, связанные с исследованием поведения объекта

(индивидуума, семьи или другой социально-экономической или

производственной единицы) как представителя большой однородной совокупности

подобных же объектов. Традиционной областью эффективного

использования вероятностно-статистического аппарата давно стала демография.

Теоретико-вероятностные понятия являются основным языком в таких

инженерных областях, как теория надежности систем, состоящих из очень

большого числа элементов, и теория выборочного контроля качества

продукции. В медицине вероятностно-статистический подход позволил

ввести понятие факторов риска развития основных хронических

заболеваний и провести количественное изучение их влияния, способствуя тем

самым большей индивидуализации, а значит, и эффективности

профилактики и лечения. Результаты специальных вероятностно-статистических

исследований выявили, что вероятность дожить до определенного

возраста подвержена не слишком значительным колебаниям (в зависимости от

условий жизни). Эти результаты и послужили основой составления так

называемых таблиц выживаемости^ в определенной мере и в

определенном смысле (а именно, в среднестатистическом, но не в индивидуальном,

конечно!) поколебавшим известное древнее изречение «никто не знает

часа своей смерти». Вероятностно-статистический способ рассуждения

играет видную роль в исследованиях, проводимых в современной физике

(в первую очередь в статистической физике) и в классической механике

(в статистической теории газов).

Отметим одну важную общую черту, характеризующую

подавляющее большинство задач перечисленных выше областей человеческой

деятельности, в которых оказывается правомерным и эффективным

применение вероятностно-статистических методов. Речь идет о существенной

многомерности обрабатываемой информации, характеризующей

исследуемые явления или объекты, т.е. о ситуациях, когда состояние или

поведение каждого из этих объектов в любой фиксированный момент времени

описывается набором соответствующих показателей. Среди этих

показателей могут быть как количественные (среднедушевой доход в семье,

размер семьи, объем валовой продукции предприятия и т. д.), так и не

количественные, т.е. ранговые (классификация специалиста, сравнительная

характеристика жилищных условий) и классификационные, или

номинальные (профессия, национальность,- нол, причины миграции и т. п.). Все эти

показатели находятся в сложной взаимосвязи друг с другом. Именно в

таких ситуациях принято говорить о многомерности исследуемой схемы, а

В.2 ТЕОРЕТИКО-ВЕРОЯТНОСТНЫЙ СПОСОБ РАССУЖДЕНИЯ 33

исследователю приходится обращаться к методам многомерного

статистического анализа.

Ко второй категории возможных областей применения — категории

допустимых вероятностно-статистических приложений —

отнесем ситуации, характеризующиеся весьма значительными нарушениями

требования сохранения неизменными условий эксперимента (вторая

половина требования а)) и вытекающими отсюда отклонениями от требования

в). Характерной формой такого рода отклонений от условий

статистического ансамбля является объединение в одном ряду наблюдений

(подлежащих обработке) различных порций исходных данных,

зарегистрированных в разных условиях (в разное время или в разных совокупностях). К

этой же категории приложений можно отнести определенный класс

задач, связанных с анализом коротких временных рядов,

зарегистрированных в условиях, практически исключающих возможность статистической

фиксации сразу нескольких эмпирических реализаций исследуемого

временного ряда на одном и том же временном интервале. Использование

вероятностно-статистических методов обработки в этом случае

допустимо, но должно сопровождаться пояснениями о несовершенстве и

приближенном характере получаемых при этом выводов (например, не следует

слишком доверять в подобных ситуациях различным числовым

характеристикам Степени достоверности этих выводов, т.е. доверительным

вероятностям, уровням значимости критерия и т.п.) и по возможности

должно дополняться другими методами научного анализа.

И наконец, к третьей категории задач статистической

обработки исходных данных — категории недопустимых вероятностно-

статистических приложений — следует отнести ситуации,

характеризующиеся либо принципиальным неприятием главной идеи понятия

статистического ансамбля — массовости исследуемой совокупности (т. е.

конкретной бессодержательностью идеи многократного повторения одного и

того же эксперимента в неизменных условиях, сформулированной в

требовании а)), либо полной детерминированностью изучаемого явления,

т.е. — отсутствием «мешающего» влияния множества случайных

факторов (нарушение требования б)). В подобных ситуациях исследователь

должен пользоваться методами анализа данных (см. [ДидеЭ. и др.]) и не

должен претендовать на вероятностную интерпретацию обрабатываемых

данных и получаемых в результате их обработки выводов.

Строгих математических методов, позволяющих точно определять,

находимся ли мы в условиях статистического ансамбля, не существует:

любая вероятностная модель, так же как и любая математическая модель

вообще, есть лишь некоторая аппроксимация исследуемой реальной дей-

2 Теория вероятностей

и прикладная статистика

34 В. ВВЕДЕНИЕ

ствительности. Можно говорить лишь о ситуациях, очевидно

укладывающихся в рамки статистического ансамбля (бросание монеты, игральной

кости; контроль продукции массового производства, работающего в

отлаженном стационарном режиме, и т. п.), укладывающихся в эти рамки

лишь приблизительно, с оговорками, и явно не соответствующих условиям

статистического ансамбля. Однако даже с последней категорией ситуаций

(названных у нас категорией недопустимых вероятностно-статистических

приложений) нет полной ясности. Так, например, с позиций

статистического ансамбля события типа «в 2050 г. начнется война между странами

А н В» явно не относятся к сфере возможных применений вероятностно-

статистических методов — налицо нарушение требования а)!

Однако существует концепция так называемых субъективных

вероятностей, в рамках которой оказывается правомерным говорить и о

вероятности таких событий. Для этого следует прибегнуть к помощи

экспертов и вместо действительной многократной реализации интересующего

нас эксперимента в одних и тех же условиях ограничиться

воображаемой прогонкой исследуемой ситуации «через сознание» многих экспертов.

При этом, очевидно, эксперт интерпретируется как некий

измерительный прибор, работающий со случайной ошибкой. Точность работы этого

«измерительного прибора», т.е. точность «прочтения» (в сознании

эксперта) исхода интересующего нас события в будущем, очевидно, зависит

как от степени объективного влияния «мешающих» случайных/

факторов (т. е. от степени временной отдаленности интересующего нас момента

времени, общей сложности ситуации и т. п.), так и от степени

осведомленности, компетентности и других субъективных качеств самого эксперта.

Мы не собираемся здесь вмешиваться в спор между субъективистской и

классической вероятностными концепциями. Останемся на той точке

зрения, что единственным объективным судьей в подобных вопросах может

быть лишь критерий практики. В этой связи уместно напомнить

читателю следующие слова Ф. Энгельса из «Анти-Дюринга»: «... Математика,

вообще столь строго нравственная, совершила грехопадение: она

вкусила от яблока познания, и это открыло ей путь к гигантским успехам, но

вместе с тем и к заблуждениям. Девственное состояние абсолютной

значимости, неопровержимой доказанности всего математического навсегда

ушло в прошлое; наступила эра разногласий, и мы дошли до того, что

большинство людей дифференцирует и интегрирует не потому, что люди

понимают, что они делают, а просто потому, что верят в это, так как до

сих пор результат всегда получался правильным»

1 М а р к с К., Энгельс Ф. Соч., т. 20, с. 89.

В.2 ТЕОРЕТИКО-ВЕРОЯТНОСТНЫЙ СПОСОБ РАССУЖДЕНИЯ 35

Резюмируя содержащееся в данном пункте обсуждение сущности,

назначения и границ применимости теории вероятностей, мы можем через

полтора века после замечательного французского ученого Лапласа

повторить, более обоснованно и убедительно, что «замечательно, что наука,

которая начала с изучения игр, возвысилась до наиболее важных

предметов человеческого знания» .

В.2.2. Что дает объединение теоретико-вероятностного и

статистического способов рассуждения?

Теперь попытаемся на простом примере показать преимущества

вероятностно-статистического (или математико-статистического)

способа принятия решения, его отличие как от чисто статистического, так и

от чисто теоретико-вероятностного.

Статистический способ принятия решения. Пусть читатель

представит себя наблюдающим за игрой двух лиц в кости,

происходящей по следующим правилам. Производится 4 последовательных бросания

игральной кости. Игрок А получает одну денежную единицу от игрока 2?,

если в результате этих четырех бросаний хотя бы один раз выпало шесть

очков (назовем этот исход «шесть»), и платит одну денежную единицу

игроку В в противном случае (назовем этот исход «не шесть»). После

ста туров читатель должен сменить одного из игроков, причем он имеет

право выбрать ситуацию, на которую он будет ставить свою денежную

единицу в следующей серии туров: за появление хотя бы одной

«шестерки» или против. Как правильно осуществить этот выбор?

Статистический способ решения этой задачи диктуется обычным

здравым смыслом и заключается в следующем. Пронаблюдав сто туров

игры предыдущих партнеров и подсчитав относительные частоты их

выигрыша, казалось бы, естественно поставить на ту ситуацию, которая

чаще возникала в процессе игры. Например, было зафиксировано, что в 52

партиях из 100 выиграл игрок В, т. е. в 52 турах из 100 «шестерка» не

выпадала ни разу при четырехкратном выбрасывании кости (соответственно

в остальных 48 партиях из ста осуществлялся исход «шесть»).

Следовательно, делает вывод читатель, применивший статистический способ

рассуждения, выгоднее ставить на исход «не шесть», т. е. на тот исход,

относительная частота появления которого (р) равна 0,52 (больше

половины).

2 См.: Oeuvres completes de Laplace. T. 7: «Theorie analytique des probabilites». Paris,

Gauthier-Villars, 1886, p/CLII.

2*

36 В. ВВЕДЕНИЕ

Теоретико-вероятностный способ решения. Этот способ

основан на определенной математической модели изучаемого явления:

полагая кость правильной (т.е. симметричной), а следовательно, принимая

шансы выпадения любой грани кости при одном бросании равными между

собой (другими словами, относительная частота, или вероятность,

выпадения «единицы» равна относительной частоте выпадения «двойки» и

т.д... равна относительной частоте выпадения «шестерки» и равна 1/6),

можно подсчитать вероятность Р {«не шесть»} осуществления ситуации

«не шесть», т.е. вероятность события, заключающегося в том, что при

четырех последовательных бросаниях игральной кости ни разу не

появится «шестерка». Этот расчет основан на следующих фактах, вытекающих

из принятой нами математической модели. Вероятность не выбросить

шестерку при одном бросании кости складывается из шансов появиться в

результате одного бросания «единице», «двойке», «тройке», «четверке»

и «пятерке» и, следовательно, составляет (в соответствии с определением

вероятности любого события, см. п. 1.1) 5/6. Затем используем теорему

умножения вероятностей (см. п. 1.1.3), в соответствии с которой

вероятность наступления нескольких независимых событий равна произведению

вероятностей этих событий. В нашем случае мы рассматриваем факт

наступления четырех независимых событий, каждое из которых

заключается в невыпадении «шестерки» при одном бросании и имеет вероятность

осуществления, равную 5/6. Поэтому

5 5 5 5

р = Р {<не шесть>} = -.-.-•-

625

1296

Как видно, вероятность ситуации «не шесть» оказалась меньше

половины, следовательно, шансы ситуации «Шесть» предпочтительнее

(соответствующая вероятность равна: 1 - 0,482 = 0,518). А значит,

читатель, использовавший теоретико-вероятностный способ рассуждения,

придет к диаметрально противоположному по сравнению с читателем со

статистическим образом мышления решению и будет ставить в игре на

ситуацию «шесть».

Вероятностно-статистический (или математико-статисти-

ческий) способ принятия решения. Этот способ как бы синтезирует

инструментарий двух предыдущих, так как при выработке с его

помощью окончательного вывода используются и накопленные в результате

наблюдения за игрой исходные статистические данные (в виде

относительных частот появления ситуаций «шесть» и «не шесть», которые,

В.2 ТЕОРЕТИКО-ВЕРОЯТНОСТНЫЙ СПОСОБ РАССУЖДЕНИЯ 37

как мы помним, были равны соответственно 0,48 и 0,52), и теоретико-

вероятностные модельные соображения. Однако модель, принимаемая в

данном случае, менее жестка, менее ограниченна, она как бы

настраивается на реальную действительность, используя для этого накопленную

статистическую информацию. В частности, эта модель уже не

постулирует правильность используемых костей, допуская, что центр тяжести

игральной кости может быть и смещен некоторым специальным образом.

Характер этого смещения (если оно есть) должен как-то проявиться в тех

исходных статистических данных, которыми мы располагаем. Однако

читатель, владеющий вероятностно-статистическим образом мышления,

должен отдавать себе отчет в том, что полученные из этих данных

величины относительных частот исходов «шесть» и «не шесть» дают лишь

некоторые приближенные оценки истинных (теоретических) шансов той и

другой ситуации: ведь подбрасывая, скажем, 10 раз даже идеально

симметричную монету, мы можем случайно получить семь выпадений «гербов»;

соответственно относительная частота выпадения «герба», подсчитанная

по этим результатам испытаний, будет равна 0,7; но это еще не значит,

что истинные (теоретические) шансы (вероятности) появления «герба»

и другой стороны монеты оцениваются величинами соответственно 0,7 и

0,3 — эти вероятности, как мы знаем, равны 0,5. Точно так же

наблюденная нами в серии из ста игровых туров относительная частота исхода

«не шесть» (равная 0,52) может отличаться от истинной (теоретической)

вероятности того же события и, значит, может не быть достаточным

основанием для выбора этой ситуации в игре! Весь вопрос в том, насколько

сильно может отличаться наблюденная (в результате осуществления п

испытаний) относительная частота рп интересующего нас события от

истинной вероятности р появления этого события и как это отличие, т.е.

погрешность рп - р, зависит от числа п имеющихся в нашем

распоряжении наблюдений? (интуитивно ясно, что чем дольше мы наблюдали за

игрой, т. е. чем больше общее число п использованных нами наблюдений,

тем больше доверия заслуживают вычисленные нами эмпирические

относительные частоты рп, т.е. тем меньше их отличие от неизвестных нам

истинных значений вероятностей р.) Ответ на этот вопрос можно

получить в нашем случае, если воспользоваться рядом модельных

соображений: а) интерпретировать реализацию любого числа игровых партий как

последовательность так называемых испытаний Бернулли, что означает,

что результат каждого тура никак не зависит от результатов

предыдущих туров, а неизвестная нам вероятность р осуществления ситуации «не

шесть» остается одной и той же на протяжении всех туров игры; б)

использовать тот факт, что поведение случайно меняющейся (при повторе-

38 В. ВВЕДЕНИЕ

ниях эксперимента) погрешности Ап = рп — р приближенно описывается

законом нормального распределения вероятностей со средним значением,

равным нулю, и дисперсией, равной рA ~р)/п (см. п. 3.1.5).

Эти соображения, в частности, позволяют оценить абсолютную

величину погрешности |ДЛ|, которую мы можем допустить, заменяя

неизвестную величину р вероятности интересующего нас события (в нашем

случае — исхода «не шесть») относительной частотой рп этого события,

зафиксированной в серии из п испытаний (в нашем случае п = 100, а

р100 = 0,25). Бели же мы смогли численно оценить абсолютную величину

возможной погрешности Ап, то естественно применить следующее

правило принятия решения: если относительная частота рп появления исхода

«не шесть» больше половины и продолжает превосходить 0,5 после

вычитания из нее возможной погрешности |АП|, то выгоднее ставить на «не

шесть»; если относительная частота рп меньше половины и продолжает

быть меньше 0,5 после прибавления к ней возможной погрешности |АП|,

то выгоднее ставить на «шесть»; в других случаях у наблюдателя нет

оснований для статистического вывода о преимуществах того или

иного выбора ставки в игре (т. е. надо либо продолжить наблюдения, либо

участвовать в игре с произвольным выбором ставки, ожидая, что это не

может привести к сколь-нибудь ощутимому выигрышу или проигрышу).

Приближенный подсчет максимально возможной величины этой

погрешности, опирающийся на модельное соображение б) (т.е. теорему

Муавра-Лапласа, см. п. 4.3), дает в рассматриваемом примере, что с

практической достоверностью, а именно с вероятностью 0,95, справедливо

неравенство

/^S. (B.I)

Возведение (B.I) в квадрат и решение получившегося квадратного

неравенства относительно неизвестного параметра р дает

1+t

Рп+*

1+i '

или, с точностью до величин порядка малости выше, чем 1/у/п:

Рп-2

и V п

В.2 ТЕОРЕТИКО-ВЕРОЯТНОСТНЫЙ СПОСОБ РАССУЖДЕНИЯ 39

В данном случае (при рп = 0,52 и п = 100) получаем

IДп| « 2у/РпA-Рп)/>/й = 2v/0,52.(l-0,52)A/l06« 0,10.

Следовательно,

0,52-0,10<р<0,52 + 0,10.

Таким образом, имеющиеся в нашем распоряжении наблюдения за