Author: Девянин П.Н.

Tags: управление предприятиями, организация производства, торговли и транспорта компьютерные системы и сети информационная безопасность

ISBN: 5-7695-2053-1

Year: 2005

Text

УДК 65.012.810(075.8)

ББК 32.973.202я73

Д259

Рецензенты:

канд. техн, наук, зав. кафедрой Информационной безопасности

МИЭМ А. Б. Лось-, канд. техн, наук, доцент МИФИ А. И. Толстой’,

канд. техн, наук, доцент МИФИ В. А. Петров

Девянин П. Н.

Д259 Модели безопасности компьютерных систем: Учеб, посо-

бие для студ. высш. учеб, заведений / Петр Николаевич Девя-

нин. — М.: Издательский центр «Академия», 2005. — 144 с.

ISBN 5-7695-2053-1

Рассмотрены с полными доказательствами положения основных мо-

делей безопасности компьютерных систем: дискреционного, мандатно-

го, ролевого разграничений доступа, безопасности информационных по-

токов, изолированной программной среды. Приведен используемый в

рассматриваемых моделях математический аппарат.

Учебное пособие разработано при содействии Академии криптогра-

фии Российской Федерации.

Для студентов высших учебных заведений. Может быть полезно специ-

алистам в области защиты информации.

УДК 65.012.810(075.8)

ББК 32.973.202я73

Оригинал-макет данного издания является собственностью

Издательского центра «Академия», и его воспроизведение любым способом

без согласия правообладателя запрещается

©Девянин П.Н., 2005

© Образовательно-издательский центр «Академия», 2005

ISBN 5-7695-2053-1 © Оформление. Издательский центр «Академия», 2005

ПРЕДИСЛОВИЕ

В настоящее время имеется достаточно много литературы, в

том числе учебной, в которой приводятся обзоры и описания раз-

личных моделей безопасности компьютерных систем. В то же вре-

мя их изложение, как правило, носит фрагментарный характер.

Основное внимание в имеющейся литературе уделяется лишь об-

щей формулировке основных определений и результатов моделей

безопасности либо краткому их перечислению обзорного характе-

ра (без подробного рассмотрения, применяемого математическо-

го аппарата и приведения доказательств). В то же время в книгах,

где доказательства приводятся, они, как правило, даются в об-

щих чертах.

В данном учебном пособии рассмотрены с полными доказа-

тельствами положения ряда основных моделей безопасности ком-

пьютерных систем. Приведен используемый в рассматриваемых

моделях математический аппарат.

Учебное пособие разработано при содействии Академии крип-

тографии Российской Федерации.

Учебное пособие предназначено для дисциплин «Теоретиче-

ские основы компьютерной безопасности», «Безопасность опе-

рационных систем», «Безопасность вычислительных систем» по

специальностям 075200 «Компьютерная безопасность» и 075500

«Комплексное обеспечение информационной безопасности ав-

томатизированных систем» и для дисциплины «Основы компью-

терной безопасности» для непрофилирующих специальностей.

Учебное пособие написано на основе десятилетнего опыта пре-

подавания перечисленных дисциплин в Институте криптографии,

связи и информатики (ИКСИ).

ГЛАВА 1

ОСНОВНЫЕ ПОНЯТИЯ И ОПРЕДЕЛЕНИЯ,

ИСПОЛЬЗУЕМЫЕ ПРИ ОПИСАНИИ МОДЕЛЕЙ

БЕЗОПАСНОСТИ КОМПЬЮТЕРНЫХ СИСТЕМ

1.1. ЭЛЕМЕНТЫ ТЕОРИИ ЗАЩИТЫ ИНФОРМАЦИИ

1.1.1. Объект, субъект, доступ

Дадим основные определения на основе [2].

Используем следующие обозначения:

А — конечный алфавит;

А* — множество слов конечной длины в алфавите А;

Я с А* — язык описания информации, являющийся множе-

ством слов, выделенных по определенным правилам из А.

Аксиома 1.1. Любая информация в компьютерной системе пред-

ставляется словом в некотором языке Я.

Определение 1.1. Объект относительно языка Я (или просто

объект) — произвольное конечное множество слов языка Я.

Определение 1.2. Преобразование информации — отображе-

ние, заданное на множестве слов языка Я.

Описание преобразования также является словом.

Для выполнения преобразования информации в компьютер-

ных системах требуется время, поэтому каждое преобразование

может или выполняться, или храниться. В первом случае описание

преобразования взаимодействует с другими ресурсами компью-

терной системы. Во втором случае, как правило, речь идет о хра-

нении описания преобразования в некотором файле.

Определение 1.3. Субъект — объект, описывающий преобразо-

вание, которое выполняется в компьютерной системе.

Используем следующие обозначения:

О — множество объектов системы;

А — множество субъектов системы (А с О).

Определение 1.4. Информационным потоком от объекта о (ис-

точника) к объекту о' (приемнику) назовем преобразование ин-

формации в объекте о', зависящее от информации в объекте о.

Субъект для выполнения преобразования использует инфор-

мацию, содержащуюся в объектах компьютерной системы, т.е.

осуществляет к ним доступ. Основными видами доступа являются:

• доступ субъекта к объекту на чтение (read)-,

• доступ субъекта к объекту на запись (write), при этом воз-

можно уничтожение информации, имевшейся в объекте;

4

• доступ субъекта к объекту на активизацию (execute), при

этом инициируется выполнение (производится активизация) в

компьютерной системе преобразования информации, описан-

ного в объекте.

Определение 1.5. В каждом состоянии компьютерной системы

на множестве субъектов введем бинарное отношение а активиза-

ции: выполняется Sj a s2, где sb s2 е А, если субъект sb выполняя

описанное в нем преобразование информации, инициирует вы-

полнение преобразования информации, описанного в субъекте 52-

Определение 1.6. В каждом состоянии компьютерной системы

определим ориентированный граф активизации G = (S, Е), где

5” — вершины графа; Е — ребра графа, соединяющие субъектов,

связанных бинарным отношением активизации.

Очевидно, что граф активизации представляет собой множе-

ство деревьев, или лес (см. подразд. 1.2).

Определение 1.7. Пользователи — субъекты компьютерной си-

стемы, соответствующие корням деревьев графа активизации.

В критериях оценки защищенности компьютерных систем

TCSEC [23] («Оранжевая книга») приводится основная аксиома

теории защиты информации, позволяющая выделить элементы

компьютерной системы, необходимые для анализа ее безопас-

ности.

Аксиома 1.2 (основная аксиома теории защиты информации). Все

вопросы безопасности информации описываются доступами

субъектов к объектам.

1.1.2. Классификация угроз безопасности информации

Определение 1.8. Угроза безопасности информации (компью-

терной системы) — потенциально возможное воздействие на ин-

формацию (компьютерную систему), которое прямо или косвен-

но может нанести урон пользователям или владельцам информа-

ции (компьютерной системы).

При классификации угроз выделяют три основных свойства

безопасности информации [6].

Определение 1.9. Конфиденциальность информации — субъек-

тивно определяемая характеристика информации, указывающая

на необходимость введения ограничений на круг субъектов, име-

ющих доступ к данной информации.

Определение 1.10. Целостность информации — свойство ин-

формации, заключающееся в ее существовании в неискаженном

виде (неизменном по отношению к некоторому фиксированному

ее состоянию).

Определение 1.11. Доступность информации — свойство ком-

пьютерной системы (среды, средств и технологии обработки), в

5

которой циркулирует информация, характеризующееся способ-

ностью обеспечивать своевременный беспрепятственный доступ

субъектов к интересующей их информации и готовность соответ-

ствующих автоматизированных служб к обслуживанию поступа-

ющих от субъектов запросов всегда, когда в обращении к ним

возникает необходимость.

В соответствии с тремя основными свойствами безопасности

информации различают три классические угрозы безопасности

информации.

Определение 1.12. Угроза конфиденциальности информации

состоит в нарушении установленных ограничений на доступ к

информации.

Определение 1.13. Угроза целостности информации — несанк-

ционированное изменение информации, случайное или предна-

меренное.

Определение 1.14. Угроза доступности информации осуществ-

ляется, когда несанкционированно блокируется доступ к инфор-

мации (блокирование может быть постоянным или на некоторое

время, достаточное, чтобы информация стала бесполезной).

Кроме перечисленных угроз выделяют еще одну угрозу, реали-

зация которой, как правило, предшествует реализации любой из

классических угроз.

Определение 1.15. Угроза раскрытия параметров компьютерной

системы — преодоление защиты компьютерной системы, выявле-

ние параметров, функций и свойств ее системы безопасности.

Осуществление угрозы конфиденциальности информации не-

редко происходит с использованием неблагоприятных информа-

ционных потоков (каналов утечки информации). Выделяют два

основных вида неблагоприятных информационных потоков: по

памяти и по времени.

Информационный поток по памяти описывается схемой, пред-

ставленной на рис. 1.1.

Информационный поток по времени описывается схемой, пред-

ставленной на рис. 1.2.

Опасность неблагоприятного информационного потока по вре-

мени определяется долей ценной информации, модулируемой на

процесс 5]. Наиболее распространенными случаями реализации

неблагоприятного информационного потока по времени являются:

• перехват информации в канале связи;

• побочные каналы утечки информации по излучению, сети

питания или акустике.

При анализе угрозы целостности информации следует иметь в

виду, что язык ее описания аналогичен языку описания угрозы

конфиденциальности. Используя при описании требований защи-

ты информации от угрозы целостности доступы субъектов к объек-

там, можно сделать выводы, аналогичные выводам, полученным

6

read

read

' write read write read '

0 ----------*- 0 -*-•-----*- ®

01 Ui 02 U2 <?3

Рис. 1.1. Информационный поток

по памяти:

Ui — нарушитель; и2 — пользователь,

обрабатывающий ценную информа-

цию; о, — объект, доступный наруши-

телю на запись; о2 — общедоступный

объект; о3 — ценный объект

' write read write read 4

® -*---•-----*- • -•--•----»- ®

^1 Ji li2 0%

Рис. 1.2. Информационный поток

по времени:

«1 — нарушитель; и2 — пользователь,

обрабатывающий ценную информа-

цию; — процесс, на который отра-

жается по времени информация о

работе пользователя и2; о, — объект,

доступный нарушителю на запись;

о2 — ценный объект

при описании требований защиты от угрозы конфиденциально-

сти; при этом следует заменить доступы на чтение информации

доступами на запись, и наоборот.

Угроза доступности информации, как правило, описывается с

использованием параметра, называемого максимальным време-

нем ожидания ответа на запрос на доступ к ресурсу (MWT —

maximum wait time). Таким образом, для каждого ресурса компью-

терной системы определяется время, приемлемое для ожидания

его получения.

Следует считать, что реализовалась угроза доступности ин-

формации, если ресурс с соответствующим максимальным вре-

менем ожидания, санкционировано запрашиваемый пользовате-

лем в момент времени t, не предоставлен ему к моменту времени

t + MWT.

Можно использовать несколько подходов для определения MWT:

• определив Л/#Т=ад для всех ресурсов, можно исключить рас-

смотрение угрозы доступности информации при анализе безопас-

ности компьютерной системы;

• можно определить MWT только для некоторых доступов

субъектов к ресурсам компьютерной системы, действительно кри-

тичных с точки зрения ее безопасности.

1.1.3. Основные виды политик безопасности

Дискреционная политика безопасности

Определение 1.16. Дискреционная политика безопасности —

политика безопасности, основанная на дискреционном управле-

нии доступом {Discretionary Access Control), которое определяется

двумя свойствами:

• все субъекты и объекты идентифицированы;

7

• права доступа субъектов на объекты системы определяются на

основании некоторого внешнего по отношению к системе правила.

Основным элементом систем дискреционного разграничения

доступа является матрица доступов.

Определение 1.17. Матрица доступов — матрица размером

|5| х |О|, строки которой соответствуют субъектам, а столбцы со-

ответствуют объектам. При этом каждый элемент матрицы досту-

пов M[s, о] с R определяет права доступа субъекта 5 на объект о,

где R — множество прав доступа.

К достоинствам дискреционной политики безопасности можно

отнести относительно простую реализацию системы разграниче-

ния доступа. Этим обусловлен тот факт, что большинство распро-

страненных в настоящее время компьютерных систем обеспечи-

вают выполнение требований именно данной политики безопас-

ности.

К недостаткам дискреционной политики безопасности отно-

сится статичность определенных в ней правил разграничения до-

ступа. Данная политика безопасности не учитывает динамику из-

менений состояний компьютерной системы. Кроме того, при ис-

пользовании дискреционной политики безопасности возникает

вопрос определения правил распространения прав доступа и ана-

лиза их влияния на безопасность компьютерной системы. В общем

случае при использовании данной политики безопасности перед

системой защиты, которая при санкционировании доступа субъек-

та к объекту руководствуется некоторым набором правил, стоит

алгоритмически неразрешимая задача —- проверить, приведут ли

его действия к нарушению безопасности или нет. Данный факт

доказывается в подразд. 2.1.

В то же время имеются модели компьютерных систем, реализу-

ющих дискреционную политику безопасности (например, рассмат-

риваемая в подразд. 2.2 модель Take-Grant), которые предоставля-

ют алгоритмы проверки безопасности.

Тем не менее, в общем случае дискреционная политика разгра-

ничения доступа не позволяет реализовать ясную и четкую систему

защиты информации в компьютерной системе. Этим обусловлива-

ется поиск других, более совершенных политик безопасности.

Мандатная политика безопасности

Определение 1.18. Мандатная (полномочная) политика безо-

пасности — политика безопасности, основанная на мандатном

разграничении доступа (Mandatory Access Control), которое опре-

деляется четырьмя условиями:

• все субъекты и объекты системы однозначно идентифициро-

ваны;

8

• задана решетка уровней конфиденциальности информации;

• каждому объекту системы присвоен уровень конфиденци-

альности, определяющий ценность содержащейся в нем инфор-

мации;

• каждому субъекту системы присвоен уровень доступа, опре-

деляющий уровень доверия к нему в компьютерной системе.

Основная цель мандатной политики безопасности — предотв-

ращение утечки информации от объектов с высоким уровнем до-

ступа к объектам с низким уровнем доступа, т.е. противодействие

возникновению в компьютерной системе неблагоприятных инфор-

мационных потоков сверху вниз.

Чаще всего мандатную политику безопасности описывают в

терминах, понятиях и определениях свойств модели Белла—Ла-

Падула, которая рассмотрена в подразд. 3.1. Для систем мандатно-

го разграничения доступа задача проверки безопасности является

алгоритмически разрешимой. Кроме того, по сравнению с компь-

ютерными системами, построенными на основе дискреционной

политики безопасности, для систем, реализующих мандатную

политику, характерна более высокая степень надежности. Прави-

ла мандатной политики безопасности более ясны и просты для

понимания разработчиками и пользователями, что также являет-

ся фактором, положительно влияющим на уровень безопасности

системы.

С другой стороны, реализация систем с политикой безопасно-

сти данного типа довольно сложна и требует значительных ресур-

сов компьютерной системы.

Политика безопасности информационных потоков

Политика безопасности информационных потоков основана на

разделении всех возможных информационных потоков между

объектами системы на два непересекающихся множества: множе-

ство благоприятных информационных потоков и множество не-

благоприятных информационных потоков. Цель реализации поли-

тики безопасности информационных потоков состоит в том, что-

бы обеспечить невозможность возникновения в компьютерной

системе неблагоприятных информационных потоков.

Политика безопасности информационных потоков в большин-

стве случаев используется в сочетании с политикой другого вида,

например с политикой дискреционного или мандатного разгра-

ничения доступа. Реализация политики безопасности информа-

ционных потоков, как правило, на практике является трудной

для решения задачей, особенно, если необходимо обеспечить за-

щиту компьютерной системы от возникновения^неблагоприятных

информационных потоков по времени.

9

Некоторые из видов моделей политик безопасности информа-

ционных потоков рассмотрены в гл. 4.

Политика ролевого разграничения доступа

Ролевое разграничение доступа является развитием политики

дискреционного разграничения доступа; при этом права доступа

субъектов системы на объекты группируются с учетом специфики

их применения, образуя роли.

Задание ролей позволяет определить более четкие и понятные

для пользователей компьютерной системы правила разграниче-

ния доступа. Ролевое разграничение доступа позволяет реализо-

вать гибкие, изменяющиеся динамически в процессе функциони-

рования компьютерной системы правила разграничения доступа.

На основе ролевого разграничения доступа, в том числе, может

быть реализовано мандатное разграничение доступа. Ролевое раз-

граничение доступа рассмотрено в гл. 5.

Политика изолированной программной среды

Целью реализации политики изолированной программной сре-

ды является определение порядка безопасного взаимодействия

субъектов системы, обеспечивающего невозможность воздействия

на систему защиты и модификации ее параметров или конфигу-

рации, результатом которых могло бы стать изменение реализуе-

мой системой защиты политики разграничения доступа.

Политика изолированной программной среды реализуется пу-

тем изоляции субъектов системы друг от друга и путем контроля

порождения новых субъектов таким образом, чтобы в системе мог-

ли активизироваться только субъекты из предопределенного спис-

ка. При этом должна контролироваться целостность объектов сис-

темы, влияющих на функциональность активизируемых субъектов.

Подробно политика изолированной программной среды рас-

смотрена в гл. 6.

1.2. МАТЕМАТИЧЕСКИЕ ОСНОВЫ МОДЕЛЕЙ БЕЗОПАСНОСТИ

1.2.1. Основные понятия

Большая часть используемых при описании свойств моделей

безопасности компьютерных систем сведений из математики рас-

смотрены в тех подразделах, в которых они непосредственно ис-

10

пользуются. Особое внимание необходимо уделить следующим

наиболее важным математическим понятиям, используемым в

нескольких моделях безопасности:

• автомат;

• граф;

• алгоритмически разрешимые и алгоритмически неразреши-

мые проблемы;

• решетка.

1.2.2. Элементы теории автоматов

В математических моделях безопасности компьютерных систем

понятие автомата часто используется для описания свойств сис-

темы защиты, ее отдельных элементов или компьютерной систе-

мы в целом.

Определение 1.19. Автоматом А(Х, S, Y, h,f) называется сово-

купность пяти элементов:

X* 0 — конечный входной алфавит;

5 * 0 — конечное множество состояний;

Y* 0 — конечный выходной алфавит;

h: X* S -> 5 — функция переходов автомата;

/: X х S -> Y — функция выходов автомата.

При этом Ая: X* -> К* — автоматное отображение, где .s0 —

начальное состояние автомата; X* и Y* — конечные последова-

тельности элементов соответственно входного и выходного алфа-

витов.

Определение 1.20. Гомоморфизмом <р автомата Л (А-, 5, Y, h,f)

в автомат А'(Х, S', Y', называется совокупность трех функ-

ций <р = (а, р, у), где

а: X-у X’;

р: S-> S';

у: Y-> У.

При этом для х е -Х, s е S, у е У справедливы равенства:

Р(/г(х, 5)) = /г'(а(х), р(у));

у(Л(х, 5)) =/'(а(х), Р(у)).

Таким образом, коммутатив-

на диаграмма, представленная на

рис. 1.3.

Определение 1.21. Суммой двух

автоматов Sb У1; /ц, /])

и Л2(А, S2, 1), где S( n S2 =

= 0, называется автомат (Л1 +

+ T2)(X St u S2, Y} У2, h, f)-

при этом для X e X выполняются

условия (рис. 1.4):

Рис. 1.3. Гомоморфизм автоматов

11

At

Рис. 1.4. Сумма двух автоматов

(Л1+Л2)(Х 5,и52> Y^ Г2, А,/)

некие двух автоматов (Л, -э Л2)(ХЬ

5! х S2, Y2, h, /)

h(x, s') = hj(x, s), если 5 e Sh для i e {1, 2};

/(x, 5) = f(x, s), если 5 e Sh для i e {1, 2}.

Определение 1.22. Последовательным соединением двух авто-

матов Sb Yh frh ft) и Л2(Х2, S2, Y2, h2, f2), где Y\ c X2,

называется автомат (Л, -> Л2)(ХЬ х S2, Y2, h, f); при этом для

х е Xlf st е 5b s2 е S2 справедливы равенства (рис. 1.5):

Л(х, (sb s2)) = (/z,(x, s,), /i2(f(x, 5,), s2));

f(xt (Sb s2)) = /2(/1(*, s^, s2).

1.2.3. Элементы теории графов

Элементы теории графов широко используются в математиче-

ских моделях безопасности компьютерных систем, например для

представления траекторий состояний функционирования системы,

матрицы доступов систем дискреционного разграничения доступа.

Определение 1.23. Графом G=(V, Е) называется совокупность

двух элементов:

V — конечное множество вершин графа;

Е с К х V — множество ребер графа.

При этом, если ребра (vt, v2) и (v2, V\) считаются одинаковы-

ми, то граф называется неориентированным, в противном случае

граф называется ориентированным.

Определение 1.24. Вершины v, v' е ^соединены путем в графе

G=(V, Е), если существует последовательность ребер (vb v2), ...,

(.vn - 1, е Е, где -V, vn = v' и п> 1. Если v= v', то такой путь

называется циклом.

Определение 1.25. Подграфом G' = (V, Е') графа G= (Е, Е)

называется граф, где Е' с Ей V' с V— множество вершин, явля-

ющихся концами ребер из Е'.

12

Определение 1.26. Вершины v, v' g Кявляются связными в гра-

фе G~ (V, Е), если v соединена путем с v' или v' соединена путем

С V.

Определение 1.27. Вершины v, v' е Кявляются сильно связны-

ми в графе G= (V, Е), если v соединена путем с v' и v' соединена

путем с V.

Определение 1.28. Подграф, состоящий из связных (сильно

связных) между собой вершин, называется компонентой связно-

сти (сильной связности) графа.

Сильно связные вершины являются связными. В неориентиро-

ванном графе связные вершины являются сильно связными.

Определение 1.29. Ориентированный граф G = (Е, Е) называ-

ется деревом, если:

• в графе не содержатся циклы;

• существует единственная вершина (корень дерева), в кото-

рую не входит ни одно ребро;

• из корня в любую другую вершину графа существует един-

ственный путь;

с в любую вершину, кроме корня, входит только одно ребро.

Определение 1.30. Граф, состоящий из совокупности деревь-

ев, называется лесом.

Наиболее часто в математических моделях безопасности ком-

пьютерных систем используются следующие близкие по идее реа-

лизации алгоритмы на графах [4];

• алгоритм обхода вершин графа;

• алгоритм поиска кратчайшего пути между вершинами графа;

• алгоритм поиска компонент связности;

• алгоритм обхода вершин дерева.

1.2.4. Алгоритмически разрешимые и алгоритмически

неразрешимые проблемы

Понятие алгоритмически неразрешимой проблемы рассмотрим

на основе [5].

Рассмотрим так называемые массовые проблемы. Массовая про-

блема представляет собой бесконечную серию индивидуальных

задач.

Без ограничения общности рассмотрим массовые задачи, все

индивидуальные задачи которых имеют двузначный ответ («да» и

«нет»).

Определение 1.31. Характеристической функцией для массо-

вой проблемы Р называется функция f.P-y {0, 1}, где для инди-

видуальной задачи и е Р выполняются условия:

• /(л) = 1, если п имеет ответ «да»;

• /(л) = 0, если л имеет ответ «нет».

13

Определение 1.32. Массовая задача является алгоритмически

разрешимой, если существует алгоритм, вычисляющий ее харак-

теристическую функцию. В противном случае массовая проблема

является алгоритмически неразрешимой.

Решая конкретную массовую проблему, следует считаться с

возможностью, что она может оказаться алгоритмически нераз-

решимой, поэтому необходимо иметь представление о технике

доказательства неразрешимости. Основной метод, применяемый

для доказательства алгоритмической неразрешимости, базирует-

ся на следующем рассуждении. Пусть имеются две массовые про-

блемы Р, и Р2. Пусть имеется алгоритм А, который по всякой ин-

дивидуальной задаче р, е Р, строит индивидуальную задачу р2 е Р2

такую, что pi имеет ответ «да» тогда и только тогда, когда р2 имеет

ответ «да».

В этом случае говорят, что проблема Р\ сводится к проблеме Р2.

Если проблема Р( неразрешима, то проблема Р2 также неразре-

шима.

Примером алгоритмически неразрешимой проблемы является

проблема останова машины Тьюринга.

1.2.5. Модель решетки

Пусть X — конечное множество.

Определение 1.33. Бинарное отношение «<» на множестве Хна-

зывается отношением строгого порядка, если для любых a, b, с е X

выполняются три свойства:

• антирефлексивность: не выполняется а < о;

• транзитивность: (а < b, b < с) => {а < с);

• антисимметричность: (о < b, b < а) =/ (а = Ь).

Определение 1.34. Бинарное отношение «<» на множестве X

называется отношением частичного порядка, если для любых

а, Ь, с е X выполняются три свойства:

• рефлексивность: а < а;

• транзитивность: (а < b, b < с) => (а < с);

• антисимметричность: (а < b, b < a) =z> (а = Ь).

Определение 1.35. Для a, b е Xэлемент с = а © b е ^называется

наименьшей верхней границей, если:

• а < с, b <с,

• для d е X истинно (а < с, й < с) => (с < Д).

Определение 1.36. Для a, b е Xэлемент с = а ® b е ^называется

наибольшей нижней границей, если:

• с < а, с < Ь;

• для d е X истинно (d < a, d<b)=> (d< с).

Для пары элементов частично упорядоченного множества Хне

обязательно существует наименьшая верхняя (наибольшая ниж-

14

няя) граница, но если она существу-

ет, то из антисимметричности следует

ее единственность.

Определение 1.37. Пусть X— частич-

но упорядоченное множество. (J, <)

называется решеткой, если для любых

a, b е Xсуществуют а® b Хм а® b

е X.

Лемма 1.1. Для любого набора 5 =

= {о,, а2, ..., ап} элементов решетки

(X, <) существуют единственные эле-

Рис. 1.6. Примеры решеток

менты:

® 5= а, © а2 © ... © а„ — наимень-

шая верхняя граница 5”;

© 5= © а2 © ... © а„ — наибольшая нижняя граница 5.

Для решетки (X, <) существует максимальный элемент high—

= ® Хм минимальный элемент low = ® X.

Определение 1.38. Линейная решетка (линейная шкала) из п

элементов — это линейное упорядоченное'множество; можно все-

гда считать Х= {0, 1, ..., п}.

Как правило, решетки представляют с помощью ориентиро-

ванных графов (рис. 1.6). При этом вершинами графа являются

элементы множества X и для аь а2 е X справедливо неравенство

а, < а2, если в графе существует путь из щ в а2.

Частным важным случаем решеток является решетка подмно-

жеств некоторого конечного множества U.

Определение 1.39. Пусть U — конечное множество, Х=2и —

множество всех подмножеств множества U. Определим решетку

(X, <) с бинарным отношением частичного порядка «<», где для

а, b с U, a, b е X выполняется условие

а < b тогда и только тогда, когда а^Ь.

При этом

а® Ь = «и Ь, а® Ь = аг\ Ь.

Другим распространенным случаем решеток является решетка

многоуровневой безопасности (MLS). Данная решетка строится

как прямое произведение линейной решетки L и решетки Xпод-

множеств множества U.

Определение 1.40. Пусть (£,<) — линейная решетка, (J, <) —

решетка подмножеств U. Определим решетку многоуровневой бе-

зопасности (X х L, <) с бинарным отношением частичного по-

рядка «<», где для (а, а), (Ь, (3) е X х L выполняется условие

(а, а) < (b, Р) тогда и только тогда, когда а с Ь, а < р.

15

При этом

(а, а) © (b, Р) = (а и Ь, шах{а, р});

(а, а) ® (b, Р) = (й n b, min{a, р}).

На практике при использовании многоуровневых решеток бе-

зопасности решетка (L, <) является линейной шкалой уровней

конфиденциальности, a (J, <) — решеткой подмножеств множе-

ства неиерархических категорий информации.

Рис. 1.7. Схема классификации и взаимосвязи положений математиче-

ских моделей безопасности компьютерных систем

16

1.3. ОСНОВНЫЕ ВИДЫ МОДЕЛЕЙ БЕЗОПАСНОСТИ

Все математические модели безопасности компьютерных сис-

тем, рассматриваемые в данном пособии, классифицируются по

пяти основным видам:

• модели систем дискреционного разграничения доступа;

• модели систем мандатного разграничения доступа;

• модели безопасности информационных потоков;

• модели ролевого разграничения доступа;

• субъектно-ориентированная модель изолированной программ-

ной среды.

Схема классификации и взаимосвязи положений рассматрива-

емых математических моделей безопасности компьютерных сис-

тем представлены на рис. 1.7.

Контрольные вопросы

1. В чем состоит важность основной аксиомы теории защиты инфор-

мации?

2. Какие основные угрозы безопасности информации рассматривают-

ся в теории защиты информации?

3. Приведите примеры наиболее распространенных в современных

операционных системах и системах управления базами данных небла-

гоприятных информационных потоков по памяти и по времени.

4. Какие основные виды политик безопасности рассматриваются в

теории защиты информации?

5. Задают ли решетку следующие графы?

6. Нарисуйте граф, соответствующий решетке многоуровневой безо-

пасности (Xх L, <), для решетки (L, <) = {Low, High] и {X, <) — решет-

ки подмножеств множества U= {Political, Economic, Military].

ГЛАВА 2

МОДЕЛИ СИСТЕМ ДИСКРЕЦИОННОГО

РАЗГРАНИЧЕНИЯ ДОСТУПА

2.1. МОДЕЛЬ МАТРИЦЫ ДОСТУПОВ ХРУ

2.1.1. Элементы модели ХРУ

Модель Харрисона —Руззо—Ульмана (ХРУ) [6, II, 13] исполь-

зуется для анализа систем защиты, реализующих дискреционную

политику безопасности.

Элементами модели ХРУ являются:

О — множество объектов системы;

У — множество субъектов системы (5с О);

R — множество видов прав доступа субъектов на объекты, на-

пример права на чтение (read), на запись (write), владения (own);

М — матрица доступов, строки которой соответствуют субъек-

там, а столбцы соответствуют объектам. M[s, о] с R — права до-

ступа субъекта 5 на объект о.

Определение 2.1. Автомат, построенный согласно положениям

модели ХРУ, называется системой ХРУ.

Функционирование системы рассматривается только с точки

зрения изменений в матрице доступа. Возможные изменения оп-

ределяются шестью видами примитивных операторов, представ-

ленных в табл. 2.1.

В результате выполнения примитивного оператора а осуществ-

ляется переход из состояния q = (X, О, М) в результирующее со-

стояние q' = (S', О', М'). Данный переход обозначим через q J-a q'.

Из примитивных операторов составляются команды. Каждая

команда состоит из двух частей:

• условия, при котором выполняется команда;

• последовательности примитивных операторов.

Таким образом, запись команды имеет следующий вид:

command с(хь ..., xt)

if (г, е M[xSi, xj) and ... and (rm е M[xs„, xj) then

cq;

сс/7,

endif

end,

18

где гь rm& R — права доступа; аь а„ — последовательность

примитивных операторов, параметрами которых являются пара-

метры команды хь хк. Следует отметить, что наличие условия

в теле команды не является обязательным.

При выполнении команды с(х(, хк) система осуществляет

переход из состояния q в новое состояние q'. Данный переход обо-

значим

Q К(л-1, .... ») Q'-

При этом

q' = q, если одно из условий команды с(х,, xt) не выпол-

нено;

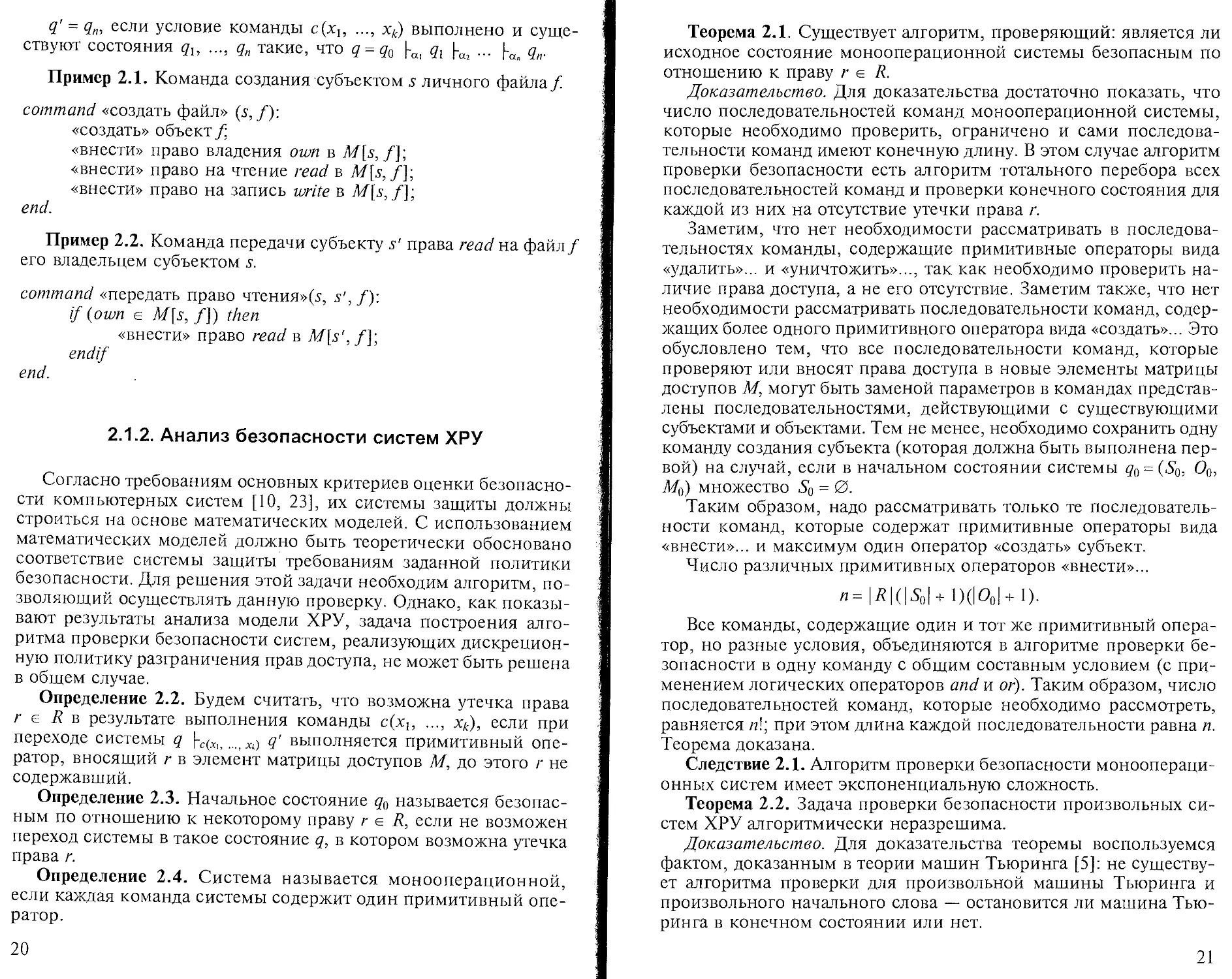

Таблица 2.1. Примитивные операторы модели ХРУ

Примитивный оператор Исходное состояние q = (5, О, М) Результирующее состояние q' = (S', О', М')

«Внести» право г e R в M[s, о] s е S 0 е О S' -S. О'= О, M'[s, о] = M[s, о] <>' {/-}, для (s’, o') * (у о) справедливо равенство M'[s', o'] = M[s', o']

«Удалить» право г е R из M[s, о] s е S 0 е О S' = S, O' = 0, M'[s, o] = M[s, o] \ {/}, для (s', o') * (s, о) справедливо равенство M’[s', o'] = Mis', o']

«Создать» субъект s' s' £ О y = 5u{s'}, O'= 0 о {s'}, для (s, о) e S x 0 справедливо равенство M'[s, о] = M[s, о], для о e O' справедливо равенство M'[s', о] = 0, для з- e 5' справедливо равенство M'[s, 5-'] = 0

«Создать» объект о' о' £ О У = У О' = 0 о {О'}, для (у о) е S х 0 справедливо равенство M'{s, о] = M[s, о], для j е S' справедливо равенство 7И'[у о'] = 0

«Уничтожить» субъект s' s' е S У = 5 \ И'}, О'= 0 \ {j'}, для (5, о) S' х О' справедливо равенство M'[s, о] = M[s, о]

«Уничтожить» объект о' О' е О о’ g S У = У 0 \ {о'}, для (у о) е S' х О' справедливо равенство M'[s, о] = M[s, о]

19

q' = q„, если условие команды с(хь ..., хк) выполнено и суще-

ствуют состояния qr, ..., q„ такие, что q = q0 Ь, |-а2 ... q„.

Пример 2.1. Команда создания субъектом 5 личного файла f.

command «создать файл» (s, f):

«создать» объект/;

«внести» право владения own в M[s, f];

«внести» право на чтение read в M[s, /];

«внести» право на запись write в M[s, /];

end.

Пример 2.2. Команда передачи субъекту s' права read на файл/

его владельцем субъектом 5.

command «передать право чтения»($, s', f):

if (own e M[s, /]) then

«внести» право read в M[s',f]',

endif

end.

2.1.2. Анализ безопасности систем ХРУ

Согласно требованиям основных критериев оценки безопасно-

сти компьютерных систем [10, 23], их системы защиты должны

строиться на основе математических моделей. С использованием

математических моделей должно быть теоретически обосновано

соответствие системы защиты требованиям заданной политики

безопасности. Для решения этой задачи необходим алгоритм, по-

зволяющий осуществлять данную проверку. Однако, как показы-

вают результаты анализа модели ХРУ, задача построения алго-

ритма проверки безопасности систем, реализующих дискрецион-

ную политику разграничения прав доступа, не может быть решена

в общем случае.

Определение 2.2. Будем считать, что возможна утечка права

г е R в результате выполнения команды с(хь ..., хД, если при

переходе системы q _ Л() д' выполняется примитивный опе-

ратор, вносящий г в элемент матрицы доступов М, до этого г не

содержавший.

Определение 2.3. Начальное состояние д0 называется безопас-

ным по отношению к некоторому праву г е R, если не возможен

переход системы в такое состояние q, в котором возможна утечка

права г.

Определение 2.4. Система называется монооперационной,

если каждая команда системы содержит один примитивный опе-

ратор.

20

Теорема 2.1. Существует алгоритм, проверяющий: является ли

исходное состояние монооперационной системы безопасным по

отношению к праву г е R.

Доказательство. Для доказательства достаточно показать, что

число последовательностей команд монооперационной системы,

которые необходимо проверить, ограничено и сами последова-

тельности команд имеют конечную длину. В этом случае алгоритм

проверки безопасности есть алгоритм тотального перебора всех

последовательностей команд и проверки конечного состояния для

каждой из них на отсутствие утечки права г.

Заметим, что нет необходимости рассматривать в последова-

тельностях команды, содержащие примитивные операторы вида

«удалить»... и «уничтожить»..., так как необходимо проверить на-

личие права доступа, а не его отсутствие. Заметим также, что нет

необходимости рассматривать последовательности команд, содер-

жащих более одного примитивного оператора вида «создать»... Это

обусловлено тем, что все последовательности команд, которые

проверяют или вносят права доступа в новые элементы матрицы

доступов Л/, могут быть заменой параметров в командах представ-

лены последовательностями, действующими с существующими

субъектами и объектами. Тем не менее, необходимо сохранить одну

команду создания субъекта (которая должна быть выполнена пер-

вой) на случай, если в начальном состоянии системы q0 = (Aq, О0,

Мо) множество 50 = 0.

Таким образом, надо рассматривать только те последователь-

ности команд, которые содержат примитивные операторы вида

«внести»... и максимум один оператор «создать» субъект.

Число различных примитивных операторов «внести»...

« = + 1)(|о0| +1).

Все команды, содержащие один и тот же примитивный опера-

тор, но разные условия, объединяются в алгоритме проверки бе-

зопасности в одну команду с общим составным условием (с при-

менением логических операторов and и or). Таким образом, число

последовательностей команд, которые необходимо рассмотреть,

равняется п\\ при этом длина каждой последовательности равна п.

Теорема доказана.

Следствие 2.1. Алгоритм проверки безопасности моноопераци-

онных систем имеет экспоненциальную сложность.

Теорема 2.2. Задача проверки безопасности произвольных си-

стем ХРУ алгоритмически неразрешима.

Доказательство. Для доказательства теоремы воспользуемся

фактом, доказанным в теории машин Тьюринга [5]: не существу-

ет алгоритма проверки для произвольной машины Тьюринга и

произвольного начального слова — остановится ли машина Тью-

ринга в конечном состоянии или нет.

21

Под машиной Тьюринга понимается способ переработки слов

в конечных алфавитах. Слова записываются на бесконечную в обе

стороны ленту, разбитую на ячейки.

Для элементов и команд машины Тьюринга используем следу-

ющие обозначения:

А = {а0, ah ..., ат} — внешний алфавит, где а0 = л — пустой

символ;

Q = {?о> , Qk} —' внутренний алфавит, где q\ — начальное

состояние; qQ — конечное состояние;

D = {г, /, е} — множество действий, где г — шаг вправо управ-

ляющей головки; I — шаг влево управляющей головки; е — управ-

ляющая головка не перемещается;

С: Q х А -» Q х А х D — функция, задающая команды машины

Тьюринга. Если C(qh, aft = (qh, ah, d), то это означает, что когда

машина находится в состоянии qia и управляющая головка указы-

вает на ячейку ленты, содержащую символ aie, тогда выполняется

шаг машины, в результате которого в эту ячейку записывается

символ а,-, машина переходит в состояние qit, а управляющая го-

ловка смещается по ленте согласно действию d.

Для того чтобы воспользоваться указанным выше фактом, пред-

ставим все элементы и команды машины Тьюринга в виде эле-

ментов и команд системы модели ХРУ.

Пусть машина Тьюринга выполнила некоторое число шагов.

Пронумеруем все ячейки, пройденные считывающей головкой

(включая те, в которые была изначально занесена информация),

числами от 1 до п. Тогда (aS], ..., аЛ) — заполнение ленты, где

aSi е A, Sj е {0, 1, ..., т} для /= 1, ..., п. Пусть считывающая головка

указывает на ячейку с номером i е {1, ..., и}, содержащую сим-

вол ait е А, где it е {0, 1, ..., т}, состояние машины qi; е Q,

где ij е {1, ..., к}, и должна быть выполнена команда С(д,-, а,;) =

= (^„ o,z„ d), где qlt, е Q, ai:, е A, if е {0, 1, ..., т}, ft е {1, ...,

к}, а е D.

Каждой ячейке ленты поставим в соответствие субъект модели

ХРУ; при этом будем считать, что 0 = S= {sb ..., $„}. Зададим мат-

рицу доступов ТИдля текущего состояния. Пусть множество прав

доступа R = Q о A u {own, left, right} и в матрицу доступов внесены

права:

• aS) е M[Sj, для у= 1, ..., п — заполнение ленты;

• own & M[Sj, 5у+1] для j= 1, ..., п — 1 — упорядочивание субъек-

тов, соответствующих ячейкам ленты;

• е M[sh 5,] — управляющая головка указывает на ячейку с

номером г;

• left е Af[sb 5J — признак крайней левой из пройденных яче-

ек на ленте;

• right е M[s„, y,J — признак крайней правой из пройденных

ячеек на ленте.

22

51 S2 ••• «У/ ••• $п-1

ds > left own

азг own

a. s3

cP

a^. own

av right

Рис. 2.1. Заполнения матрицы доступов модели ХРУ

Таким образом, текущему состоянию машины Тьюринга соот-

ветствует матрица доступов М системы модели ХРУ, представ-

ленная на рис. 2.1.

Построим гомоморфизм машины Тьюринга в систему ХРУ. Для

каждой команды машины Тьюринга а,) = (qt)„ ah„ d) зада-

дим соответствующую ей команду модели ХРУ:

• если d = е, то

command Eq, a ^q^,a h,{s'):

if {qi; e M[s, 5]) and (a,, e M[s, 5]) then

«удалить» право q^ из M[s, 5];

«удалить» право ah из M[s, 5];

«внести» право qit, в M[s, 5];

«внести» право ah. в M[s, 5];

endif

end',

• если d = г, то необходимо задать две команды для случаев,

когда считывающая головка указывает или не указывает на самую

правую ячейку ленты:

command RXqija^qi.aj.ys, s'):

if {qh e Д) and (ah e M[s, 5]) and {own <= Л/[5, 5']) then

«удалить» право qi: из M[s, Д;

«удалить» право а,- из M[s, 5];

«внести» право а,,, в M[s, Д;

«внести» право #/? в M\s’, 5'];

endif

end',

23

command Rlq^a^q^Oifs, s')'.

if (q^ e M[s, 5]) and (ah e M[s, 5]) and (right e M[s, 5]) then

«удалить» право qh из M[s, 5];

«удалить» право ai: из M[s, 5];

«удалить» право right из M[s, 5];

«внести» право ah, в M[s, 5];

«создать» субъект 5';

«внести» право own в M[s, 5'];

«внести» право аа в M\s', 5'];

«внести» право qi)f в M[s', s'];

«внести» право right в M[s', 5'];

endif

end',

• если d= I, то две команды для этого случая задаются анало-

гично командам для случая d = г.

Если машина Тьюринга останавливается в своем конечном со-

стоянии qG, то в соответствующей системе ХРУ происходит утеч-

ка права доступа q0. Из алгоритмической неразрешимости задачи

проверки: остановится ли машина Тьюринга в конечном состоя-

нии, — следует аналогичный вывод для задачи проверки безопас-

ности соответствующей ей системе ХРУ. Таким образом, в общем

случае для систем дискреционного разграничения доступа, пост-

роенных на основе модели ХРУ, задача проверки безопасности

алгоритмически неразрешима. Теорема доказана.

Приведенные выше теоремы 2.1 и 2.2 указывают на имеющую-

ся проблему выбора у разработчиков систем защиты. С одной сто-

роны, общая модель ХРУ может выражать большое разнообразие

политик дискреционного разграничения доступа, но при этом не

предоставляет алгоритма проверки их безопасности. С другой сто-

роны, можно использовать монооперационные системы, для ко-

торых алгоритм проверки безопасности существует, но данный

класс систем является слишком узким. Например, моноопераци-

онные системы не могут выразить политику, дающую субъектам

право владения на созданные ими объекты, так как не существует

одного примитивного оператора, который одновременно и создает

объект, и помечает его как принадлежащий создающему субъекту.

Дальнейшие исследования модели ХРУ велись в основном в

направлении определения условий, которым должна удовлетво-

рять система, чтобы для нее задача проверки безопасности была

алгоритмически разрешимой. Так, в 1976 г. было доказано [13],

что задача проверки безопасности алгоритмически разрешима для

систем, в которых нет примитивных операторов вида «создать»...

В 1978 г. было установлено [14], что таковыми могут быть систе-

мы монотонные и моноусловные, т. е. системы, команды которых

не содержат операторов вида «уничтожить»... или «удалить»... и

содержат условия, состоящие из не более одной проверки вида

24

г е M[s, о]. В том же году было установлено [17], что задача про-

верки безопасности для систем с конечным множеством субъек-

тов разрешима, но вычислительно сложна.

2.1.3. Модель типизированной матрицы доступов

Другая дискреционная модель, получившая название «Типи-

зированная матрица доступов» (ТМД), представляет собой разви-

тие модели ХРУ, дополненной концепцией типов, что позволяет

несколько смягчить те условия, для которых возможно доказа-

тельство безопасности системы. Рассмотрим модель ТМД на осно-

ве [3] и [22].

Формальное описание модели ТМД включает в себя следую-

щие элементы:

О — множество объектов системы;

S — множество субъектов системы (S с О);

R — множество прав доступа субъектов к объектам;

М — матрица доступов;

С — множество команд;

Т — множество типов объектов;

Г: О -» Т — функция, ставящая в соответствие каждому объек-

ту некоторый тип;

q = (S, О, t, М) — состояние системы;

Q — множество состоянии системы.

Состояние системы изменяется с помощью команд из множе-

ства С. Команды ТМД имеют тот же формат, что и в модели ХРУ,

но всем параметрам приписывается определенный тип:

command с(хр ..., хк\ tk)

if (г, е ЛГ[х5|, х0|]) and ... and (rm е M\xv xj) then

о-ъ

O-n,

endif

end.

Перед выполнением команды происходит проверка типов фак-

тических параметров. Если они не совпадают с указанными в оп-

ределении, то команда не выполняется. В модели используются

шесть видов примитивных операторов, отличающихся от анало-

гичных операторов модели ХРУ только использованием типизи-

рованных параметров (табл. 2.2).

Таким образом, ТМД является обобщением модели ХРУ, ко-

торую можно рассматривать как частный случай ТМД с одним

единственным типом для всех объектов и субъектов. С другой сто-

роны, любую систему ТМД можно выразить через систему ХРУ,

введя для обозначения типов специальные права доступа, а про-

25

Таблица 2.2. Примитивные операторы модели ТМД

Оператор Исходное состояние q = (5, О, М) Результирующее состояние q' = (S', O', M')

«Внести» право г е R в M[s, о] s е S о е О S' = S, O' = 0, t'(o) = t(o) для о e 0, M'[s, o] = M[s, o] u {/-}, для (s', o’) * (s, о) справедливо равенство W[s’, o'] = Л/fs', o’]

«Удалить» право г е R из M[s, о] s е S о е О S' = S, O'= 0, t'(o) = t(o) для о e 0, o] = M[s, o] \{r}, для (s’, o') * (s, о) справедливо равенство M'[s', o'] = M[s', o']

«Создать» субъект s' с типом 4 s' f S S' = Scj П'}, O’ = Ou{4 для о e О справедливы равен- ства t’(o) = t(o), t'(s') = ts-, для (s, о) e SxO справедливо равенство M'fs, о] = M'fs, о], для о е О' справедливо равен- ство M'fs', о] = 0, для 5 е S' справедливо равенство M'fs, s’] = 0

«Создать» объект О' с типом t0 o' О S' = S, О'=О^{о'}, t'(o') — to, для (з, о) е S х О справедливо равенство M'fs, о] = Mfs, о], для s е S' справедливо равен- ство M'fs, o’] = 0

«Уничтожить» субъект Г s’ e S s' = s\ п'}, о’ = о\{у}, для о е О' справедливо равен- ство t'(o) = t(o), для (s, о) е S' х О' справедливо равенство W[s, о] = M[s, о]

«Уничтожить» объект О' o' e 0 o' S S’ = S, О' = О \ {о'}, для о е О' справедливо равен- ство t’(o) = t(o), для (s, о) е S' х О' справедливо равенство M’[s, о] = M[s, о]

верку типов в командах заменив проверкой наличия соответству-

ющих прав доступа.

Появление в каждой команде дополнительных неявных усло-

вий, ограничивающих область применения команды только объек-

тами соответствующих типов, позволяет несколько смягчить же-

26

сткие условия классической модели, при которых критерий бе-

зопасности является разрешимым.

Определение 2.5. Модель монотонной типизированной матри-

цы доступов (МТМД) — модель ТМД, в командах которой отсут-

ствуют немонотонные примитивные операторы вида «удалить»...

и «уничтожить»...

Определение 2.6. Каноническая форма модели МТМД

(КФМТМД) — модель МТМД, в которой команды, содержащие

примитивные операторы вида «создать»..., не содержат условий и

примитивных операторов вида «внести»...

Терема 2.3. Любая система МТМД эквивалента системе

КФМТМД.

Доказательство. Пусть задана система МТМД, в которой опре-

делены множества R, Т, Q, С. Построим эквивалентную ей систе-

му КФМТМД, определив множества R*, Т*, Q*, С*.

Пусть

R* = R u {active}',

{tactive}.

В каждом состоянии q* = (S*, О*, Г, М*), соответствующем

состоянию q = (S, О, t, М), справедливы равенства:

S* = S и {sac/lve};

О* = О и KcU-

Пусть также для каждого о е О справедливо равенство /*(о) =

= До) и sacr,-ve — единственный субъект такой, что t*(sacfive) = tactive.

Кроме того, для 5 е S, о е О справедливо равенство М* [д о] =

= о] и в начальном состоянии системы для о е О0 справедли-

во равенство M*[saa!ve, о] = {active}.

Таким образом, право доступа active обозначает активизиро-

ванные субъекты и объекты КФМТМД.

Каждую команду с(х,: Д ..., xk: tk) системы МТМД, не содер-

жащую примитивные операторы «создать»..., представим коман-

дой c(Xp Д ..., xk. tk, s’. tacfm) системы КФМТМД, полученной из

исходной команды добавлением условий проверки active е M[s, х,],

для z = I, ..., к.

Каждую команду Дх{\ Д ..., хк. tk) системы МТМД, содержа-

щую примитивные операторы «создать»..., представим двумя мо-

нотонными командами КФМТМД:

• с'Д^. t{, ..., хк: tk) — команда без проверки условий, содержа-

щая все примитивные операторы «создать»... команды сДд Д ...,

хк- fk);

• сДхр Д ..., хк: д s: tocf,ve) — команда, содержащая условия и

примитивные операторы «внести»... команды c(xt: Д ..., хк: tk),

условия проверки active е Л/[5, х,], для всех родительских (не со-

здаваемых в команде Дх{\ Д ..., хк: tk)) объектов х,-, примитивные

операторы «внести» право active в ЛД5, х,] для всех объектов х,-,

создаваемых в команде с(х(: Д ..., хк. Д).

27

Таким образом, только «активизированные» объекты (в том

числе и субъекты) системы КФМТМД соответствуют объектам

системы МТМД, а все преобразования над ними в системе

КФМТМД соответствуют преобразованиям системы МТМД. Тео-

рема доказана.

Для того чтобы сформулировать ограничения, необходимые для

алгоритмической разрешимости задачи проверки безопасности в

системах МТМД, определим отношения между типами.

Определение 2.7. Пусть с(хр th хк: t^) — некоторая команда

ТМД. Будем говорить, что является дочерним типом в с(х,:

..., хк. tk), если в ее теле имеется один из следующих примитивных

операторов:

• «создать» субъект 5 с типом (;

• «создать» объект о с типом /,.

В противном случае будем говорить, что t, является родитель-

ским типом в с(х(: t\, хк: tk).

Заметим, что в одной команде тип может быть одновременно и

родительским, и дочерним. Например:

command foo(s\. и, s2: и, s3: v, ot: w, о2: b)

« создать» субъект s2 с типом и;

« создать» субъект т3 с типом и;

end.

Здесь и является родительским типом относительно и дочер-

ним типом относительно s2. Кроме того, w и b являются родитель-

скими типами, a v — дочерним типом.

Тогда можно описать взаимосвязи между различными типами

с помощью графа, определяющего отношение «наследственно-

сти» между типами, устанавливаемые через операции порожде-

ния объектов.

Определение 2.8. Граф создания — ориентированный граф с

множеством вершин Т, в котором ребро от и к v существует тогда

и только тогда, когда в системе имеется команда, в которой и

является родительским типом, a v — дочерним типом.

Граф создания для каждого типа позволяет определить:

• объекты каких типов должны существовать в системе, чтобы

в ней мог появиться объект или субъект заданного типа;

• объекты каких типов могут быть порождены при участии

объектов заданного типа.

Определение 2.9. Система МТМД (КФМТМД) называется ацик-

лической (АМТМД или, соответственно, АКФМТМД) тогда и

только тогда, когда ее граф создания не содержит циклов; в про-

тивном случае говорят, что система является циклической.

Например, граф создания для приведенной выше команды

/оо(), содержит следующие ребра: {(и, м), (и, и), (w, и), (w, v),

(b, и), (b, v)}. Система МТМД, содержащая эту команду, будет

циклической, поскольку тип и является для нее одновременно и

28

родительским, и дочерним, что приводит к появлению в графе

цикла (и, и).

Алгоритм проверки безопасности систем АМТМД будет стро-

иться для эквивалентных им систем АКФМТМД. Он состоит из

двух шагов.

Шаг 1. Используя команды, содержащие только примитивные

операторы «создать»... и не содержащие условий, перейти из на-

чального состояния системы в некоторое развернутое состояние,

обеспечивающее минимально необходимый и достаточный для

распространения прав доступа состав объектов.

Шаг 2. Используя команды, не содержащие примитивные опе-

раторы «создать»..., перейти из развернутого состояния в замкну-

тое состояние, в котором дальнейшее применение таких команд

не приведет к изменениям в матрице доступов.

Второй шаг алгоритма, очевидно, всегда будет иметь конечную

сложность. Так как множество объектов не изменяется, то необхо-

димо перебрать все последовательности различных команд (по ана-

логии с доказательством теоремы 2.1), которых конечное число.

Наибольшую трудность в общем случае представляет разработ-

ка алгоритма построения развернутого состояния. Однако для

АМТМД или АКФМТМД такой алгоритм существует. Перед его

рассмотрением дадим определение.

Определение 2.10. Пусть аир — две различные команды систе-

мы МТМД, содержащие примитивные операторы «создать»... Бу-

дем считать, что а < р тогда и только тогда, когда для каждого

дочернего типа в а в графе создания найдется путь в некоторый

родительский тип в р.

Лемма 2.1. В АМТМД отношение «<» на множестве команд яв-

ляется отношением строгого порядка (обладает свойствами анти-

рефлексивности, антисимметричности и транзитивности).

Доказательство. Выполняется по определению отношения «<»

и АМТМД. /

Алгоритм 2.1. Алгоритм построения развернутого состояния для

АКФМТМД.

Шаг 1. Упорядочить линейно в списке все команды, содержа-

щие примитивные операторы вида «создать»... (команда а следует

в списке перед командой р тогда и только тогда, когда или а < р,

или аир несравнимы).

Шаг 2. Начиная с начального состояния, применять по создан-

ному на шаге 1 списку все команды; при этом каждая команда

применяется со всеми возможными для нее наборами родитель-

ских объектов.

Лемма 2.2. Алгоритм 2.1 заканчивает работу за конечное время

на любом начальном состоянии произвольной АКФМТМД.

Доказательство. Число команд в списке конечно. Для каждой

команды из списка на каждом шаге работы алгоритма существует

29

конечный набор объектов, которые могут являться ее параметра-

ми. Следовательно, алгоритм 2.1 всегда заканчивает работу за ко-

нечное время. Лемма доказана.

Определение 2.11. Пусть (qQ, qx, ..., qh ...) — некоторая история

МТМД. Для каждого состояния qi = (Sh Oiy th Т), i = 0, 1, ..., на

множестве О, рекурсивно определим функцию порождения объек-

тов л():

• для каждого о е с (7, зададим л(о) = о,

• если объект о е Ок с. О, создан на шаге 0 < к < i истории

командой ак, где ot, о2, ..., о,„ е Ок_ t — последовательность вхо-

дящих в нее объектов родительских типов, то зададим я(о) =

= <x*O(0i), л(о2), ..., л(о„,)).

Пример 2.3. Пусть система МТМД с двумя командами:

command cv(x: и, у: v)

«создать» субъект у с типом v;

end,

command cw(x: и, у: v, z: w)

«создать» объект z с типом w;

end,

и история имеет вид q0 Ь„(л. у) <li у, д Qi, где % = (50, (70, г0,

Г) = ({х}, {х}, {(х, и)}, {и, v, w}). Тогда в состоянии q2 = (S2, О2, t2,

Т) = ({х, у}, {х, у, z}, {(х, и), (у, v), (z, to)}, {и, и, w}) функция

п() будет иметь следующие значения:

л(х) = X,

л (у) = си(х),

7t(z) = CU>(X, Си(х)).

Лемма 2.3. В развернутом состоянии АМТМД для каждого воз-

можного значения функции порождения объектов л() существует

только один объект.

Доказательство. Развернутое состояние для АМТМД строится

по алгоритму 2.1 за конечное число шагов; при этом, по опреде-

лению шага 2, оно содержит объекты для всех возможных значе-

ний функции тг(). В то же время, на каждом шаге построения по

алгоритму 2.1 получается новый объект с новым значением фун-

кции л(). Лемма доказана.

Теорема 2.4. Существует алгоритм проверки безопасности сис-

тем АМТМД.

Доказательство. Без ограничения общности по теореме 2.3 бу-

дем рассматривать АКФМТМД.

Пусть / — начальное состояние системы; q —• развернутое со-

стояние системы, полученное из/по алгоритму 2.1; т — замкну-

тое состояние системы, полученное из q с использованием всех

команд, не содержащих примитивные операторы вида «создать»...;

при этом дальнейшее применение таких команд к т не приводит

к изменениям в матрице доступов.

30

Так как система монотонная, то для (s, о) е Sgx Од выполняется

условие

Mg[s, о] <= Mm[s, о]. (2.1)

Покажем, что для систем АКФМТМД для любой истории

(/ ..., h, ...) может быть найдена история (q, ..., g, ...) без ко-

манд, содержащих примитивные операторы вида «создать»..., где

для (s, о) е х Oh выполняется условие

Mh[s, о] с Л/Дл(5), л(о)]. (2.2)

Если условие (2.2) выполняется, то из (2.1) и (2.2) следует,

что для (s, о) е Sfx О/выполняется условие Mh[s, о] с Л/Дл(5),

л(о)] с М„,[л(з), л(о)]. Так как/— начальное состояние системы, то

заменяем л(5) на s, л(о) на о и получаем, что для (s, о) е SfX Of

выполняется условие

Mh[s, о] с Mg[s, о] a о],

что и означает алгоритмическую разрешимость задачи проверки

безопасности систем АМТМД.

Обоснуем (2.2), для чего построим алгоритм преобразования

последовательности команд истории (/ ..., А, ...) в последова-

тельность команд истории (д, ..., g, ...).

Шаг 1. В командах истории (/ ..., h, ...) удалить примитивные

операторы вида «создать»...

Шаг 2. Команды c(x(: tx, ..., хк: tk) истории (/ ..., h, ...) заме-

нить на команды c(x(x}): it, n(xk): tk) истории (д, ..., g, ...)(

По индукции по длине истории (/ ..., h, ...) легко показать,

что выполняются два условия.

Условие 1. Условие каждой команды истории (q, ..., g, ...) ис-

тинно тогда и только тогда, когда истинно условие соответствую-

щей ей команды истории (/ ..., h, ...).

Условие 2. Для состояния h истории (/ ..., h, ...) и соответству-

ющего ему состояния g истории (д, ..., g, ...) выполняется условие

для (з, о) e S/t х О/, истинно (г <= Mh[s, о]) => (г <= Л/Дл(5), л(о)]).

Таким образом, (2.2) обосновано. Теорема доказана.

Следствие 2.2. Алгоритм проверки безопасности систем АМТМД

имеет экспоненциальную сложность.

Доказательство. При построении замкнутого состояния систе-

мы из развернутого состояния используется алгоритм, аналогич-

ный алгоритму, использованному в теореме 2.1. По следствию 2.1

получаем, что алгоритм проверки безопасности систем АМТМД

имеет экспоненциальную сложность.

Определим подмножество АМТМД, называемое тернарными

АМТМД.

Определение 2.12. Тернарными называются АМТМД, в кото-

рых каждая команда имеет не более трех параметров.

31

Для тернарной АМТМД доказано [8], что алгоритм проверки

ее безопасности имеет полиномиальную сложность.

Таким образом, введение строгого контроля типов в дискре-

ционную модель ХРУ позволило доказать критерий безопасности

систем для более приемлемых ограничений, что существенно рас-

ширило область ее применения.

2.2. МОДЕЛЬ РАСПРОСТРАНЕНИЯ ПРАВ ДОСТУПА

TAKE-GRANT

2.2.1. Основные положения классической модели

Take-Grant

Классическая модель Таке-Grant ориентирована на анализ пу-

тей распространения прав доступа в системах дискреционного

разграничения доступа. Классическую модель Take-Grant рассмот-

рим на основе [6].

Основные элементы модели Take-Grant'.

О — множество объектов;

S с О — множество субъектов;

R- {/'i, >2, , ки} Д, <?} — множество видов прав доступа, где

t {take) — право брать права доступа; g {grant) — право давать

права доступа;

G= {S, О, Е) — конечный помеченный ориентированный граф

без петель, представляющий текущие доступы в системе. Элемен-

ты множеств 5 и О являются вершинами графа, которые соответ-

ственно будем обозначать: ® — объекты (элементы множества

0\5), • — субъекты (элементы множества У). Элементы множе-

ства Е с О х О х R являются ребрами графа. Каждое ребро помече-

но непустым подмножеством множества видов прав доступа R.

Состояние системы описывается соответствующим ему графом

доступов. В отличие от модели ХРУ в модели Take-Grant возможно

наличие прав доступа не только у субъектов на объекты, но и у

объектов на объекты.

Основная цель классической модели Take-Grant — определе-

ние и обоснование алгоритмически проверяемых условий провер-

ки возможности утечки права доступа по исходному графу досту-

пов, соответствующего некоторому состоянию системы.

Порядок перехода системы модели Take-Grant из состояния в

состояние определяется правилами преобразования графа досту-

пов, которые в классической модели носят название де-юре пра-

вил. Преобразование графа G в граф G' в результате выполнения

правила ор обозначим следующим образом:

G [ор G'.

32

х у z 1аке{а, x,y,z)x у z

Рис. 2.2. Применение правила taketa, х, у, z)

ух z grant [о., х, у, z) у х z

Рис. 2.3. Применение правила grant(a, х, у, z)

В классической модели Take-Grant рассматриваются четыре де-

юре правила преобразования графа, выполнение каждого из ко-

торых может быть инициировано только субъектом, являющимся

активной компонентой системы (рис. 2.2 —2.5):

• takeQ — брать права доступа;

• grants — давать права доступа;

• create^) — создавать новый объект или субъект; при этом

субъект-создатель может взять на созданный субъект любые права

доступа (по умолчанию предполагается, что при выполнение пра-

вила create^ создается объект; случаи, когда создается субъект,

оговариваются особо);

• remove^) — удалять права доступа.

Рассмотрим условия применения де-юре правил в исходном

состоянии G=(S, О, Е) и результаты их применения в результи-

рующем состоянии G' = (S', О', Е') (табл. 2.3).

В модели Take-Grant основное внимание уделяется определе-

нию условий, при которых в системе возможно распространение

прав доступа определенным способом. Рассмотрим условия реа-

лизации:

• способа санкционированного получения прав доступа;

• способа похищения прав доступа.

G G'

, Р

• f- •---------

х create^,х,у) х у

Рис. 2.4. Применение правила

create^, х, у)

G G'

Р , р\а

•—г—•—е——на

х у remove(a,x,y) х у

Рис. 2.5. Применение правила

remove(a, х, у)

2 Девянин

33

Таблица 2.3. Де-юре правила классической модели Take-Grant

Правила Исходное состояние G = (5, 0, E) Результирующее состояние G' = (S', O', E')

take(<J.. х, у, z) x e S, (x, у, {Г}) с E, (y, z, p) с E, x * z, a c 3 S’ = 5, O' = 0, E' ~ E u {(x, z, a)}

grantiyi, х, у, z) x e S, (x, У, Ш) с E, (x, z, P) a: E, y^z, ac3 S’ = S, O'= 0, E' = E x> {(y, z, a-)}

create^, х, j) x e . S', у <t 0, 3^0 0 = 0 и { у }, S' = 5 и { у } (если у — субъект), Е' = Е с {(х, у, 3)}

removefa, x, j) x e S, (x, у, 3) с E, ac₽ S' =S, О' = О, Е‘ = Е\{(х, у, а)}

Санкционированное получение прав доступа

Данный способ характеризуется тем, что при передаче прав

доступа не накладывается ограничений на кооперацию субъектов

системы, участвующих в этом процессе.

Определение 2.13. Пусть х, у е О0, х * у — различные объекты

графа доступов Со = (So, О0, До), о. с 7?. Определим предикат «воз-

можен доступ»(а, х, у, Go), который будет истинным тогда и только

тогда, когда существуют графы Gt =(St, Oh Et), ..., GN=(SN, ON,

En) и правила oph ..., opN такие, что Go G ... GN и

(x, y, a) cz En.

Определение истинности предиката «возможен доступ»^) не-

посредственно по определению является в общем случае алгорит-

мически неразрешимой задачей, так как требует проверки всех

траекторий функционирования системы. По этой причине для

проверки истинности предиката «возможен доступ»() следует оп-

ределить необходимые и достаточные условия, проверка которых

возможна. Решение данной задачи будет выполнено в два этапа.

На первом этапе будут определены и обоснованы условия истин-

ности предиката «возможен доступ>>{) для графов, все вершины

которых являются субъектами, на втором этапе условия истинно-

34

сти предиката «возможен доступ»^ будут определены и обосно-

ваны для произвольных графов.

Определение 2.14. Пусть G~ (S, S, Е) — граф доступов. Гово-

рят, что вершины графа доступов являются /g-связными или что

они соединены /g-путем, если, без учета направления ребер, в

графе между ними существует путь такой, что каждое ребро этого

пути помечено t или g.

Теорема 2.5. Пусть Со = (50, 50, £0) — граф доступов, содержа-

щий только вершины-субъекты, х, у е So, х у. Тогда предикат

«возможен доступ»(а, х, у, Go) истинен тогда и только тогда,

когда выполняются условия 1 и 2.

Условие 1. Существуют субъекты ..., зт е 50:

(sh у, у,) с £0, где z = 1, ..., т и а = У! о ... и у,„.

Условие 2. Субъекты х и s, /g-связны в графе Со, где /= 1, ..., т.

Доказательство. Проведем доказательство теоремы для т= 1,

так как схему доказательства для этого случая легко продолжить

для случая т > 1.

При т = 1 условия 1 и 2 формулируются следующим образом.

Условие 1. Существует субъект 5 такой, что выполняется вклю-

чение у, а) с Ео.

Условие 2. Субъекты хи s соединены /g-путем в графе Go.

Достаточность. Пусть выполнены условия 1 и 2. Доказатель-

ство проведем индукцией по длине /g-пути, соединяющего субъек-

ты х и s. ,

Пусть N=0. Тогда x = s, (х, у, а) с Ео и предикат «возможен

доступДа, х, у, Go) истинен. /

Пусть N= 1. Тогда существует (5, у, а) с<с0 и х и 5 соединены

ребром / или g в графе Go . Возможны четыре случая такого со-

единения х и s, для каждого из которых указана последователь-

ность преобразований графа, требуемая для передачи прав досту-

па (рис. 2.6 —2.9).

Рис. 2.6. Первый случай

Рис. 2.7. Второй случай

35

Рис. 2.8. Третий случай

Пусть 7V> 1. Пусть вершина z находится на /g-пути между х и 5

и является смежной с sb графе Go. Тогда исходя из доказанного

для случая ЛГ= 1 существует последовательность преобразований

графов доступов Go Д», - К» gk такая, что (z, у, а) с Ек,

и длина /g-пути между z и х равна N- 1. Это позволяет применить

предположение индукции. Достаточность условий теоремы дока-

зана.

Необходимость. Пусть истинен предикат «возможен доступ»(а,

х, У, <?о)-

По определению истинности предиката существует последова-

тельность графов доступов G{ = (5Ь О,, Д), ..., GN=(SN, ON, EN)

такая, что Go |-0/„ Gt \-ор2... GN и (%, у, а) с EN. Среди всех таких

последовательностей выберем ту, у которой длина N является

минимальной. В этом случае (х, у, a) <z EN_}.

Докажем необходимость условий 1 и 2 индукцией по N.

При N=0 очевидно, что (х, у, а) с Д . Таким образом, s = x и

условия теоремы выполнены.

36

При N= 1 из определения де-юре правил модели следует, что

существует субъект 5 такой, что выполняется включение (s, у,

а) с Ео и или opv = take(a, х, s, у), или opI = grant(a, s, х, у).

Таким образом, s и х /g-связны в графе Gj и условия теоремы

выполнены.

Пусть N > 0 и утверждение теоремы истинно для к < N. Тогда

(х, у, а) ср EN_ । и ребро (х, у, а) появляется в графе доступов GN

в результате применения к графу GN _ t некоторого правила opN.

Очевидно, что это не правила createQ или remove(). Следователь-

но, существует субъект s' е SN_t такой, что (s', у, а) с EN_{ и

или (х, s', f) 6 En_\ и opN= take(a, x, s', у), или (s', x, g) g En~{ и

op n = grant (a, s', x, y).

Возможны два случая: s' g 5о и s' <p 5o .

Рассмотрим первый случай. Пусть s' g Sq, тогда истинен преди-

кат «возможен доступ» (a, s', у, Go)', при этом число преобразова-

ний графов меньше N. Следовательно, по предположению индук-

ции существует s g 5о: (s, у, a) g Ео и s' соединен с s /g-путем в

графе Со. Кроме того, если opN= take(a, х, s', у), то истинен пре-

дикат «возможен docmyn»({t}, х, s', (т0), а если opN=grant(a, s', х, у),

то истинен предикат «возможен docmyn»({g}, s', х, (70); при этом

число преобразований графов меньше N. Следовательно, по пред-

положению индукции существует s" g 5о такой, что если opN =

= take(a, х, s', у), то (s", s', /) g Е(1 и s" соединен с х /g-путем

в графе Go, а если opN = grant(a, s', х, у), то (s", х, g) g Е(1 и

s" соединен с s' /g-путем в графе Со. Таким образом, существует

5 g 50: (s, у, а) с Ео и субъекты х и 5 соединены /g-путем в графе

Со. Для случая s' g 5о индуктивный шаг доказан (рис. 2.10).

Рассмотрим второй случай. Пусть s' <р 50 . Заметим, что число

преобразований графов N минимально, поэтому преобразования

графов удовлетворяют следующим требованиям:

• каждый субъект графа Со создает не более одного субъекта;

• субъект-создатель берет на созданный субъект необходимый

набор прав {/, g};

• созданный субъект не создает новых субъектов.

Справедливость перечисленных требований следует из того, что

если субъект графа Со создает более одного субъекта или создан-

ный субъект создает нового субъекта, то в преобразованиях гра-

фов доступа такие дополнительные субъекты могут быть замене-

ны имеющимися. Следовательно, не будет являться необходимой

операция создания дополнительных субъектов, что противоречит

условию минимальности числа преобразований графов. Требова-

ло

/g-ПУТЬ t tg-TTfTb

ф • • • ..ф ' ' '^ф • • • ф »ф

х s" s' sy

Рис. 2.10. Случай s' е Sa и opN= takeki, х, s', у)

37

Gi s'

/g-путь /g-ПуГЬ

a

0 • —"-Ч i ... *' **

x s" Sy

Рис. 2.11. Случай s' .So и opN= takeG.j., x, s', y)

ние к субъекту-создателю брать на созданный субъект необходи-

мый набор прав {/, g} является, очевидно, необходимым.

Из перечисленных требований следует, что существуют M<N- 1,

s" е 5): орм= create ({t, g}, s", s'). Среди всех последовательностей

преобразований длины N можно выбрать такую, что М= 1. Тогда

рассмотрим граф Gt; при этом St = So u {5Е} = Ео о {(s", s', {t, g})},

истинен предикат «возможен доступ»(а, s', у, Gj с числом пре-

образований меньше /Уи s' е St. Следовательно, существует se <$i:

(5, у, а) с при этом 5 и s' соединены /g-путем в графе Gt.

Очевидно, что 5 е SQ, (s, у, a) с Ео; при этом 5 и s" соединены

/g-путем в графе Со. Кроме того, если opN = take(a, х, s', у),

то истинен предикат «возможен docmyn»({t}, х, s', Gt), а если

opN = grant{a, s', х, у), то истинен предикат «возможен. docmyn»({g},

s', х, G{); при этом число преобразований меньше N. Следователь-

но, так как s" — единственный субъект в графе Gh обладающий

правами доступа на s', то х и s" соединены /g-путем в графе Gt и,

очевидно, в графе Go.

Таким образом, существует 5 е S(l: (s, у, а) Ео; при этом х и

5 соединены /g-путем в графе Go. Для случая s' к 50 индуктивный

шаг доказан (рис. 2.11). Теорема доказана.

Для определения истинности предиката «возможен доступ» в

произвольном графе необходимо определить ряд дополнительных

понятий.

Определение 2.15. Островом в произвольном графе доступов Со

называется его максимальный /g-связный подграф, состоящий

только из вершин субъектов.

Определение 2.16. Мостом в графе доступов Go называется

/g-путь, концами которого являются вершины-субъекты, прохо-

дящий через вершины-объекты, словарная запись которого имеет

следующий вид: /*, /*, /’g/", fgT, где символ * означает много-

кратное (в том числе нулевое) повторение.

Определение 2.17. Начальным пролетом моста в графе доступов

(?о называется /g-путь, началом которого является вершина-

субъект, концом — объект, проходящий через вершины-объек-

ты, словарная запись которого имеет следующий вид: /*g.

Определение 2.18. Конечным пролетом моста в графе доступов

6'0 называется /g-путь, началом которого является вершина-

субъект, концом — объект, проходящий через вершины-объек-

ты, словарная запись которого имеет следующий вид: /*.

38

Теорема 2.6. Пусть Go = (So, О0, Ео) — произвольный граф до-

ступов, х, у е Оц- х у. Предикат «возможен доступ»(а, х, у, Go)

истинен тогда и только тогда, когда выполняются условия 3, 4 и 5.

Условие 3. Существуют объекты ..., sm е О0:

(5,-, у, у,) с Ео для i = 1, ..., /и и а = 7; и ... и ут.

Условие 4. Существуют субъекты х'ь х'т, 5), ..., s'„, е Sy

а) х=х- или х- соединен с х начальным пролетом моста в графе

Go, где i = 1, ..., /и;

б) s = s’i или S- соединен с s конечным пролетом моста в графе

Go, где /= 1, ..., т.

Условие 5. В графе Со для каждой пары (х,', 5,'), где /= 1, ..., т,

существуют острова Д,, ..., w;> 1 такие, что х,' <= s- е IIUi, и

существуют мосты между островами 1у и где j = 1, и^{.

Доказательство. Проведем доказательство теоремы для т= 1,

так как схему доказательства для этого случая легко продолжить в

случае т > 1.

При т= 1 условия 3, 4, 5 формулируются следующим образом

(рис. 2.12).

Условие 3. Существует 5 е О0: (s, у, а) с Ео.

Условие 4. Существуют х', s' е Sy

а) х=х' или х' соединен с х начальным пролетом моста в графе

Gy

б) s = s' или s' соединен с j конечным пролетом моста в графе

Go-

Рис. 2.12. Пример пути передачи объекту х прав доступа а на объект у

39

Условие 5. В графе Go существуют острова 1Ь Iu, и> 1, такие

что х' е s' 6 1и, и существуют мосты между островами Ij и Ij+l,

где j = 1, и -1.

Достаточность. Является очевидным тот факт, что по мостам

возможна передача прав доступа между субъектами, являющими-

ся его концами. В качестве примера разобрана последовательность

преобразований графа доступов при передаче прав по мосту вида

tgt (рис. 2.13).

Также очевидно, что по конечному пролету моста субъект мо-

жет забрать права доступа у объекта, а по начальному пролету

моста — передать его объекту.

Go

® ~Ь create({ t, g}, х, z)

а s У tai(e^g^ 6)

Рис. 2.13. Пример передачи прав доступа по мосту

40

По условию 3 существует объект s, который обладает правами

а на объект у. По условию 4, б существует субъект s', который

либо совпадает с s, либо по конечному пролету моста может за-

брать у субъекта 5 права а на объект у.

По теореме 2.1 права доступа, полученные одним субъектом,

принадлежащим острову, могут быть переданы любому другому

субъекту острова. По условию 5 между островами существуют мос-

ты, по которым возможна передача прав доступа. По условию 4, а

существует субъект х', который или совпадает с х, или, получив

права доступа, может передать их х по начальному пролету моста.

Необходимость. Пусть истинен предикат «возможен доступна,

х, у, Go). По определению истинности предиката существует по-