Author: Бендат Дж. Пирсол А.

Tags: теория вероятностей и математическая статистика теория вероятностей математическая статистика комбинаторный анализ теория графов математика математический анализ информатика

ISBN: 5-03-001071-8

Year: 1989

i

Дж. Бендаi. А. Пирсол

Прикладной анализ

случайных данных

Прикладной анализ случайных данных

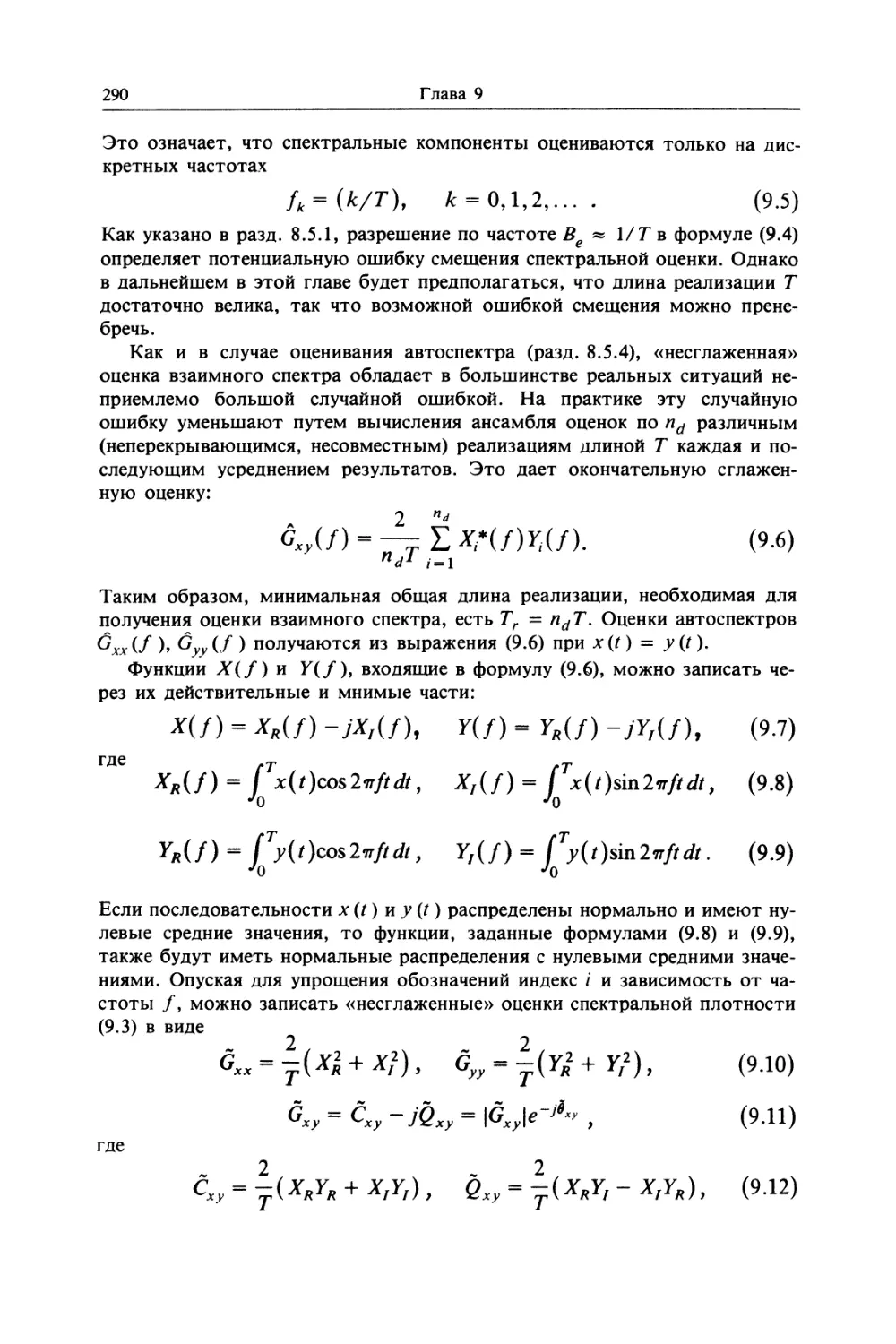

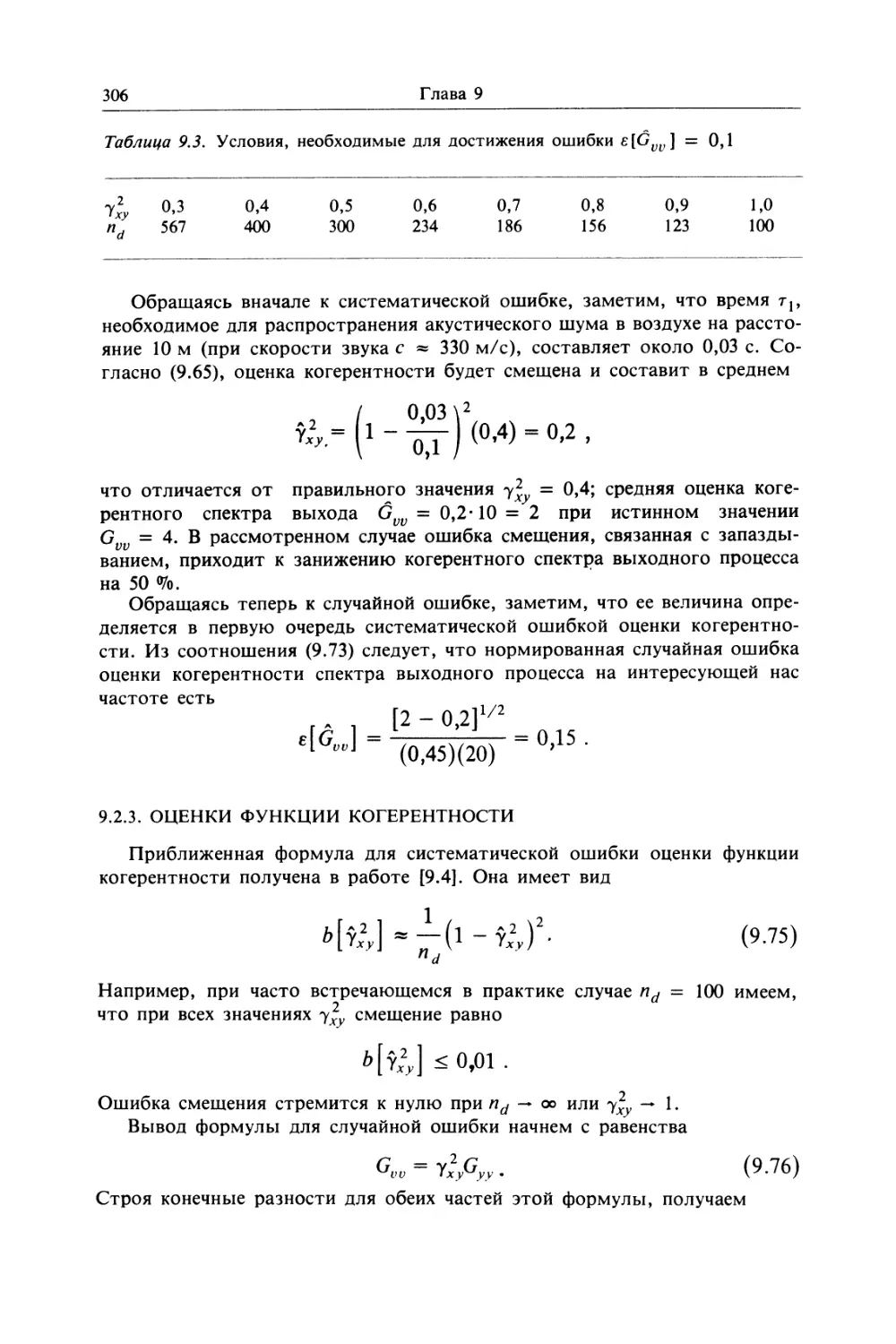

RANDOM DATA

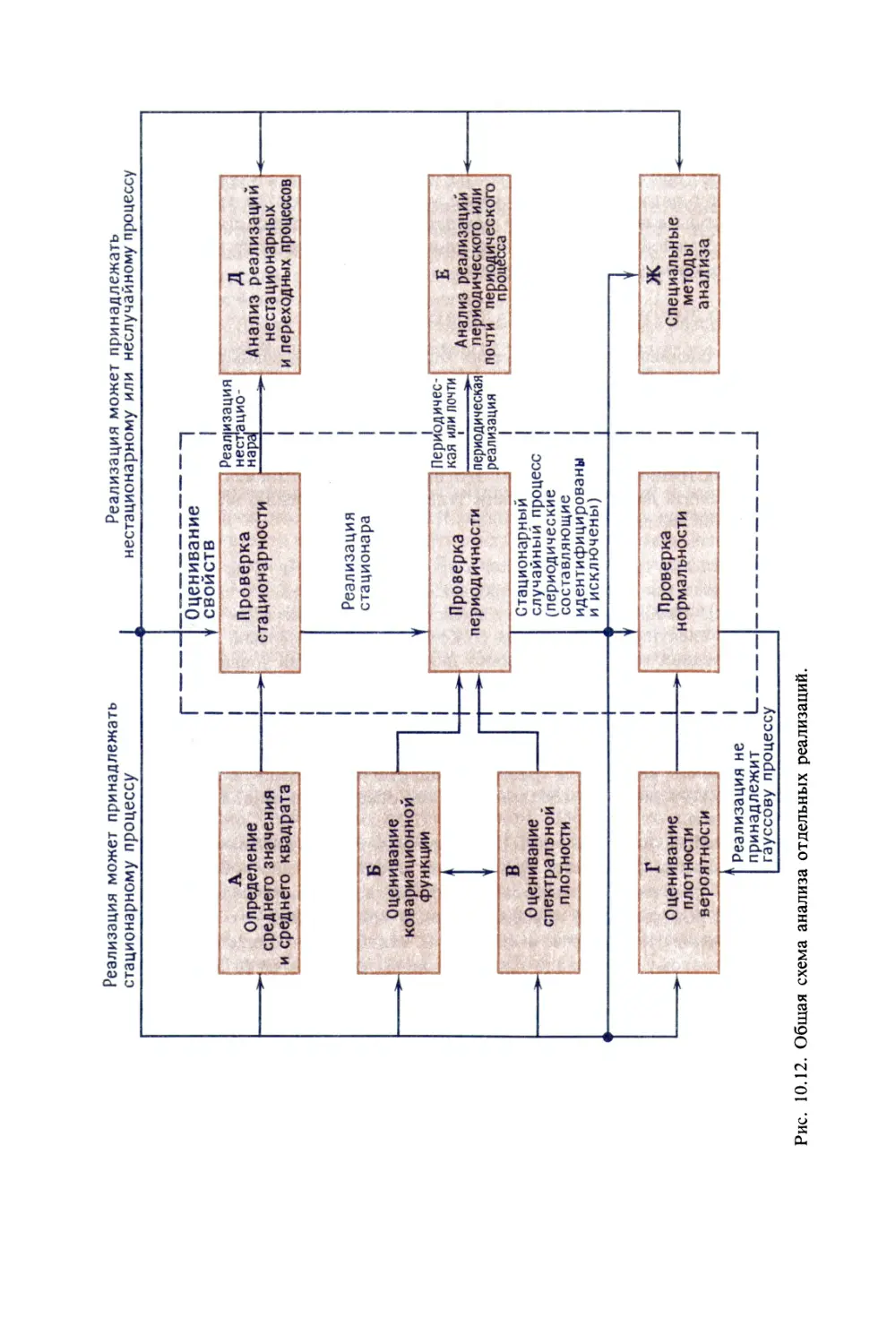

Analysis and Measurement Procedures

Julius S. Bendat

Mathematical Consultant in Random Data Analysis

Allan G. Piersol

Senior Scientist, Astron Research and Engineering

A Wiley-Interscience Publication

JOHN WILEY & SONS

New York • Chichester • Brisbane • Toronto • Singapore

Дж.Бендат, А.Пирсол

Прикладной анализ

случайных данных

Перевод с английского

д-ра физ.-мат. наук В. Е. Привальского

и А. И. Кочубинского

под редакцией

акад. И. Н. Коваленко

Москва «Мир» 1989

Scan AAW

ББК 22.172

Б 46

УДК 519.2

Бендат Дж., Пирсол А.

Б 46 Прикладной анализ случайных данных: Пер. с англ.— М.:

Мир, 1989.— 540 с., ил.

ISBN 5-03-001071-8

Монография известных специалистов из США, посвященная проблемам

сбора и предварительной обработки данных, оценке спектральных плотно-

стей, ковариационных и передаточных функций, использованию этих характе-

ристик для решения прикладных задач, в частности идентификации систем,

определения числа трактов распространения случайных сигналов, выделения

периодических составляющих.

Книга написана ясно и доступно, не перегружена математическими выво-

дами, и в то же время имеет достаточный уровень строгости. Теоретические

положения иллюстрируются многочисленными практическими примерами и

задачами.

Для инженеров и научных работников, а также студентов и аспирантов,

интересующихся практическим анализом случайных данных.

Может служить учебным пособием.

1602090000 — 083

Б-------------------16—89,4.1

041(01) — 89

ББК 22.172

Редакция литературы

по новой технике и космическим исследованиям

ISBN 5-03-001071-8(русск.)

ISBN 0-471-04000-2(англ.)

© 1986 by John Wiley & Sons, Inc.

All rights reserved. Authorized translation from

English language edition published by John Wiley

& Sons, Inc.

© перевод на русский язык, «Мир», 1989

ОТ РЕДАКТОРА ПЕРЕВОДА

Книга известных американских специалистов в области прикладного

анализа случайных процессов посвящена подробному разбору основных

практических методов анализа случайных данных, которые могут исполь-

зоваться для решения очень широкого круга прикладных задач в самых

разных областях науки и техники. Последовательно и на высоком научном

и методическом уровне излагаются все основные этапы анализа случайных

данных: сбор и предварительная обработка, оценивание спектральных ха-

рактеристик, ковариационных функций и частотных характеристик линей-

ных систем, оценка надежности полученных результатов. Подробно о со-

держании и целях книги говорится в предисловии авторов, однако некото-

рые ее разделы заслуживают особого упоминания. Прежде всего отметим

итерационные методы вычисления частотных характеристик линейных си-

стем с коррелированными входными процессами, позволяющие избежать

обращения матриц большой размерности. Несомненный интерес представ-

ляют спектральные методы анализа ряда важных классов нестационарных

случайных процессов. Отметим, наконец, последнюю главу, посвященную

применениям преобразований Гильберта к анализу случайных данных.

Этот предмет вообще редко излагается в литературе прикладной направ-

ленности, вследствие чего, вероятно, преобразования Гильберта совершен-

но недостаточно используются на практике.

В книге приводятся основные сведения из теории вероятностей, матема-

тической статистики и теории случайных процессов; все главы снабжены

задачами, поэтому она может служить прекрасным учебным пособием для

первоначального знакомства с предметом. В то же время широта охвата

материала и хорошо продуманная структура книги позволяют использо-

вать ее как справочник по данной тематике.

Авторы не стремились дать полное математическое обоснование всех

излагаемых ими методов, поэтому изложение порой оказывается поверх-

ностным; иногда без пояснений используются довольно сложные матема-

тические понятия. В тех случаях, когда это препятствует пониманию основ-

ного текста, такие понятия разъясняются в примечаниях. Заметим, однако,

что на практике по имеющейся реализации случайного процесса обычно не

представляется возможным проверить выполнение довольно сложных ус-

ловий, гарантирующих применимость того или иного метода; это чаще

6

От редактора перевода

всего делается по косвенным признакам. Некоторые рекомендации на этот

счет приводятся в данной книге.

Авторы не исчерпывают всего многообразия существующих методов

анализа случайных данных, да и вряд ли это возможно. Заметим все же,

что интенсивно развиваемые в настоящее время параметрические методы,

особенно полезные при анализе коротких реализаций, заслуживают хотя

бы краткого описания.

Параметрический, особенно авторегрессионный спектральный анализ

может служить, по меньшей мере, эффективной заменой описанных в этой

книге традиционных непараметрических методов во многих ситуациях, в

частности при малой длине реализации и наличии априорной информации о

процессе. Таким путем можно анализировать.и многомерные линейные си-

стемы со случайными процессами на входе и выходе. Одно из важных до-

стоинств этого подхода — возможность получать аналитические выраже-

ния для всех оцениваемых спектральных характеристик, одновременно

представив анализируемый процесс разностным стохастическим уравнени-

ем. Подробная информация о параметрическом спектральном анализе со-

держится в работе [11.13], а краткое описание метода и его геофизические

приложения — в [11.14]. Способы построения доверительных интервалов

для авторегрессионных оценок автоспектров описаны в работах [11.14,

11.15], а приближенные результаты для линейной системы с одним вход-

ным и одним выходным процессами с относительно гладкими спектраль-

ными характеристиками дан в работе [11.16]. При достаточно длинных ре-

ализациях точность параметрических и авторегрессионных оценок, по-

видимому, одинакова.

Не вызывает сомнений, что эта книга, как и предыдущие монографии

тех же авторов, окажется полезной специалистам самого разного профиля,

использующим в своей работе методы теории случайных процессов, а так-

же студентам и аспирантам, специализирующимся в этой области, и бу-

дет способствовать внедрению эффективных методов прикладного анализа

случайных процессов в практику научных и инженерных исследований.

И. Н. Коваленко

ПРЕДИСЛОВИЕ К РУССКОМУ ИЗДАНИЮ

Эта книга — четвертая наша работа, опубликованная издательством

«Мир» в переводе на русский язык. Ей предшествовали два более ранних

варианта, вышедшие на английском языке в 1966 и 1971 гг., и дополняю-

щая их книга по приложениям корреляционного и спектрального анализа

(1980 г.). Мы глубоко признательны издательству «Мир» и советским спе-

циалистам, которые взяли на себя труд перевода и редактирования наших

работ. Нам хочется особо отметить вклад сотрудника Института водных

проблем АН СССР В. Е. Привальского, участвовавшего в переводе всех че-

тырех книг. Многие его замечания профессионального характера включа-

лись в более поздние допечатки англоязычных публикаций наших книг и

значительно способствовали их улучшению.

Мы, как и прежде, надеемся, что это издание окажется полезным не

только советским, но и другим читающим по-русски ученым и инженерам,

которые работают в области измерения и анализа случайных процессов са-

мого различного типа.

Лос-Анджелес, Калифорния,

1 декабря 1987 г.

Алан Дж. Пирсол,

Джулиус С. Бендат

ВВЕДЕНИЕ

Эта книга представляет собой существенно переработанное и расширен-

ное издание нашей книги, вышедшей в 1971 г.*\ которая, в свою очередь,

является значительно переработанным вариантом нашей книги «Measu-

rement and Analysis of Random Data», впервые опубликованной в 1966 г.* 2) В

данное издание вошли более совершенные и современные методы измере-

ния и анализа случайных процессов, в которых отражены последние дости-

жения в области построения моделей, оценки статистических ошибок, ме-

тодов сбора данных и вычислительных алгоритмов. Первые четыре главы

содержат основные сведения, необходимые для чтения книги, и охватыва-

ют интуитивные предпосылки теории, свойства линейных систем, основы

теории вероятностей и математической статистики и в целом совпадают

по содержанию с аналогичным материалом, имеющимся в издании 1971 г.

В гл. 5 подробно обсуждаются стационарные случайные процессы, причем

основные понятия излагаются более полно и включены новые разделы, на-

пример раздел, посвященный производным от случайных процессов. В гл.

6 и 7 выводятся и детально анализируются соотношения, связывающие

входные и выходные процессы одномерных и многомерных линейных си-

стем. Особое внимание здесь уделяется современным методам анализа, ко-

торые появились за время, прошедшее с момента выхода предыдущего из-

дания книги. Далее в гл. 8 и 9 выводятся формулы для статистических

ошибок, присущих разнообразным оценкам параметров, в том числе и тем

довольно сложным оценкам, для которых такие формулы в 1971 г. еще не

были получены. Гл. 10 и 11 посвящены изложению современных методов

сбора и цифровой обработки данных с включением дополнительного мате-

риала, относящегося к обработке входных и выходных процессов много-

мерных линейных систем с помощью эффективных итерационных алгорит-

мов. Гл. 12, посвященная нестационарным процессам, полностью перера-

ботана и значительно расширена. Особое внимание в ней уделяется различ-

ным способам спектрального описания нестационарных процессов и выво-

Имеется перевод: Бендат Дж., Пирсон А. Измерение и анализ случайных про-

цессов: Пер. с англ.— М.: Мир, 1974. — 464 с.— Прим, перев.

2) Имеется перевод: Бендат Дж., Пирсон А. Измерение и анапиз спучайных про-

цессов: Пер. с ангп. — М.: Мир, 1971. — 408 с.— Прим, перев.

Введение

9

ду соотношений, связывающих вход и выход линейных систем в случае не-

стационарных входных процессов и(или) линейных систем с зависящими от

времени параметрами. Гл. 13 содержит совершенно новый материал, каса-

ющийся преобразования Гильберта и его применений, который вообще от-

сутствовал в предыдущих изданиях. Для удобства читателя в книгу вклю-

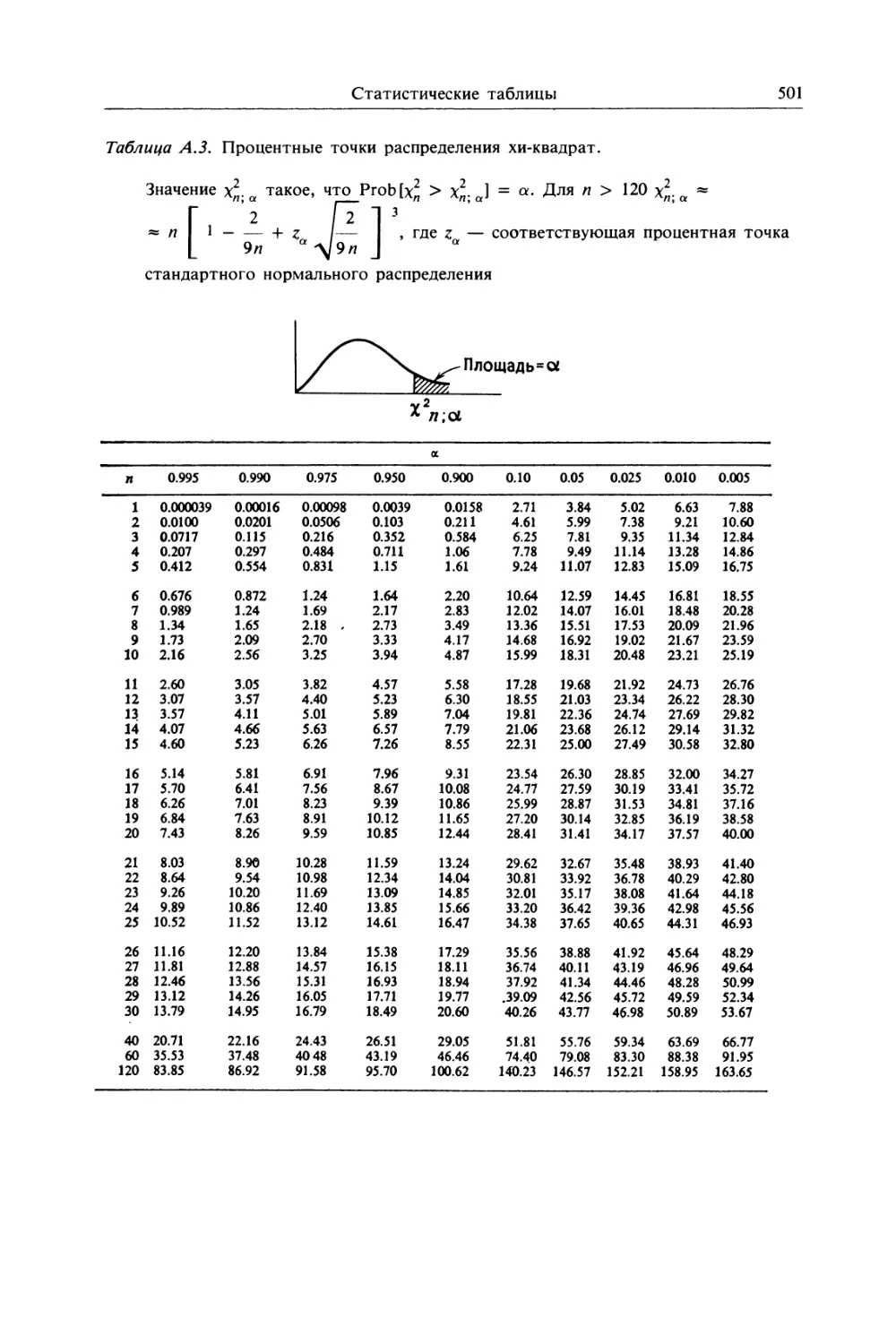

чены приложения А и Б. В приложении А приводится ряд статистических

таблиц, облегчающих пользование книгой, а приложение Б содержит крат-

кие определения основных понятий, относящихся к области анализа случай-

ных процессов, что может способствовать стандартизации терминологии в

этой области.

Как и издание 1971 г., данная книга задумана прежде всего как справоч-

ное пособие для практически работающих инженеров и ученых. Кроме то-

го, авторы стремились дать полное теоретическое введение к своей книге

«Engineering Applications of Correlation and Spectral Analysis», вышедшей в

1980 г.1), имеющей прикладную направленность. Вторая наша цель — дать

учебное пособие студентам, специализирующимся в данной области, поэто-

му в конце каждой главы помещены задачи. Предполагается, что читатель

знаком с основами математического анализа и прикладными аспектами те-

ории преобразований Фурье. Желательно также знакомство с основными

понятиями теории линейных систем, теорци вероятностей и математичес-

кой статистики, хотя в первых главах книги и дается краткий обзор этих

предметов.

Хочется выразить признательность многим нашим коллегам и сотруд-

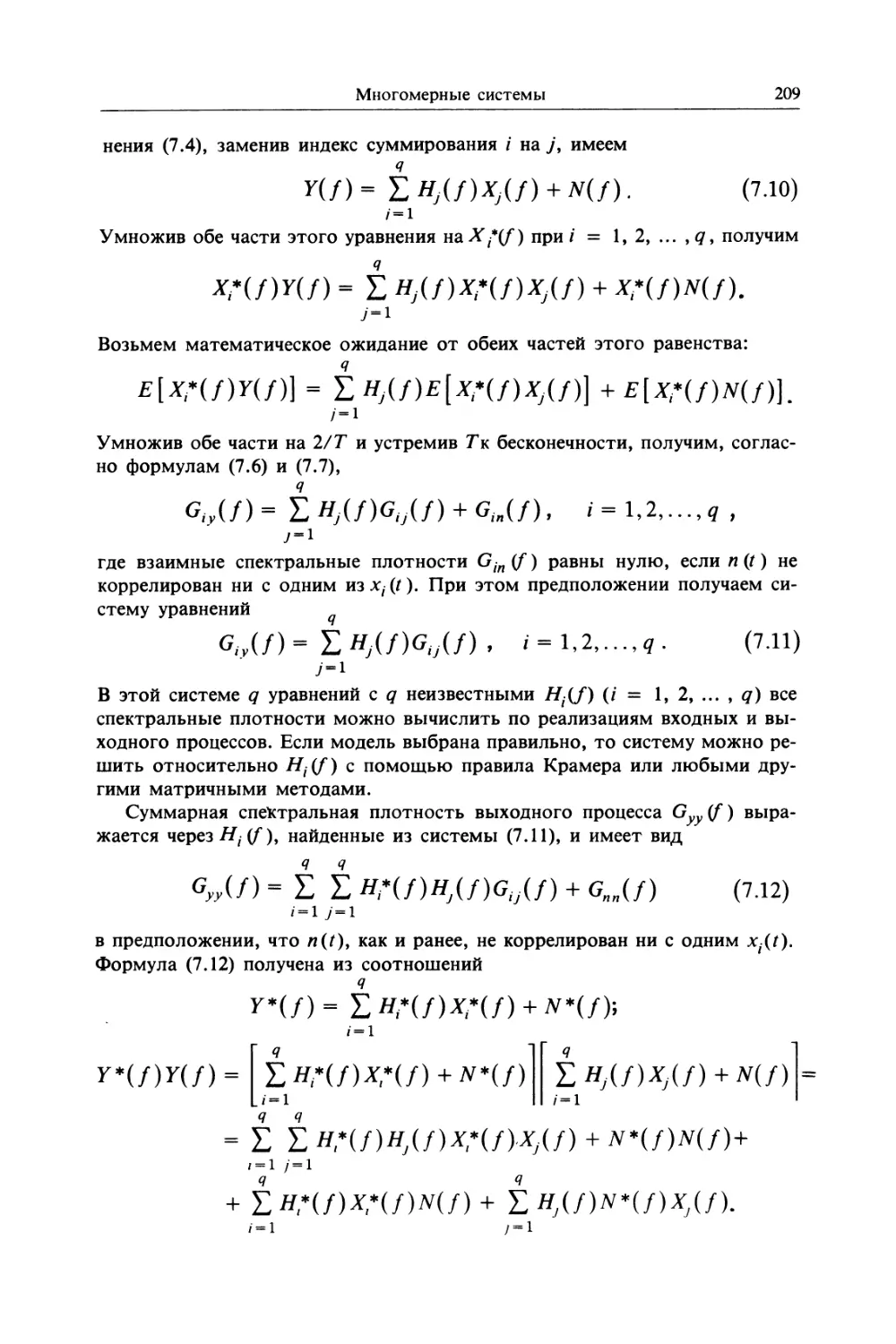

никам за помощь в работе над книгой. Мы особенно благодарны Дж. Рич-

ману, просмотревшему часть, рукописи и сделавшему полезные замечания.

Мы благодарим также правительственные учреждения и частные компа-

ний, оказавшие поддержку нашей работе, а также Калифорнийский универ-

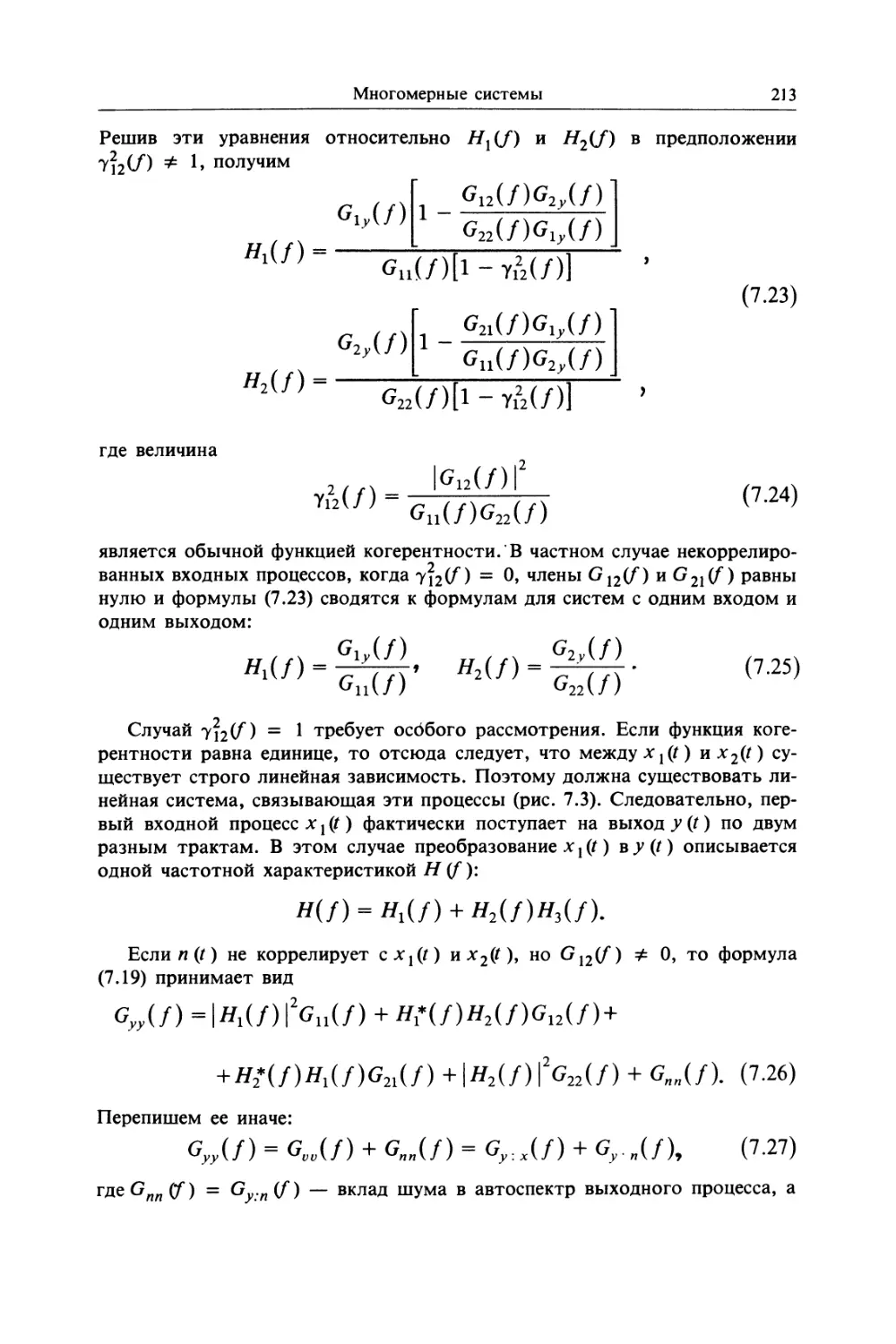

ситет, Институт повышения квалификации и другие организации, которые

поддержали наши семинарские занятия по данной тематике. Наконец, мы

признательны Б. Кларк, И. Салазер и Ф. Паррис за их тщательную работу

по оформлению рукописи.

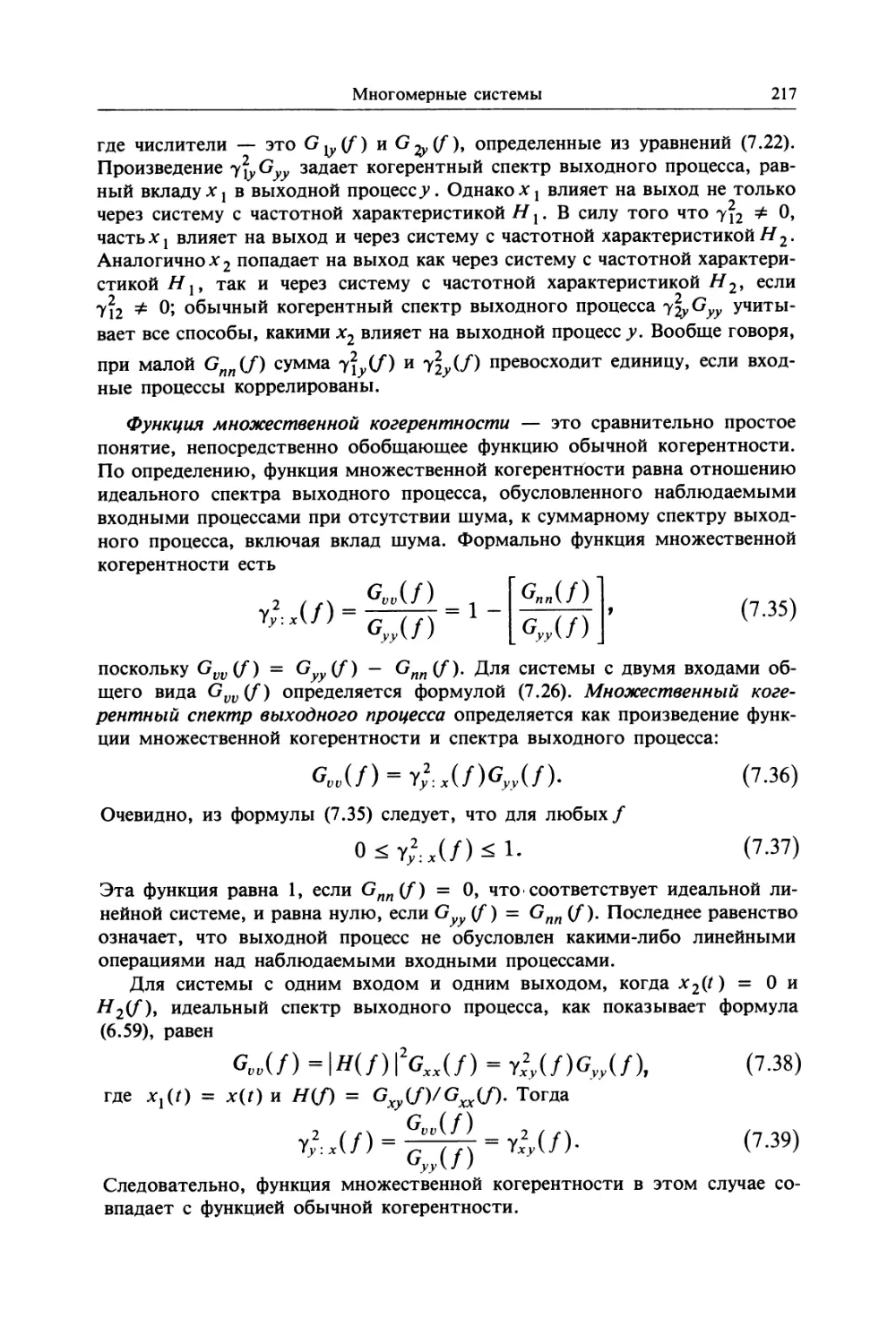

Лос-Анджелес, Калифорния,

январь 1986 г.

Джулиус С. Бендат,

Алан Дж. Пирсол

Имеется перевод: Бендат Дж., Пирсол А. Приложения корреляционного и

спектрального анализа: Пер. с англ.— М.: Мир, 1982. —312 с. — Прим, перев.

СПИСОК ОБОЗНАЧЕНИИ

с.к.о. ФКИПФ ФБИПФ а, b — среднеквадратичное отклонение — фильтры с конечной импульсной переходной функцией — фильтры с бесконечной импульсной переходной функцией — выборочные коэффициенты регрессии; произвольные постоян- ные

А Ь[ ] В — амплитуда; число инверсий — смещение величины [ ] — ширина полосы частот в герцах

с С схх(т) СхУТ) Сху(П e(Z ) f[ ] f Xf FT [ ] Gxv(/) G (f) xy^' G (Л yy x v f Gx.y x (/) W)' h (r) IW(/)I ] i — затухание механической системы; произвольная постоянная — электрическая емкость — ковариация — корреляционная функция — взаимная корреляционная функция — коспектральная плотность (односторонняя) — разность потенциалов — математическое ожидание величины [ ] — циклическая частота — разрешение по частоте — преобразование Фурье функции [ ] — спектральная плотность (односторонняя) — взаимная спектральная плотность (односторонняя) — условная спектральная плотность (односторонняя) — условная взаимная спектральная плотность (односторонняя) — спектральная плотность «энергии» — импульсная переходная функция — частотная характеристика — амплитудная характеристика системы — преобразование Гильберта функции [ ] — индекс

Im[ ] J — ток — мнимая часть [ ] — V — 1; индекс

к К log L L (f) /77 — коэффициент жесткости пружины; индекс — следовое волновое число; число интервалов группировки — натуральный логарифм — электрическая индуктивность; длина — условная частотная характеристика — механическая масса; максимальный сдвиг

"’f — индекс модуляции

Список обозначений

И

п N Р U) р (х У ) Р {х) р (X, у ) Prob [ ], Р Q Q (' ) г г ху R Rxx <г> Rxy <» в ('|.'2), & (т, 1 ) Re [ ] 5 5 2 — число степеней свободы; индекс — размер выборки — плотность вероятности — совместная плотность вероятности — функция распределения — совместная функция распределения — вероятность события [ ] — число входов; число реализаций — электрический заряд — квадратурная спектральная плотность (односторонняя) — число серий; число выходов — выборочный коэффициент корреляции — электрическое сопротивление — ковариационная функция — взаимная ковариационная функция — двойная по времени ковариационная функция — действительная часть [ ] — выборочное стандартное отклонение — выборочная дисперсия — выборочная ковариация

v(/) — спектральная плотность (двусторонняя) — взаимная спектральная плотность (двусторонняя) — условная спектральная плотность (двусторонняя) — условная взаимная спектральная плотность (двусторонняя)

/(/) stfvf2), X (f- g) S/N — спектральная плотность «энергии» (двусторонняя) — двойная по частоте спектральная плотность (двусторонняя) — отношение сигнал/шум

t — время; случайная величина с /-распределением Стью- дента

Д/ T T r Un U (J), V(t ) Var [ ] W 0 — интервал дискретности — длина реализации; период — суммарная длина реализации — исходные значения случайного процесса — величины, зависящие от времени — дисперсия [ ] — ширина интервала — нестационарная частотно-временная спектральная плотность, определенная как для отрицательных, так и для положитель- ных частот (двусторонняя)

x (/ ), у (t ) .V — величины, зависящие от времени — выборочное среднее х

X X(f) X(f, T) z К ]l И Q — амплитуда гармонического процесса х (1 ) — преобразование Фурье функции х (1 ) — преобразование Фурье реализации х (t ) длиной Т — стандартная нормальная случайная величина — абсолютная величина [ ] — оценка [ ] — малая вероятность; уровень значимости; связанная переменная

12

Список обозначений

0 У 1(f) УуХ(/) 5( ) A £ Г е м р Р(т) (J а2 — вероятность ошибки второго рода; связанная переменная — функция обычной когерентности — функция множественной когерентности — функция частной когерентности — дельта-функция — малое приращение — нормированная ошибка — коэффициент механического затухания — фазовый угол — аргумент Gху (f ) — среднее значение — коэффициент корреляции — нормированная корреляционная функция — стандартное отклонение — дисперсия

т Ф(П Ф х2 Ф ф2 — сдвиг времени — фазовая характеристика — произвольный статистический параметр — случайная величина с распределением хи-квадрат — среднеквадратичное значение — средний квадрат

Глава 1

ОСНОВНЫЕ ОПРЕДЕЛЕНИЯ И МОДЕЛИ

Данная глава содержит основные определения и модели детерминиро-

ванных и случайных процессов и имеет целью описать интуитивные пред-

посылки теории, составляющей предмет этой книги. Отличительные

свойства стационарных, эргодических и нестационарных случайных процес-

сов поясняются с помощью классификации по простым признакам наличия

или отсутствия тех или иных свойств. Дается неформальное определение

основных статистических характеристик, описывающих обобщенные

свойства отдельных реализаций стационарных случайных процессов и пар

таких реализаций, а также их свойства во временной и частотной областях.

Формулируются основные типы задач анализа линейных систем, решаемых

в этой книге, а также основные критерии оценки ошибок, свойственных

анализу случайных данных, которые лежат в основе планирования экспери-

ментов и сравнения разных методов анализа.

1.1. Детерминированные и случайные процессы

Любые данные, полученные в результате наблюдения реального физиче-

ского явления, можно отнести, вообще говоря, к детерминированному или

недетерминированному типу. Детерминированные процессы — это процес-

сы, которые можно описать явными математическими формулами. Рас-

смотрим, например, жесткое тело, подвешенное к неподвижной опоре с по-

мощью линейной пружины (рис. 1.1). Пусть т — масса тела (предполага-

ется, что оно неупругое), к — коэффициент жесткости пружины (предпола-

гается, что она не имеет массы). Пусть тело смещено от положения равно-

весия на расстояние X и освобождается в момент времени t = 0. С по-

мощью основных законов механики или на основе многократных наблюде-

ний можно установить, что имеет место следующая зависимость:

t

Уравнение (1.1) позволяет точно определять положение тела в любой буду-

щий момент времени. Следовательно, этот процесс, описывающий движе-

ние тела, является детерминированным.

На практике часто встречаются физические явления, протекание кото-

рых с разумной точностью можно описать явными математическими зави-

симостями. Например, движение спутника по околоземной орбите, измене-

ние потенциала между обкладками конденсатора по мере его разряда через

резистор, колебания несбалансированного вращающегося механизма, изме-

нение температуры воды по мере ее нагревания по сути своей являются де-

терминированными процессами. Однако многие другие физические явления

порождают процессы, которые нельзя считать детерминированными. На-

пример, высота волн при морском ветровом волнении, акустическое давле-

14

Глава 1

|| к

Положение

---1-- равновесия

Рис. 1.1. Простая система, состоящая из тела и

x(t) пружины.

ние, производимое потоком воздуха при его движении по трубе, и электри-

ческий сигнал на выходе генератора шума — это процессы, которые невоз-

можно описать во всех деталях. Совершенно невозможно предсказать точ-

ное значение таких процессов в будущие моменты времени. Эти процессы

случайны по своей сути, и для их описания требуются вероятностные поня-

тия и статистические характеристики.

Отнесение тех или иных физических процессов к детерминированному

или случайному типу зачастую не бесспорно. Например, можно утверж-

дать, что встречающиеся на практике физические процессы вообще не мо-

гут быть в полной мере детерминированными, поскольку никогда нельзя

исключить возможности того, что в будущем произойдет какое-нибудь со-

бытие, которое повлияет на явление, порождающее процесс, совершенно

непредсказуемым образом. С другой стороны, можно утверждать, что нет

и истинно случайных процессов, поскольку может оказаться, что при до-

статочно полном знании основных механизмов явления порождаемый этим

явлением процесс удастся описать точными математическими формулами.

С практической точки зрения решение о случайности или детерминирован-

ности конкретного физического процесса обычно основывается на нашей

способности воспроизвести процесс в ходе контролируемого эксперимента.

Если многократное повторение эксперимента, в ходе которого получается

интересующий нас процесс, приводит к одним и тем же результатам (в

пределах ошибок эксперимента), то этот процесс обычно можно считать

детерминированным. Если же невозможно указать эксперимент, который

давал бы при его повторении идентичные результаты, то такой процесс

обычно считается случайным по своей сути.

Сейчас мы обсудим несколько способов классификации детерминирован-

ных и случайных процессов. Заметим, что принципы классификации выби-

рались с точки зрения удобства анализа и не всегда являются наилучшими

с других возможных точек зрения. Заметим также, что обычно предполага-

ется, что физические процессы представляют собой функции времени, так

что далее для удобства будем пользоваться именно такой интерпретацией.

При желании вместо времени можно взять любую другую независимую пе-

ременную.

1.2. Классификация детерминированных процессов

Процессы, описывающие детерминированные явления, делятся на пе-

риодические и непериодические. В свою очередь периодические процессы

Основные определения и модели

15

Рис. 1.2. Классификация детерминированных процессов.

можно разделить на гармонические и полигармонические. Непериодические

процессы делятся на «почти периодические» и переходные. Такая классифи-

кация детерминированных процессов схематически представлена на рис.

1.2. Разумеется, может встретиться и любое сочетание этих типов. Перей-

дем к краткому обзору всех этих типов детерминированных процессов и

дадим ряд практических примеров.

1.2.1. СИНУСОИДАЛЬНЫЙ ПЕРИОДИЧЕСКИЙ ПРОЦЕСС

Синусоидальный процесс — это периодический процесс, поведение кото-

рого во времени математически выражается следующей формулой:

x(t) = Xsin(2w/Oz + в), (1.2)

где А' — амплитуда,/0 — циклическая частота в герцах, в — начальный фа-

зовый угол в радианах, х (I ) — мгновенное значение в момент t.

Синусоидальный процесс, определенный формулой (1.2), обычно назы-

вается гармоническим. При практическом анализе гармонических процессов

фазовый угол 0 часто игнорируется. В этом случае

х(/) = JfsinZTr/oZ. (1.3)

Уравнение (1.3) графически можно изобразить либо в виде зависимости

мгновенного значения от времени, либо в виде зависимости амплитуды от

частоты (частотного спектра), см. рис. 1.3.

Интервал времени, на котором происходит одно полное колебание или

цикл гармонического процесса, называется периодом Т . Число циклов в

единицу времени называется частотой /0. Частота и период связаны соот-

ношением

1

Тр = 7- (1-4)

JQ

Заметим, что частотный спектр, изображенный на рис. 1.3, состоит из

единственной амплитуды, расположенной на определенной частоте, и этим

16

Глава 1

Рис. 1.3. Реализация и спектр гармонического процесса.

отличается от спектров, задающих непрерывную зависимость амплитуды

от частоты. Такие спектры называются дискретными или линейчатыми.

Известно много примеров физических явлений, которые на практике

приближенно описываются гармоническими процессами. Примером может

служить напряжение на выходе электрического генератора. Другой пример

дают колебания несбалансированного вращающегося груза. Гармонические

процессы являются с точки зрения анализа простейшим видом процессов,

протекающих во времени.

1.2.2. ПОЛИГАРМОНИЧЕСКИЕ ПРОЦЕССЫ

К полигармоническим процессам относятся периодические процессы, ко-

торые математически представляются функцией времени, точно повторяю-

щей свои значения через одинаковые интервалы времени, т. е.

x(t) = x(t + пТр) п = 1,2,3,... . (1-5)

Как и в случае гармонических процессов, интервал времени, в течение кото-

рого происходит одно полное колебание, называется периодом Тр. Число

циклов в единицу времени называется фундаментальной частотой J\. Гар-

монические процессы представляют собой частный случай полигармониче-

ских процессов при j\ = /0.

За редкими на практике исключениями, полигармонические процессы

разлагаются в ряд Фурье по формуле

а0 £

x(t) = — + д, (ancos2irnf1t 4- bnsin2trrnflt)f (1.6)

И=1

где/j = \/Тр и

2 ст

ап = — I px(t)cos2irnfltdt1 п = 0,1,2,...;

тр Jo

2 fT

bn = — I px(t)sin2irnf1tdt, n = 1,2,3,... .

Гр-'о

Другое представление полигармонических процессов рядом Фурье дает

формула

Основные определения и модели

17

х(‘) = хо + Е - 0„), (1.7)

Л = 1

где Хо = а 0/2 и

Хп - ^ап + » п ~ 1’ 2, 3, ... ;

Ь„

6п = arctg —, п = 1, 2, 3, ... ;

ап

иначе говоря, формула (1.7) утверждает, что полигармонический процесс

есть сумма постоянной составляющей XQ и бесконечного числа гармониче-

ских составляющих, называемых гармониками и имеющих амплитуды Хп и

фазы 0п . Все частоты гармонических составляющих кратны фундаменталь-

ной частоте f j.

При практическом анализе периодических процессов фазовые углы 0п ча-

сто игнорируются. В этом случае формулу (1.7) можно охарактеризовать

дискретным спектром, как показано на рис. 1.4. Иногда полигармонические

процессы содержат только конечное число составляющих. В других случаях

может отсутствовать фундаментальная составляющая. Например, пусть

периодический процесс образован суммой трех гармонических процессов с

частотами 60, 75 и 100 Гц. Наибольший общий делитель этих частот равен

5 Гц, т. е. период этого процесса равен 0,2 с. Поэтому при разложении в

ряд Фурье все величины Хп равны нулю, кроме соответствующих значени-

ям п = 12, 15 и 20.

Физические явления, описываемые полигармоническими процессами,

встречаются намного чаще, чем явления, порождающие простые гармони-

ческие процессы. Фактически многие полигармонические процессы рассмат-

риваются как простые только приближенно. Например, детальный анализ

напряжения на выходе электрического генератора может выявить неболь-

шие составляющие на высших гармониках. В других случаях физические пе-

риодические процессы имеют много мощных гармоник. Например, вибра-

ция многоцилиндрового двигателя внутреннего сгорания обычно содержит

значительное число мощных гармоник.

18

Глава 1

1.2.3. ПОЧТИ ПЕРИОДИЧЕСКИЕ ПРОЦЕССЫ

В разд. 1.2.2 было отмечено, что периодический процесс обычно пред-

ставляется в виде ряда, состоящего из гармонических процессов с соизме-

римыми частотами. И наоборот, любой процесс, образованный суммой

двух и более гармонических процессов с соизмеримыми частотами, будет

периодическим. Однако если процесс образован суммой двух и более гар-

монических процессов с произвольными частотами, то он, как правило, не

будет периодическим. Точнее говоря, сумма двух и более гармонических

процессов будет периодическим процессом тогда и только тогда, когда от-

ношение любых двух частот есть рациональное число. В этом случае су-

ществует фундаментальный период, который удовлетворяет уравнению

(1.5). Поэтому процесс

х(/) = A^sin^Z + #i) + Jf2sin(3/ + 02) + Jf3sin(7/ 4- 03)

периодический, так как 2/3, 2/7 и 3/7 — рациональные числа (фундамен-

тальный период Тр = 1). С другой стороны, процесс

x(t) = X1sin(2/ + 4- Jf2sin(3z 4- в2) 4- Jf3sin(\/5O t 4- 03)

не периодический, так как 2/V50 и 3/V5O не рациональные числа (фундамен-

тальный период бесконечно велик). Реализация такого процесса носит

почти периодический характер, но соотношение (1.5) не выполняется ни

при каком конечном значении Тр .

На основании этих соображений почти периодические процессы опреде-

ляются математически как функция времени вида

00

х(г) = £ X„sin(2w/„r + 0„), (1.8)

п = 1

причем fn/fm не для всех значений индексов являются рациональными чис-

лами. На практике почти периодические процессы порождаются физически-

ми явлениями, в которых одновременно действуют гармонические процес-

сы, не связанные между собой. Хороший пример дает вибрация многомо-

торного винтового самолета, в котором двигатели не синхронизированы.

Почти периодические процессы обладают следующим важным свойст-

вом. Если исключить из рассмотрения фазовые углы Оп, то формулу (1.8)

Рис. 1.5. Спектр почти периодического процесса.

Основные определения и модели

19

можно охарактеризовать дискретным спектром, подобным спектру поли-

гармонического процесса. Единственное отличие состоит в том, что отно-

шения частот составляющих не являются рациональными числами (рис.

1.5).

1.2.4. ПЕРЕХОДНЫЕ НЕПЕРИОДИЧЕСКИЕ ПРОЦЕССЫ

По определению, переходные процессы — это все непериодические про-

цессы, за исключением почти периодических процессов, определенных в

разд. 1.2.3. Другими словами, к переходным относятся все процессы, кото-

рые можно задать какой-либо функцией времени, за исключением рассмот-

ренных выше.

К переходным процессам приводят многочисленные и самые разно-

образные явления. Например, процесс, показанный на рис. 1.6, а, может

представлять температуру воды в чайнике (по отношению к температуре

помещения) после выключения нагревателя. Процесс, изображенный на

рис. 1.6,6, может характеризовать свободные колебания демпфированной

механической системы после прекращения действия вынуждающей силы.

Процесс, представленный на рис. 1.6, в, может описывать напряжение в

тросе с нагруженным концом, который разрывается в моменте.

Важная особенность переходных процессов, отличающая их от периоди-

ческих и почти периодических, состоит в том, что их нельзя охарактеризо-

вать дискретным спектром. В большинстве случаев для переходных процес-

сов можно получить непрерывное спектральное представление, используя

преобразование Фурье вида

/00

x^e-^f'dt. (1.9)

- 00

Вообще говоря, преобразование Фурье X (f) является комплексной величи-

ной, которая записывается в полярной форме:

*(/) = |Д/ЖА/)-

Рис. 1.6. Примеры переходных процессов.

20

Глава 1

Рис. 1.7. Спектры переходных процессов.

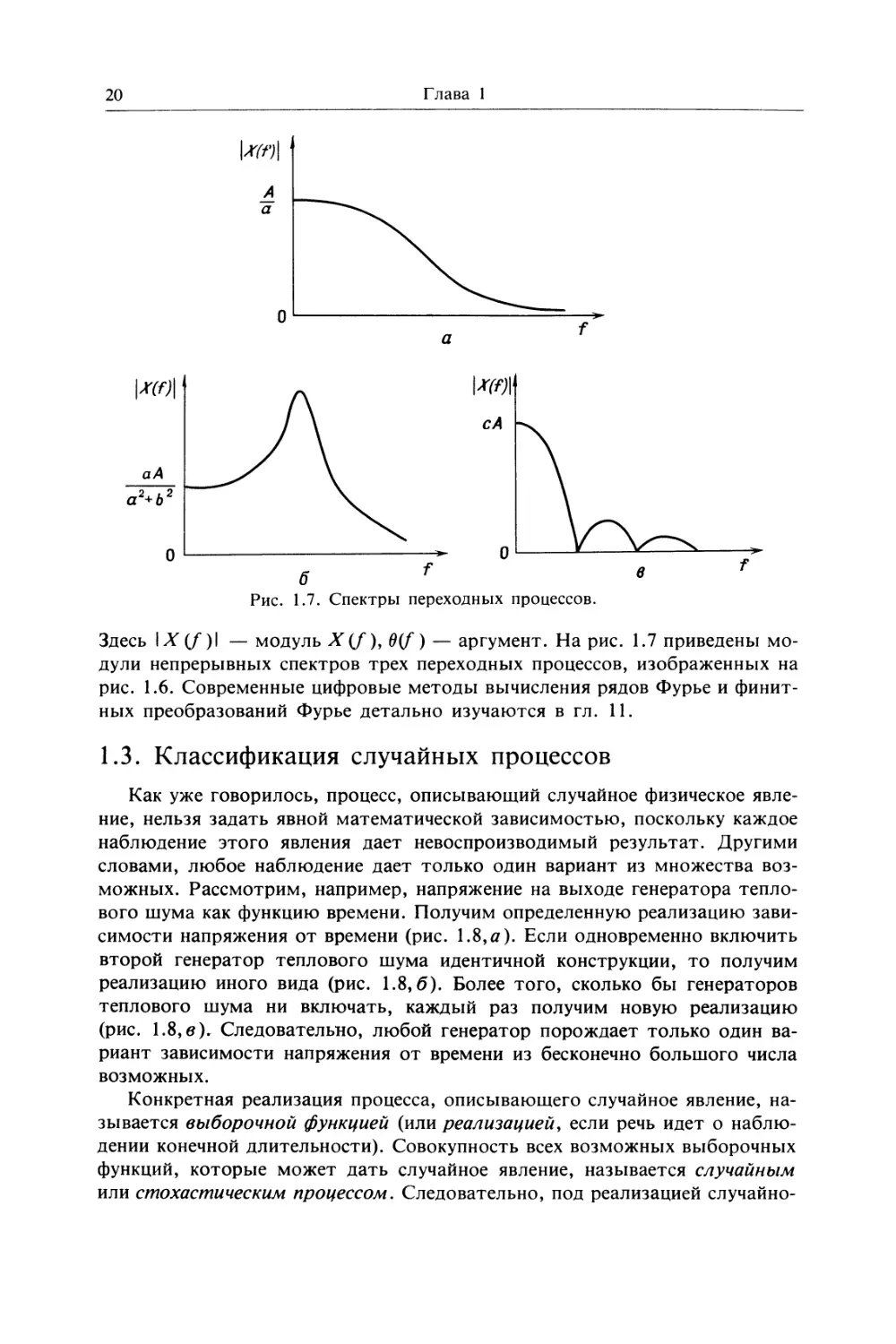

Здесь IJV(/)I — модуль X(f), 6(f) — аргумент. На рис. 1.7 приведены мо-

дули непрерывных спектров трех переходных процессов, изображенных на

рис. 1.6. Современные цифровые методы вычисления рядов Фурье и финит-

ных преобразований Фурье детально изучаются в гл. 11.

1.3. Классификация случайных процессов

Как уже говорилось, процесс, описывающий случайное физическое явле-

ние, нельзя задать явной математической зависимостью, поскольку каждое

наблюдение этого явления дает невоспроизводимый результат. Другими

словами, любое наблюдение дает только один вариант из множества воз-

можных. Рассмотрим, например, напряжение на выходе генератора тепло-

вого шума как функцию времени. Получим определенную реализацию зави-

симости напряжения от времени (рис. 1.8,а). Если одновременно включить

второй генератор теплового шума идентичной конструкции, то получим

реализацию иного вида (рис. 1.8, б). Более того, сколько бы генераторов

теплового шума ни включать, каждый раз получим новую реализацию

(рис. 1.8,в). Следовательно, любой генератор порождает только один ва-

риант зависимости напряжения от времени из бесконечно большого числа

возможных.

Конкретная реализация процесса, описывающего случайное явление, на-

зывается выборочной функцией (или реализацией, если речь идет о наблю-

дении конечной длительности). Совокупность всех возможных выборочных

функций, которые может дать случайное явление, называется случайным

или стохастическим процессом. Следовательно, под реализацией случайно-

Основные определения и модели

21

а

Время

в

Рис. 1.8. Выборочные функции на выходе генератора теплового шума.

го физического явления понимается один из возможных исходов случайно-

го процесса.

Случайные процессы делятся на стационарные и нестационарные. В

свою очередь стационарные случайные процессы делятся на эргодические и

неэргодические. Дальнейшая классификация нестационарных случайных

процессов проводится по особенностям их нестационарностей. Классифика-

ция случайных процессов схематически показана на рис. 1.9. Рассмотрим

Рис. 1.9. Классификация случайных процессов.

22

Глава 1

более подробно содержание и физический смысл всех этих понятий. Точ-

ные определения и соотношения приведены в гл. 5 и 12.

1.3.1. СТАЦИОНАРНЫЕ СЛУЧАЙНЫЕ ПРОЦЕССЫ

Если физическое явление описывается случайным процессом, то свой-

ство этого явления в принципе можно оценить в любой момент времени

путем усреднения по совокупности выборочных функций, образующих слу-

чайный процесс. Рассмотрим, например, совокупность выборочных функ-

ций (называемую также ансамблем), определяющую случайный процесс,

изображенный на рис. 1.10. Среднее значение (первый момент) этого слу-

чайного процесса в момент времени t j можно вычислить, взяв мгновенные

значения всех выборочных функций ансамбля в момент времени t j, сложив

эти значения и разделив на число выборочных функций. Аналогичным об-

разом ковариацию (смешанный момент) значений случайного процесса в

два различных момента времени (эта величина называется ковариационной

функцией) вычисляется путем усреднения по ансамблю произведений мгно-

венных значений в моменты времени^ и/j 4- т. Следовательно, среднее

значение рх (t j) и ковариационная функция Rxx (t t { 4- т) случайного про-

цесса {х(О], где символ [ ] обозначает ансамбль выборочных функций,

определяется формулами

= lim 77 Е (1.10а)

N->oo /V /r = 1

1 N

+ t) = lim — £ xk(ti)xk(tl + t), (1.106)

У-* 00 /V £ = !

в которых суммирование производится в предположении равновероятности

всех выборочных функций.

В общем случае, когда (t j) и Rxx (t \ 4- т), определенные уравнени-

ями (1.10), зависят от момента времени t и случайный процесс [х (t )j назы-

вается нестационарным. В том частном случае, когда fix(tx) и R^tt 4- т)

не зависят от момента времени t j, случайный процесс называется слабо

стационарным или стационарным в широком смысле. Среднее значение

слабо стационарного процесса постоянно, а ковариационная функция зави-

сит только от сдвига времени т, т. е. mx(zi) = 1*х и ^rx(G» G + т) =

= *хх (г)-

Для определения полного набора функций распределения, задающих

структуру случайного процесса [х (t)], нужно вычислить бесконечное число

моментов и смешанных моментов высших порядков. В том случае, когда

все моменты и смешанные моменты инвариантны во времени, случайный

процесс [х (t)] называется строго стационарным или стационарным в уз-

Основные определения и модели

23

Рис. 1.10. Ансамбль реализаций, задающих случайный процесс.

ком смысле1). Во многих приложениях проверка слабой стационарности

позволяет обосновать строгую стационарность.

1.3.2. ЭРГОДИЧЕСКИЕ СЛУЧАЙНЫЕ ПРОЦЕССЫ

В разд. 1.3.1 было показано, как можно определить характеристики слу-

чайного процесса путем усреднения по ансамблю в определенные моменты

времени. Однако в большинстве случаев характеристики стационарного

случайного процесса можно вычислить, усредняя по времени в пределах от-

дельных выборочных функций, входящих в ансамбль. Возьмем, например,

к-ю выборочную функцию ансамбля, изображенного на рис. 1.10. Среднее

значение (к) и ковариационная функция Rxx (т, к), вычисленные по к -й

Авторы не рассматривают случай, когда некоторые моменты распределения

могут не существовать.— Прим. ред.

24

Глава 1

реализации, равны

1

MxU) = lim / ХМ dt,

Т —» оо Г •'о

1 гТ

lim — xk(t)xk(t + т) dt.

Т-* оо Г •'о

(1.11а)

(1.116)

Если случайный процесс [ х(Г)] стационарен, а рх(к) и Rxx(t, к), вычислен-

ные по различным реализациям согласно формулам (1.11), совпадают, то

случайный процесс называется эргодическим. Для эргодических процессов

средние значения и ковариационные функции, полученные усреднением по

времени (как и другие характеристики, вычисленные усреднением по време-

ни), равны аналогичным характеристикам, найденным усреднением по ан-

самблю, т. е. рх(к) = 1лх и Rxx(t, к) = /^(т). Отметим, что свойством

эргодичности могут обладать только стационарные процессы.

Очевидно, что эргодические случайные процессы образуют очень важ-

ный класс случайных процессов, поскольку все свойства эргодических про-

цессов можно определить по единственной выборочной функции. К счас-

тью, на практике стационарные случайные процессы обычно оказываются

эргодическими. Именно по этой причине свойства стационарных случай-

ных явлений часто можно определить по одной наблюдаемой реализации.

Подробное изложение свойств эргодических случайных процессов дается в

гл. 5.

1.3.3. НЕСТАЦИОНАРНЫЕ СЛУЧАЙНЫЕ ПРОЦЕССЫ

К нестационарным процессам относятся все случайные процессы, не

удовлетворяющие условиям стационарности, сформулированным в разд.

1.3.1. Если не наложены дополнительные ограничения, то свойства неста-

ционарных случайных процессов обычно зависят от времени и могут быть

установлены только путем усреднения в отдельные моменты времени по

ансамблю выборочных функций, образующих процесс. На практике часто

не удается получить достаточное для точной оценки свойств процесса чис-

ло реализаций. Этим фактом объясняется отставание в развитии практиче-

ских методов измерения и анализа нестационарных случайных процессов.

Во многих случаях нестационарные случайные процессы, отвечающие

реальным физическим явлениям, имеют особенности, упрощающие их ана-

лиз и измерение. Например, иногда случайные данные удается представить

в виде случайного процесса [х(0], все выборочные функции которого име-

ют вид x(t) = a(t)u(t). Здесь u(t) — выборочная функция стационарно-

го случайного процесса [и (О), a a(t) — детерминированная функция. Дру-

гими словами, данные представляются нестационарным случайным процес-

сом, все выборочные функции которого имеют общий детерминированный

тренд. Если нестационарный случайный процесс имеет такой вид, то для

описания его свойств не всегда требуется усреднение по ансамблю. Иногда

Основные определения и модели

25

многие важные свойства удается оценить по единственной выборочной

функции, как и в случае эргодических стационарных процессов. Подробно

такие задачи изучаются в гл. 12.

1.3.4. СТАЦИОНАРНОСТЬ ВЫБОРОЧНЫХ ФУНКЦИЙ

Понятие «стационарность», введенное и рассмотренное в разд. 1.3.1,

относится к средним по ансамблю свойствам случайного процесса. Однако

на практике часто говорят о стационарности или нестационарности дан-

ных, представляющих собой единственную реализацию случайного явле-

ния. В этом случае стационарность понимается в несколько ином смысле.

Если о единственной реализации говорят как о стационарной, то обычно

имеют в виду, что ее свойства, определенные на коротких интервалах вре-

мени, существенно не изменяются от интервала к интервалу. Слово «су-

щественно» означает здесь, что наблюдаемые колебания превосходят от-

клонения, которые можно объяснить обычной выборочной изменчивостью

статистических оценок.

Чтобы пояснить это соображение, рассмотрим одну реализацию хк (t),

являющуюся к-й выборочной функцией случайного процесса (х (t )]. Пусть

среднее значение и ковариационная функция оценены по небольшому интер-

валу длиной Т с началом в точке t j, т. е.

М'р к) = ~ р + Тхк(1) dt, (1.12а)

1 \

Rjji> li + тД) = rf''l + Txk(t)xk(t + r)dt. (1.126)

В общем случае, когда выборочные величины, определенные формулами

(1.12), сильно изменяются с изменением начального момента t выбороч-

ная функция называется нестационарной. В том частном случае, когда вы-

борочные свойства величин (1.12) не изменяются существенно с изменением

начального момента ti9 реализация называется стационарной. Заметим,

что реализация эргодического случайного процесса стационарна. В то же

время выборочные функции большинства практически интересных неста-

ционарных случайных процессов не стационарны. Поэтому при выполне-

нии свойства эргодичности (что справедливо для большинства стационар-

ных физических явлений) проверка стационарности одной реализации явля-

ется эффективным методом проверки в целом предположения стационарно-

сти и эргодичности случайного процесса, из которого эта реализация полу-

чена. Методы проверки стационарности отдельных реализаций изучаются в

гл. 4 и 10.

1.4.. Анализ случайных данных

Анализ случайных данных основан на иных соображениях, чем анализ

детерминированных данных, описанных в разд. 1.2. В частности, в силу

26

Глава 1

того что реализацию случайного процесса нельзя задать явной математи-

ческой формулой, для оценки свойств таких данных должны использовать-

ся статистические методы. Тем не менее случайные процессы удовлетворя-

ют вполне определенным соотношениям, описывающим преобразования

этих процессов; эти соотношения играют ключевую роль во многих прило-

жениях. В таких приложениях важно уметь выявлять и учитывать стати-

стические ошибки, связанные с оценками параметров и соотношениями

между входными и выходными процессами преобразований.

1.4.1. ОСНОВНЫЕ ХАРАКТЕРИСТИКИ СЛУЧАЙНЫХ ПРОЦЕССОВ

Основные статистические характеристики, имеющие важное значение

для описания свойств отдельных реализаций стационарных случайных про-

цессов, таковы:

1) средние значения и средние квадраты;

2) плотности вероятности;

3) ковариационные функции;

4) функции спектральной плотности.

При обсуждении интуитивных предпосылок теории поучительно дать

описательные определения этих величин, не прибегая к математическим

формулам. Затем в качестве примеров будут рассмотрены некоторые осо-

бенно интересные частные случаи.

Среднее значение и дисперсия ах2 стационарной реализации случайного

процесса характеризуют соответственно центр рассеяния и величину рассея-

ния данных. Средний квадрат ^А2, равный сумме дисперсии и квадрата сред-

него значения, является мерой того и другого одновременно. Среднее зна-

чение оценивается простым усреднением всех значений реализации. Анало-

гичным усреднением квадратов значений реализации оценивается средний

квадрат. Если перед возведением в квадрат из значений реализации вычи-

тать среднее значение, то такое усреднение даст оценку дисперсии.

Плотность вероятности р (х ) стационарной реализации задает скорость

изменения вероятности в зависимости от значения реализации. Функция

р (х) обычно оценивается путем вычисления вероятности того, что мгно-

венное значение отдельной реализации заключено в узком интервале, центр

которого пробегает область значений процесса, с последующим делением

на ширину интервала. Общая площадь, ограниченная графиком плотности

вероятности по всей его области определения, равна единице, что просто

свидетельствует о достоверности события, заключающегося в том, что

значения реализации содержатся между — оо и +оо. Часть этой площади,

лежащая левее данного значения х, определяет функцию распределения,

обозначаемую Р (х). Часть площади, ограниченная графиком плотности

между произвольными двумя значениями хг их2 и равная Р(х2) — Р (хг),

задает вероятность того, что значения реализации в наугад выбранный мо-

мент времени попадут в этот интервал значений процесса. Плотности веро-

ятности и функции распределения подробно изучаются в гл. 3 и 4.

Ковариационная функция Rxx (т) стационарного процесса задает меру за-

висимости его значений, сдвинутых относительно друг друга на определен-

Основные определения и модели

27

б

г

Рис. 1.11. Четыре примера реализаций случайных процессов: а — гармонический

процесс; б — гармонический процесс плюс случайный шум; в — узкополосный слу-

чайный шум; г — широкополосный случайный шум.

ный интервал времени. Чтобы оценить ковариационную функцию, следует

сдвинуть реализацию на время т, перемножить исходную и сдвинутую реа-

лизации и усреднить полученные произведения по всей реализации или по

некоторому ее отрезку. Эта процедура выполняется для всех требуемых

значений сдвига времени.

Спектральная плотность (иначе, спектр мощности) Gxx(f) стационар-

ной реализации задает скорость изменения среднего квадрата в зависимо-

сти от частоты. Для оценивания спектра вычисляется средний квадрат в

28

Глава 1

узкой полосе частот при разных центральных частотах, а затем полученное

значение делится на ширину этой полосы. Общая площадь, лежащая под

графиком спектральной плотности по всей полосе частот, равна суммарно-

му среднему квадрату реализации. Часть этой площади, заключенная меж-

ду частотами j\ и /2> равна среднему квадрату, сосредоточенному в этой

Рис. 1.12. Плотности вероятности: а — гармонический процесс; б — гармониче-

ский процесс плюс случайный шум; в — узкополосный случайный шум; г — широко-

полосный случайный шум.

Основные определения и модели

29

полосе частот. Ковариационные функции и спектральные плотности изуча-

ются в гл. 5.

На рис. 1.11 показаны типичные реализации гармонического процесса,

гармонического процесса в случайном шуме, узкополосного шума и широ-

кополосного шума. На рис. 1.12—1.14 приводятся вычисленные теоретиче-

ски соответственно плотности вероятности, ковариационные функции и

КХХМ

АЛ » г

Рис. 1.13. Ковариационные функции: а — гармонический процесс; б — гармони-

еский процесс плюс случайный шум; в — узкополосный случайный шум; г — широ-

ополосный случайный шум.

30

Глава 1

спектральные плотности этих процессов. Формулы, по которым были по-

строены эти графики, выводятся наряду с другими в гл. 5.

Для пар реализаций, принадлежащих двум разным стационарным слу-

чайным процессам, важное значение имеют совместные статистические ха-

рактеристики, а именно:

1) совместные плотности вероятности;

2) взаимные ковариационные функции;

Gn(f)

О

Рис. 1.14. Спектральные плотности: а — гармонический процесс; б — гармони-

ческий процесс плюс случайный шум; в — узкополосный случайный шум; г — широ-

кополосный случайный шум.

Основные определения и модели

31

3) взаимные спектральные плотности;

4) частотные характеристики;

5) функции когерентности.

Первые три функции описывают основные свойства пары реализаций по

принимаемым ими значениям и по их свойствам во временной и частотной

областях. По известным взаимной спектральной плотности и спектраль-

ным плотностям реализаций можно теоретически вычислить линейные ча-

стотные характеристики (амплитудные и фазовые характеристики), связы-

вающие эти две реализации. В этом случае реализации считаются входом и

выходом некоторой линейной системы. Функция когерентности характери-

зует точность принятой линейной модели и тоже может быть вычислена

по измерениям спектральной и взаимной спектральной плотностей. Де-

тально этот предмет рассматривается в гл. 5—7.

Плотности вероятности и функции распределения обычно применяются,

помимо описания вероятностной структуры процесса, с целью:

1) проверки нормальности;

2) выявления нелинейностей;

3) анализа экстремальных значений.

Основные применения ковариационных функций охватывают:

1) выявление периодичностей;

2) выделение сигналов из шума;

3) измерение запаздываний;

4) локализацию источников помех:

5) идентификацию трактов и скоростей распространения сигналов.

В число типичных применений спектральных плотностей входят:

1) определение свойств систем по наблюдениям входных и выходных

процессов:

2) предсказание выходных процессов по входным процессам и свойст-

вам системы;

3) идентификация входных процессов по выходным процессам и свойст-

вам системы;

4) задание динамических данных для тестовых программ;

5) идентификация источников энергии и шума;

6) оптимальный линейный прогноз и фильтрация.

1.4.2. СООТНОШЕНИЯ МЕЖДУ ВХОДНЫМИ И ВЫХОДНЫМИ

ПРОЦЕССАМИ

Большинство задач преобразования входного процесса в выходной мож-

но сформулировать в виде одной из следующих моделей или их комбина-

ций:

1) модель с одним входом и одним выходом;

2) модель с одним входом и несколькими выходами:

3) модель с несколькими входами и одним выходом;

4) модель с несколькими входами и несколькими выходами.

Во всех случаях сигналы от каждого входа к каждому выходу проходят по

одному или нескольким параллельным трактам, имеющим разные запаз-

32

Глава 1

n(t)

Рис. 1.15. Система с одним входом, одним выходом и шумом на выходе.

дывания. В системах с несколькими входами входные процессы могут кор-

релировать или не коррелировать между собой. Если процессы не стацио-

нарны, то анализ проводится специальными методами, которые рассмат-

риваются в гл. 12.

Простая система с, одним входом и одним выходом изображена на рис.

1.15. Здесь х (t) и у (t) — наблюдаемые входные и выходные реализации

стационарных процессов, п (t) — ненаблюдаемый внешний шум. Величина

Hxy(f) — частотная характеристика линейной системы с постоянными па-

раметрами, преобразующей x(t) в у (/). На рис. 1.16 показана система с

одним входом и несколькими выходами, представляющая собой простое

обобщение системы, изображенной на рис. 1.15; здесь входной сигнал x(t)

вызывает несколько выходных сигналов y^t) (i = 1, 2, 3, ... , г). Выход-

ной сигнал у, (t) является результатом преобразования x(t) линейной си-

стемой с постоянными параметрами, задаваемой частотной характеристи-

кой Шумовые процессы л, (О описывают влияние внешнего шума

на соответствующие выходные сигналы. Из рис. 1.16 понятно, что такая

система может рассматриваться как комбинация отдельных систем с од-

ним входом и одним выходом.

Методы изучения систем с одним выходом излагаются в гл. 6 в терми-

нах оценок спектральных и взаимных спектральных плотностей. Там же

определены функции обычной когерентности, играющие ключевую роль

как в задачах идентификации систем, так и в задачах идентификации источ-

ников. Для определения амплитудной и фазовой составляющих искомой ча-

стотной характеристики необходимо знать взаимную спектральную плот-

ность между входным и выходным процессами. Хорошую оценку только

ni(t)

Рис. 1.16. Система с одним входом и несколькими выходами.

Основные определения и модели

33

амплитудной характеристики можно построить, зная лишь оценки входной

и выходной спектральных плотностей при условии, что внешним шумом на

входе и выходе можно пренебречь.

Если в модели с одним входом и одним выходом стационарные входной

и выходной сигналы полностью определены, система линейна и имеет по-

стоянные параметры, на входе и выходе отсутствует внешний шум, то

функция обычной когерентности тождественно равна единице на всех ча-

стотах. Любое отклонение от этих идеальных условий приводит к тому,

что значение функции когерентности будет меньше единицы. На практике

оценки функции когерентности часто меньше единицы; эти функции играют

важную роль при оценке статистической надежности измерений частотных

характеристик.

Все эти понятия можно перенести на более общие системы с нескольки-

ми входами и выходами, при этом потребуется определить и соответству-

ющим образом истолковать функции множественной и частной когерент-

ности. Такие общие схемы представимы в виде комбинации систем с не-

сколькими входами и одним выходом при заданных входных стационарных

процессах и различных частотных характеристиках, определяющих систе-

мы с постоянными параметрами, как показано на рис. 1.17. Современные

методы анализа систем со многими входами и выходами, в которых ис-

пользуются условные (остаточные) процессы, рассматриваются в гл. 7.

Рис. 1.17. Система с несколькими входами и одним выходом.

34

Глава 1

Эти методы представляют собой обобщение классических регрессионных

методов, описанных в гл. 4. В частности, строится разложение спектраль-

ной плотности выходного процесса, показанного на рис. 1.17, которое по-

казывает вклад любого входного сигнала в выходной спектр на данной ча-

стоте при некоторых условиях, наложенных на остальные входные сигна-

лы, упорядоченные определенным образом.

Основные понятия математической статистики, используемые при оцен-

ке случайных данных, рассмотрены в гл. 4. В гл. 8 и 9 выводятся формулы

для систематических и случайных ошибок, присущих различным оценкам,

используемым при анализе одномерных и многомерных случайных процес-

сов. В их число входят формулы для случайных ошибок, появляющихся

при оценивании частотных характеристик (как амплитудных, так и фазо-

вых) и функций когерентности (обычной, множественной и частной). Эти

формулы удобны в вычислительном отношении и безусловно полезны для

правильной интерпретации полученных результатов.

1.4.3. ХАРАКТЕРИСТИКИ ОШИБОК

В качестве введения в материал гл. 8 и 9 рассмотрим сейчас некоторые

характеристики ошибок оценивания. Оценку величины ф обозначим через ф,

т. е. с помощью символа ( у. Величина ф — это оценка ф, построенная по

наблюдению на конечном интервале времени или по конечному числу вы-

борочных точек.

Предположим, что оценка ф (хотя бы умозрительно) может быть полу-

чена многократно путем повторения эксперимента или выполнения опреде-

ленной программы измерений. Тогда в^ принципе можно оценить матема-

тическое ожидание ф, обозначаемое £ [ф]. Например, если эксперимент по-

вторяется многократно и дает оценки ф, (/ = 1, 2, ... , TV), то

£[ф] = ^Еф,- (113)

Это математическое ожидание может совпасть или не совпасть с истин-

ным значением ф. В случае совпадения оценка ф называется несмещенной.

В противном случае оценка называется смещенной. Смещение оценки, обо-

значаемое b [ф], равно математическому ожиданию оценки минус истинное

значение параметра:

&[ф] = £[ф] - ф. (1.14)

Следовательно, смещение оценки — это систематическая ошибка, которая

всегда имеет одну и ту же абсолютную величину и один и тот же знак, ес-

ли измерения проводятся при неизменных условиях.

Дисперсия оценки, обозначаемая Уаг[ф], определяется как математиче-

ское ожидание квадрата разности между оценкой и ее средним значением.

Формально

Уаг[ф] = Е [(ф - £[ф])2] .

(1-15)

Основные определения и модели

35

Дисперсия характеризует случайную ошибку оценки, т. е. ту часть общей

ошибки, которая не является систематической и может иметь разные знаки

и разные абсолютные значения от измерения к измерению.

Суммарная ошибка оценивания характеризуется средним квадратом

ошибки, который определяется как математическое ожидание квадрата

разности между оценкой и ее истинным значением. Средний квадрат

ошибки оценки ф равен

£[(ф-ф)2]. (1.16)

Легко проверить, что

я[(ф-ф)2] = Уаг[ф]+(*[ф])2. (1.17)

Иначе говоря, средний квадрат ошибки равен сумме дисперсии и квадрата

смещения. Если смещение равно нулю или пренебрежимо мало, то средний

квадрат ошибки и дисперсия совпадают.

Рис. 1.18 иллюстрирует смысл смещения (систематической ошибки) и

дисперсии (случайной ошибки) на примере пристрелки двух винтовок.

Рис. 1.18, а показывает, что винтовка А обладает большим смещением и

малой случайной ошибкой. Рис. 1.18,6 показывает, что винтовка Б имеет

малое смещение, но большую случайную ошибку. Очевидно, из винтовки А

никогда нельзя попасть в цель, в то время как из винтовки Б можно слу-

чайно поразить ее. Однако большинство стрелков предпочтет винтовку А,

поскольку систематическую ошибку можно исключить (если известно, что

она есть) путем регулировки прицела винтовки, а случайную ошибку устра-

нить нельзя. Следовательно, винтовка А потенциально имеет меньший

средний квадрат ошибки.

2*

Рис. 1.18. Случайные и систематические ошибки при стрельбе из винтовки по

мишени: а — винтовка А, большая систематическая ошибка и малая случайная

ошибка; б — винтовка Б, малая систематическая ошибка и большая случайная

ошибка.

36

Глава 1

Наконец, важной величиной является нормированная среднеквадратич-

ная ошибка оценки, обозначаемая £[ф]. Эта безразмерная ошибка равна

квадратному корню из среднего квадрата ошибки, деленному на истинное

значение параметра (разумеется, в предположении, что оно не равно

нулю). Формально

е[ф] =

/е (ф - ф)2

ф

(1-18)

На практике стараются уменьшить нормированную среднеквадратичную

ошибку в максимально возможной степени. В этом случае появляется уве-

ренность в том, что произвольная оценка ф близка к истинному значе-

нию ф.

1.4.4. МЕТОДЫ АНАЛИЗА ДАННЫХ

Рекомендуемые методы анализа данных детально обсуждаются в

гл. 10—13. В гл. 10 рассматриваются задачи сбора данных, включая их на-

копление, запись, передачу, подготовку и предварительную оценку. Описы-

ваются общие подходы к анализу отдельных реализаций и их совокупно-

стей, которые могут применяться в разнообразных приложениях. Основное

внимание уделяется эффективным методам анализа свойств стационарных

случайных процессов. Методы анализа цифровых данных обсуждаются в

гл. 11, в том числе вычислительные процедуры для исключения тренда и

цифровой фильтрации, ряды Фурье, быстрое преобразование Фурье дис-

кретных временных рядов, представляющих реализации стационарных (эр-

годических) случайных процессов. Выведены численные формулы для по-

строения оценок плотностей вероятности, ковариационных функций и

спектральных плотностей по отдельным реализациям и парам реализаций.

Кроме того, подробно описаны цифровые процедуры получения оценок

всех величин, изученных в гл. 6 и 7 при решении разных задач, связанных с

одномерными и многомерными линейными системами. Гл. 12 посвящена

специальным методам анализа нестационарных процессов, а в гл. 13 рас-

сматриваются методы преобразования Гильберта.

Задачи

1.1. Определите, какие из перечисленных ниже функций являются периодически-

ми, а какие непериодическими:

а)х(/) = 3sinZ 4- 2sin2/ 4- sin3/;

б)х(Г) = 3sin/ 4- 2sin2r 4- sin7r/;

в)х(Г) = 3sin4r 4- 2sin5r 4- sin6/;

r) x (t) = e sin/.

1.2. Определите период функции x (t) = sin 111 4- sin 12/.

В задачах 1.3—1.6 требуется установить, какие из перечисленных свойств всегда

справедливы.

Основные определения и модели

37

1.3. Стационарный случайный процесс должен

а) быть дискретным;

б) быть непрерывным;

в) быть эргодическим;

г) иметь не зависящие от времени средние по ансамблю характеристики;

д) иметь средние по времени характеристики, совпадающие с соответствующи-

ми средними по ансамблю.

1.4. Эргодический процесс должен

а) быть дискретным;

б) быть непрерывным;

в) быть стационарным;

г) иметь не зависящие от времени средние по ансамблю характеристики;

д) иметь средние по времени характеристики, совпадающие с соответствующи-

ми средними по ансамблю.

1.5. Все статистические свойства случайного процесса можно установить по его

единственной реализации, если процесс

а) детерминированный;

б) эргодический;

в) стационарный;

г) обладает всеми перечисленными свойствами.

1.6. Ковариационная функция стационарного случайного процесса должна

а) убывать с возрастанием I т I;

б) зависеть только от сдвига времени;

в) стремиться к постоянной с возрастанием I т I;

г) всегда быть неотрицательной.

1.7. Как изменятся ответы на вопросы задачи 1.6, если стационарный случай-

ный процесс не содержит периодической составляющей?

1.8. Выведите формулу (1.17).

1.9. Известно, что средний квадрат оценки равен 0,25, а смещение равно 0,40.

Вычислите дисперсию оценки.

1.10. Пусть в условиях задачи 1.9 истинное значение параметра равно ф = 5.

Вычислите нормированную среднеквадратичную ошибку оценки.

Глава 2

ЛИНЕЙНЫЕ ФИЗИЧЕСКИЕ СИСТЕМЫ

До детального обсуждения процедур измерения и анализа случайных

физических данных желательно пояснить некоторые важные понятия и ос-

новные определения, относящиеся к динамике физических систем. В этой

главе дается обзор теоретических формул, описывающих характеристики

отклика идеальных линейных систем; основные представления иллюстри-

руются простыми примерами из физики.

2.1. Линейные системы с постоянными параметрами

Идеальная система — это система, которая имеет постоянные пара-

метры и в которой две четко определенные фиксированные характеристи-

ки, именуемые входными (возбуждение) и выходными (отклик), линейно

связаны между собой. Система имеет постоянные параметры, если все ее

основные свойства неизменны во времени. Например, простая пассивная

электрическая цепь будет системой с постоянными параметрами, если зна-

чения сопротивления, емкости и индуктивности всех элементов одинаковы

в разные моменты времени. Система линейна, если ее реакция аддитивна и

однородна. Термин «аддитивна» означает, что реакция на сумму двух вход-

ных сигналов равна сумме реакций на каждый сигнал в отдельности. Тер-

мин «однородна» означает, что реакция на произведение постоянной и

входного сигнала равна произведению этой постоянной и реакции, вызыва-

емой одним лишь сигналом. Формально, если f(x) обозначает реакцию на

входной сигнал х, то система линейна в том случае, когда для любых двух

входных сигналов х j, х 2 и постоянной с имеют место свойство аддитивно-

сти

/(%! + Х2) = /(*1) + /(*2) (2’1а)

и свойство однородности

/(<•%) = с/(х). (2.16)

Предположение о постоянстве параметров на практике выполняется с

разумной точностью для многих физических систем. Например, основные

свойства электрической цепи или механической конструкции обычно не ис-

пытывают существенных изменений на протяжении промежутков времени,

представляющих практический интерес. Разумеется, есть и исключения.

Параметры электрического сопротивления могут измениться под взаимо-

действием высокой температуры, а жесткость конструкции — из-за накоп-

ления усталости, вызванной постоянной вибрацией. Кроме того, в некото-

рые физические системы зависимость параметров от времени заложена

конструктивно и необходима для выполнения системой ее функций. Оче-

видный пример дают электронные системы связи. Однако подобные случаи

являются скорее исключениями и легко выявляются на практике.

С предположением о линейности дело обстоит сложнее. Все физические

Линейные физические системы

39

системы становятся нелинейными при экстремальных значениях входных

сигналов. Например, в электрическом конденсаторе в конце концов проис-

ходит пробой при нарастании напряжения, и, следовательно, проходящий

через него ток уже не будет пропорционален приложенному напряжению;

металлический трос в конце концов оборвется при увеличении нагрузки, и,

следовательно, напряжение уже не будет пропорционально нагрузке. Труд-

ности усугубляются тем, что обычно нелинейные эффекты проявляются

постепенно, начиная с некоторого момента времени. Например, связь меж-

ду нагрузкой и напряжением в металлическом тросе обычно начинает от-

клоняться от линейной задолго до момента обрыва. Тем не менее характе-

ристики отклика многих физических систем можно считать линейными, во

всяком случае в некоторой ограниченной области значений входных сигна-

лов, не рискуя совершить серьезных ошибок.

ПРИМЕР 2.1. НЕЛИНЕЙНАЯ СИСТЕМА. Рассмотрим простую систему с

квадратичной реакцией, в которой выходной сигнал имеет вид

У = /(*) = ах2.

Для любых двух входных сигналов х{ и х2

f(xx + х2) = a(xi + х1)2 = axi + laxix2 + ах2

а свойство аддитивности из соотношения (2.1а) требует, чтобы

/(%! + Х2) = ах\ + ах2 •

Далее, для произвольной постоянной с

f(cx) = а(сх)2 = с2ах2у

а свойство однородности из соотношения (2.16) требует, чтобы

f(cx) = сах\

Следовательно, эта система нелинейна, поскольку она не обладает ни

свойством аддитивности, ни свойством однородности.

2.2. Основные динамические характеристики

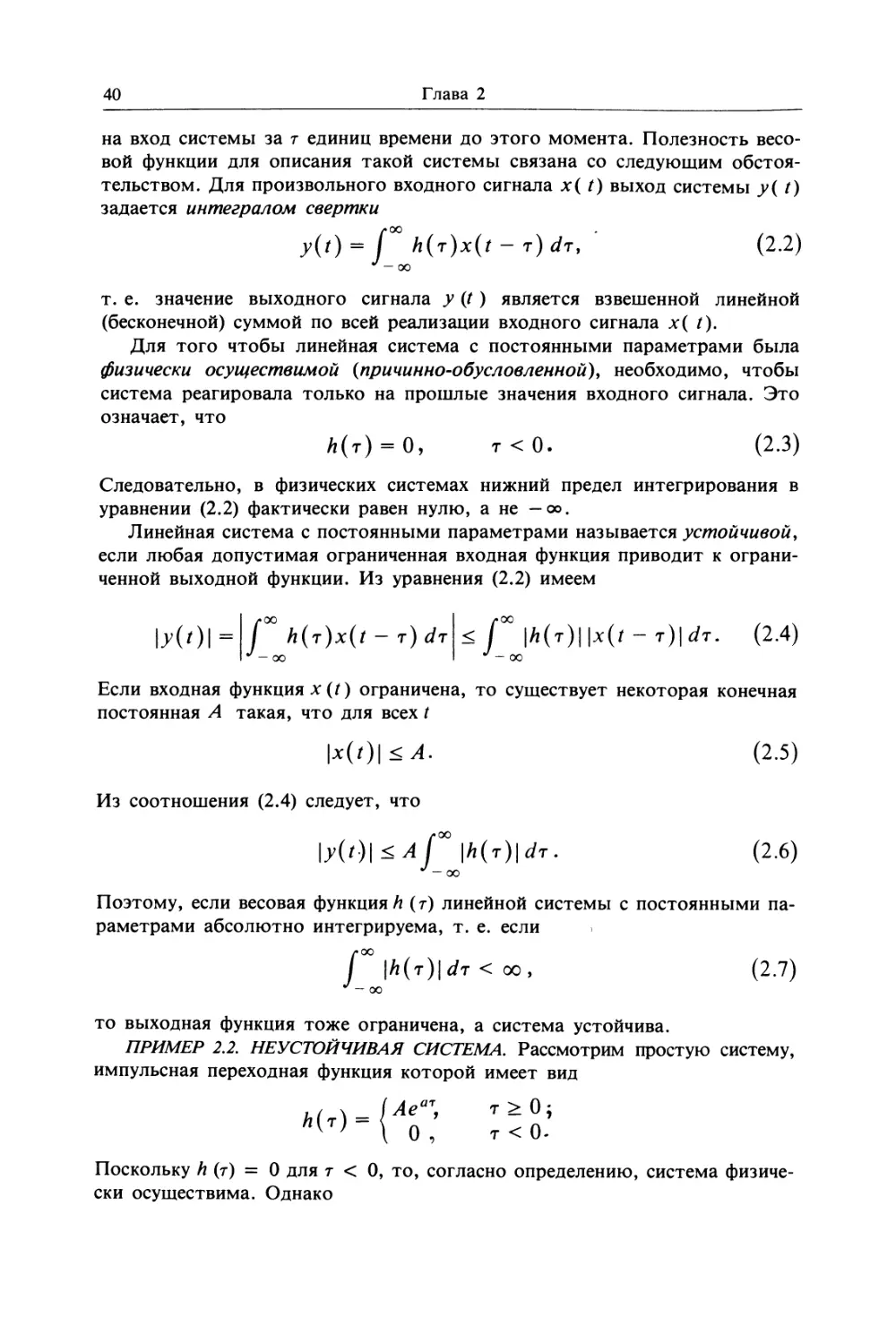

Динамические характеристики линейной системы с постоянными пара-

метрами можно описать с помощью весовой функции h (т), иногда называ-

емой импульсной переходной функцией, которая определяется как реакция

в произвольный момент времени на импульсное воздействие, поступившее

40

Глава 2

на вход системы за г единиц времени до этого момента. Полезность весо-

вой функции для описания такой системы связана со следующим обстоя-

тельством. Для произвольного входного сигнала x(t) выход системы у( t)

задается интегралом свертки

/♦00

y(t) = [ h(r)x(t - г) dr, (2.2)

•'-00

т. е. значение выходного сигнала у (t) является взвешенной линейной

(бесконечной) суммой по всей реализации входного сигнала х( /).

Для того чтобы линейная система с постоянными параметрами была

физически осуществимой (причинно-обусловленной), необходимо, чтобы

система реагировала только на прошлые значения входного сигнала. Это

означает, что

й(т) = 0, т < 0. (2.3)

Следовательно, в физических системах нижний предел интегрирования в

уравнении (2.2) фактически равен нулю, а не — оо.

Линейная система с постоянными параметрами называется устойчивой,

если любая допустимая ограниченная входная функция приводит к ограни-

ченной выходной функции. Из уравнения (2.2) имеем

/оо

|А(т)| |x(z - т)| dr. (2.4)

- nr

Если входная функциях (О ограничена, то существует некоторая конечная

постоянная А такая, что для всех t

|x(z)| < А.

(2-5)

Из соотношения (2.4) следует, что

/00

|й(т)|<7т. (2.6)

- 00

Поэтому, если весовая функция Л (т) линейной системы с постоянными па-

раметрами абсолютно интегрируема, т. е. если

f |Л(т)| dr < оо , (2.7)

•'-00

то выходная функция тоже ограничена, а система устойчива.

ПРИМЕР 2.2. НЕУСТОЙЧИВАЯ СИСТЕМА. Рассмотрим простую систему,

импульсная переходная функция которой имеет вид

Поскольку h (т) = 0 для т < О, то, согласно определению, система физиче-

ски осуществима. Однако

Линейные физические системы

41

г00 z х г00 А

/ |А(т)|</т = / |Леат| dr = -(е000 - 1).

— ос •'о а

Отсюда следует, что система неустойчива при а 0 и устойчива

при а < 0. В частности, если а = — b < 0, то

/•ОО Л Л

I \Ae-h'\dT = — = - •

•'о ~~ b b

На этом пример 2.2 заканчивается.

Линейную систему с постоянными параметрами можно охарактеризо-

вать также передаточной функцией Н (р), которая определяется как преоб-

разование Лапласа функции h (т), т. е.

Н(р)={ h(r)e~pr dr, p = a+jb. (2.8)

•'о

В терминах передаточной функции Н (р) можно придать интересный вид

критерию устойчивости линейной системы с постоянными параметрами

(в предположении, что она физически осуществима). Именно, если Н(р) не

имеет полюсов в правой полуплоскости комплексной плоскости р, включая

мнимую ось (отсутствуют полюса с а 0), то система устойчива. Обрат-

но, если Н (р ) имеет хотя бы один полюс в правой полуплоскости ком-

плексной плоскости р или на ее мнимой оси, то система неустойчива.

Важное свойство линейных систем с постоянными параметрами — со-

хранение частот. Более подробно, рассмотрим линейную систему с посто-

янными параметрами, имеющую весовую функцию h (г). Уравнение (2.2)

показывает, что при произвольной входной функции х (t) п-я производная

по времени выходной функции у (О равна

гоо dnx(t — т)

(2-9>

Пусть теперь на вход поступает гармоническая функциях (Г), т. е.

х(/) = Xsmtynft + 6) . (2.10)

Вторая производная х (t) равна

dt1

-47r2f2x(t).

(2.11)

Из уравнения (2.9) следует, что вторая производная выходной функции(t)

имеет вид

~^ = ~^2f2y(t). (2.12)

42

Глава 2

Следовательно, у (t) — гармоническая функция с той же частотой, что и

х (t). Этот результат показывает, что линейная система с постоянными па-

раметрами не меняет частоты, а воздействует только на амплитуду и фазу

сигнала, подаваемого на вход.

2.3. Частотные характеристики

Если линейная система с постоянными параметрами физически осущест-

вима и устойчива, то ее динамические свойства можно описать посредст-

вом частотной характеристики которая определяется как преобра-

зование Фурье функции h (г), т. е.

/♦00

h(r)e ~j2,r/r dr. (2.13)

Отметим, что нижний предел интегрирования равен нулю, а не — оо, по-

скольку h (т) = 0 при т < 0. По существу, частотная характеристика — это

частный случай передаточной функции, когда в показателе экспоненты р =

= а + jb величина а = 0, a b = 2тг/. В случае физически осуществимых

устойчивых систем частотная характеристика содержит ту же информа-

цию, что и передаточная функция.

Можно получить важное соотношение, содержащее частотную характе-

ристику, взяв преобразование Фурье от обеих частей уравнения (2.2). Пусть

X(f) — преобразование Фурье входного сигналах (О» a Y(f) — преобразо-

вание Фурье соответствующего выходного сигнала у (О, при этом предпо-

лагается, что оба эти преобразования Фурье существуют; тогда из уравне-

ния (2.2) следует, что

У(/) = Я(/)Х(/). (2.14)

Итак, в терминах частотной характеристики системы и преобразований

Фурье входного и выходного сигналов интегралу свертки из уравнения (2.2)

соответствует простое алгебраическое выражение (2.14).

Как правило, частотная характеристика — это комплекснозначная функ-

ция, поэтому удобно представить ее через модуль и аргумент. Для этого

запишем H(f) в полярной форме:

Я(/) = |Я(/)|е-^>. (2.15)

Модуль \H(f)\ называется амплитудной характеристикой, а соответству-

ющий аргумент </>(/') — фазовой характеристикой. В этих терминах частот-

ная характеристика интерпретируется следующим образом. Предположим,

что входным сигналом системы служит гармоническая функция с частотой

f (считаем, что она определена на всей оси времени); эта функция вызыва-

ет выходной сигнал, являющийся, как было показано в разд. 2.2, тоже гар-

монической функцией с той же частотой. Отношение амплитуд выходного

и входного сигналов равно амплитудной характеристике системы I

а сдвиг фазы между выходным и входным сигналами задается фазовой ха-

рактеристикой </>(/*) системы.

Линейные физические системы

43

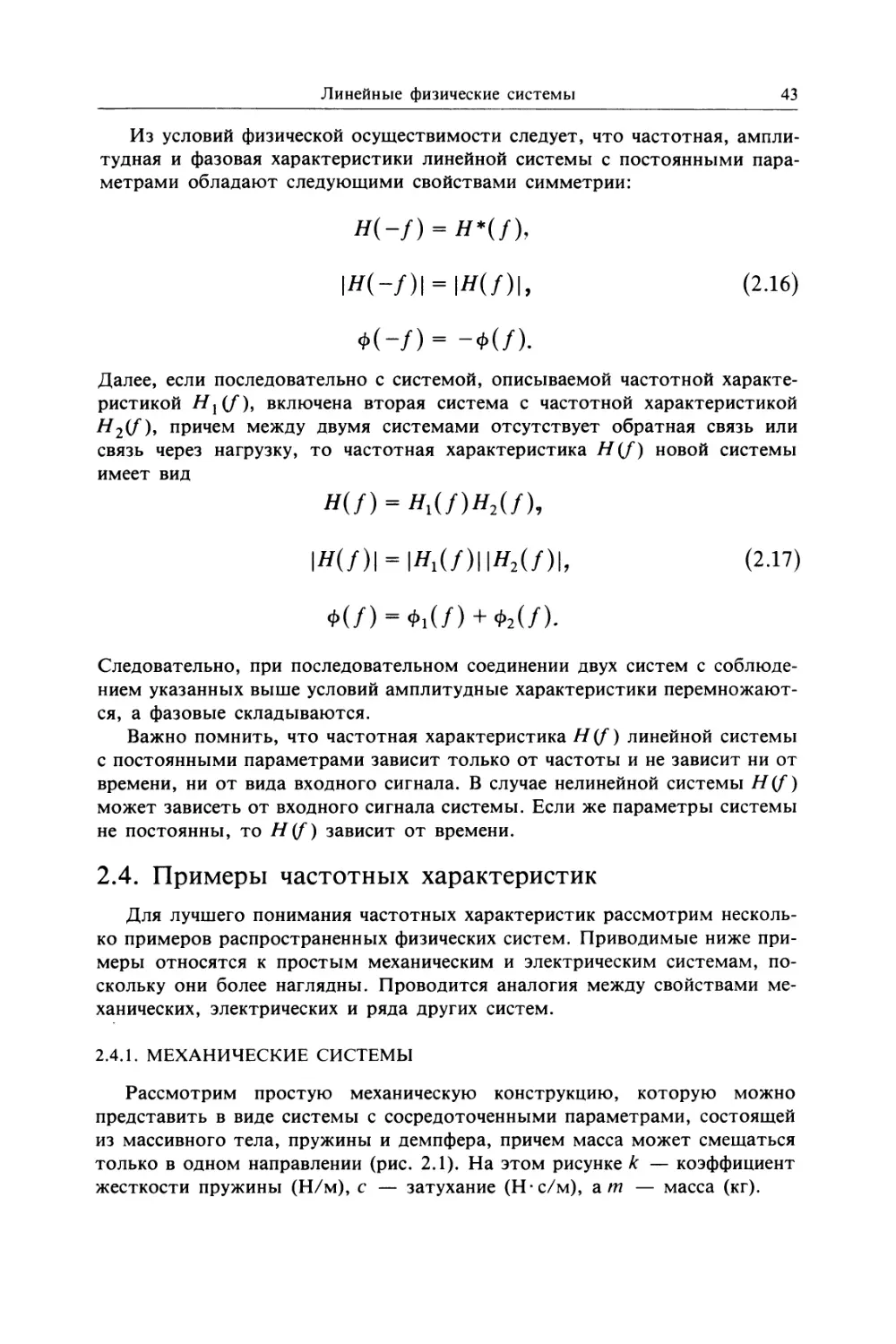

Из условий физической осуществимости следует, что частотная, ампли-

тудная и фазовая характеристики линейной системы с постоянными пара-

метрами обладают следующими свойствами симметрии:

я(-/) = я*(/),

|Я(-/)| = |Я(/)|, (2.16)

Ф(-/) = -Ф(/).

Далее, если последовательно с системой, описываемой частотной характе-

ристикой включена вторая система с частотной характеристикой

причем между двумя системами отсутствует обратная связь или

связь через нагрузку, то частотная характеристика H(f) новой системы

имеет вид

Я(/) = Я1(/)Я2(/),

\Н(П\ = \НАП\\НАП\, (2.17)

Ф(/) = Ф1(/) + Фг(/)-

Следовательно, при последовательном соединении двух систем с соблюде-

нием указанных выше условий амплитудные характеристики перемножают-

ся, а фазовые складываются.

Важно помнить, что частотная характеристика H(f) линейной системы

с постоянными параметрами зависит только от частоты и не зависит ни от

времени, ни от вида входного сигнала. В случае нелинейной системы H(f)

может зависеть от входного сигнала системы. Если же параметры системы

не постоянны, то H(f) зависит от времени.

2.4. Примеры частотных характеристик

Для лучшего понимания частотных характеристик рассмотрим несколь-

ко примеров распространенных физических систем. Приводимые ниже при-

меры относятся к простым механическим и электрическим системам, по-

скольку они более наглядны. Проводится аналогия между свойствами ме-

ханических, электрических и ряда других систем.

2.4.1. МЕХАНИЧЕСКИЕ СИСТЕМЫ

Рассмотрим простую механическую конструкцию, которую можно

представить в виде системы с сосредоточенными параметрами, состоящей

из массивного тела, пружины и демпфера, причем масса может смещаться

только в одном направлении (рис. 2.1). На этом рисунке к — коэффициент

жесткости пружины (Н/м), с — затухание (Нс/м), ат — масса (кг).

44

Глава 2

Рис. 2.1. Простая механическая система.

Перед определением частотной характеристики следует выяснить, какие

входные и выходные параметры системы нас интересуют. Как будет пока-

зано ниже, для системы, изображенной на рис. 2.1, возможно несколько

вариантов выбора таких параметров.

Сила как входной процесс и смещение тела

как выходной процесс. Допустим, что в качестве входного сиг-

нала нас интересует сила, приложенная к телу, а в качестве выходного сиг-

нала — вызванное силой смещение тела (рис. 2.2). Здесь F(t) — приложен-

ная сила в ньютонах, y(t) — соответствующее смещение тела в метрах.

Для определения частотной характеристики этой системы в первую оче-

редь следует вывести уравнение движения. Для этого воспользуемся одним

из основных положений механики, согласно которому сумма всех сил,

действующих на массу, должна равняться нулю:

F(t) + Fk(.t) + Fc(z) + Fm(t) = 0, (2.18)

где

Fk(t) = — ky(t) — упругая сила пружины, (2.18а)

Fc(t) = — cy(t) — демпфирующая сила, (2.186)

= -my(t) — сила инерции, (2.18в)

t) =----------скорость,

dt

y(t)

F(t)

Рис. 2.2. Механическая система, входом

которой служит сила.

Линейные физические системы

45

y(t) =

d2y(t)

dt2

— ускорение.

Следовательно, уравнение движения Системы имеет вид

my(t) + cy(t) + ky(t) = F(t). (2.19)

В разд. 2.3 частотная характеристика системы была определена как пре-

образование Фурье реакции системы на импульсное воздействие. В данном

случае реакция системы — это смещение у (t); его преобразование Фурье

дается формулой

г(/) = ry(t)e-^'dt = H(f). (2.20)

•'о

Тогда преобразования Фурье имеют вид

[j(0] (2.20а)

[j>(0]= -(2^)2Я(/). (2.206)

Переходя к преобразованиям Фурье в обеих частях уравнения (2.19) с уче-

том того, что преобразование Фурье импульсного воздействия силы

F(t) = 6(0 равно единице, получим следующее выражение:

[-(2tt/)2W + j2irfc + Л] H(f) = 1. (2.21а)

Поэтому

[k-(2vf)2m+j2vfc]~\ (2.216)

где индекс f—d указывает, что рассматриваемая функция H(f) связывает

силу на входе и смещение на выходе системы.

Уравнение (2.21) целесообразно переписать в другой форме, введя обо-

значения

с

ly/km

fn = ^4- ’ (2.226)

2 77 V т

Величина f из формулы (2.22а) безразмерная и называется коэффициентом

затухания. Величина fn из формулы (2.226) называется собственной часто-

46

Глава 2

той незатухающих колебаний и измеряется в герцах. Подставив эти вели-

чины в уравнение (2.21), получим следующее выражение:

1A

(2.23)

1-(///J2+W//„

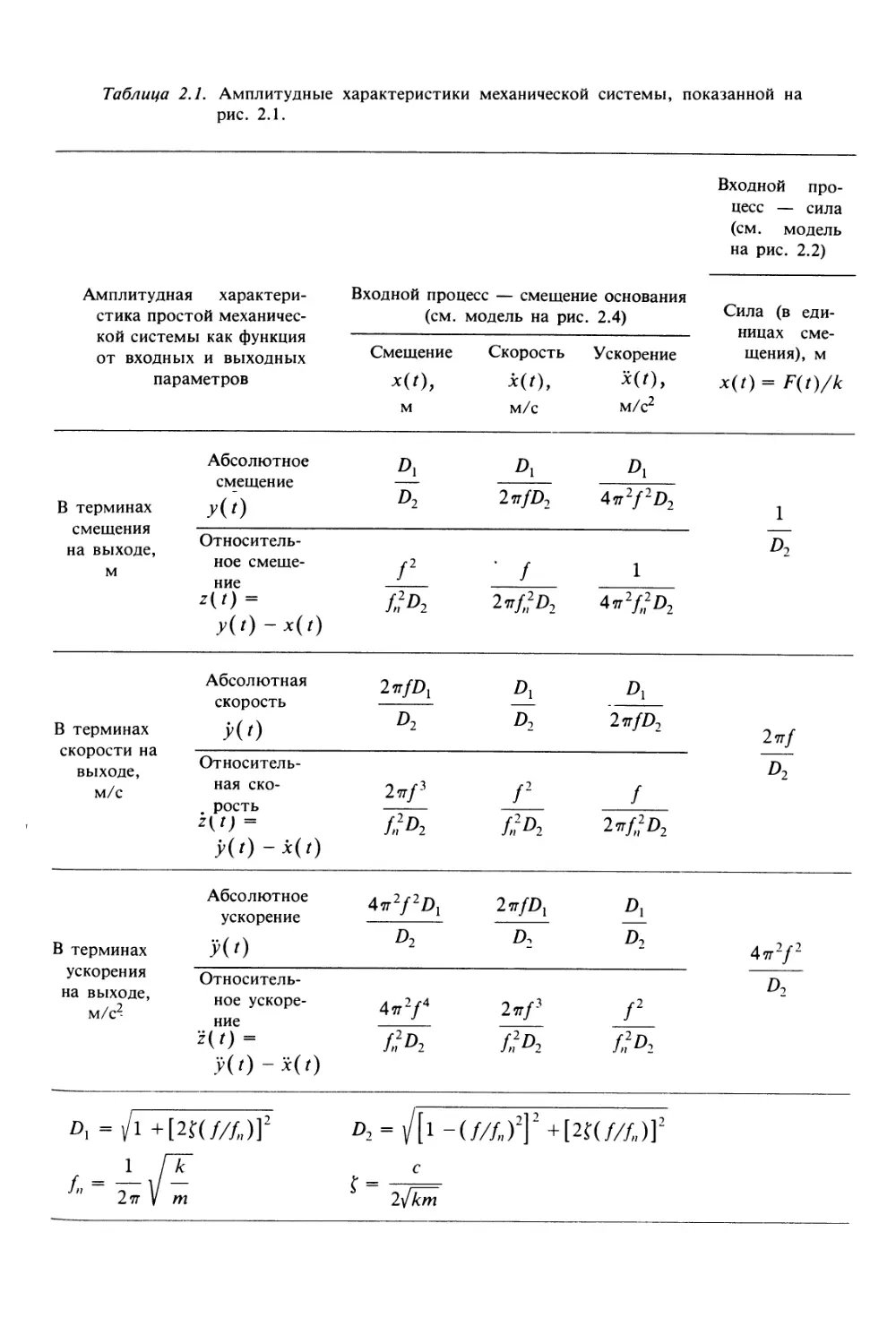

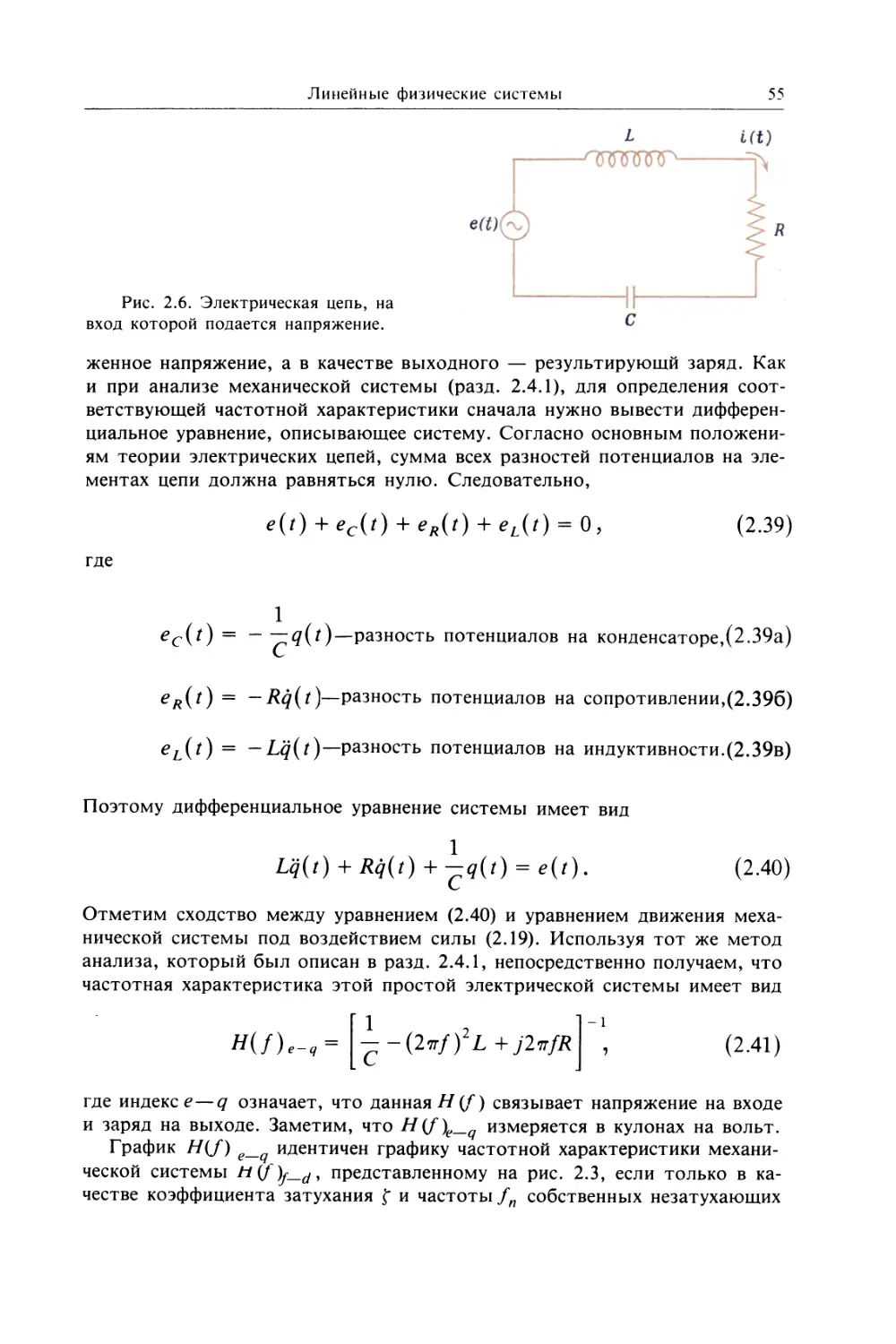

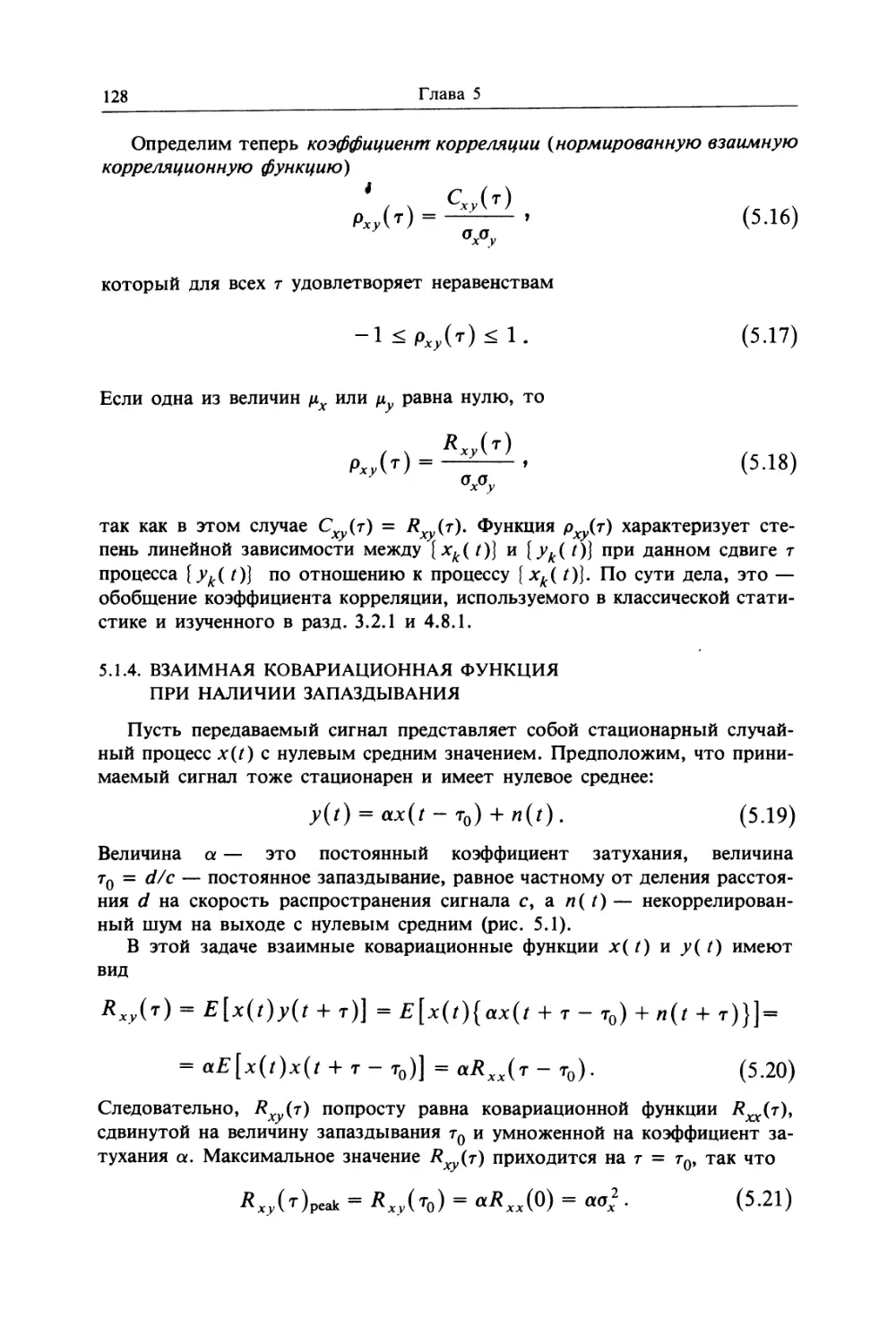

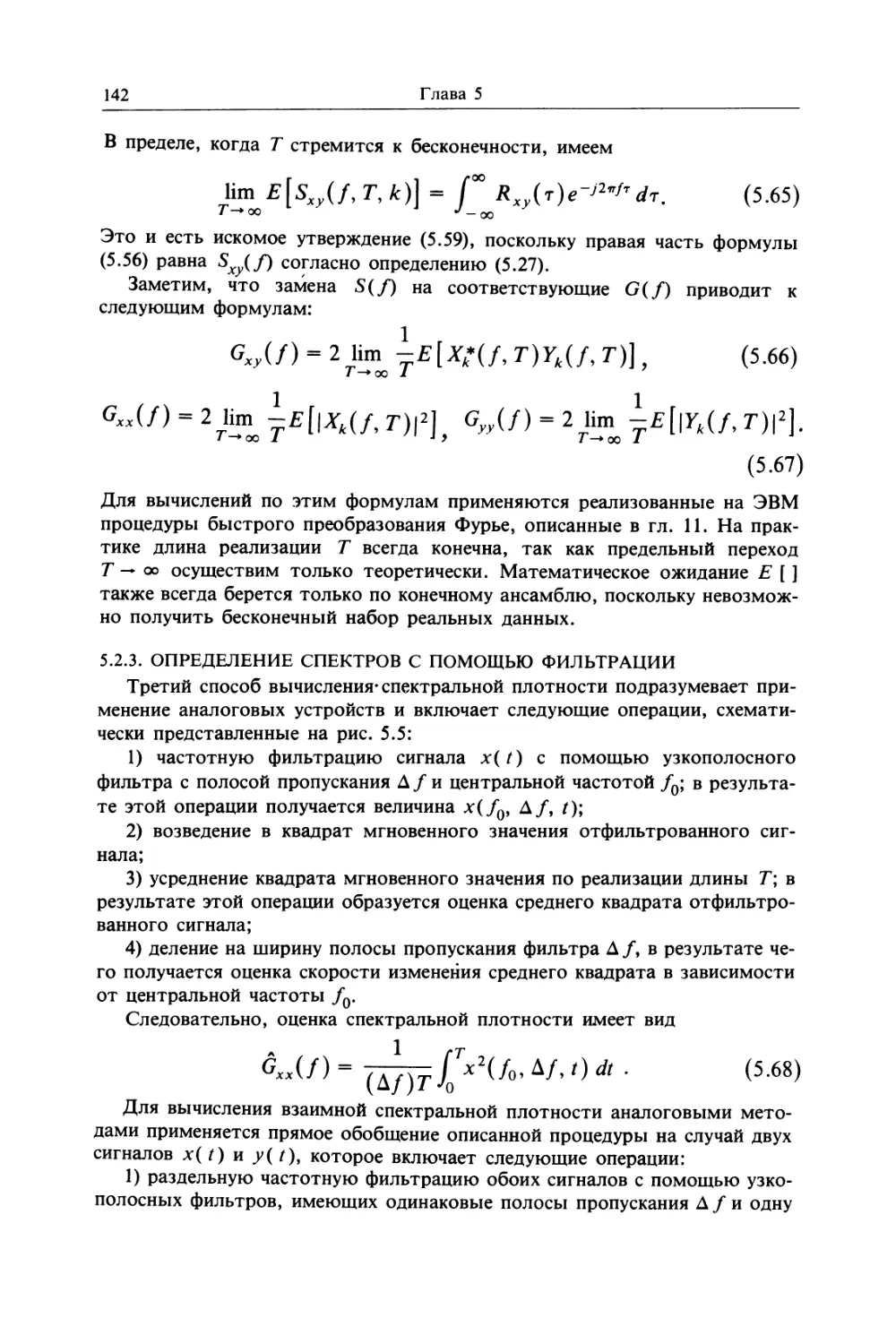

Переписав выражение (2.23) в показательной форме, получим выражение

для частотной характеристики в терминах амплитудной (Iи фазовой